DeepSeek V4 vs GPT-5.5: зачем open weights стали встречным ходом рынка

DeepSeek V4 и GPT-5.5 одновременно вошли в класс million-token context. Главный спор теперь не только о качестве, но и о способе доступа к frontier-модели.

Проверено 25 апреля 2026 года. DeepSeek V4 vs GPT-5.5 быстро стало главным сравнением конца апреля. Причина простая: компании почти одновременно вышли в один и тот же сегмент длинного контекста, но с противоположной логикой доступа. OpenAI 23 апреля представила GPT-5.5, сначала вывела модель в ChatGPT и Codex, а 24 апреля открыла её в API. В тот же день DeepSeek перевела линейку на V4, добавила deepseek-v4-pro и deepseek-v4-flash в API и выложила open-weight preview на Hugging Face под лицензией MIT.

По данным AP, релиз DeepSeek вышел через часы после запуска GPT-5.5 у OpenAI. Формально это не повод писать, будто одна компания буквально ответила другой по сценарию пресс-службы. Но рынок читает тайминг именно так: обе стороны говорят про длинный контекст, только OpenAI продаёт его как закрытый управляемый сервис, а DeepSeek как сочетание API и открытых весов.

Если нужен фон по самой продуктовой раскатке OpenAI, сначала стоит открыть наш разбор выхода GPT-5.5 в ChatGPT и Codex. Этот текст про другое: почему после 24 апреля frontier-модели стало труднее сравнивать только по качеству ответа и цене за токен. Теперь в центре сравнения ещё и способ доступа к одной и той же мощности.

Почему рынок свёл эти релизы в одну пару

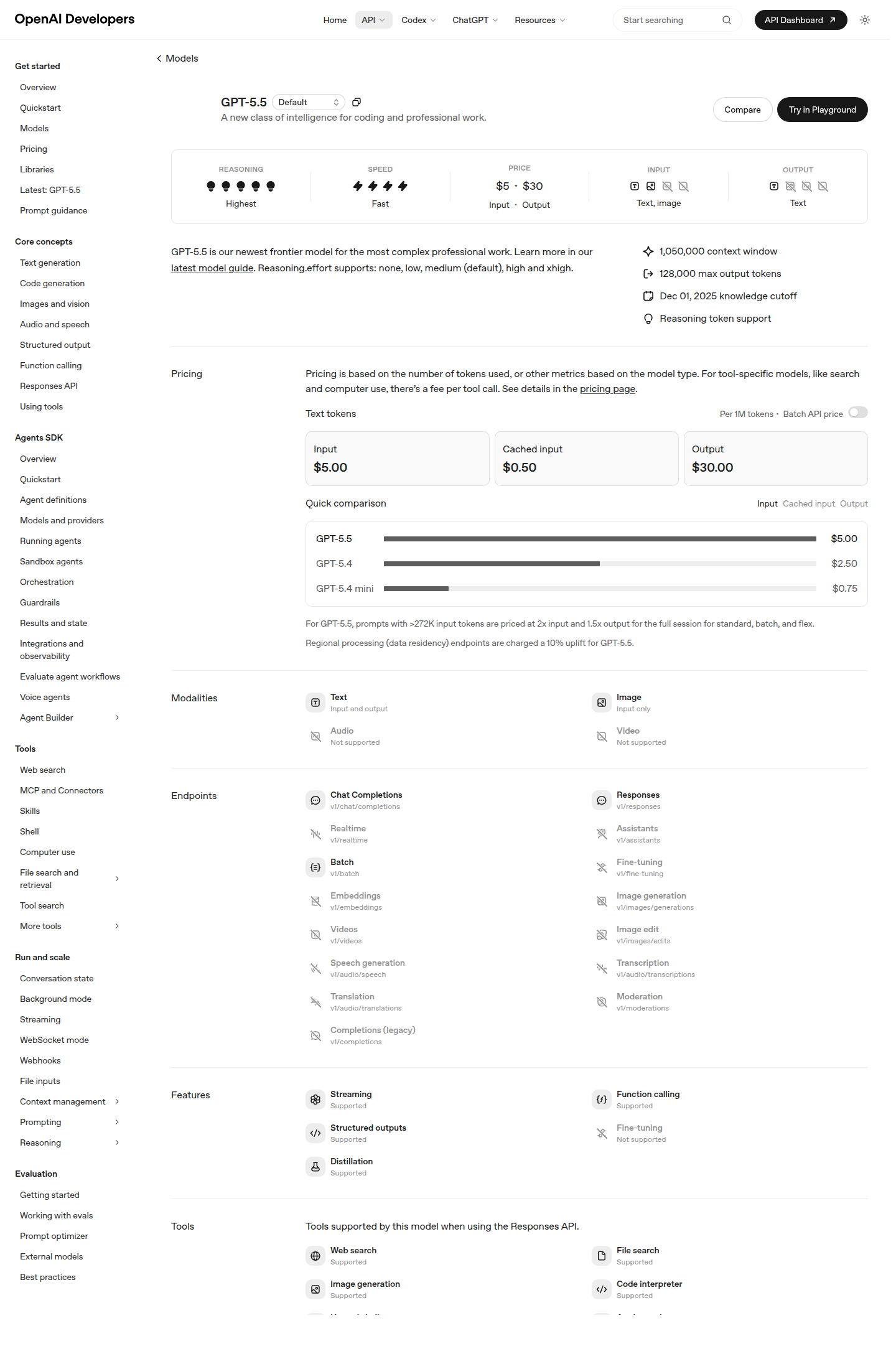

На бумаге у DeepSeek V4 и GPT-5.5 много различий, но одна общая деталь слишком заметна, чтобы её игнорировать: обе стороны пришли в класс million-token reasoning. У OpenAI в карточке gpt-5.5 указано контекстное окно 1,050,000 токенов. У DeepSeek для V4 Pro и V4 Flash в API-документации указан 1 млн токенов. Это уже делает сравнение неизбежным.

| Ось сравнения | DeepSeek V4 | GPT-5.5 |

|---|---|---|

| Дата ключевого этапа | 24 апреля 2026 года | 23 апреля 2026 года; API открыт 24 апреля |

| Контекстное окно | 1 млн токенов | 1,050,000 токенов |

| Статус весов | Open weights, MIT | Закрытые веса |

| Основной путь доступа | Hugging Face + DeepSeek API | ChatGPT, Codex и OpenAI API |

| Формат API | OpenAI Chat Completions и Anthropic-compatible | OpenAI API / Responses API |

На этом месте сравнение выходит за пределы обычной новости. Рынок видит два ответа на один и тот же запрос. Один вариант предлагает очень сильную модель внутри закрытого контура вендора. Второй выкладывает веса, сохраняет облачный API и оставляет инфраструктурной команде право самой решать, где проходит граница между облаком и своим стеком.

Что OpenAI продаёт вместе с GPT-5.5

OpenAI в этом цикле делает ставку не на идею open model, а на управляемую рабочую поверхность. Сначала компания вывела GPT-5.5 в ChatGPT и Codex, объяснив задержку API отдельными safeguards для внешних развёртываний. Уже 24 апреля модель появилась и в API, но логика релиза не изменилась: сначала собственные продукты, потом разработческий контур.

Это важно, потому что GPT-5.5 продаётся не сама по себе. Вместе с ней OpenAI продаёт среду: доступ через ChatGPT и Codex, набор инструментов, собственный стек безопасности, лимиты, режимы работы и предсказуемый сервис. Для многих корпоративных команд это реальное преимущество. Им нужен не только интеллект модели, но и понятный способ встроить его в уже существующий рабочий процесс без самостоятельной сборки сложной инфраструктуры.

У этой модели есть и обратная сторона: веса закрыты, а правила доступа определяет вендор. Команда может купить мощный API, но не может скачать модель, перенести её в свой контур и настроить собственную экономику инференса так же свободно, как это возможно с open-weight релизом.

gpt-5.5 в OpenAI API: 1,050,000 токенов контекста, закрытый контур и управляемый сервис. Источник: OpenAI Developers.Что DeepSeek меняет одним только форматом релиза

DeepSeek делает почти зеркальный ход. В changelog за 24 апреля компания не просто добавляет новые имена моделей. Она переводит API на deepseek-v4-pro и deepseek-v4-flash, оставляет старые алиасы как временный мост и сразу объявляет срок их вывода из обращения, 24 июля 2026 года. Это выглядит не как осторожный эксперимент, а как полноценный переход линейки на новый класс моделей.

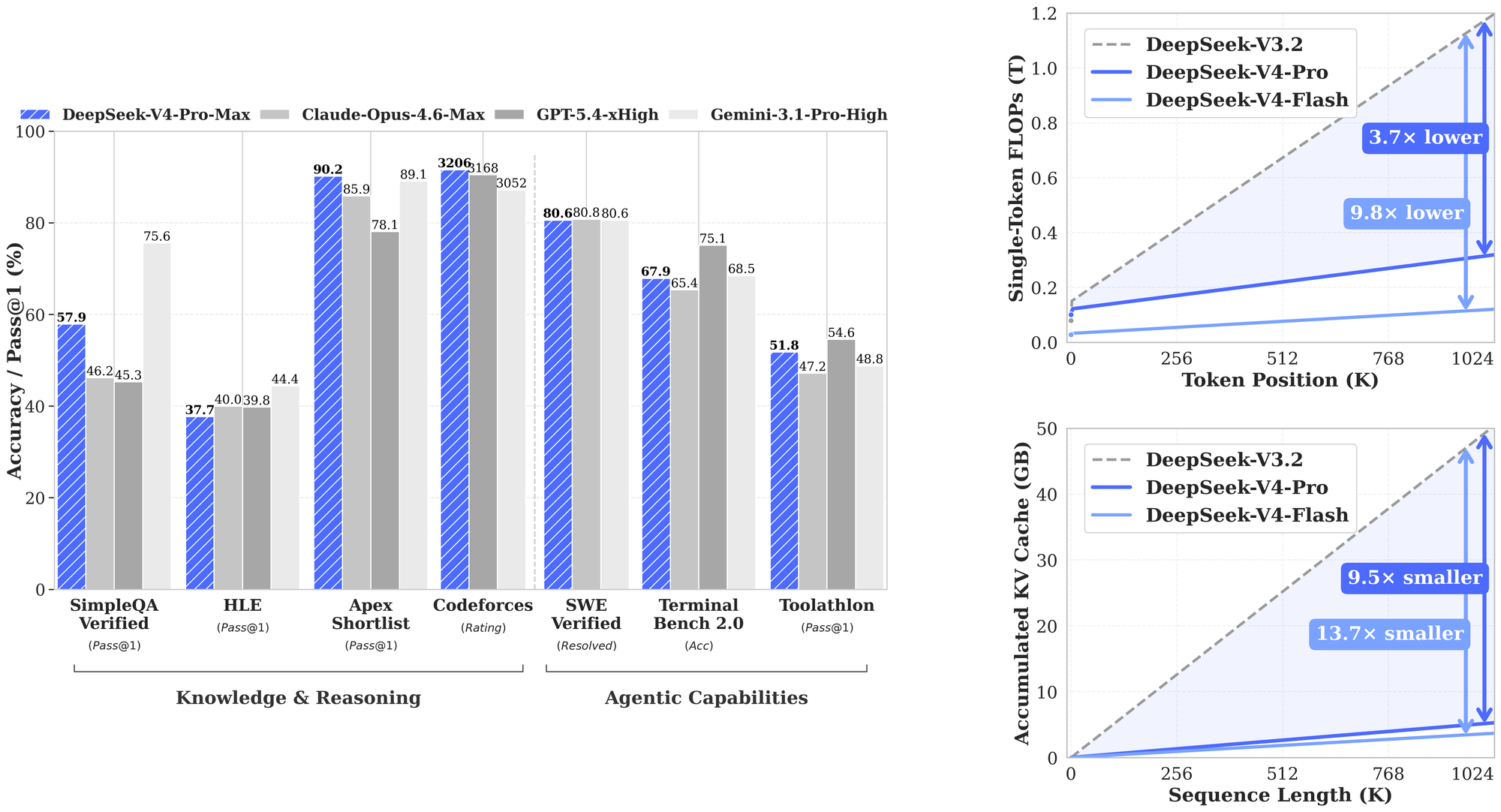

На Hugging Face DeepSeek-V4-Pro описана как MoE-модель на 1,6 трлн параметров с 49 млрд активных. У V4 Flash масштаб меньше, 284 млрд общих и 13 млрд активных параметров, но логика та же: миллион токенов контекста, thinking и non-thinking режимы, tool calls, JSON output, FIM и открытые веса под MIT. Если нужен широкий фон по экосистеме DeepSeek, он уже есть в нашем полном гайде по DeepSeek на русском. Здесь важнее другое: компания сознательно подаёт V4 не только как модель, но и как альтернативный способ владеть frontier-возможностями.

При этом важно не свалиться в романтическую версию open source. V4 Pro не превращает frontier-модель в игрушку для ноутбука. Масштаб слишком большой, а своя инфраструктура для такого класса моделей остаётся дорогой и сложной. Но сам факт, что у покупателя есть выбор между облачным API и весами, меняет переговорную позицию сильнее, чем ещё один рекламный график.

Почему open weights здесь важнее ещё одного спора о цене

У DeepSeek есть и ценовой аргумент, причём сильный. Но если свести новый материал к прайсу, он начнёт дублировать наш разбор экономики DeepSeek V4. Для этой статьи важнее другое: open weights меняют не только сумму в одном счёте, но и саму архитектуру выбора.

С GPT-5.5 компания выбирает между разными продуктами OpenAI и разными режимами внутри одного вендора. С DeepSeek V4 компания может выбирать уже между типами владения: остаться в API, поднимать свой контур, совмещать оба режима или использовать V4 как инструмент давления на цены и условия закрытых поставщиков. Это уже не обычное сравнение "у кого модель умнее". Это сравнение того, кто контролирует способ доступа к этой умности.

На рынке ИИ это особенно чувствительно в двух случаях. Первый, когда речь идёт о длинной рабочей памяти, больших общих префиксах, постоянных policy-файлах и агентных сессиях, которые живут долго. Второй, когда компания не хочет полностью зависеть от чужого интерфейса и чужой дорожной карты. Именно поэтому DeepSeek V4 читается как встречный ход не только против GPT-5.5, но и против самой логики закрытого frontier-рынка.

Где у GPT-5.5 всё ещё сильная позиция

Было бы небрежно объявить эту историю победой open-weight лагеря. DeepSeek выиграла внимание рынка, но это не значит, что закрытый контур OpenAI вдруг стал второсортным. У GPT-5.5 по-прежнему сильны те вещи, которые сложно свести к одной строке в карточке модели: зрелая продуктовая поверхность, собственные инструменты, управляемая безопасность, корпоративная предсказуемость и понятный облачный сервис.

Есть и ещё одна важная оговорка. Open weights не равны лучшему качеству по умолчанию. DeepSeek в собственных материалах делает ставку на эффективность и доступ к модели, а не на тезис "мы уже окончательно перегнали всех закрытых конкурентов". Поэтому корректнее говорить так: V4 не закрывает спор о качестве, но резко меняет спор о том, кто и на каких условиях может работать с frontier-моделью.

Здесь DeepSeek V4 vs GPT-5.5 и становится полезным сравнением. OpenAI сильнее как контролируемая сервисная среда. DeepSeek важнее как сигнал, что frontier-возможности больше нельзя автоматически отождествлять с полностью закрытым доступом.

Что меняется после 24 апреля

После этой пары релизов рынок сложнее описывать старой формулой "закрытые модели лучше, открытые дешевле". GPT-5.5 показывает, как далеко можно продвинуть закрытый продуктовый контур с мощной моделью и длинной памятью. DeepSeek V4 показывает, что такой же класс длинного контекста можно вывести в режим, где веса доступны, API не исчезает, а разработчик получает больше свободы.

Для команд это довольно практический сдвиг. Сравнивать теперь нужно не только бенчмарки и токеновые ставки, но и четыре других параметра: кто контролирует доступ, можно ли перенести модель в свой контур, насколько дорого будет держать длинную память и насколько вендор связывает интеллект с собственной продуктовой оболочкой.

DeepSeek V4 vs GPT-5.5 поэтому стоит читать не как финальную таблицу лидеров, а как смену самой базы сравнения. До апреля 2026 года рынок чаще спорил о том, какая закрытая модель впереди. После 24 апреля спор формулируется жёстче: если frontier-модель уже умеет жить на миллионном контексте, то почему один вендор даёт доступ только через свой контур, а другой ещё и выкладывает веса?

Источники и дата проверки

Факты, даты, характеристики и формулировки в этом материале проверены 25 апреля 2026 года по официальным страницам OpenAI, OpenAI Developers, DeepSeek API Docs и Hugging Face, а также по сообщениям AP и The Verge для внешнего контекста релиза и рыночной реакции.