GPT-5.5 в ChatGPT и Codex: главные сигналы рынка ИИ 23 апреля

OpenAI вывела GPT-5.5 в ChatGPT и Codex, но не открыла модель в API в день анонса. Это важнее обычного релизного шума: рынок снова смещается к рабочему контуру вокруг модели.

GPT-5.5 OpenAI представила 23 апреля 2026 года и сразу вывела модель в собственные рабочие поверхности: ChatGPT и Codex. По состоянию на 24 апреля 2026 года GPT-5.5 постепенно появляется у пользователей Plus, Pro, Business и Enterprise в ChatGPT, а в Codex OpenAI отдельно заявляет доступ для Plus, Pro, Business, Enterprise, Edu и Go. API компания обещает открыть очень скоро, но не в день анонса. Это главный факт релиза: OpenAI снова сначала усиливает свой продуктовый контур, а уже потом отдаёт новую модель внешним разработчикам.

На официальной странице релиза компания подчёркивает рост в задачах агентного программирования, работе за пользователя в интерфейсах и знаниевом труде. Но для рынка важнее не только то, что GPT-5.5 сильнее GPT-5.4. Важнее то, где OpenAI разрешает этой силе работать. Если новая ступень интеллекта сначала уходит в ChatGPT и Codex, конкурентная борьба снова смещается к рабочему интерфейсу, а не только к API-цене и сухим бенчмаркам.

Что OpenAI открыла сразу

В ChatGPT новая модель идёт как GPT-5.5 Thinking, а GPT-5.5 Pro доступна только на Pro, Business и Enterprise. Страница справки OpenAI отдельно предупреждает, что раскатка идёт постепенно и у части пользователей модель может не появиться сразу. Для редакции это важная оговорка: анонсировано и доступно у всех здесь не одно и то же.

В Codex ставка ещё прямее. В разделе доступности OpenAI пишет про 400K контекстного окна и режим Fast: токены генерируются в 1,5 раза быстрее, но по цене в 2,5 раза выше. Это уже не язык обычного релиза модели, а язык рабочего режима. Мы отдельно разбирали, как OpenAI превращает Codex в рабочую среду для агентного программирования. На фоне нашего разбора GPT-5.4 видно, что OpenAI продаёт не просто новую ступень качества, а конкретный способ использовать её в длинной инженерной сессии.

Бенчмарки OpenAI тоже показывает аккуратно, но достаточно ясно. В анонсе компания ставит GPT-5.5 на 82,7% в Terminal-Bench 2.0 против 75,1% у GPT-5.4 и на 58,6% в SWE-Bench Pro против 57,7% у GPT-5.4. Это заметный рост, но сам по себе он не объясняет более интересный ход: релиз сначала приземлён в ChatGPT и Codex, а не в открытый API-контур.

Почему API оставили на потом

Объяснение у OpenAI прямое: API-развёртывания требуют отдельных safeguards и отдельной работы с безопасностью и безопасным обслуживанием в масштабе. Это звучит как бюрократическая сноска, но на деле это сильный рыночный сигнал. В собственном продукте OpenAI контролирует интерфейс, доступные инструменты, режимы использования и темп раскатки. Через API тот же интеллект уходит в тысячи чужих приложений, где цена ошибки заметно выше.

Этот осторожный запуск хорошо читается рядом с другим официальным тезисом OpenAI: компания относит биологические, химические и кибервозможности GPT-5.5 к уровню High в своей Preparedness Framework. Иными словами, OpenAI сама признаёт, что модель сильнее не только в написании кода и офисной работе, но и в чувствительных областях. Отсюда и продуктовая логика: сначала более закрытый контур ChatGPT и Codex, потом API.

Для рынка это плохая новость только в одном случае: если вы ждали, что GPT-5.5 можно будет интегрировать в свой стек уже 23 апреля. Для всех остальных это довольно трезвый сигнал. Вендоры передовых моделей всё чаще разделяют три слоя, которые раньше читались как одно и то же: собственный интерфейс, агентный рабочий режим внутри него и внешний API для разработчиков.

Цены уже объявлены, доступа ещё нет

OpenAI уже назвала API-цены, хотя сам API в день анонса не открыла. Когда GPT-5.5 появится для внешних разработчиков, базовая модель должна стоить $5 за 1 млн входных токенов и $30 за 1 млн выходных. Для GPT-5.5 Pro компания заявляет $30 за вход и $180 за выход. Для обеих моделей обещан контекст 1 млн токенов в API. Это важное уточнение для команд, которые сейчас считают бюджеты: цена уже известна, но доступ пока нет, а значит архитектурные планы нельзя принимать за готовый продукт.

На практике это усиливает тренд, который мы уже разбирали в материале про цены и лимиты ИИ-агентов для программирования. Вендоры разводят саму модель, рабочий режим внутри собственного продукта и внешний API. GPT-5.5 это подтверждает особенно чисто: в Codex вы уже получаете 400K контекста и быстрый режим, а в API пока видите только обещанный прайс-лист.

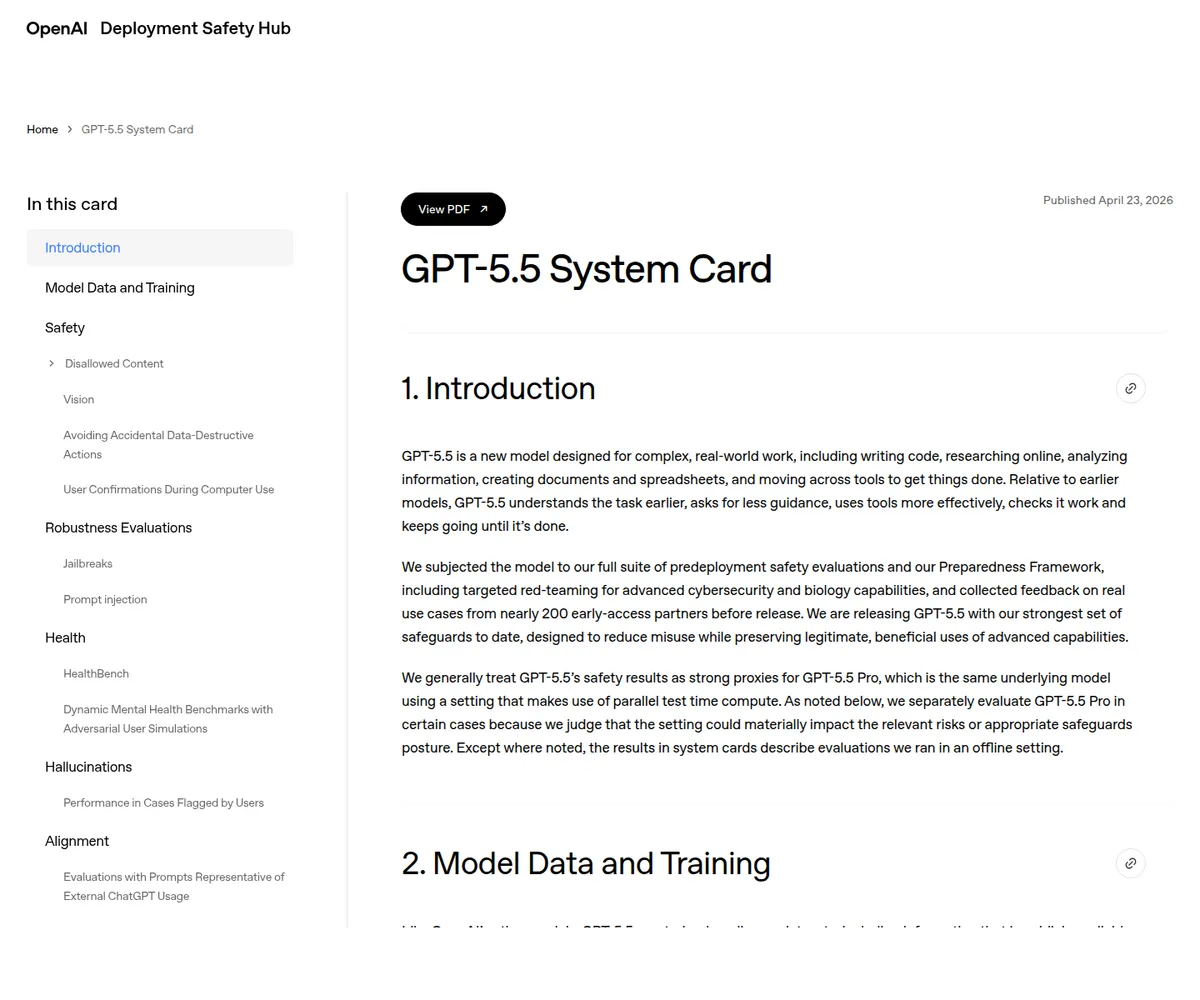

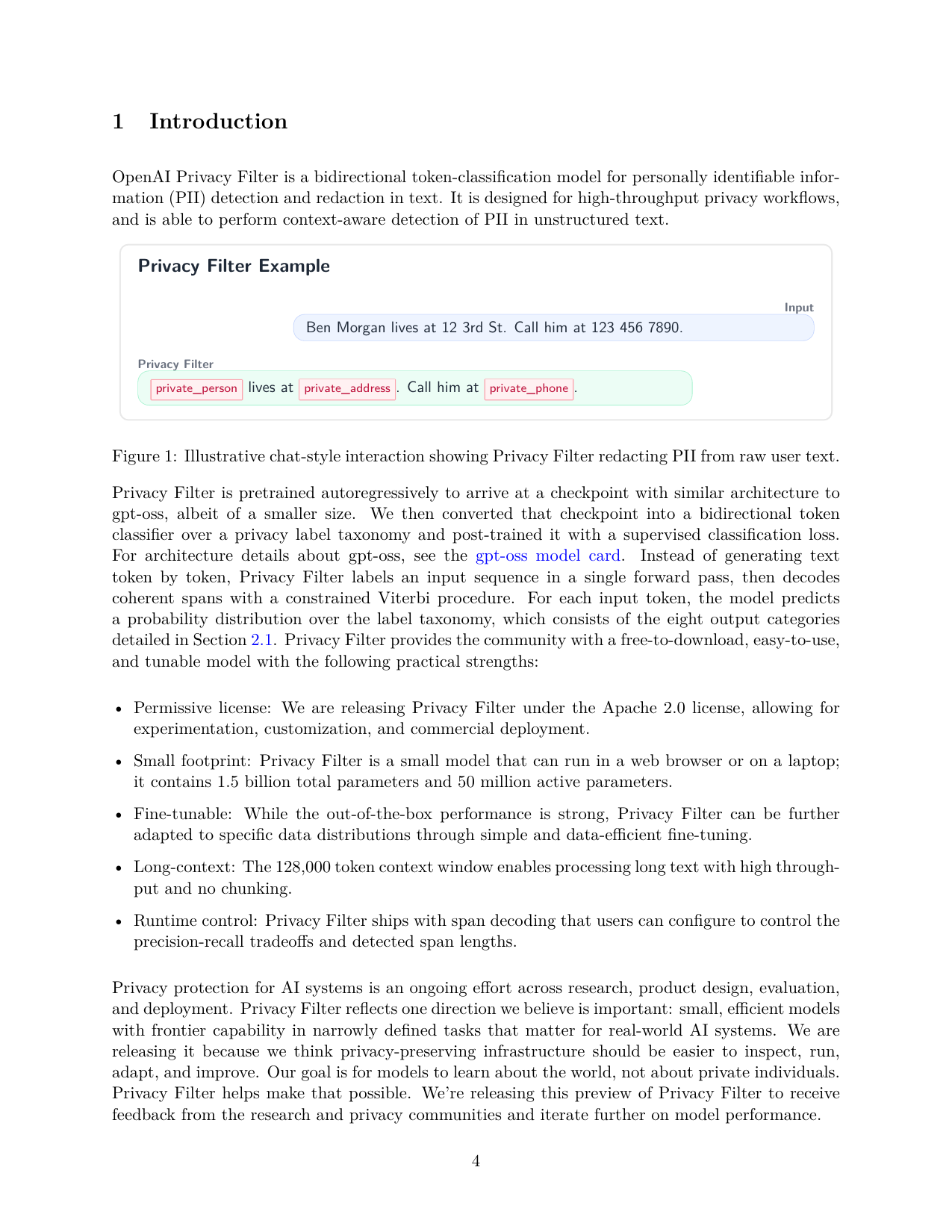

Сильный сигнал №1: OpenAI выпускает privacy-инфраструктуру рядом с GPT-5.5

За день до GPT-5.5 OpenAI выпустила ещё один важный продукт, который легко пропустить на фоне большой модели. 22 апреля компания представила OpenAI Privacy Filter: модель с открытыми весами для обнаружения и редактирования персональных данных в тексте. Здесь важны не только слова про открытые веса и Apache 2.0. OpenAI прямо пишет, что модель можно запускать локально, а значит фильтрация может происходить без отправки неочищенных данных на внешний сервер.

Это меняет картину рынка сильнее, чем кажется. Большие вендоры уже конкурируют не только передовыми моделями, но и вспомогательной инфраструктурой: фильтрацией PII, журналированием, маршрутизацией, памятью, рабочими агентными режимами и контурами доступа. В карте модели Privacy Filter OpenAI отдельно указывает 128K контекста, 1,5 млрд параметров и всего 50 млн активных параметров. То есть компания выкладывает не ещё одну универсальную LLM, а узкий производственный инструмент, который можно встроить в пайплайны обучения, индексирования, логирования и ревью.

На фоне GPT-5.5 это особенно показательно. Если одна рука OpenAI выпускает более сильную рабочую модель, а другая одновременно открывает privacy-инструмент под локальное использование, компания явно строит не только витрину ChatGPT, но и весь корпоративный контур вокруг неё.

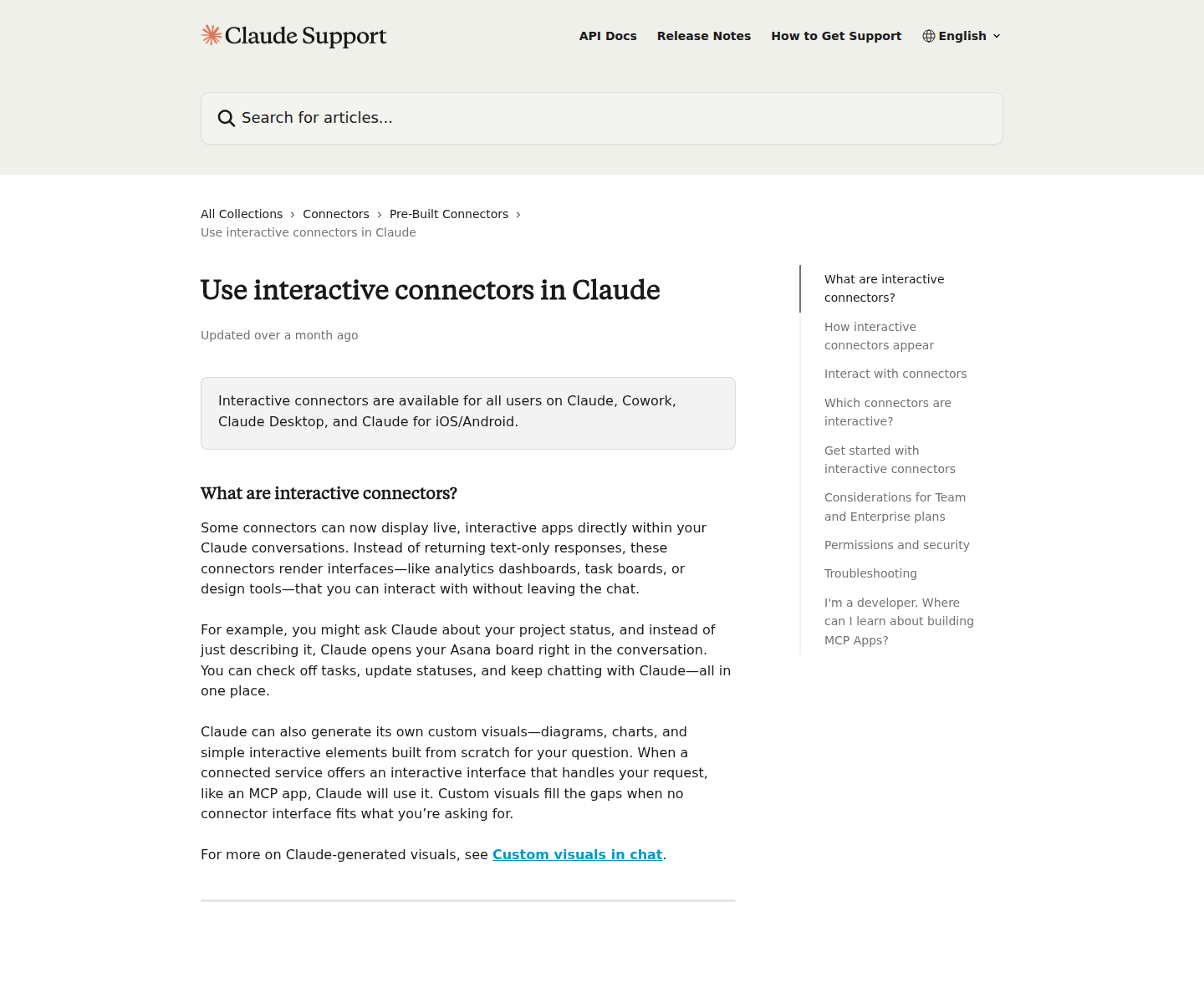

Сильный сигнал №2: Anthropic опускает коннекторы на уровень личных приложений

Второй важный сигнал приходит уже не от OpenAI, а от Anthropic. В журнале релизов Claude указано, что ещё 25 марта 2026 года Claude для iOS и Android получил полностью интерактивные приложения. Текущая справка по интерактивным коннекторам пишет ещё прямее: эта механика доступна всем пользователям Claude, Cowork, Claude Desktop и Claude for iOS/Android. Отдельная iOS-страница перечисляет системные приложения Messages, Mail, Calendar, Maps, Reminders и Location Services, а также совместимые сторонние приложения.

Здесь важен не список коннекторов сам по себе. Важно, что борьба между платформами идёт всё ниже по стеку. Модель должна не только ответить, но и открыть нужный экран, показать карточку действия, черновик письма, задачу в Asana или макет в Figma. Это тот же сдвиг, который мы уже отмечали в материале про OpenAI Workspace Agents: интерфейс ИИ всё больше становится операционной оболочкой над рабочими приложениями.

Если поставить рядом GPT-5.5, Privacy Filter и интерактивные коннекторы Claude, картина становится довольно чёткой. Следующий раунд рынка ИИ идёт не только за счёт самой умной модели. Он идёт за счёт рабочего контура: кто быстрее даст безопасный доступ к сильной модели, кто встроит её в реальные приложения и кто сможет объяснить корпоративному клиенту, как всё это контролировать.

Что из этого следует

По состоянию на 24 апреля 2026 года главный вывод простой. GPT-5.5 это не просто ещё один скачок поверх GPT-5.4. OpenAI снова показывает продуктовую иерархию: сначала ChatGPT и Codex, потом API. Параллельно компания открывает privacy-инструмент под локальное использование, а Anthropic продолжает опускать действия ИИ в коннекторы и мобильные приложения.

Для разработчиков это значит одно: ждать нужно не только новой модели, но и нового режима работы с ней. Для команд стоит смотреть не только на цену за токены, но и на контекстное окно, скорость, доступные инструменты, правила безопасности и то, где именно вендор разрешает модели действовать. В 2026 году это уже не детали релиза. Это и есть продукт.