GPT-5.4 от OpenAI: миллион токенов, бенчмарки и цены

OpenAI за две недели марта выпустила три модели GPT-5.4. Разбираем, что изменилось в бенчмарках, ценах и возможностях.

OpenAI 5 марта 2026 года выпустила GPT-5.4 — флагманскую языковую модель с контекстным окном в миллион токенов, встроенным управлением компьютером и механизмом «мышления вслух». Через 12 дней компания добавила Mini и Nano — компактные варианты для разработчиков с ценой от $0.20 за миллион входных токенов.

Что нового в GPT-5.4 Thinking

GPT-5.4 объединила три нововведения, которые раньше существовали только по отдельности.

Контекст в миллион токенов. API-версия модели обрабатывает до 1 000 000 токенов — примерно 750 000 слов или полноценная техническая документация крупного проекта. Для сравнения: GPT-5.2 поддерживала 200 000 токенов.

Мышление вслух. В ChatGPT модель показывает план решения задачи до генерации ответа. Пользователь видит структуру рассуждения и может скорректировать направление, не дожидаясь финального результата. OpenAI называет это «upfront plan» — впервые модель даёт вмешаться в процесс мышления на лету.

Управление компьютером. GPT-5.4 — первая модель общего назначения от OpenAI со встроенными возможностями computer use. Модель установила рекорды на бенчмарках OSWorld-Verified и WebArena Verified.

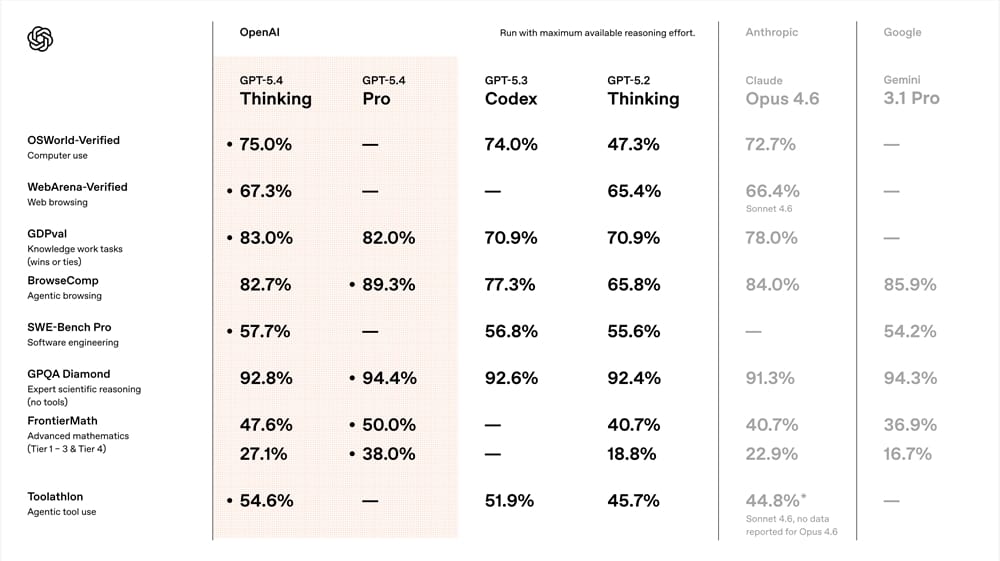

Бенчмарки: цифры вместо обещаний

OpenAI опубликовала результаты по нескольким категориям. Главные показатели:

| Бенчмарк | GPT-5.2 | GPT-5.4 | Прирост |

|---|---|---|---|

| BigLaw Bench (юридические задачи) | — | 91% | — |

| Финансовое моделирование | 68,4% | 87,3% | +27,6% |

| SWE-Bench Pro (код) | — | 57,7% | — |

| ARC-AGI (абстрактное мышление) | 86,2% | 93,7% | +8,7% |

| Фактические ошибки в утверждениях | базовый | −33% | — |

Модель на 33% реже допускает фактические ошибки в отдельных утверждениях по сравнению с GPT-5.2. Общая доля ответов с ошибками снизилась на 18%.

В тесте на создание презентаций оценщики предпочли результаты GPT-5.4 в 68% случаев — из-за лучшей визуальной подачи и разнообразия макетов.

Mini и Nano: линейка для разработчиков

17 марта, через 12 дней после флагмана, OpenAI выпустила GPT-5.4 Mini и Nano — компактные модели для задач, где полная мощность GPT-5.4 избыточна.

| Модель | Вход ($/1M токенов) | Выход ($/1M токенов) | Доступность |

|---|---|---|---|

| GPT-5.4 | $2.50 | — | API, ChatGPT, Codex |

| GPT-5.4 Mini | $0.75 | $4.50 | API, ChatGPT, Codex |

| GPT-5.4 Nano | $0.20 | $1.25 | Только API |

Mini работает вдвое быстрее GPT-5 Mini при более высокой точности на бенчмарках кода и мультимодальных задач. Nano — самая дешёвая модель OpenAI: $52 хватает для обработки описаний 76 000 фотографий.

OpenAI рекомендует Nano для классификации, извлечения данных, ранжирования и субагентов в многоагентных системах. Nano доступен только через API — компания позиционирует модель как инфраструктурный инструмент, а не потребительский продукт.

Место GPT-5.4 в гонке моделей

GPT-5.4 — не первая модель с миллион-токенным контекстом. Anthropic запустила эту возможность в бета-режиме для Claude Opus 4.6 в феврале 2026 года. Google предлагает аналогичное окно в Gemini с конца 2025 года.

Но OpenAI впервые объединила миллион-токенный контекст, нативный computer use и интерактивное мышление в одной модели. GPT-5.4 — не лучшая по каждому отдельному параметру, но самая широкая по набору возможностей в одном API-вызове.

Для разработчиков это значит меньше интеграций: один endpoint вместо нескольких специализированных моделей.

«GPT-5.4 — первая модель общего назначения с нативными возможностями computer use.»

— OpenAI, анонс GPT-5.4, 5 марта 2026

Кому стоит обратить внимание

Подписчики ChatGPT Plus, Team и Pro получили GPT-5.4 Thinking 5 марта. Ключевое улучшение — коррекция рассуждений модели до завершения генерации. На практике это экономит время в анализе документов, написании кода и финансовом моделировании.

Разработчики получили три модели с разным соотношением цены и производительности. Nano по $0.20/1M токенов конкурирует с Gemini Flash-Lite от Google и открывает сценарии массовой обработки, где раньше использовались только open-source модели.

Компании могут загрузить в контекст GPT-5.4 целую базу знаний — миллион токенов покрывает техническую документацию проекта средней величины.

Ближайший вопрос — ответ Anthropic и Google. Claude Opus 4.6 — единственный конкурент с сопоставимым контекстом, но без встроенного computer use. Gemini имеет длинный контекст, но отстаёт в бенчмарках кода. Гонка за универсальность — в разгаре.

GPT-4o и GPT-4.5: архитектура и отличия

OpenAI в 2025 году расширила линейку GPT-4, представив несколько специализированных вариантов. GPT-4o («omni») стал флагманом с нативной мультимодальностью — единая архитектура обрабатывает текст, изображения и аудио без отдельных модальных компонентов. GPT-4.5 — промежуточная модель с улучшенным «emotional intelligence» и снижением галлюцинаций.

Сравнение моделей OpenAI 2025

| Модель | Контекст | Мультимодальность | Цена (вход/выход) | Скорость |

|---|---|---|---|---|

| GPT-4o | 128K токенов | Текст + изображения + аудио | $2.5/$10 за 1M | Быстрая |

| GPT-4o mini | 128K токенов | Текст + изображения | $0.15/$0.6 за 1M | Очень быстрая |

| GPT-4.5 | 128K токенов | Текст + изображения | $75/$150 за 1M | Средняя |

| o3 | 200K токенов | Текст + изображения | $10/$40 за 1M | Медленная |

| o3-mini | 200K токенов | Текст | $1.1/$4.4 за 1M | Быстрая |

Бенчмарки GPT-4o vs конкуренты

| Тест | GPT-4o | Claude 3.5 Sonnet | Gemini 1.5 Pro | Llama 4 Maverick |

|---|---|---|---|---|

| MMLU (знания) | 87.2% | 88.7% | 85.9% | 85.5% |

| HumanEval (код) | 90.2% | 93.7% | 86.8% | 77.1% |

| MATH (математика) | 76.6% | 78.3% | 67.7% | 61.2% |

| MMMU (мультимодальность) | 69.1% | 68.3% | 65.8% | 73.4% |

GPT-4o в продакшене: что важно знать

Structured Outputs — функция гарантированного JSON-вывода по заданной схеме. Критична для production-приложений, где нужен стабильный формат ответа без дополнительного парсинга.

Function Calling — наиболее зрелая реализация среди всех LLM-провайдеров. Параллельный вызов функций, strict mode для надёжного парсинга. OpenAI API де-факто стандарт — большинство open source фреймворков (LangChain, LlamaIndex) ориентированы на его совместимость.

Realtime API — streaming аудио без конвертации Speech-to-Text. Latency ~300мс от голоса до голосового ответа. Используется для голосовых ботов без задержки.

Как выбрать модель OpenAI для конкретной задачи

Продакшен-API, нужна скорость и низкая цена → GPT-4o mini ($0.15/1M входящих токенов)

Сложные задачи, нужно максимальное качество → GPT-4o или o3-mini

Математика, программирование, science → o3 или o3-mini

Голосовой ассистент в реальном времени → GPT-4o Realtime API

Эмоциональный AI, клиентский сервис → GPT-4.5 (если бюджет позволяет)

Сравнение моделей OpenAI: GPT-4.5, o3, o3-mini

| Модель | Тип | MMLU | AIME 2024 | Цена (in/out) | Контекст |

|---|---|---|---|---|---|

| GPT-4.5 | Стандартная LLM | 88.7% | 36.7% | $2.5/$10 per 1M | 128K |

| o3 (high) | Reasoning | 91.6% | 96.7% | $10/$40 per 1M | 200K |

| o3-mini (high) | Reasoning (эффективный) | 86.9% | 87.3% | $1.1/$4.4 per 1M | 200K |

| GPT-4o | Мультимодальная | 87.2% | 9.3% | $2.5/$10 per 1M | 128K |

GPT-4.5: что реально изменилось

- EQ и sycophancy: по тестам OpenAI, GPT-4.5 на 40% реже соглашается с неправильными утверждениями пользователя, что важно для деловых применений

- Следование инструкциям: улучшено в сложных системных промптах с множеством правил — IFEval 87.5% (GPT-4o: 83.6%)

- Галлюцинации: SimpleQA точность 62.5% — лучший результат среди OpenAI-моделей (GPT-4o: 38.2%)

- Не reasoning-модель: GPT-4.5 не умеет в extended thinking — для математики и кода лучше o3

o3 vs o3-mini: когда что использовать

- o3 (high): максимальное качество reasoning — PhD-уровень физики, олимпийская математика, сложный многошаговый код. Дорого: $40 за 1M выходных токенов

- o3-mini (high): 90% качества o3 при цене в 9× ниже. Стандартный выбор для production reasoning-задач в 2026

- o3-mini (low/medium): для задач, где нужна скорость — latency в 2–3× меньше при небольшой потере качества

Ценообразование: практический расчёт

При обработке 1000 пользовательских запросов (в среднем 500 входящих + 500 выходящих токенов на запрос):

- GPT-4.5: $0.25 + $0.50 = $0.75 на 1000 запросов

- o3-mini (medium): ~$0.55 + $2.20 = $2.75 на 1000 запросов (reasoning токены не включены в выходные)

- o3 (high): $5.00 + $20.00 = $25.00 на 1000 запросов

- GPT-4o-mini: $0.075 + $0.15 = $0.225 на 1000 запросов — самый дешёвый вариант

GPT-5: что известно

OpenAI не анонсировала официальную дату выхода GPT-5 на момент марта 2026. По утечкам и публичным заявлениям Sam Altman:

- GPT-5 объединит возможности стандартных моделей и reasoning в одной архитектуре

- Нативная мультимодальность: текст, изображения, аудио, видео

- Agent-first design: оптимизация для длинных многошаговых задач

- Ориентировочный выход: H2 2026 (информация не подтверждена официально)

Читайте также: