OpenAI сворачивает self-serve fine-tuning: что меняется

OpenAI перекрывает self-serve путь к новым fine-tuning jobs и даёт действующим клиентам окно до 6 января 2027 года. Разбираем таймлайн и последствия.

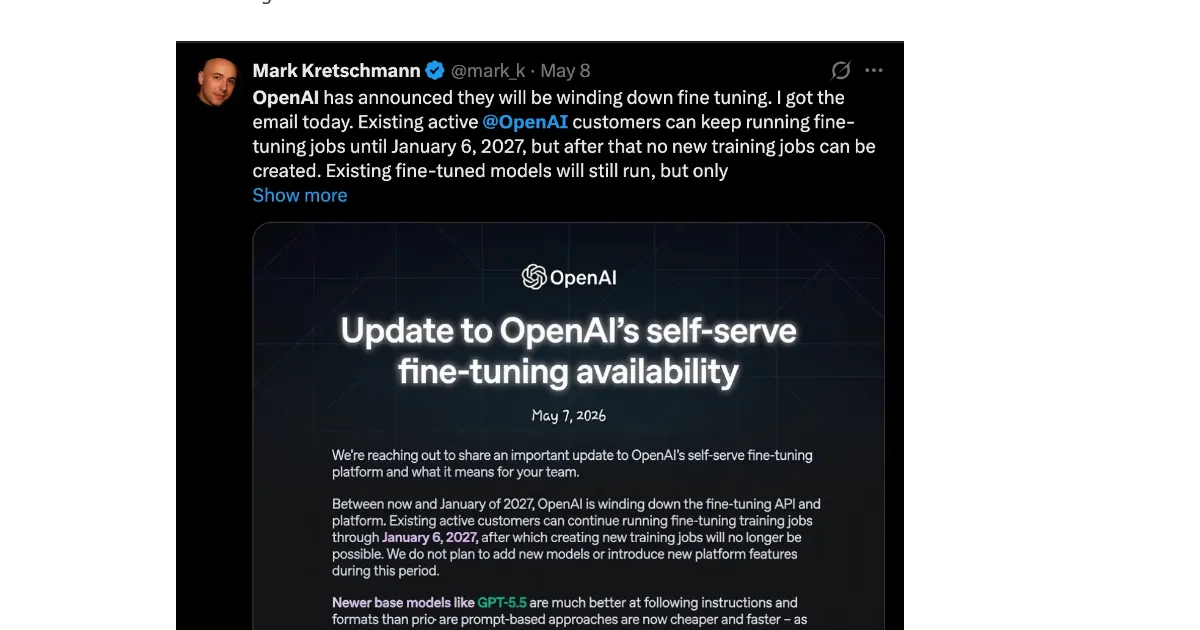

По состоянию на 13 мая 2026 года OpenAI действительно сворачивает self-serve fine-tuning. Компания сужает доступ к новым training jobs, а действующим клиентам даёт переходное окно до 6 января 2027 года. Уже обученные модели пока остаются в строю: inference на fine-tuned models сохранится до депрекации базовой модели.

Для разработчиков это новость не только про дедлайны. Она показывает смену приоритетов внутри самой OpenAI. В анонсе 2024 года компания описывала кастомизацию как набор разных путей: RAG, fine-tuning и custom-trained models. В апдейте 2026 года режут именно self-serve слой. Теперь важнее понять, в каких сценариях OpenAI подталкивает команды к RAG, промптам и более дорогому enterprise/custom контуру.

Какой таймлайн дала OpenAI

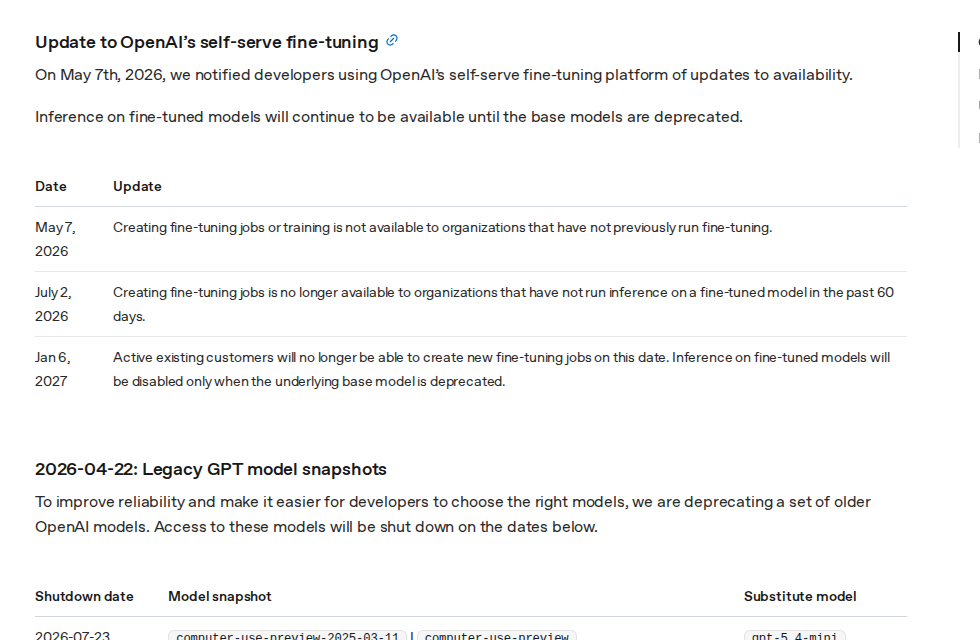

Технически ключевой документ здесь не общий блог-пост, а раздел Deprecations в официальной документации OpenAI. Именно там компания зафиксировала три даты, которые и определяют, кто ещё может создавать новые fine-tuning jobs, а кто уже нет.

| Дата | Что меняется | Кого затрагивает |

|---|---|---|

| 7 мая 2026 | Создание fine-tuning jobs или training недоступно | Организации, которые раньше не запускали fine-tuning |

| 2 июля 2026 | Новые jobs закрываются и для тех, кто не запускал inference на fine-tuned model за последние 60 дней | Организации без недавнего активного использования fine-tuned models |

| 6 января 2027 | Даже активные существующие клиенты больше не смогут создавать новые fine-tuning jobs | Все оставшиеся пользователи self-serve платформы |

График жёсткий. Первая отсечка уже наступила. Вторая нужна, чтобы отсечь организации, которые technically когда-то прикасались к fine-tuning, но не держат живой production-контур вокруг fine-tuned models. Третья дата закрывает переходный период для тех, кто до сих пор реально использует self-serve fine-tuning в работе.

Документация отдельно пишет, что inference на уже дообученных моделях продолжит работать до тех пор, пока не будет депрекейтнута базовая модель. Сначала исчезает возможность создавать новые training jobs, а доступ к уже развёрнутому inference живёт дольше.

Что именно не отключают сейчас

Самая дорогая ошибка в пересказе этой новости — написать, что OpenAI «закрывает fine-tuning полностью». Официальные формулировки говорят другое. Компания сворачивает self-serve платформу для новых jobs и не снимает уже обученные модели из API в тот же день. Для команд с работающим продом это принципиальная разница.

Если у вас уже есть fine-tuned model, срочная проблема сейчас не в завтрашнем падении inference. Проблема в том, что окно для будущих retraining-циклов быстро сужается. У одних оно уже закрылось. У других закроется 2 июля 2026 года. У оставшихся — 6 января 2027-го. Это уже обычный migration planning, а не задача «разберёмся потом».

При этом сам fine-tuning как техника никуда не исчезает из разговора об LLM. Мы уже отдельно разбирали, когда дообучение вообще оправдано и как выбрать метод. Новость OpenAI не отменяет эти сценарии. Она меняет то, насколько легко и дёшево можно было входить в них через self-serve слой.

Почему это сильный рыночный сигнал

Самый интересный контекст здесь в том, что update появился внутри старой страницы OpenAI про развитие fine-tuning API и расширение Custom Models Program. В исходном тексте компания ставила в один ряд три стратегии: расширение знаний модели через RAG, настройку поведения через fine-tuning и создание custom-trained models с новым domain-specific knowledge. Теперь из этой тройки урезают именно self-serve вариант дообучения.

Это вывод Toolarium из двух официальных документов, а не прямая цитата OpenAI. Компания не отказывается от кастомизации. Она сохраняет более дорогие и более тесные форматы работы: assisted fine-tuning, PEFT-подходы на большей шкале и fully custom-trained models для организаций с большими объёмами proprietary data. Самый дешёвый и массовый вход в fine-tuning при этом становится заметно уже.

Отсюда и сдвиг в сторону prompt-first и retrieval-first логики. Если use case решается хорошими базовыми моделями и подключением данных через retrieval, OpenAI всё меньше заинтересована в том, чтобы этот клиент по умолчанию запускал новое дообучение. Для многих команд это будет означать простой пересмотр архитектуры: часть задач дешевле закрыть через RAG и нормальную работу с источниками данных, а не через новый training job.

В ту же сторону смотрит и enterprise-контур. Если компании всё-таки нужен глубокий кастомный слой, OpenAI явно подталкивает его не в массовый self-serve, а в режим тесной работы с собственными командами и кастомными программами. Это хорошо ложится на более широкий разворот OpenAI в корпоративную инфраструктуру, который мы уже разбирали в материале про отдельный deployment-контур OpenAI.

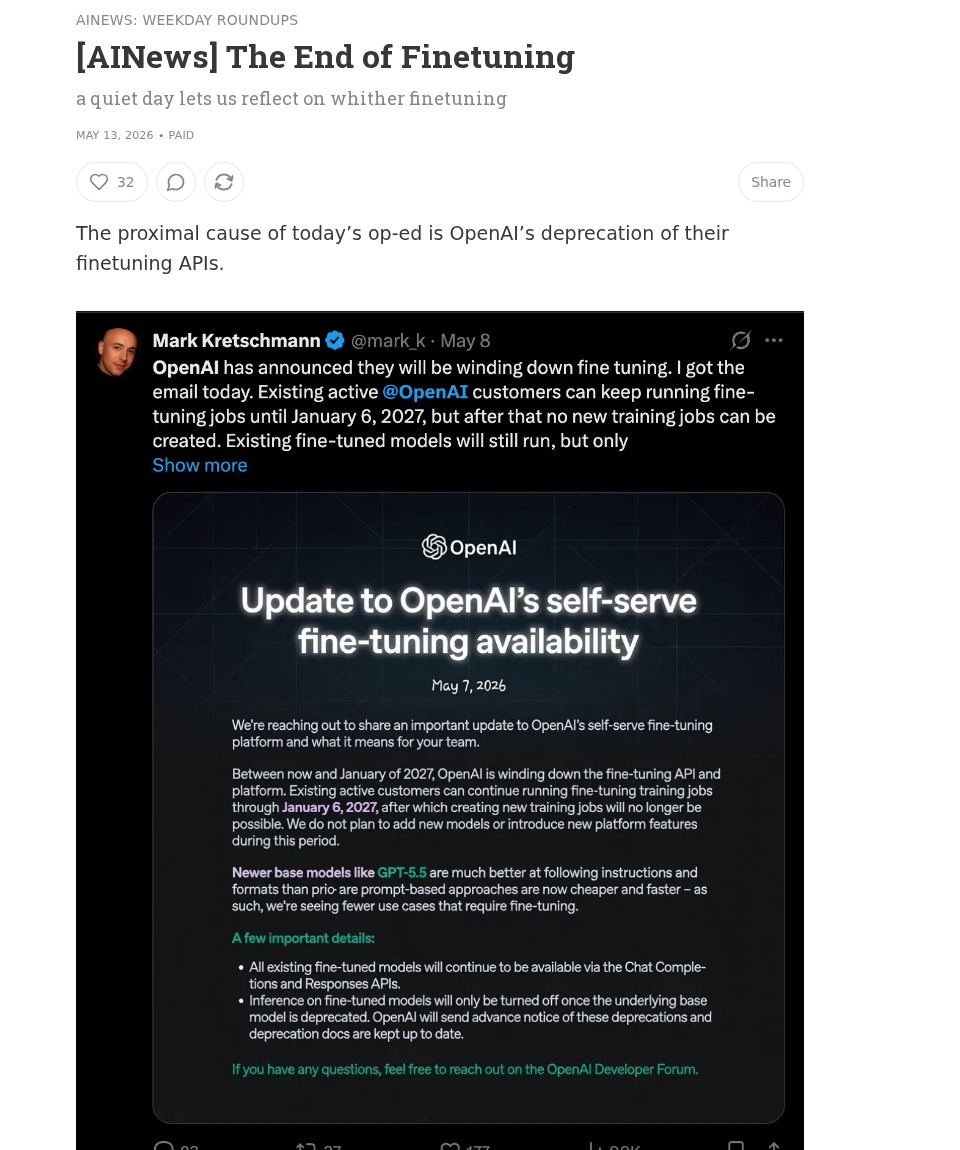

Почему рынок увидел здесь конец эпохи

Внешняя реакция на новость оказалась жёстче, чем официальный тон OpenAI. Статья Latent Space от 13 мая 2026 года сразу называет сюжет The End of Finetuning. Это спорная формулировка, если читать её буквально, но она хорошо передаёт настроение рынка: self-serve fine-tuning больше не выглядит стандартным default-путём для широкой массы команд.

В статье опубликован и скрин сообщения, где OpenAI связывает решение с более сильными новыми базовыми моделями и более дешёвыми prompt-based approaches. Эту часть нужно читать аккуратно. Для дедлайнов и технических ограничений главным источником всё равно остаётся официальная документация OpenAI. Но как объяснение того, почему компания вообще идёт на такой шаг, внешний сигнал полезен: часть прежних fine-tuning сценариев теперь действительно закрывается без нового training job.

Что теперь делать командам

Практически ситуация раскладывается на три типа команд.

- Если организация раньше не запускала fine-tuning, надо исходить из того, что self-serve окно уже закрыто. В этом случае первый маршрут — пересмотреть use case под RAG, prompt engineering или смену модели.

- Если fine-tuning когда-то был, но inference на fine-tuned models давно не запускался, критическая дата — 2 июля 2026 года. После неё новое обучение тоже закроется.

- Если у вас есть живой production на fine-tuned models, главная дата — 6 января 2027 года. До неё нужно понять, какие retraining-процессы ещё надо успеть завершить и чем потом заменять self-serve training.

Для части команд это будет неприятный, но полезный тест на зрелость архитектуры. Если кастомизация держалась только на привычке «давайте ещё раз дообучим», новость OpenAI заставит пересобрать стек. Если же команда уже умеет различать знания, инструкции, retrieval и реальное domain adaptation, переход будет менее болезненным.

Что стоит вынести

OpenAI не закрывает fine-tuning как идею. Она закрывает эпоху, в которой self-serve fine-tuning выглядел почти универсальным и сравнительно дешёвым входом в кастомизацию моделей. Дальше дообучение становится более выборочным инструментом: либо для тех, кто ещё успевает пройти переходное окно, либо для компаний, готовых идти в assisted/custom формат.

Для всех остальных дефолт смещается в сторону более сильных базовых моделей, промптов и retrieval-слоя. И это уже не частная техподдержка API. Это маленькая, но очень показательная перестройка всей продуктовой логики вокруг LLM-кастомизации.

Читайте также

- Fine-tuning LLM: когда дообучение оправдано и как выбрать метод

- RAG: что это и когда он действительно нужен

- OpenAI Deployment Company: зачем OpenAI строит отдельный контур внедрения

Источники и дата проверки

- OpenAI: Introducing improvements to the fine-tuning API and expanding our custom models program, исходная страница 2024 года с update от 8 мая 2026 года, проверено 13 мая 2026 года.

- OpenAI Developers: Deprecations — Update to OpenAI’s self-serve fine-tuning, проверено 13 мая 2026 года.

- Latent Space: [AINews] The End of Finetuning, опубликовано 13 мая 2026 года, использовано для внешней рыночной реакции и скрина письма OpenAI.