OpenAI Workspace Agents в ChatGPT: агенты для команд

OpenAI запустила Workspace Agents в ChatGPT для командных процессов. Разбираем Codex-runtime, Slack, approvals, pricing через credits и спор вокруг control plane.

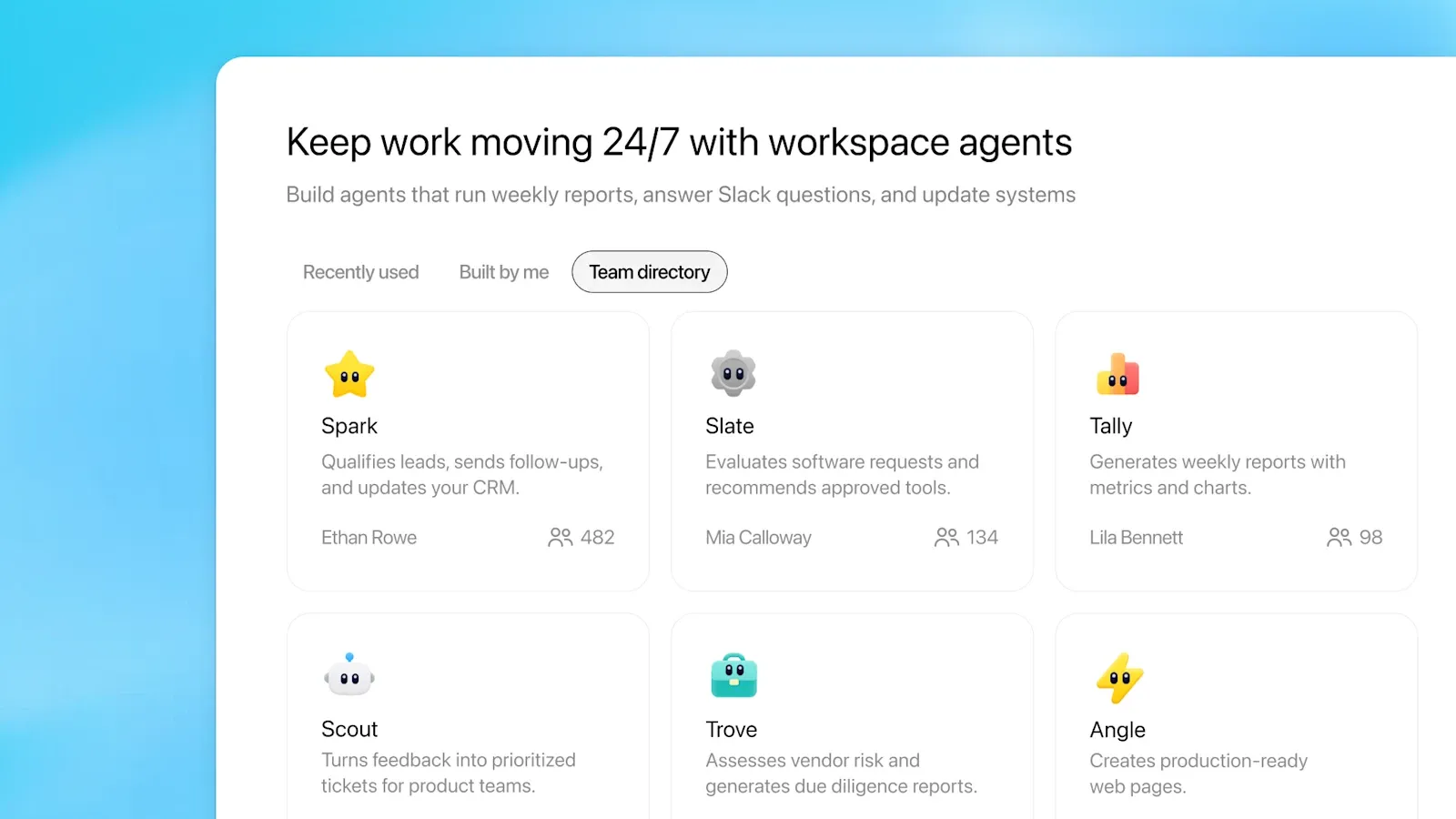

OpenAI 22 апреля 2026 года запустила Workspace Agents в ChatGPT. Компания добавляет в ChatGPT общий рабочий слой для команд: агент можно собрать один раз, подключить к корпоративным инструментам, дать ему расписание и использовать вместе в ChatGPT или Slack.

Главный сдвиг в том, что OpenAI переносит AI-агентов из личного окна переписки в командный workspace. Компания уже давно разворачивается к enterprise AI: мы разбирали это в материале о том, почему OpenAI делает ставку на корпоративный рынок. Workspace Agents показывают, как эта ставка выглядит в продукте: общие агенты, права доступа, память, расписания, approvals и интеграции с рабочими системами.

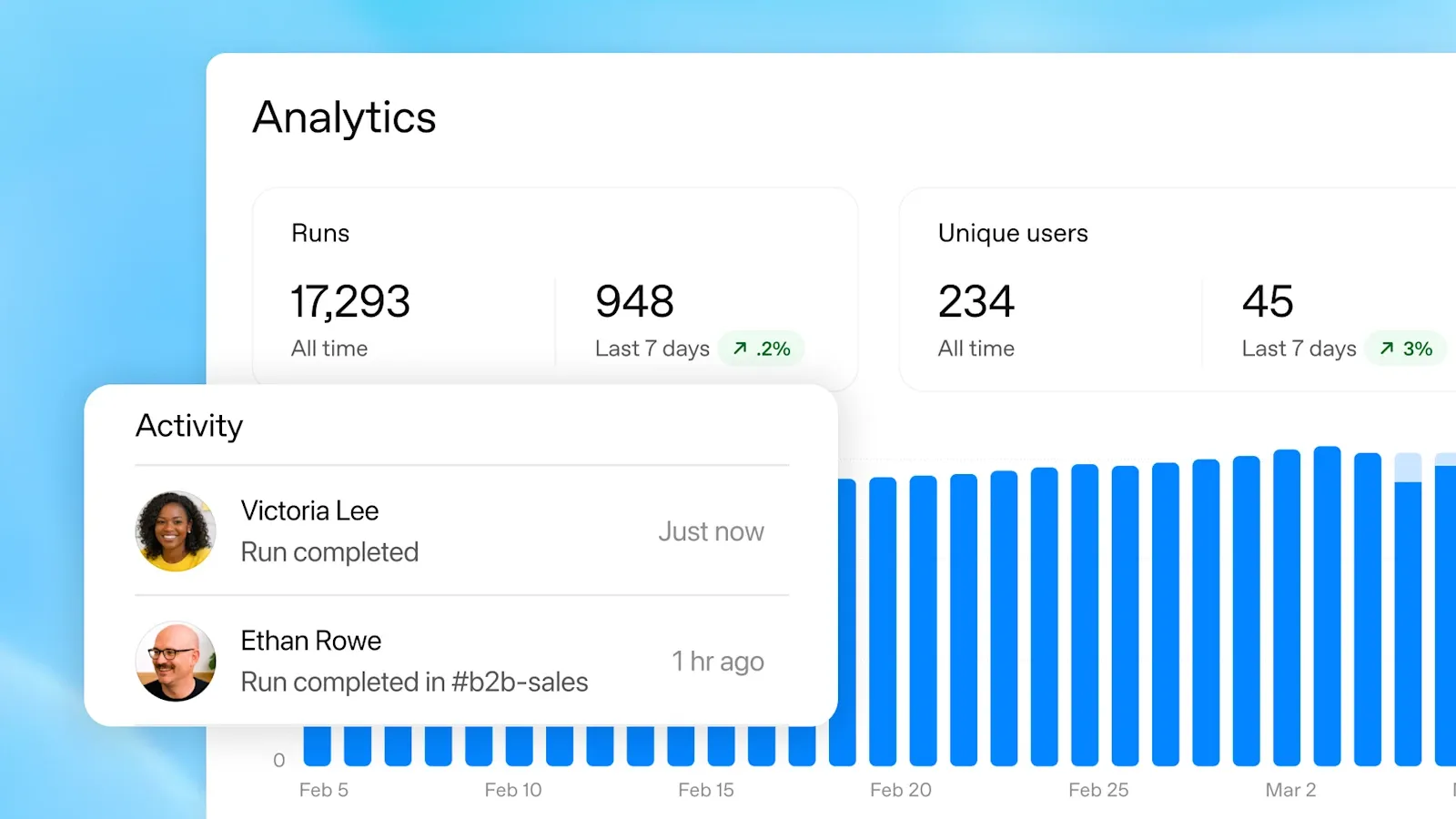

По состоянию на 23 апреля 2026 года функция доступна в research preview для ChatGPT Business, Enterprise, Edu и Teachers. OpenAI пишет, что Workspace Agents будут бесплатными до 6 мая 2026 года, а затем перейдут на оплату через credits.

Что именно запустила OpenAI

OpenAI называет Workspace Agents развитием GPTs. GPTs пока остаются: в анонсе компания отдельно пишет, что они будут доступны, пока команды тестируют новые агенты, а позднее появится способ конвертировать GPTs в Workspace Agents.

| Параметр | Что известно на 23 апреля 2026 года |

|---|---|

| Доступ | Research preview для ChatGPT Business, Enterprise, Edu и Teachers. |

| Где работают агенты | В ChatGPT и Slack; OpenAI обещает больше поверхностей позже. |

| Runtime | Агенты работают в облаке на базе Codex и получают workspace для файлов, кода, инструментов и памяти. |

| Контроль | Админы задают права, доступные инструменты, действия, approval-gates и мониторинг. |

| Цена | Бесплатно до 6 мая 2026 года; после этого начнётся credit-based pricing. |

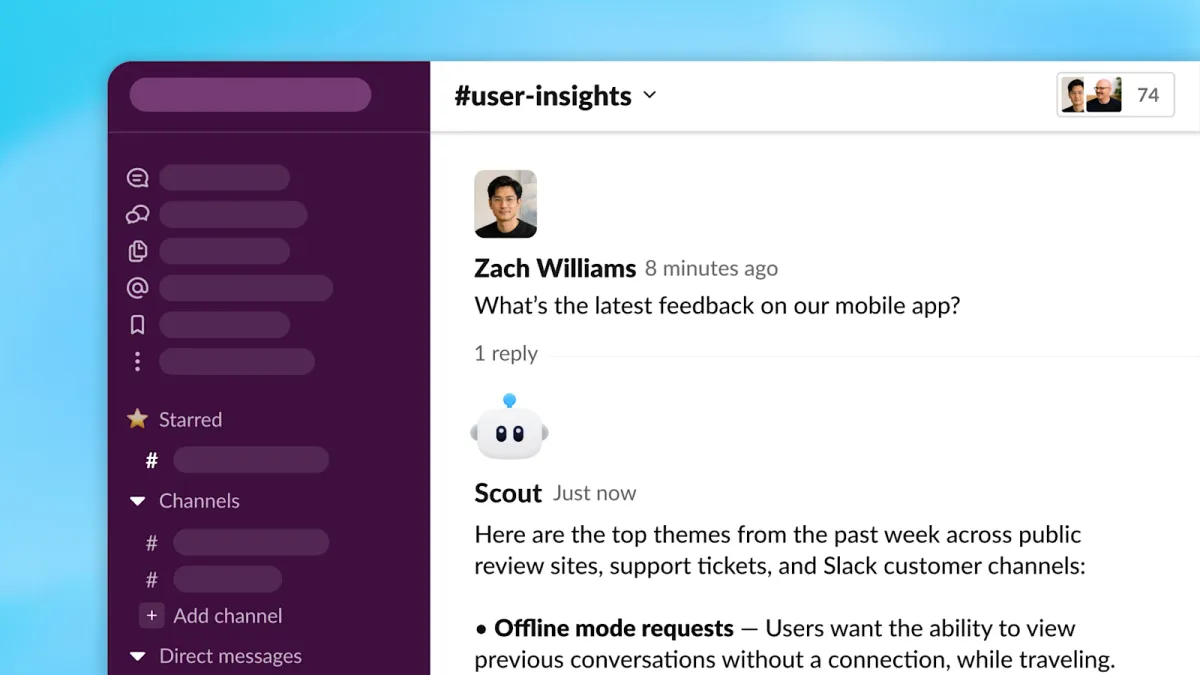

В OpenAI Academy агент описан как связка из триггера, процесса и инструментов. Лучше всего такой формат подходит для повторяемой работы: еженедельного отчёта, обработки заявок, разбора обратной связи, подготовки брифинга или обновления CRM.

Почему Codex в центре этой истории

Главная техническая деталь в анонсе: Workspace Agents powered by Codex. Агент отвечает не только текстом. Он может писать и запускать код, работать с подключёнными приложениями, помнить исправления между запусками и продолжать многошаговую задачу в облаке.

Из-за этого Workspace Agents ближе к рабочему исполнителю, чем к справочному боту. Пример OpenAI с weekly metrics reporter хорошо показывает разницу: агент должен в назначенный день забрать данные, построить графики, написать выводы и отправить отчёт. Без runtime с файлами, кодом и расписанием такой сценарий быстро превращается в цепочку ручных копирований.

Здесь рядом лежит тема инфраструктуры. В статье про Cloudflare Agent Cloud OpenAI мы уже разбирали, почему агентам нужен боевой контур: песочницы, права, логи, сеть, хранение и понятная среда выполнения. Workspace Agents решают ту же задачу на уровне рабочего продукта: внутри ChatGPT появляется управляемый слой для команд, которым не нужно самим собирать агентный runtime.

Рынок спорит, где должен жить контроль

Запуск OpenAI совпал с другой новостью: Google и AWS почти одновременно усилили свои агентные платформы. Google представила Gemini Enterprise Agent Platform как место, где технические команды строят, масштабируют, управляют и улучшают агентов. AWS добавила в Bedrock AgentCore managed harness в preview: разработчик задаёт модель, системный промпт и инструменты, а harness берёт на себя рассуждение, выбор инструмента, действие и потоковую отдачу ответа.

Разница подходов важнее названий продуктов. OpenAI делает ставку на рабочий слой внутри ChatGPT и Codex-runtime. Google упаковывает агентов в платформу управления вокруг Gemini Enterprise. AWS идёт от execution layer: быстрее поднять прототип, дать отдельную microVM-сессию с файловой системой и shell-доступом, а затем вынести оркестрацию в Strands-based code, если нужен полный контроль.

VentureBeat формулирует этот раскол как спор между control plane и execution layer. Для бизнеса вывод простой: «купить агента» недостаточно. Нужно понимать, где будут жить права, память, логи, расписания, approval-каналы и состояние долгих задач.

Больше агентов не всегда значит лучше

На фоне гонки платформ легко решить, что будущее обязательно будет мультиагентным: один агент планирует, второй пишет код, третий проверяет, четвёртый спорит с первыми тремя. Но исследование Dat Tran и Douwe Kiela, опубликованное на arXiv 2 апреля 2026 года и обновлённое 11 апреля, охлаждает этот тезис.

Авторы работы Single-Agent LLMs Outperform Multi-Agent Systems on Multi-Hop Reasoning Under Equal Thinking Token Budgets сравнивали single-agent и multi-agent системы при равном бюджете reasoning-токенов. Их вывод: на multi-hop reasoning задачах одиночный агент часто не хуже и иногда лучше, если бюджет вычислений нормализован. В части экспериментов преимущество multi-agent систем связано с большим объёмом вычислений при выполнении или с другим контекстом; сама архитектура не объясняет весь выигрыш.

Для Workspace Agents это хороший стоп-сигнал. Команде не обязательно строить «рой» агентов на каждый процесс. Часто один хорошо ограниченный агент с ясным триггером, инструментами, памятью и approval-gates будет дешевле и надёжнее, чем несколько агентов, которые координируют друг друга и сжигают credits.

Что смотреть компаниям

Workspace Agents стоит оценивать по тому, выдержит ли агент реальный процесс после красивого демо в Slack. Перед пилотом полезно ответить на пять вопросов:

- какой повторяемый процесс агент забирает у людей и как выглядит успешный результат;

- какие системы он читает, куда может писать и какие действия требуют approval;

- кто в команде владеет инструкцией, тестами и качеством ответа;

- как админ увидит историю запусков, изменения конфигурации и ошибки;

- сколько будет стоить регулярный запуск после 6 мая 2026 года, когда начнётся pricing через credits.

Хороший первый сценарий для Workspace Agents не должен быть самым рискованным. Лучше начать с отчётов, triage, брифингов или черновиков писем, где агент готовит работу, а человек принимает решение. Запуск агента, который сам меняет CRM, отправляет письма клиентам или правит финансовые таблицы, требует более жёстких прав, логов и approval-каналов.

Итог

OpenAI Workspace Agents в ChatGPT показывают, куда движутся корпоративные AI-агенты: от личных ассистентов к общим рабочим процессам с памятью, расписаниями, инструментами и контролем. Это сильный ход для OpenAI, потому что ChatGPT уже стоит перед сотрудником, а Codex даёт агентам среду выполнения.

Но рынок ещё не выбрал одну архитектуру. OpenAI тянет контроль внутрь ChatGPT workspace и Codex-runtime. Google говорит языком платформы управления. AWS продаёт скорость запуска через execution harness. А исследования по single-agent подходу напоминают: сложность должна окупаться, иначе компания оплачивает лишнюю координацию вместо полезной работы.