AI-курсор Gemini: зачем DeepMind переосмысливает мышь

DeepMind хочет, чтобы Gemini понимала экран там, где уже находится курсор. Разбираем, почему это важнее ещё одной кнопки ИИ.

По состоянию на 13 мая 2026 года Google DeepMind вынесла в отдельный сюжет то, что десятилетиями считалось фоном интерфейса: курсор. В блоге от 12 мая 2026 года команда показала AI-enabled pointer на базе Gemini и прямо объяснила, чего хочет добиться: пользователь должен меньше таскать контекст в отдельное окно чат-бота, а модель должна лучше понимать, что именно происходит на экране.

Это важная новость не про очередную кнопку Gemini и не про ещё один красивый ролик из лаборатории. По той же публикации DeepMind видно, что идея уже приземляется в продукты: с 12 мая 2026 года Google разрешила обращаться к Gemini in Chrome через указатель, а Magic Pointer для Googlebook обещана как часть ноутбуков, которые выйдут осенью 2026 года. Иными словами, разговор идёт не о чат-окне, а о попытке превратить сам указатель в новый интерфейс для ИИ.

При этом дорисовывать лишнее здесь опасно. Google пока не объявляла массовый запуск Magic Pointer для всех платформ, не раскрывала полный список поддерживаемых рынков и не объясняла в деталях, как именно будет работать сбор экранного контекста на уровне приватности и хранения данных. Поэтому главный вопрос сейчас звучит не так: «заменит ли Gemini мышь». Корректнее спросить иначе: почему DeepMind вообще полезла в курсор, и что это меняет в логике ИИ-интерфейсов.

Что именно показала DeepMind

Официальный материал DeepMind строится вокруг простой, но довольно жёсткой критики нынешних ИИ-инструментов. Сегодня модель часто живёт в отдельной панели или отдельной вкладке. Чтобы получить пользу, человек должен сам перенести туда нужный фрагмент текста, изображения или страницы, а потом ещё и точно описать, что от модели требуется. DeepMind хочет перевернуть это соотношение: не пользователь подстраивается под чат, а интерфейс подхватывает смысл там, где человек уже работает.

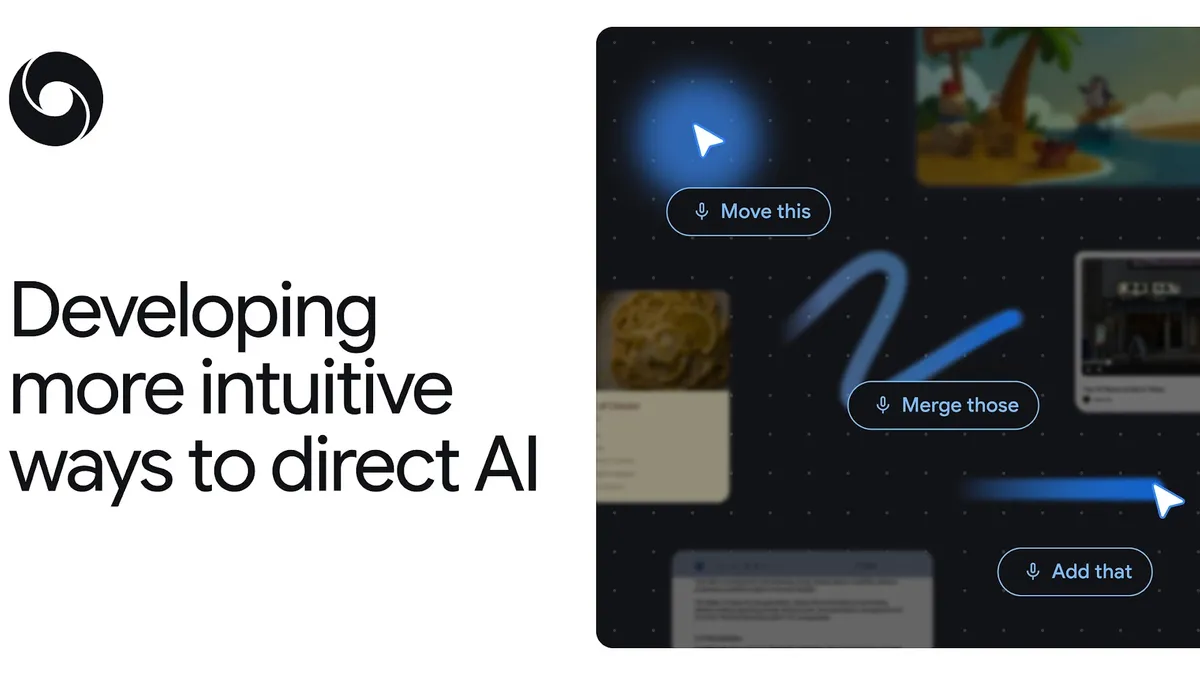

В блоге это разложено на четыре принципа. Первый — maintain the flow: ИИ не должен заставлять пользователя выходить из рабочего потока. Второй — show and tell: модель должна понимать не только слова, но и то, на какой объект указывает курсор. Третий — сила коротких команд вроде «исправь это» или «перемести сюда», которые работают только тогда, когда система видит общий контекст. Четвёртый — превращение пикселей в сущности: дата должна распознаваться как дата, место как место, а объект на фото как объект, с которым можно что-то сделать.

Это важно, потому что DeepMind говорит не о декоративной надстройке над курсором. Речь идёт о перераспределении самой стоимости взаимодействия. Сегодня дорогим местом в работе с ИИ остаётся передача контекста: надо выбрать нужный кусок, сформулировать запрос, пояснить, что к чему относится. В pointer-подходе часть этой нагрузки уходит с человека на систему. Если это сработает, промпт станет короче, а жесты и указание на экран снова станут такой же важной частью интерфейса, как в обычном человеческом разговоре.

Почему курсор важнее очередной кнопки Gemini

Самая сильная мысль в публикации DeepMind звучит почти как упрёк всей нынешней волне ИИ-продуктов: хорошая модель до сих пор слишком часто требует от человека длинного, педантичного, «машинно-дружелюбного» запроса. Для обычной работы это трение. Если вам нужно быстро сравнить два товара, построить диаграмму из таблицы или понять, что означает фрагмент кода, вы сначала занимаетесь не задачей, а упаковкой задачи в форму, удобную для модели.

DeepMind пытается сократить именно это трение. Указатель в такой схеме перестаёт быть просто координатой на экране. Он становится маркером намерения. Система видит, на что вы навели курсор, в каком документе или приложении это происходит, и какой тип действия здесь вообще уместен. Отсюда и вся логика коротких команд вроде «сравни это», «объедини эти изображения», «покажи маршрут» или «что это значит».

Здесь удобно вспомнить уже опубликованный у Toolarium материал про AI Mode в Chrome. Там Google тоже переносит модель ближе к рабочему контексту экрана, а не оставляет её в изолированном чате. История с курсором идёт ещё на шаг дальше: если AI Mode перестраивает браузерный поиск, то AI-enabled pointer претендует на то, чтобы перестроить саму базовую грамматику действий на экране.

Это и отличает историю от обычного «ещё одной Gemini-функции». Кнопку можно добавить и убрать. Боковую панель можно переставить местами. Но курсор — один из самых устойчивых примитивов всей настольной среды. Если Google научится делать его по-настоящему контекстным, она получит не новую кнопку, а новый вход в интерфейс. Для конкурентов это уже другой уровень игры.

Как концепт уже превращают в продукт

Сам по себе research-пост ещё не доказывал бы многого, если бы рядом не было продуктового подтверждения. Но оно есть. В том же блоге DeepMind написано, что с 12 мая 2026 года пользователи могут обращаться к Gemini in Chrome через указатель на ту часть страницы, которая их интересует. В примерах Google называет сравнение товаров и визуализацию нового дивана прямо в вашей комнате. Это уже не разговор про абстрактное будущее.

Дальше — Googlebook: AI-native ноутбуки Google под Gemini Intelligence. На официальном лендинге Googlebook `Magic Pointer` вынесен в число ключевых сценариев рядом с ИИ-виджетами и связкой ноутбука с Android-телефоном. Формулировка там короткая и показательная: пользователь может выбрать объект и сразу попросить Gemini спросить, сравнить или создать нужный результат. То есть идея из исследовательского поста уже стала маркетинговым обещанием конкретного продукта.

Есть и ещё один слой, который делает историю серьёзнее. В developer-блоге Google от 12 мая 2026 года Android описывается уже не просто как operating system, а как intelligence system. Там же компания продвигает AppFunctions, через которые приложения отдают системе и агентам свои действия, данные и сервисы. Если нужен внутренний контекст по этой линии, он уже разобран у Toolarium в материале Google A2UI: интерфейсы для AI-агентов. В связке с курсором это выглядит не как одиночная фича, а как попытка собрать новый агентный интерфейсный стек: курсор понимает, куда вы смотрите; система знает, какие действия допустимы; агент умеет вызвать их без лишней ручной навигации.

Именно поэтому историю нельзя сводить к общему обзору Android Show. Если открыть текст с Googlebook, мы снова скатимся в соседний сюжет про ноутбуки и новые устройства Google. Здесь важнее другое: DeepMind сначала изменила саму точку взаимодействия, а уже потом Google начала встраивать это решение в Chrome и Googlebook.

Какие риски появляются вместе с новым курсором

Здесь начинается территория, где фактов у Google пока меньше, чем красивых обещаний. И это нормально для раннего продуктового этапа. Но для редакционного анализа это значит, что вопрос надо ставить жёстче. Если курсор становится носителем контекста, пользователю нужно понимать хотя бы три вещи: что именно система видит вокруг указателя, что из этого уходит в модель и где проходит граница между подсказкой и действием.

Это вывод Toolarium по открытым материалам, а не прямая цитата Google. Официальные страницы подробно объясняют удобство, но почти не раскрывают механику данных. Между тем именно она будет решать судьбу таких интерфейсов. Одно дело — распознать выделенный фрагмент текста на странице. Другое — устойчиво понимать сразу несколько объектов, историю действия, рабочий документ, карту, форму и потенциально чувствительную информацию на экране.

Есть и чисто UX-риски. Указатель всегда был очень быстрым инструментом. Если на нём начинают висеть контекстные предложения, всплывающие действия и интерпретация намерения, интерфейс легко перейти в режим «слишком услужливого помощника», который шумит чаще, чем помогает. TechCrunch в пересказе брифинга пишет, что в Googlebooks контекстные действия будут всплывать после движения курсора. На бумаге это выглядит аккуратно. В реальной работе всё решат частота ложных срабатываний, ясность подсказок и возможность быстро отказаться от предложения системы.

Наконец, есть вопрос доверия. Чем короче становится путь от указания на объект к действию модели, тем меньше времени у пользователя на проверку промежуточных шагов. В блоге DeepMind есть много примеров в духе «сделай сводку», «построй диаграмму», «покажи маршрут». Но уже на следующем шаге рынку захочется большего: переносить данные между приложениями, менять элементы интерфейса, заполнять формы. И вот там граница между полезной экономией времени и слишком смелой автоматизацией станет болезненно важной.

Что всё это значит для рынка

История с AI-курсором важна не только для Google. Она показывает, куда вообще может сместиться гонка интерфейсов вокруг генеративного ИИ. Последние два года рынок в основном спорил о моделях, окнах чата и боковых панелях. DeepMind предлагает другой ход: если модель действительно понимает экранный контекст, то следующим полем конкуренции станет не форма чата, а способность встроиться в базовые жесты работы за компьютером.

Для Microsoft, Apple и других платформ это неприятный сигнал. Победит не тот, кто просто прикрутит ещё одного ассистента к рабочему столу, а тот, кто найдёт самый естественный путь между человеческим намерением и действием системы. Указатель здесь логичен: он уже есть во всех рабочих сценариях, он дёшев по усилию, и пользователь интуитивно понимает, как им показать системе, что важно именно сейчас.

Но отсюда не следует, что мышь «устарела» и завтра её заменит Gemini. Пока что у Google есть исследовательский пост, ранняя интеграция в Chrome, обещание Magic Pointer для Googlebook и общий платформенный разворот Android к intelligence system. Это много для одного майского анонса, но всё ещё мало для окончательного вывода о том, как такой интерфейс переживёт реальную рабочую нагрузку.

Вывод

AI-курсор Gemini: зачем DeepMind переосмысливает мышь — это сильный сюжет не потому, что Google придумала ещё один способ обратиться к модели. Сильный он потому, что Google и DeepMind пытаются пересобрать самую базовую единицу настольного интерфейса. Их ставка проста: человек должен меньше писать, меньше переключаться между окнами и чаще показывать системе смысл жестом, а не длинным промптом.

Получится ли из этого новый стандарт, пока неясно. Но важный вывод уже есть. Следующий раунд борьбы вокруг ИИ-интерфейсов, похоже, пройдёт не только в чате и не только в поисковой строке. Он пройдёт прямо на экране, вокруг курсора и контекста, который раньше считался слишком «человеческим» и слишком неструктурированным для машины. DeepMind считает, что это ограничение пора снимать. По состоянию на май 2026 года рынок впервые увидел, как именно Google собирается это сделать.

Читайте также

- Googlebook: AI-native ноутбуки Google под Gemini Intelligence

- Google A2UI: интерфейсы для AI-агентов

- AI Mode в Chrome: Google превращает браузер в ИИ-поиск

Источники и дата проверки

Факты, даты, формулировки развёртывания и названия функций в этом материале проверены 13 мая 2026 года.

- Google DeepMind: Reimagining the mouse pointer for the AI era

- Googlebook: Designed for Gemini Intelligence

- Android: Gemini Intelligence

- Android Developers Blog: Building for the Intelligence System on Android

- TechCrunch: Google unveils Googlebook, a new line of AI-native laptops

- 9to5Google: Googlebook has a premium focus, coming to some Chromebooks