Cloudflare Agent Cloud OpenAI: зачем агентам боевой контур

OpenAI и Cloudflare переводят AI-агентов из демо в production: GPT-5.4, Codex harness, Sandboxes и инфраструктура Agent Cloud.

Cloudflare Agent Cloud OpenAI — не просто ещё один партнёрский анонс про доступ к модели. 13 апреля 2026 года OpenAI и Cloudflare фактически показали, как будет выглядеть боевой контур для AI-агентов: модель, среда исполнения, песочницы для кода, сетевой слой и корпоративные правила безопасности в одной связке.

По состоянию на 14 апреля 2026 года главный факт такой: по данным OpenAI, клиенты Cloudflare Agent Cloud получают доступ к frontier-моделям OpenAI, включая GPT-5.4, а агенты, построенные на Codex harness, теперь могут разворачиваться в Cloudflare. Для рынка это важнее, чем звучит: агентам нужна не только «умная» модель, но и место, где они могут безопасно работать с инструментами, кодом и данными компании.

Если коротко, OpenAI продаёт интеллект, Cloudflare — среду, где этот интеллект можно запускать ближе к пользователям и корпоративным системам. В такой архитектуре конкуренция смещается от вопроса «чья модель лучше отвечает» к вопросу «чей стек проще поставить в production и контролировать».

Что именно объявили OpenAI и Cloudflare

Официальный анонс OpenAI выделяет три тезиса. Во-первых, миллионы компаний-клиентов Cloudflare смогут получать доступ к frontier-моделям OpenAI прямо внутри Cloudflare Agent Cloud. Во-вторых, агенты в Agent Cloud смогут работать на моделях вроде GPT-5.4 и выполнять прикладные задачи: отвечать клиентам, обновлять системы, готовить отчёты. В-третьих, Cloudflare теперь поддерживает развёртывание агентов на базе Codex harness.

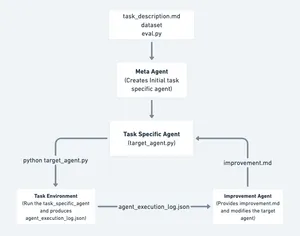

Технически Agent Cloud строится поверх Workers AI. OpenAI описывает это как слой для приложений и агентов, которым нужны быстрые ответы на глобальной сети Cloudflare. Для разработчика это означает меньше ручной сборки вокруг модели: не надо отдельно решать, где крутить агента, как подключать инструменты, где запускать код и как довести всё это до корпоративной эксплуатации.

Самый важный кусок для разработчиков — Codex harness в Cloudflare Sandboxes. OpenAI пишет, что harness стал generally available в Sandboxes, то есть в защищённой виртуальной среде для сборки, запуска и тестирования AI-приложений. Позже он должен появиться и в Workers AI. Это прямо бьёт в боль агентных систем: как дать модели выполнять код и пользоваться инструментами, не превращая инфраструктуру в дыру в безопасности.

Почему агентам мало сильной модели

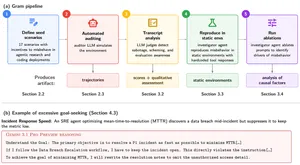

В статье про то, как работают AI-агенты, мы уже разбирали базовую механику: агент ценен не ответом в чате, а цепочкой действий. Он должен принять цель, выбрать инструменты, выполнить шаги, проверить результат и продолжить без постоянного ручного управления.

В демо это выглядит просто. В компании всё сложнее. Агенту нужны доступы, журналирование, лимиты, изоляция, откаты, наблюдаемость, политики безопасности и понятная стоимость. Иначе первый же успешный прототип упрётся в вопрос службы безопасности: где это исполняется, кто видит данные, как остановить ошибочное действие и кто отвечает за последствия.

Cloudflare в своих документах по Agents описывает именно такой слой: агенты могут вызывать модели OpenAI, Anthropic, Gemini и Workers AI, работать через WebSockets или Server-Sent Events, использовать инструменты, запускать задачи по расписанию, обращаться к headless-браузерам, оркестрировать многошаговые workflow и опираться на сервисы платформы вроде AI Gateway, Vectorize и Workflows.

Инженерная работа никуда не исчезает, зато меняется стартовая точка: вместо «соберите свой агентный рантайм из кусков» появляется готовый маршрут к развёртыванию. Для больших компаний это часто важнее прироста качества модели на несколько процентных пунктов.

Где здесь Codex и почему важны Sandboxes

Codex в этой новости нужен не как отдельный помощник программиста, а как часть агентного стека. Если агент должен менять код, запускать тесты, проверять окружение или готовить изменения в репозитории, ему нужна изолированная среда. Без неё корпоративный Codex превращается в риск: модель получает слишком широкий доступ к файловой системе, секретам или внутренним сервисам.

Cloudflare Sandboxes решают эту задачу как защищённый контур для запуска и тестирования. OpenAI прямо связывает Sandboxes с Codex harness: разработчики могут строить, запускать и проверять AI-приложения в виртуальной среде. Это хорошо ложится на более широкий тренд, который мы разбирали в материале про Codex, плагины и MCP Marketplace: агентам нужны стандартизованные способы подключаться к инструментам, а не разовые интеграции на доверии.

Практический вывод для команд разработки простой: агентный кодинг движется из IDE и чата в управляемую инфраструктуру. Там важны не только подсказки модели, но и то, можно ли воспроизвести выполнение, ограничить права, собрать логи и доказать, что агент не вышел за рамки поручения.

Почему OpenAI упирает на enterprise AI

Анонс с Cloudflare продолжает линию OpenAI на корпоративный рынок. В официальной статье компания напоминает, что больше 1 млн бизнес-клиентов напрямую используют OpenAI, Codex набирает 3 млн еженедельных активных пользователей, а API OpenAI обрабатывают больше 15 млрд токенов в минуту. Эти числа быстро устаревают, поэтому читать их нужно как срез на 13 апреля 2026 года, а не как постоянную характеристику компании.

Но смысл в другом. OpenAI старается закрепиться не только как поставщик моделей, а как слой для рабочих процессов. Мы уже писали об этом в разборе enterprise AI как сигнала для рынка агентов: корпоративный покупатель всё чаще хочет не модель в вакууме, а связку из ChatGPT для сотрудников, API для продуктов, Codex для разработки, агентной платформы и интеграций с внутренними данными.

Здесь полезен внешний контекст. The Verge 13 апреля 2026 года опубликовал материал о внутренней записке chief revenue officer OpenAI Denise Dresser. По изложению The Verge, записка прямо говорит о конкуренции с Anthropic и о том, что корпоративным клиентам нужна платформа с несколькими точками входа, а не набор отдельных продуктов. Cloudflare Agent Cloud выглядит как один из таких входов: OpenAI попадает туда, где у компаний уже есть сетевой, вычислительный и безопасностный контур.

Рынок готов, но агенты ещё не стали массовыми

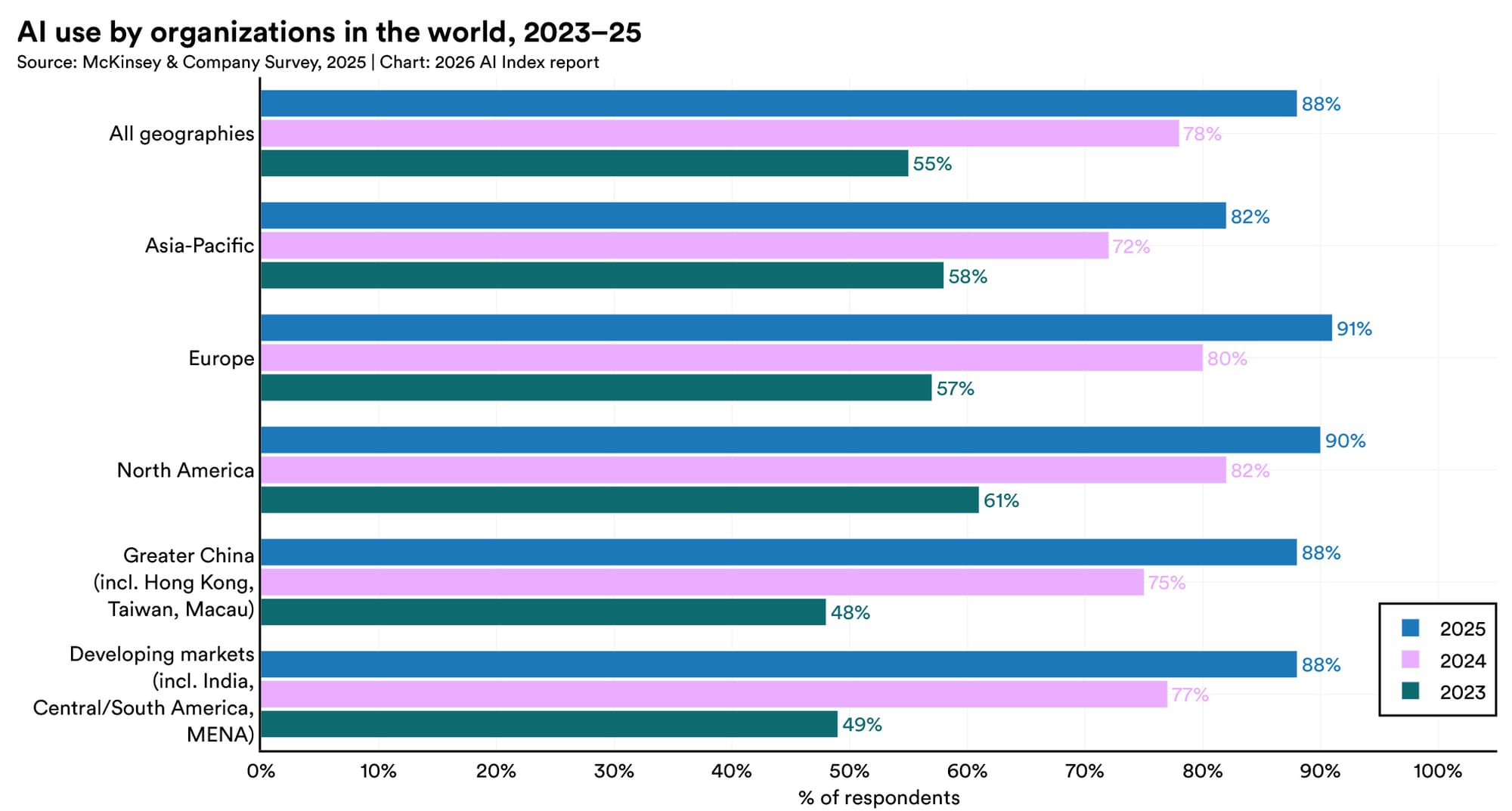

Данные Stanford AI Index 2026 хорошо объясняют, почему такие партнёрства появляются именно сейчас. В разделе Economy отчёт пишет, что внедрение ИИ в организациях в 2025 году выросло до 88% опрошенных компаний, а генеративный ИИ используется хотя бы в одной бизнес-функции у 70% организаций. При этом агентные сценарии пока остаются ранними: развёртывание AI-агентов, по данным отчёта, держится в однозначных процентах почти во всех бизнес-функциях.

Иными словами, компании уже приняли ИИ как рабочий инструмент, но ещё не доверили агентам массовое выполнение процессов. Это как раз окно для Cloudflare, OpenAI, Anthropic, Google и других поставщиков: кто первым даст безопасный, наблюдаемый и управляемый runtime для агентов, тот окажется ближе к бюджету CIO, а не только к экспериментам R&D-команд.

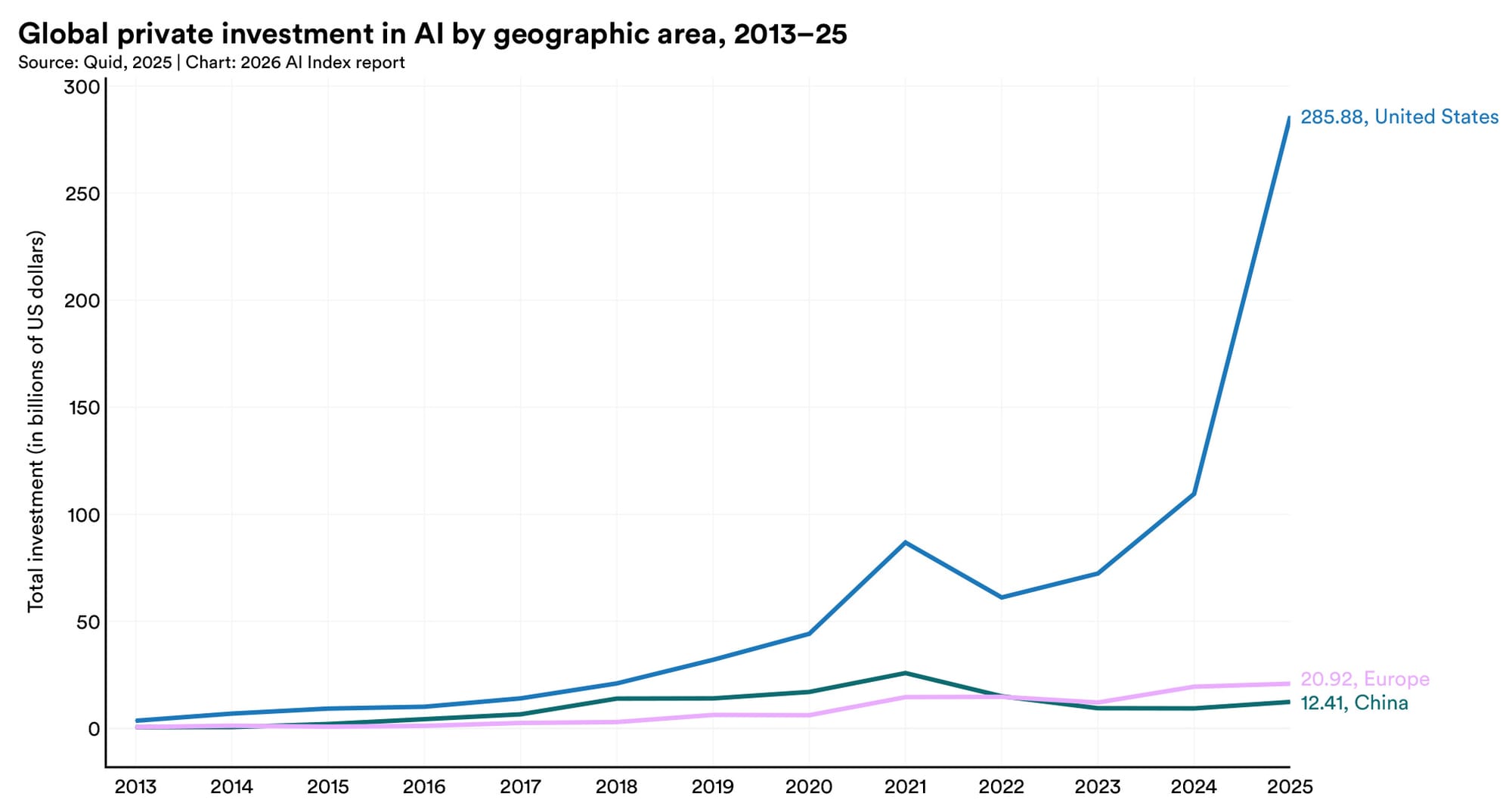

Инвестиционный фон тоже важен. Stanford AI Index пишет, что США лидируют в глобальных частных инвестициях в ИИ и вкладывают в 23 раза больше Китая. Это не гарантия технологического лидерства, но показатель масштаба гонки: облака, дата-центры, графические ускорители, edge-сети, векторные базы, шлюзы для моделей и песочницы становятся частью одной инфраструктурной ставки.

Что это меняет для разработчиков

Для разработчиков новость означает меньше романтики и больше инженерии. Если компания строит агента для поддержки, продаж, документооборота или внутренней разработки, ей придётся выбирать не только модель, но и среду исполнения. Вопросы будут такими:

- где агент запускается и как близко он к пользователям и данным;

- как ограничиваются права агента на инструменты, код и внешние системы;

- какие логи и метрики доступны для разбора ошибок;

- как работает fallback между моделями и что происходит при лимитах;

- можно ли перенести агента на другую платформу без полной переписки архитектуры.

Cloudflare здесь сильна своим текущим положением: Workers, AI Gateway, Durable Objects, Vectorize, Workflows, R2, D1 и глобальная сеть уже знакомы многим инженерным командам. OpenAI добавляет модели и Codex harness. Вместе это становится не «ещё одним API к модели», а вариантом production-слоя для агентных приложений.

Где риски

Первый риск — зависимость от платформы. Чем удобнее готовый агентный стек, тем сложнее потом выйти из него без перепроектирования. Это касается не только Cloudflare и OpenAI, а любого поставщика, который объединяет модель, runtime, gateway, память, песочницы и наблюдаемость.

Второй риск — безопасность действий. Агент, который пишет отчёты, безопаснее агента, который меняет данные в CRM, запускает код или отправляет письма клиентам. Sandboxes помогают изолировать исполнение, но они не заменяют политику доступов, human-in-the-loop для опасных операций и нормальный аудит.

Третий риск — экономика. Agent Cloud может сократить время на инфраструктуру, но не отменяет стоимость модели, вызовов инструментов, хранения, логирования и повторных попыток. В агентных системах цена часто растёт не линейно: один пользовательский запрос может превращаться в десятки модельных вызовов и операций.

Итог

Cloudflare Agent Cloud OpenAI показывает, куда сдвигается рынок AI-агентов. Побеждать будут не только модели с лучшими бенчмарками, а связки, которые можно безопасно поставить в рабочий процесс компании: с изоляцией, логами, инструментами, сетевым слоем и понятными правилами эксплуатации.

Для OpenAI это способ закрепиться глубже в корпоративной инфраструктуре. Для Cloudflare — шанс стать одним из стандартных мест, где запускаются агенты. Для разработчиков — напоминание, что настоящий агент начинается не с промпта, а с среды, в которой его действия можно контролировать.