DeepSeek V4 Pro и Flash: как открытые веса подошли к лидерам

DeepSeek V4 Pro и Flash вывели серию с открытыми весами в 1M context. Разбираем, где релиз приблизил DeepSeek к закрытым лидерам.

Проверено 26 апреля 2026 года. DeepSeek выпустила не одну новую модель, а сразу две версии V4: DeepSeek V4 Pro и DeepSeek V4 Flash. Важен здесь не сам факт релиза, а его смысл: линейка с открытыми весами впервые подошла к верхнему классу не только по цене, но и по тем сценариям, где обычно смотрят на длинный контекст, качество рассуждений и агентную работу с кодом.

В официальном релизе от 24 апреля 2026 года компания пишет о двух моделях с контекстом 1M, thinking и non-thinking режимами, доступом через OpenAI ChatCompletions и Anthropic API, а также о немедленной доступности в API. Это уже не история про «дешёвую открытую альтернативу на потом». DeepSeek подаёт V4 как рабочую серию для тех задач, где закрытые модели до сих пор считались почти безальтернативными.

Если нужен фон по экономике релиза или по прямому сопоставлению с OpenAI, у нас уже есть отдельные материалы про экономику DeepSeek V4 и про пару DeepSeek V4 и GPT-5.5. Здесь угол уже другой: зачем DeepSeek разделила релиз на Pro и Flash и почему именно эта связка стала сигналом, что модели с открытыми весами подошли к верхнему сегменту заметно ближе, чем ещё несколько месяцев назад.

Что именно вышло 24 апреля

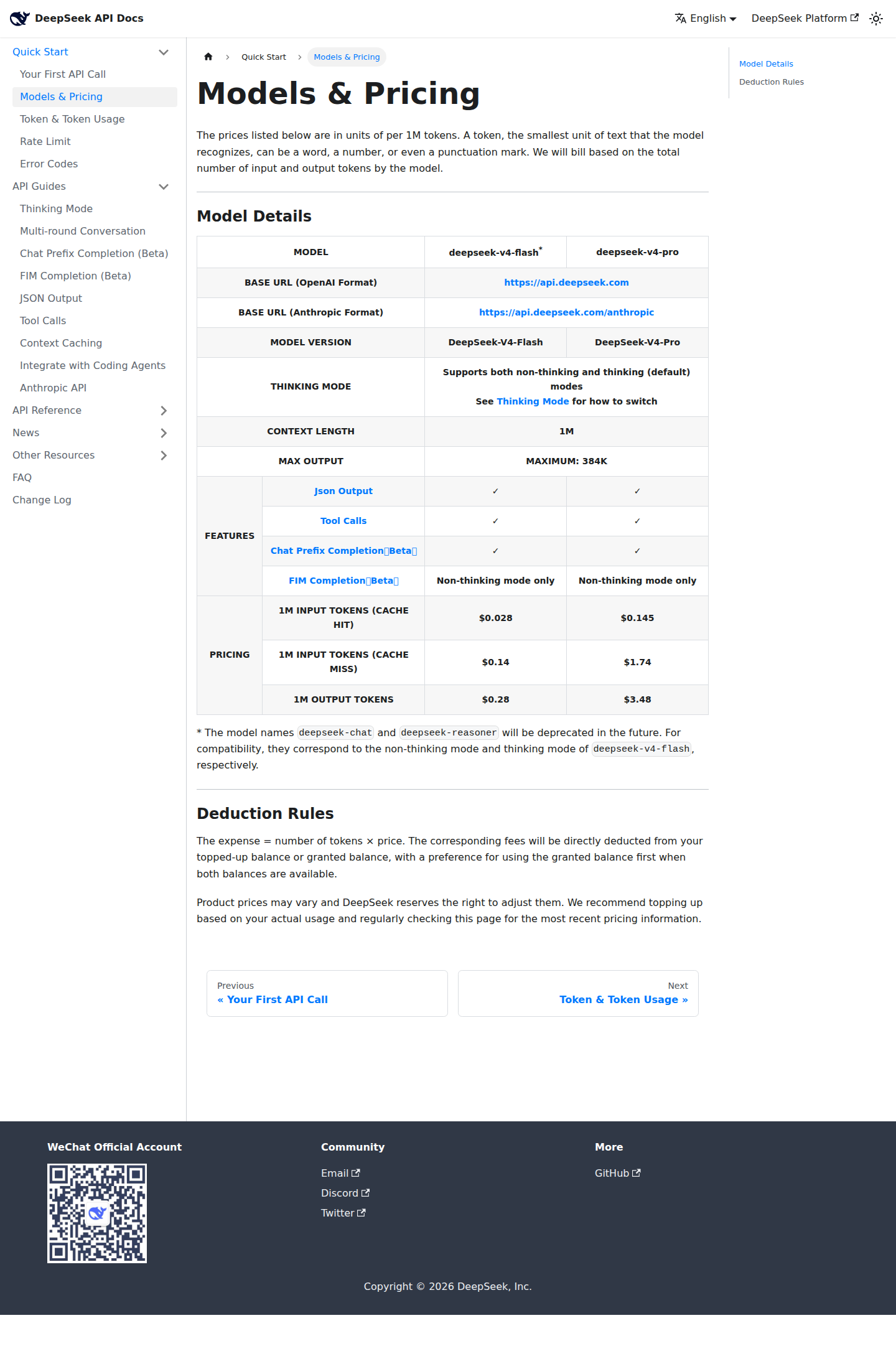

По официальным страницам DeepSeek картина выглядит так. Обе модели работают с окном контекста 1 млн токенов, поддерживают два режима рассуждения и доступны в тот же API-контур без смены base_url. Меняется только имя модели. Для команд, которые уже сидят на API-интеграциях, это практическая деталь, а не косметика: переключение на V4 не требует перестраивать клиентский слой с нуля.

| Параметр | DeepSeek V4 Flash | DeepSeek V4 Pro |

|---|---|---|

| Общие / активные параметры | 284B / 13B | 1.6T / 49B |

| Контекст | 1M | 1M |

| Максимальный вывод | 384K | 384K |

| Режимы | Thinking и non-thinking | Thinking и non-thinking |

| Доступ | OpenAI ChatCompletions, Anthropic API, open weights | OpenAI ChatCompletions, Anthropic API, open weights |

| Цена API, 1M токенов | $0.028 cache hit, $0.14 cache miss, $0.28 output | $0.03625 cache hit, $0.435 cache miss, $0.87 output до 5 мая 2026 года 15:59 UTC; затем $0.145, $1.74 и $3.48 |

Отдельный операционный нюанс: старые алиасы deepseek-chat и deepseek-reasoner пока ещё работают, но в changelog DeepSeek уже поставила им срок жизни до 24 июля 2026 года. То есть V4 не висит рядом со старой линейкой как эксперимент. Компания явно переводит всю API-историю на новый слой.

Зачем DeepSeek выпустила сразу Pro и Flash

В этой паре и спрятан главный смысл релиза. Если бы DeepSeek вывела только одну большую модель, рынок прочитал бы это как ещё одну попытку доказать, что открытые веса могут догнать закрытый верхний сегмент. Но связка Pro + Flash говорит о более зрелом сценарии: компания хочет покрыть не только витринный максимум, но и рабочую маршрутизацию задач.

DeepSeek V4 Pro здесь выступает как старшая модель для тяжёлых задач на рассуждение, сложного кода и более дорогих агентных сценариев. DeepSeek V4 Flash — не «обрезок для галочки», а дешёвый слой с тем же 1M context и теми же режимами рассуждения. В карточке на Hugging Face DeepSeek прямо пишет, что Flash при большем thinking budget может близко подходить к Pro по качеству рассуждений, хотя и уступает на задачах на знания и в самых тяжёлых агентных сценариях.

Для разработчиков это важнее красивого лозунга про открытость. Появляется понятная архитектура: держать Flash на рутинных длинных прогонах, предварительном анализе и части агентных вызовов, а Pro включать там, где цена ошибки выше. Такой продуктовый расклад уже напоминает зрелые закрытые платформы, где модельный ряд строят под разные классы нагрузки, а не под один демонстрационный максимум.

Почему разговор о frontier-классе теперь выглядит иначе

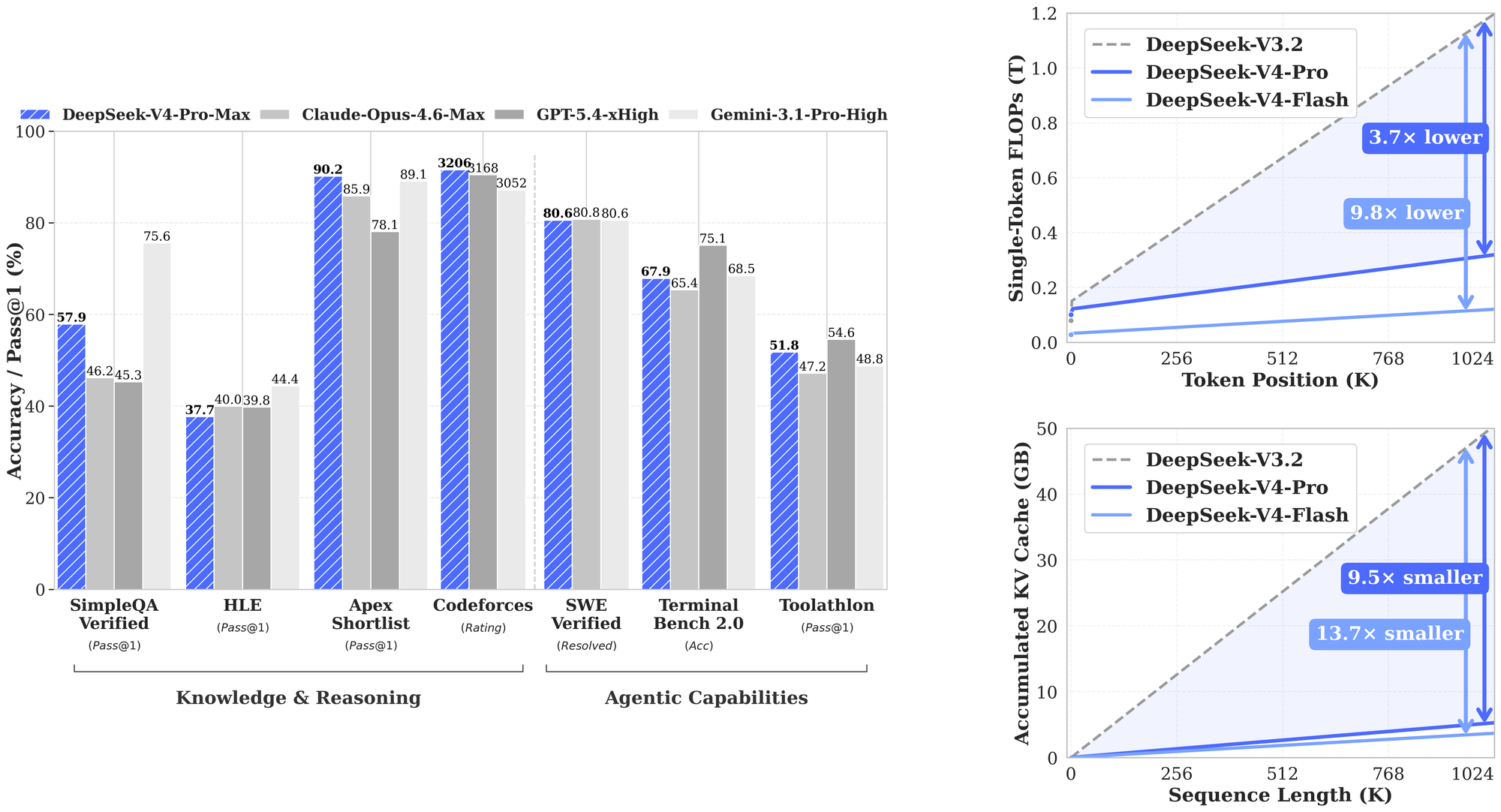

Самый громкий тезис DeepSeek в этом релизе — не просто 1M context и не только открытые веса. Компания прямо утверждает, что DeepSeek V4 Pro Max заметно сократила разрыв с ведущими закрытыми моделями в задачах на рассуждение и агентной работе. В техническом отчёте DeepSeek формулирует это аккуратнее, чем в рекламных пересказах: по стандартным reasoning-бенчмаркам Pro Max уже превосходит GPT-5.2 и Gemini 3.0 Pro, но всё ещё слегка уступает GPT-5.4 и Gemini 3.1 Pro.

Это важная разница. Говорить, что DeepSeek уже «догнала frontier», было бы небрежно. Та же DeepSeek в техотчёте пишет, что траектория модели всё ещё отстаёт от state-of-the-art frontier-моделей примерно на 3–6 месяцев. Но и старая формула «открытые модели дешевле, зато заметно слабее» после этого релиза звучит уже слишком грубо.

Есть и вторая причина, почему рынок читает этот запуск как сигнал сближения. DeepSeek продаёт не только абсолютный максимум качества, а сочетание качеств, которое раньше обычно было разбросано по разным лагерям: миллионный контекст, режимы рассуждения, API-совместимость, агентный фокус и открытые веса под лицензией MIT. Даже AP в разборе релиза отдельно отмечает, что ожидание вокруг V4 было связано именно с проверкой, насколько близко китайская лаборатория сможет подойти к OpenAI, Anthropic и Google.

Где разрыв всё ещё остаётся

Релиз DeepSeek V4 важно не перехвалить. Из того же техотчёта следует, что сильнее всего серия выглядит в задачах на рассуждение, коде и длинном контексте. Но на задачах на знания закрытый верхний сегмент всё ещё держит дистанцию, а Flash при всей своей привлекательности не становится полной заменой Pro в сложных агентных сценариях.

Сама DeepSeek пишет это почти прямым текстом. Flash чуть позади на задачах на знания и в самых сложных агентных рабочих сценариях. Pro Max на публичных agent-бенчмарках держится рядом с сильными моделями с открытыми весами, но всё ещё уступает лучшим закрытым моделям. Иначе говоря, новая серия перевела разговор из режима «могут ли открытые веса приблизиться к верхнему классу вообще» в режим «насколько часто их уже можно ставить в рабочий контур без автоматического штрафа по качеству».

Для редакторского разбора это и есть ключевой вывод. Разрыв не закрыт. Но он уже недостаточно велик, чтобы обсуждать DeepSeek только через цену и идеологию открытости. После V4 спор перешёл в практическую плоскость: где open-weight модель уже годится для реальной нагрузки, а где закрытая модель всё ещё даёт более сильный запас по качеству.

Что это меняет для команд, которые строят агентов и кодовые сценарии

Главное последствие релиза не в заголовке «кто кого победил». Оно в том, что у команд появляется более гибкая развилка. Можно смотреть на DeepSeek не как на единственную модель для всего подряд, а как на двухуровневую связку: Flash для дешёвого длинного контекста и части агентной рутины, Pro для более тяжёлых reasoning- и coding-задач. Для тех, кому нужен широкий фон по самой лаборатории, у нас есть отдельный разбор как DeepSeek изменила рынок ИИ.

Второй сдвиг ещё важнее. Открытые веса здесь перестают быть просто политическим аргументом против закрытых API. Они становятся частью переговорной позиции. Если модель уже умеет жить на 1M context, поддерживает thinking, tool calls и совместима с популярными API-форматами, то выбор теперь идёт не между «серьёзной закрытой моделью» и «дешёвой открытой игрушкой». Выбор уже между разными способами владеть почти одним и тем же классом возможностей.

Именно поэтому DeepSeek V4 Pro и Flash стоит читать не как очередную таблицу бенчмарков. Это продуктовый сигнал. DeepSeek показывает, что модельный ряд с открытыми весами можно строить вокруг реальных рабочих режимов: длинной памяти, дешёвого массового слоя, более сильного уровня рассуждений и прямой совместимости с текущими интеграциями.

Этого пока недостаточно, чтобы объявить закрытый frontier-класс побеждённым. Но достаточно, чтобы признать: после 24 апреля 2026 года планка для открытых моделей стала другой. DeepSeek уже не просто давит на цену. Она давит на саму границу между «открытым» и «frontier».

Источники и дата проверки

Факты, даты, характеристики, API-детали и цены в этом материале проверены 26 апреля 2026 года по официальным источникам DeepSeek: релизу DeepSeek V4 Preview Release, changelog DeepSeek API Docs, странице Models & Pricing, карточке DeepSeek-V4-Pro на Hugging Face и техническому отчёту DeepSeek-V4. Внешний рыночный контекст сверялся по материалу AP News.