DeepSeek V4 на Huawei Ascend: как Китай собирает суверенный AI-стек

DeepSeek V4 важна не только как новая модель. Вместе с Ascend и Huawei MindIE она начинает выглядеть как реальный китайский контур развёртывания, а не просто ещё один релиз LLM.

Проверено 26 апреля 2026 года. DeepSeek V4 на Huawei Ascend важна не только как новый раунд гонки моделей. За двое суток вокруг релиза сложилась более интересная конструкция. DeepSeek выпустила V4 Preview с открытыми весами, обновила API и сделала миллионный контекст стандартным режимом. Huawei со своей стороны не ограничилась общими словами про поддержку ИИ. На Ascend community уже есть отдельный DeepSeek-хаб, официальный гайд по быстрому развёртыванию DeepSeek-V4-Flash на серверах Atlas 800I A2/A3 и собственный слой инференса MindIE, который продаётся как способ поднимать такие модели через знакомые интерфейсы вроде OpenAI API и vLLM.

Из этого пока рано делать громкий вывод, что Китай уже полностью ушёл от Nvidia во всём жизненном цикле передовой модели. Таких доказательств в открытых источниках нет. Но корректный вывод всё равно сильный: по состоянию на 26 апреля 2026 года у DeepSeek и Huawei уже виден не только модельный релиз, а рабочий контур инференса и развёртывания. Именно это и делает историю про open weights против закрытого API менее абстрактной, чем ещё неделю назад.

Что именно вышло 24–25 апреля

24 апреля DeepSeek официально вывела DeepSeek-V4-Pro и DeepSeek-V4-Flash в preview. В релизе есть две детали, без которых этот материал не собрать. Первая, обе модели стали частью живого продуктового контура уже в день анонса: их можно было запускать в чате и через API. Вторая, 1M context теперь стал стандартом для всех официальных сервисов DeepSeek, а старые имена deepseek-chat и deepseek-reasoner переведены в режим временной совместимости до 24 июля 2026 года.

На следующий день, 25 апреля, на Ascend community появился подробный гайд по быстрому развёртыванию для DeepSeek-V4-Flash. Huawei описывает вполне конкретный сценарий: после подготовки ОС и сети пользователь может автоматически скачать vLLM-Ascend, NPU-драйверы и прошивку, системные зависимости и веса модели, а затем одной командой поднять сервис на Ascend Atlas 800I A2 или A3. Для истории о «суверенном стеке» это важнее любой пресс-релизной формулировки. Здесь уже есть не лозунг, а путь развёртывания.

| Слой | Что подтверждено | Что это даёт |

|---|---|---|

| Модель | DeepSeek V4 Preview с open weights, 1M context и API в день релиза | Китайский стек получает собственный слой модели, а не только доступ к чужим закрытым API |

| Интерфейс доступа | DeepSeek поддерживает OpenAI ChatCompletions и Anthropic-compatible API | Снижается стоимость миграции для команд, которые уже живут на привычных клиентских интерфейсах |

| Железо и инференс | Huawei показывает официальный путь развёртывания для DeepSeek-V4-Flash на Ascend Atlas 800I A2/A3 | Появляется практический сценарий работы вне контура, где всё завязано на Nvidia хотя бы на уровне инференса |

| Слой эксплуатации | MindIE продвигает OpenAI, Triton и vLLM-совместимые интерфейсы и кейсы локального развёртывания DeepSeek | История движется от «у нас есть чип» к «у нас есть продаваемый путь внедрения» |

| Граница утверждений | Открытых подтверждений полного контура обучения V4 без Nvidia нет | Говорить о готовом цельном суверенном стеке пока рано; про инференсе и развёртывании говорить уже можно |

Что DeepSeek приносит в этот стек

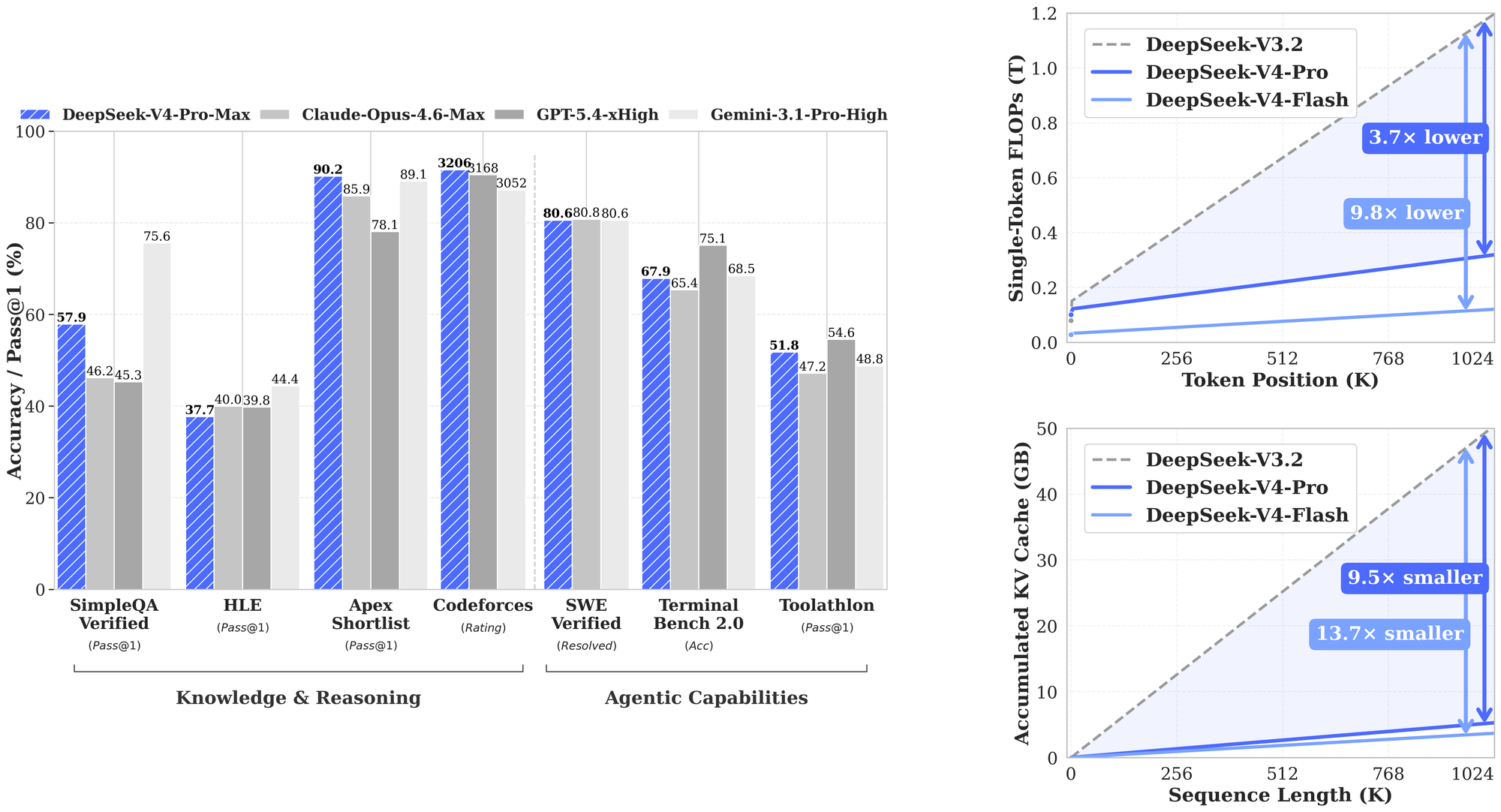

Если убрать рынок и политику, вклад DeepSeek легко описать в сухих параметрах. По модельной карточке на Hugging Face DeepSeek-V4-Pro заявлена как модель на 1,6 трлн параметров с 49 млрд активных, а DeepSeek-V4-Flash как 284-миллиардная модель с 13 млрд активных параметров. Обе получают контекстное окно 1 млн токенов. Для инструктивных моделей используется смешанная точность FP4 и FP8, а сами веса выпущены под лицензией MIT.

Это важно не только как техническая справка. До сих пор разговор о суверенном ИИ часто ломался на первой же ступени: кто вообще даёт модельный слой, который можно держать у себя, а не просто арендовать по закрытому API. DeepSeek V4 впервые делает этот вопрос менее теоретическим. Мы уже разбирали в материале про экономику DeepSeek V4, как компания ломает цену длинного контекста. Для новой статьи важнее другой вывод: теперь DeepSeek продаёт не только дешёвую точку входа, но и право держать передовую модель внутри собственного контура.

В официальной карточке и техотчёте DeepSeek ещё заметнее другая деталь. V4 строится вокруг архитектуры длинного контекста. В релизе компания называет 1M context стандартом для всех официальных сервисов, а в техотчёте подчёркивает, что модель целится не просто в гонку бенчмарков, а в агентные сценарии, где длинная память действительно работает, а не висит в характеристиках ради маркетинга.

Что Huawei добавляет поверх модели

Самый интересный слой начинается там, где заканчивается обычная модельная карточка. На странице DeepSeek专区 Huawei пишет прямым текстом, что Ascend уже поддерживает серию моделей DeepSeek. Но куда важнее не эта строка сама по себе, а то, что идёт дальше. Уже 25 апреля Huawei публикует отдельный гайд по быстрому развёртыванию DeepSeek-V4-Flash-w8a8-mtp на серверах Atlas 800I A2/A3. В гайде зафиксирован не общий принцип, а маршрут: автоматическая загрузка vLLM-Ascend, драйверов и firmware, затем автоматическая установка базового окружения, затем запуск модели как API-сервиса.

Для корпоративного рынка это и есть главный технологический сигнал. Модель сама по себе мало что решает, если рядом нет поддерживаемого пути внедрения. Huawei пытается закрыть именно эту дыру. По сути, компания говорит корпоративному заказчику и госсектору: вам не нужно выбирать между «у нас есть китайский чип» и «у нас есть рабочий сервис». Мы хотим дать и то и другое.

Почему MindIE здесь не второстепенная деталь

Если смотреть только на одну статью про гайд по развёртыванию, можно решить, что речь идёт о локальной технической демонстрации. Страница MindIE рисует более широкую картину. Huawei называет MindIE инференс-движком для Ascend, который упрощает deployment, debugging и optimization, отдельно подчёркивает совместимость с OpenAI, Triton и vLLM-подобными интерфейсами, а в кейсах прямо показывает развёртывание DeepSeek в разных средах: China Southern Airlines, платформы для городских сервисов в Лунгане и университетский контур в Southeast University.

Это ещё не доказательство того, что вся страна одномоментно пересела на DeepSeek V4. Но это уже подтверждение более скромной и важной вещи: Huawei продаёт не только железо, а целый слой эксплуатации вокруг таких моделей. Для суверенного ИИ-стека это почти обязательное условие. Без слоя инференса, понятных API и реальных сценариев эксплуатации даже сильная модель остаётся исследовательским активом, а не промышленным продуктом.

В этом смысле DeepSeek и Huawei повторяют логику, которую мы видели в другой географии в материале про AI-суверенитет Европы и Mistral. Суверенность на рынке начинается не с лозунга, а с собранной цепочки: модель, вычисления, развёртывание, закупочный контур и понятная юрисдикция. Разница только в том, что китайская связка сейчас выглядит заметно более жёсткой именно на уровне инфраструктурного исполнения.

Где нужно тормозить с выводами

Самая опасная ошибка в такой статье — перепрыгнуть от «есть путь развёртывания на Ascend» к «DeepSeek полностью ушла от Nvidia». Открытые источники такого не подтверждают. The Verge отдельно пишет, что компания не раскрыла стоимость обучения V4 и не сообщила, на каком именно железе модель обучалась. AP тоже описывает связку DeepSeek и Huawei как шаг к снижению зависимости от Nvidia, а не как доказанный полный разрыв с американским стеком.

Поэтому корректная формулировка уже сейчас такая: вокруг DeepSeek V4 и Huawei Ascend у Китая вырисовывается более цельная история про суверенный ИИ, но на практике он лучше подтверждён на уровне инференса и развёртывания, чем на уровне полного контура обучения. Это не слабый вывод. Наоборот, он полезнее лозунга про «полный суверенитет», потому что описывает реальный прогресс, а не красивую абстракцию.

Есть и вторая оговорка. Не стоит путать open weights с массовой доступностью. Даже если модель выпущена по MIT, масштаб V4 Pro остаётся инфраструктурно тяжёлым. Тут DeepSeek выигрывает не тем, что любой разработчик запустит всё на ноутбуке, а тем, что для крупных китайских игроков и их подрядчиков появляется своя переговорная позиция: модель можно арендовать через API, а можно интегрировать в более контролируемый контур.

Почему эта история важнее ещё одного модельного релиза

Снаружи DeepSeek V4 выглядит как очередная запись в новостной ленте: новая линейка, сильные бенчмарки, новый ценник, очередной спор с OpenAI и Anthropic. Но если соединить DeepSeek API Docs, Hugging Face и Ascend community, получается другая картина. Здесь уже складывается не просто модельный анонс, а собственная китайская версия технологического пакета: модельный слой, открытые веса, API-совместимость, длинный контекст, слой инференса и официальный путь развёртывания на национальном аппаратном контуре.

Это особенно важно в момент, когда мировой рынок всё чаще упирается не в вопрос «какая модель умнее», а в вопрос «кто контролирует среду, в которой эта модель работает». Для закрытых API передового класса ответ давно готов: среду контролирует вендор. Связка DeepSeek и Huawei даёт другой ответ: часть этой среды можно постепенно собирать у себя, пусть и не без оговорок.

По состоянию на 26 апреля 2026 года самый точный вывод звучит так. DeepSeek V4 на Huawei Ascend — это ещё не окончательно собранный цельный суверенный ИИ-стек Китая. Но это уже и не просто новый релиз модели. Это первый достаточно конкретный момент, когда китайский контур модели, API и инференса начал выглядеть как связанная система, а не как набор разрозненных амбиций.

Источники и дата проверки

- DeepSeek API Docs: DeepSeek V4 Preview Release, опубликовано 24 апреля 2026 года, проверено 26 апреля 2026 года.

- DeepSeek API Docs: Models & Pricing, проверено 26 апреля 2026 года.

- Hugging Face: DeepSeek-V4-Pro, проверено 26 апреля 2026 года.

- Ascend Community: DeepSeek专区, проверено 26 апреля 2026 года.

- Ascend Community: DeepSeek-V4-Flash 极速体验指南, опубликовано 25 апреля 2026 года, проверено 26 апреля 2026 года.

- Ascend Community: MindIE, проверено 26 апреля 2026 года.

- AP News: China’s DeepSeek rolls out a long-anticipated update of its AI model, опубликовано 25 апреля 2026 года, проверено 26 апреля 2026 года.

- The Verge: China’s DeepSeek previews new AI model a year after jolting US rivals, опубликовано 24 апреля 2026 года, проверено 26 апреля 2026 года.