safetensors в PyTorch Foundation: почему это важно для безопасности моделей

safetensors стал проектом PyTorch Foundation. Это сигнал, что безопасная поставка весов моделей становится базовым требованием для open-source ИИ.

safetensors в PyTorch Foundation выглядит как инфраструктурная новость, которую легко пропустить на фоне релизов моделей. Но 8 апреля 2026 года PyTorch Foundation объявила, что safetensors стал её новым проектом фонда рядом с PyTorch, vLLM, DeepSpeed, Ray и Helion. Для рынка моделей с открытыми весами это важнее, чем кажется по заголовку: речь не о новой библиотеке, а о закреплении формата, который помогает распространять веса без риска произвольного выполнения кода при загрузке.

Если коротко, PyTorch Foundation взяла под своё крыло не очередной «полезный инструмент», а один из базовых кирпичей современной цепочки поставки моделей. Именно поэтому новость стоит читать не как бюрократический апдейт про Linux Foundation, а как сигнал о том, какой формат индустрия всё увереннее считает безопасной нормой.

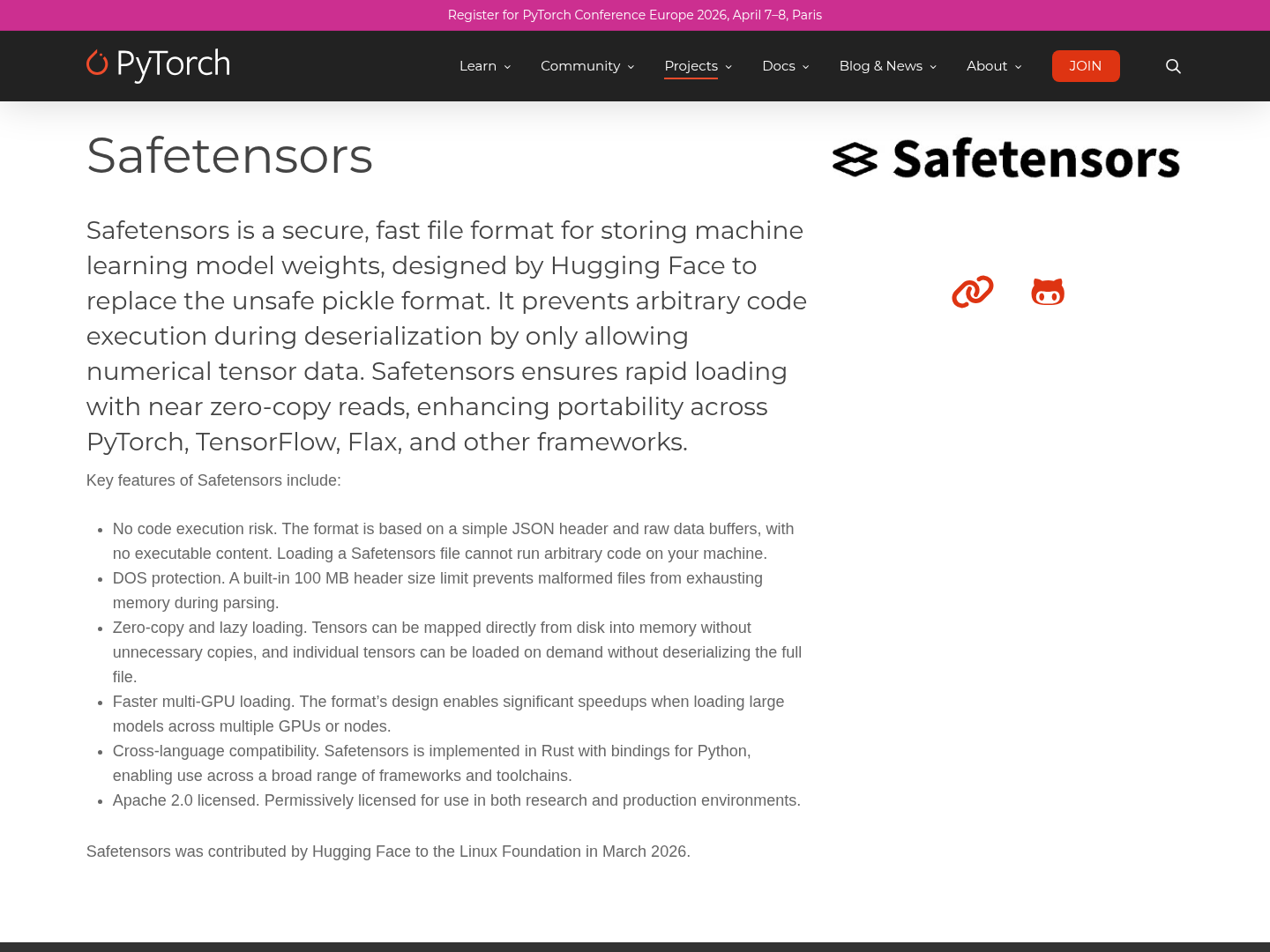

По состоянию на 8 апреля 2026 года PyTorch Foundation официально объявила safetensors своим новым проектом фонда. На странице проекта также указано, что Hugging Face передала safetensors в Linux Foundation в марте 2026 года.

Что именно произошло 8 апреля

В официальном анонсе PyTorch Foundation пишет, что safetensors стал новым проектом фонда и теперь находится в одном контуре с DeepSpeed, Helion, PyTorch, Ray и vLLM. Формулировка здесь важна: это не интеграция в ядро PyTorch и не обещание, что весь рынок немедленно переедет на один формат. Это институциональный шаг: один из самых заметных форматов для распространения весов моделей получает более формальный дом внутри экосистемы, которая и так управляет значительной частью рабочего стека вокруг открытого ИИ.

PyTorch Foundation делает акцент сразу на двух вещах. Первая — безопасность. В анонсе фонд прямо говорит, что вклад safetensors от Hugging Face снижает риск произвольного выполнения кода при работе с модельными файлами. Вторая — производительность. Там же говорится о более высокой скорости в сложных вычислительных сценариях, включая развёртывания на нескольких GPU и нескольких узлах.

Смысл в том, что safetensors теперь легитимизируется не только как удобный формат из экосистемы Hugging Face, но и как часть более широкого инфраструктурного слоя open-source ИИ. Для компаний это важный сигнал: если вы строите поставку и загрузку моделей в боевом контуре, индустрия всё отчётливее указывает, какой формат считается базовой гигиеной.

Почему safetensors вообще стал де-факто стандартом

На странице проекта PyTorch описывает safetensors как безопасный и быстрый формат для хранения весов моделей, созданный Hugging Face на замену небезопасному pickle-подходу. Ключевая идея простая: файл хранит только числовые тензоры, JSON-заголовок и сырые буферы данных. В такой схеме загрузка файла не должна запускать произвольный код на машине пользователя.

Это не теоретическая деталь. В политике безопасности библиотеки Transformers команда Hugging Face отдельно пишет, что рекомендует загружать и скачивать модели именно в формате safetensors, потому что он разработан специально для предотвращения произвольного выполнения кода на вашей системе. Там же есть практический совет: при загрузке моделей можно использовать параметр use_safetensors, чтобы библиотека не подхватила небезопасный формат, если рядом нет файла .safetensors.

Кроме безопасности у формата есть и инженерные плюсы, которые делают его удобным не только для security-команд. Страница проекта перечисляет zero-copy и lazy loading, ограничение заголовка в 100 МБ для защиты от некорректных файлов, более быструю загрузку больших моделей на нескольких GPU и совместимость с PyTorch, TensorFlow, Flax и другими инструментами. То есть safetensors выигрывает не потому, что «безопаснее на бумаге», а потому что хорошо вписывается в реальные рабочие конвейеры.

Почему это важно для open-source ИИ именно сейчас

В 2026 году рынок моделей с открытыми весами уже нельзя описывать только словами «вышла новая LLM». Намного важнее становится всё, что происходит вокруг самой модели: как распространяются веса, как проверяются артефакты, как загружаются зависимости и где в цепочке может появиться вредоносный код. Мы уже разбирали, к чему приводит слабый контроль над поставкой пакетов, на примере взлома LiteLLM на PyPI. История с safetensors — из той же плоскости, только на уровне формата распространения самих весов.

Поэтому переход в PyTorch Foundation важен не только для Hugging Face. Он усиливает шанс, что вокруг safetensors будет больше согласованной инфраструктуры, документации и боевых практик. Это особенно заметно на фоне роста open-source экосистемы моделей и инструментов, о которой мы писали в материале про Hugging Face как платформу open-source ИИ. Чем больше открытых моделей крутится между репозиториями, облаками и inference-стеками, тем дороже становятся ошибки в формате поставки.

Есть и чисто практический слой. PyTorch Foundation теперь объединяет проекты, которые часто встречаются в одном боевом контуре: собственно PyTorch, inference-движки вроде vLLM, распределённые тренинговые и serving-компоненты. Мы отдельно разбирали, как развернуть LLM на сервере с vLLM. На этом фоне safetensors внутри того же фонда выглядит не случайным пополнением списка, а попыткой собрать более связный технический фундамент для open-source ИИ-стека.

Что эта новость пока не означает

Из такого анонса легко сделать слишком широкий вывод, и это была бы ошибка. PyTorch Foundation не объявляла, что safetensors стал обязательным форматом для всей экосистемы PyTorch. Фонд также не заявлял, что проблема безопасности поставки моделей решена целиком. Формат убирает один важный класс рисков, но не отменяет проверку источников, целостности файлов, зависимостей и поведения кода вокруг самих моделей.

Не стоит и подменять новость другим тезисом: «safetensors уже встроен в PyTorch по умолчанию». В официальных материалах такого обещания нет. Правильнее читать событие так: индустрия закрепляет safetensors как всё более стандартный и доверенный формат для дистрибуции весов, но вопрос обязательности и глубины интеграции всё ещё зависит от конкретных библиотек, сервисов и рабочих процессов.

Итог

Переход safetensors в PyTorch Foundation важен не из-за формального статуса сам по себе, а потому что он фиксирует зрелость формата на уровне инфраструктуры. Open-source ИИ упирается не только в качество моделей, но и в то, насколько безопасно и быстро эти модели можно доставить в боевой контур. Safetensors закрывает как раз этот слой.

Если смотреть на рынок трезво, это не самая громкая новость недели. Но именно из таких новостей и складывается реальный технический стандарт отрасли. Через год все будут спорить о том, какой стек «по умолчанию» считается нормальным для моделей с открытыми весами. И решение PyTorch Foundation уже подсказывает один из ответов.