Hugging Face в 2026 году: что даёт платформа разработчику, кроме каталога моделей

Практический разбор Hugging Face: где платформа помогает искать модели, собирать демо и быстро запускать inference, а где нужен свой стек.

Проверено 6 мая 2026 года. Hugging Face часто называют «GitHub для ИИ», но в 2026 году это уже слишком узкая формула. Платформа давно стала не только каталогом весов: это одновременно Hub с git-репозиториями, model cards, датасеты, Spaces для демо, serverless-инференс через Inference Providers и выделенные Inference Endpoints для продакшена.

Если нужен общий маршрут по экосистеме больших моделей, начните с полного гайда по LLM для разработчиков. Если вы уже выбираете между семействами открытых моделей, держите рядом разбор Llama, Mistral и Qwen. А здесь разбираем следующий слой: когда Hugging Face действительно ускоряет работу команды, а когда лучше сразу идти в локальный запуск или в свой серверный контур с vLLM.

| Задача | Что брать в Hugging Face | На что смотреть сразу |

|---|---|---|

| Быстро найти и проверить открытую модель | Model Hub, model card, встроенный виджет или Inference Providers | Лицензия, ограничения, качество model card и доступность нужного рантайма |

| Показать рабочее демо команде или клиенту | Spaces | Хватит ли бесплатного CPU, нужен ли GPU, сколько живёт и сколько стоит демо |

| Дать API к модели без собственной инфраструктуры | Inference Providers | Кредиты, тарификация, провайдер и то, подходит ли serverless-путь под ваш трафик |

| Собрать стабильный production-контур | Inference Endpoints или свой сервер | SLO, контроль над железом, стоимость часа и совместимость со стеком |

Что такое Hugging Face на практике

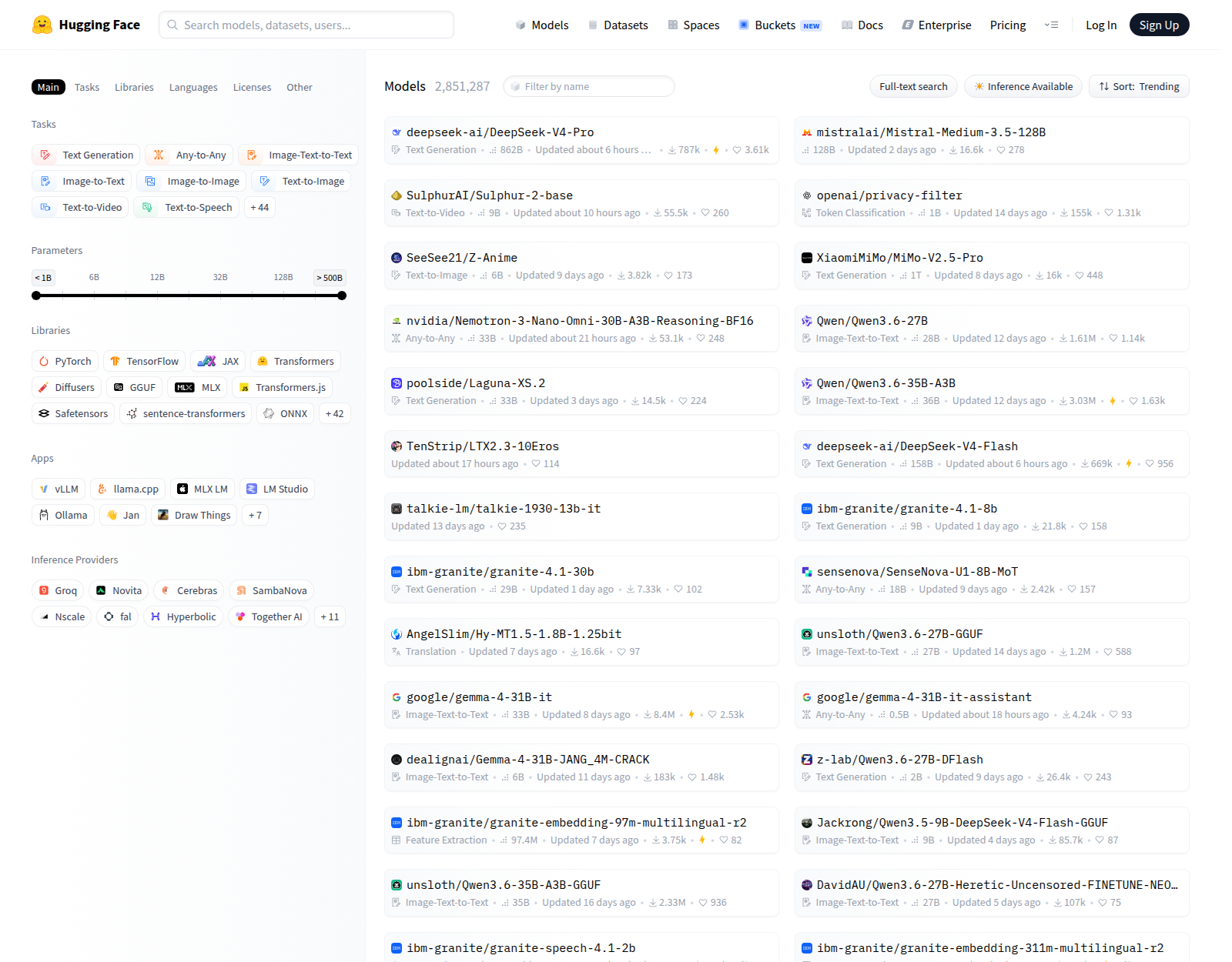

По официальной документации Hub, на платформе сейчас больше 2 млн моделей, 500 тыс. датасетов и 1 млн демо-приложений. Но важнее не сами цифры, а то, как это собрано. Hugging Face хранит модели, датасеты и Spaces в git-репозиториях, даёт версионность, историю изменений, pull request, обсуждения, коллекции и единые ссылки на артефакты команды.

Поэтому короткий ответ на вопрос «что такое Hugging Face?» звучит так: это общий слой совместной работы вокруг открытых моделей и ML-артефактов. Не просто витрина, а место, где разработчик может найти модель, проверить карточку, скачать веса, поднять демо, дать ссылку коллеге и при необходимости перейти к API или выделенному развёртыванию.

Model Hub: каталог — это только первый слой

Самая недооценённая часть Hugging Face — не список популярных моделей, а структура вокруг них. Model card в документации платформы описана как обязательный слой для discoverability, reproducibility и sharing. На практике это значит, что нормальная карточка должна объяснять назначение модели, ограничения, датасеты, метрики и сценарии использования, а не просто давать кнопку Download.

Для команды это важнее красивого leaderboard. Один и тот же Hub помогает отсеять половину плохих кандидатов ещё до запуска: видно задачу, язык, лицензию, статус gated/open, примеры, файлы и связанные датасеты. А если вы потом уходите в локальный стек, то именно отсюда обычно начинается маршрут в квантизацию, GGUF-версии и интеграции под Ollama.

Библиотеки и рабочий контур команды

Если смотреть глазами разработчика, Hugging Face полезен тем, что не заканчивается на Hub. В официальной документации рядом живут Transformers, Datasets, Diffusers, PEFT, TRL, Accelerate, Text Generation Inference и другие инструменты. Это и есть причина, почему платформу удобно держать в рабочем контуре, а не только использовать как склад файлов.

Практический смысл простой. Исследователь публикует чекпоинт и model card в Hub. Инженер поднимает его через Transformers или huggingface_hub. Команда дообучает адаптер через LoRA, держит рядом датасет и решает, что делать дальше: дать демо через Spaces, быстрый API через Inference Providers или увести модель в отдельный серверный стек. Для материалов про ИИ для разработчиков это важный сценарий: одна платформа связывает исследование, интеграцию и внутреннюю передачу знаний.

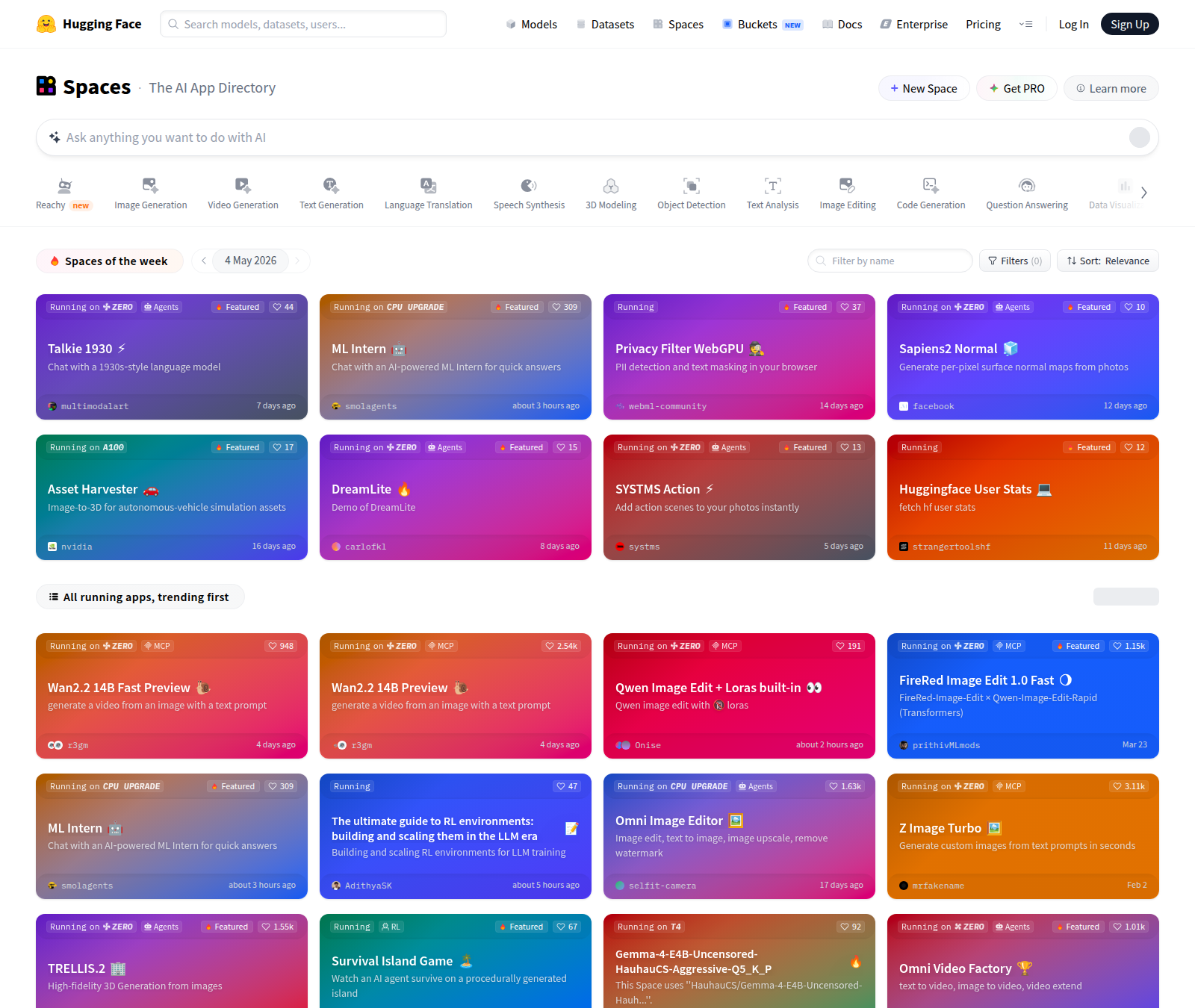

Spaces: где прототип запускают быстрее, чем согласуют фронтенд

Spaces закрывают другой слой: показать модель в браузере без собственного развёртывания. В документации сказано, что бесплатное окружение даёт 2 vCPU, 16 ГБ RAM и 50 ГБ непостоянного диска. Для более тяжёлых демо есть платное железо: на странице pricing сейчас указаны, например, T4 small от $0.40 в час и T4 medium от $0.60 в час. Для части сценариев Hugging Face отдельно продвигает ZeroGPU с динамическими H200.

Отсюда и правильный вывод. Spaces хорошо подходят для внутренних прототипов, портфолио, быстрых proof of concept и публичных демо. Но если у вас жёсткие требования к доступности, приватности или предсказуемой нагрузке, нельзя путать удобный demo-hosting с production-serving.

Inference Providers, Endpoints или свой сервер

Самое заметное изменение последних версий платформы — смещение от старой логики «просто вызовите модель через API» к более чёткой развилке.

Inference Providers дают pay-as-you-go доступ к моделям через единый слой маршрутизации. В документации сервиса указано 200+ моделей, а для старта есть месячные кредиты: $0.10 для бесплатных аккаунтов, $2 для PRO и $2 на каждое место в Team или Enterprise. Это хороший путь для экспериментов, сравнения моделей и быстрого подключения без своей инфраструктуры.

Inference Endpoints — уже другой разговор. Это выделенное и управляемое развёртывание на отдельной инфраструктуре. На pricing-странице Hugging Face сейчас указан вход от $0.033 в час для CPU-инстансов, дальше цена зависит от облака, памяти и ускорителей. Такой вариант ближе к production, чем к песочнице.

Свой сервер по-прежнему нужен там, где вам важны предсказуемая стоимость, контроль над рантаймом, низкая задержка или локальное размещение. Поэтому Hugging Face не отменяет собственный inference-стек, а скорее помогает быстрее дойти до момента, когда вы понимаете, какой именно стек вам нужен.

Где команды обычно ошибаются

- Смотрят на популярность репозитория вместо назначения. Трендовая модель в Hub ещё не означает, что она подходит под ваш язык, лицензию, память и формат развёртывания.

- Игнорируют model card. Если карточка плохо заполнена, вы теряете контекст про ограничения, датасеты и intended use ещё до первого запуска.

- Путают demo-speed и production-readiness. То, что модель красиво живёт в Spaces, не говорит, что её так же просто обслуживать под реальной нагрузкой.

- Слишком поздно разводят сценарии. Отдельно нужно выбирать, где вы ищете и проверяете модели, и отдельно — где вы их реально обслуживаете: через Providers, через Endpoints или на своём контуре с vLLM.

- Смешивают платформу и линейку моделей. Hugging Face — это инфраструктурный слой. Ответ на вопрос «какую open-weight модель выбрать?» лежит не здесь, а в сравнении семейств моделей.

Когда Hugging Face действительно стоит держать в основном стеке

Платформа особенно полезна в трёх случаях. Первый: команда регулярно сравнивает открытые модели и ей нужен единый реестр артефактов, лицензий и карточек. Второй: вам нужно быстро показать работающий прототип без отдельного DevOps-проекта. Третий: между исследованием и продуктом уже есть несколько человек, и им нужен повторяемый маршрут «репозиторий — данные — демо — API — деплой» без хаоса в файлах и ссылках.

Если же у вас уже есть отлаженный внутренний serving-слой, фиксированный набор моделей и строгие требования по данным, Hugging Face остаётся важным источником моделей и документации, но не обязательно должен быть центром всего production-контура.

Итог

Hugging Face полезно воспринимать не как «ещё один сайт с моделями», а как рабочую инфраструктуру вокруг открытого ML-стека. Hub решает поиск и совместную работу. Spaces ускоряют демонстрацию. Inference Providers помогают быстро попробовать модель через единый API. Endpoints дают управляемый путь к выделенному развёртыванию. А дальше уже начинается инженерный выбор: локальный запуск, собственный сервер или платформа как промежуточный слой.

Именно поэтому статья про Hugging Face должна отвечать не на абстрактный вопрос «что это такое», а на более полезный: где эта платформа экономит команде время, а где только создаёт иллюзию, что инфраструктурный выбор уже сделан.

Источники и дата проверки

Факты и тарифы в этом материале проверены 6 мая 2026 года по официальным источникам Hugging Face:

- Hugging Face Hub documentation — описание Hub, масштабы платформы, Git-based repos, модели, датасеты и Spaces.

- Model Cards — роль карточек моделей для discoverability, reproducibility и sharing.

- Spaces Overview — бесплатное окружение, visibility и базовая модель работы Spaces.

- Hugging Face Pricing — стоимость PRO, Teams, Spaces Hardware и стартовая цена Inference Endpoints.

- Inference Providers — интеграция serverless-инференса в Hub.

- Inference Providers Pricing and Billing — месячные кредиты и логика биллинга.