Luma открыла Uni-1.1 API для генерации изображений

Luma вывела Uni-1.1 в API и делает ставку на рабочий контур: цена за изображение, редактирование на естественном языке, референсы и web_search.

Luma открыла Uni-1.1 API для генерации и редактирования изображений и подаёт это не как ещё один красивый генератор картинок, а как рабочий API для разработчиков и креативных команд. В официальном анонсе от 5 мая 2026 года компания описывает запуск как REST-интерфейс к своей модели Unified Intelligence, где рассуждение и генерация изображений работают внутри одной системы, а не в цепочке из отдельных моделей.

Для рынка это важнее, чем кажется по одному пресс-релизу. Генерация изображений быстро уходит из режима «покажи впечатляющее демо» в режим «встрой в рабочий контур». Luma делает ставку именно на этот переход: цена за изображение, редактирование на естественном языке, до девяти reference images, встроенный web_search и отдельные сценарии для генерации и правки. Это уже разговор не про магию промпта, а про то, как собрать воспроизводимый визуальный конвейер внутри продукта.

По состоянию на 13 мая 2026 года ключевые факты в этом материале сверены по официальным страницам Luma, OpenAI и Google Cloud. Сравнение с OpenAI и Google ниже стоит читать как разбор экономики и рабочих сценариев, а не как доказательство того, что Luma уже «победила» рынок по качеству.

Что именно Luma вывела в API

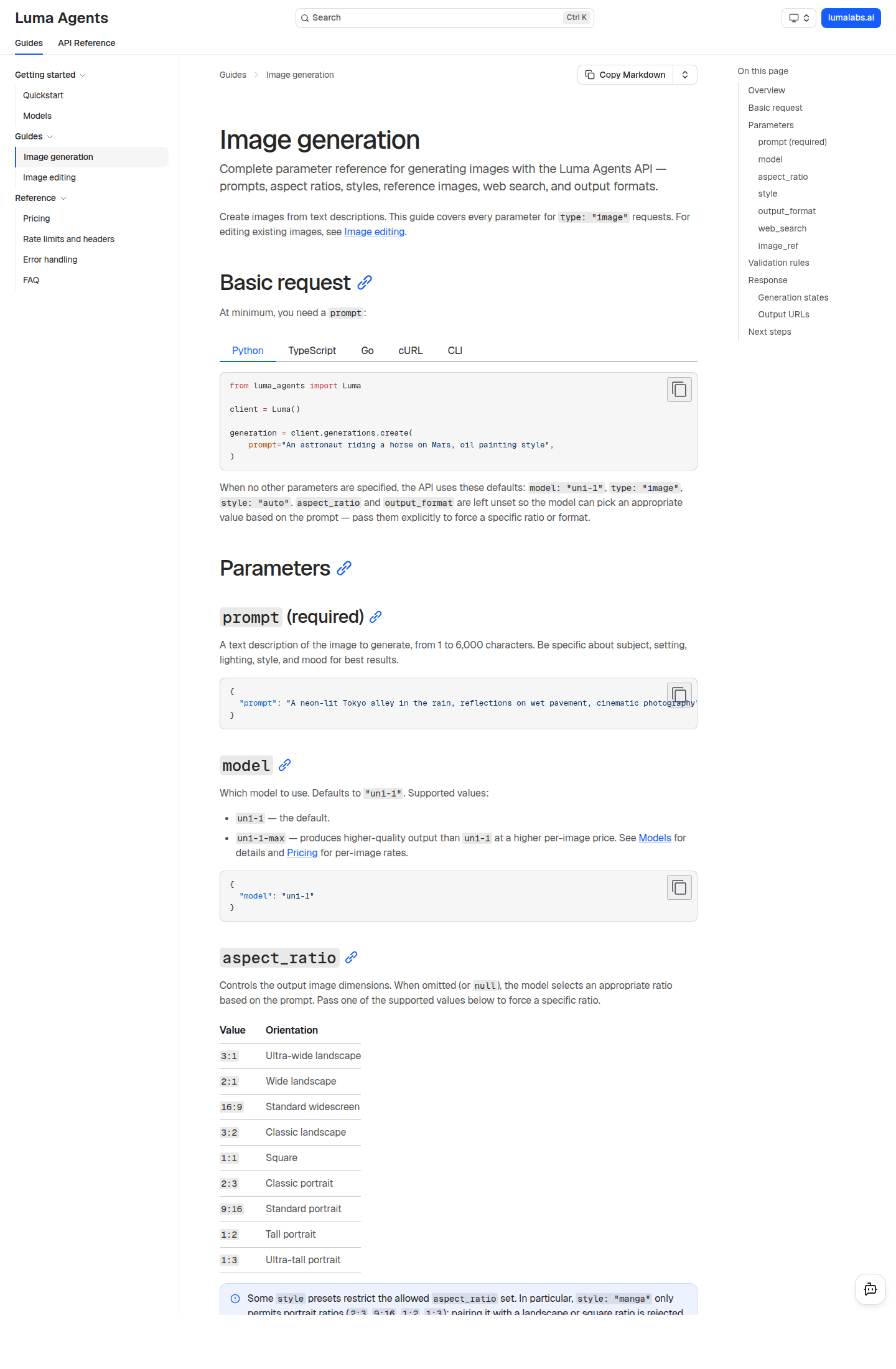

На уровне продукта Luma показывает два главных сценария: Generate Image и Modify Image. В анонсе компания пишет о text-to-image, генерации по референсам и редактировании на естественном языке. В документации это сведено к единой API-схеме семейства uni-1: один и тот же формат покрывает генерацию и редактирование, а переключение идёт через тип запроса.

Из практических деталей здесь важны четыре вещи. Первая: базовая модель uni-1 и более дорогая uni-1-max доступны всем аккаунтам и отличаются в первую очередь качеством вывода и ценой за изображение. Вторая: Luma разрешает до девяти reference images для text-to-image и до восьми референсов для image edit, потому что исходное изображение занимает отдельный слот. Третья: в документации по генерации прямо указана опция web_search: true, при которой модель ищет визуальные ориентиры в интернете до генерации. Четвёртая: компания продаёт это как API со встроенными агентными функциями вроде улучшения промпта, исследования темы и подбора референсов, а не как модель, к которой разработчику придётся отдельно достраивать половину обвязки.

Именно здесь Luma пытается отстроиться от части конкурентов. Не тезисом «наша картинка красивее», а тезисом «наш API лучше держит сложное намерение, больше похож на рабочий конвейер и меньше заставляет пользователя быть промпт-инженером». Для рынка это важный сдвиг: генерация всё чаще становится частью длинной цепочки, где нужно придумать, заземлить на референсах, поправить, сохранить стиль и повторить это в масштабе.

Почему здесь так много разговора про цену и workflow

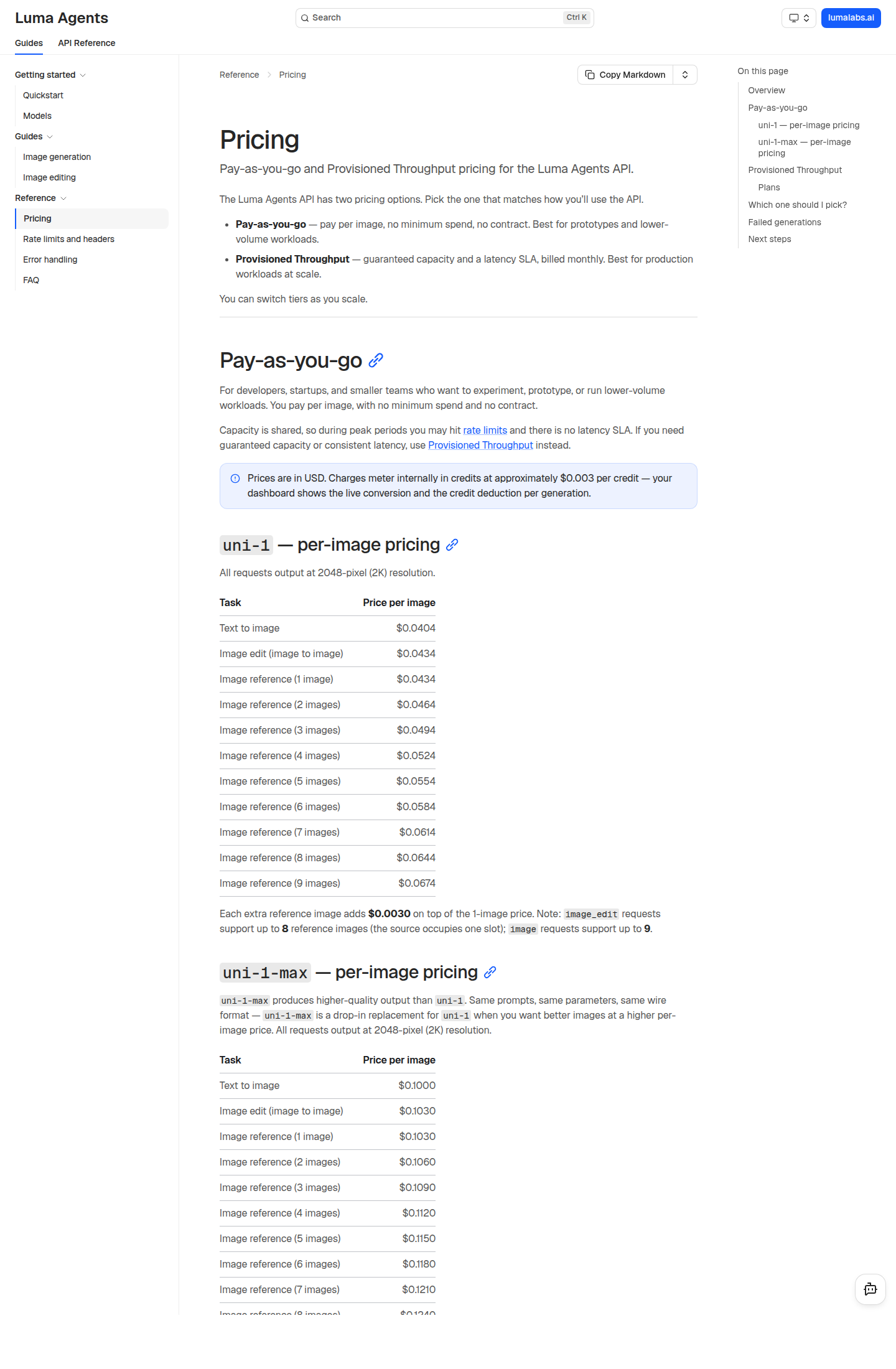

Сухая цена у Luma достаточно агрессивная, чтобы про неё говорить отдельно. На официальной API-странице и в pricing guide компания указывает для uni-1 $0.0404 за text-to-image в 2K, $0.0434 за image edit и шаг примерно по $0.003 за каждый дополнительный reference image. Для uni-1-max базовая цена text-to-image уже $0.1000 за изображение. Для команды, которая делает много вариаций, промо-ассетов или продуктовых рендеров, это уже не мелочь: экономика генерации быстро становится продуктовым ограничением, а не декоративной сноской.

На стороне Google сравнение проще: в актуальной pricing-странице Agent Platform указаны Imagen 4 по $0.04 за изображение, Imagen 4 Ultra по $0.06 и Imagen 4 Fast по $0.02. Здесь видно, почему Luma вообще получила право зайти в разговор «на уровне Google». Её базовый uni-1 почти совпадает с Imagen 4 по цене за изображение, а не живёт в другой ценовой лиге.

С OpenAI картина сложнее и поэтому интереснее. В официальной заметке про image generation API компания по-прежнему объясняет цену gpt-image-1 через токены: $5 за миллион text input tokens, $10 за миллион image input tokens и $40 за миллион output image tokens. Там же OpenAI даёт практическую вилку примерно $0.02, $0.07 и $0.19 за квадратное изображение в low, medium и high quality. Это значит, что лозунг «Luma дешевле OpenAI» нельзя бросать без оговорки: у OpenAI другая схема биллинга и другая шкала качества. Но для разработчика сигнал всё равно понятен. Luma сознательно продаёт image API в понятных единицах «цена за изображение» и делает это рядом с Google, а не где-то в премиальной нише.

Отсюда и главный вывод: рынок image API начинает напоминать рынок LLM API двухлетней давности. Побеждает не тот, кто один раз красиво выступил на демо. Побеждает тот, у кого сочетаются приемлемая цена, понятная интеграция, управляемый результат и меньше ручной возни вокруг модели.

Почему сравнение с OpenAI и Google нельзя сводить к «кто лучше рисует»

Ошибка в таком сюжете напрашивается сама собой: увидеть слова OpenAI, Google и Luma в одном абзаце и превратить материал в небрежный рейтинг генераторов. SEO brief как раз запрещает этот разворот, и правильно. У OpenAI уже есть своя линия: генерация картинок становится рабочим инструментом. Мы разбирали это в материале ChatGPT Images 2.0: OpenAI делает картинки рабочим инструментом. У Google своя: персональный контекст и визуальные сценарии, встроенные в экосистему, о чём мы писали в тексте Google Photos в Gemini: Nano Banana 2 получает личный контекст.

Luma отвечает с третьей позиции. Не через гигантский потребительский интерфейс и не через корпоративную платформу масштаба Google Cloud, а через обещание более прямого рабочего контура: до девяти референсов, правки на естественном языке, улучшение промпта, исследование темы и сбор референсов прямо в API. Иными словами, компания продаёт не только модель, но и сокращение количества промежуточной инженерной работы вокруг неё.

Это важный сдвиг для разработчиков. Если раньше генерация изображений часто жила в продукте как отдельная кнопка «сделай картинку», то теперь модель всё чаще становится частью большого процесса: собрать брендовые ограничения, подтянуть референсы, удержать объект между итерациями, исправить фон, поменять свет, не развалить композицию. Именно в таком процессе Luma и хочет выглядеть не слабее больших игроков.

При этом перебарщивать с выводами не стоит. Заявления про «less than half the price and latency of comparable models», лидерство в Human Preference Elo и RISEBench исходят от самой Luma. Это полезно как сигнал позиционирования, но не как независимый рыночный вердикт. Для Toolarium здесь честнее другой вывод: Luma вышла в ту точку рынка, где её уже нужно сравнивать с OpenAI и Google по реальным рабочим сценариям, а не держать в категории «интересный нишевый визуальный стартап».

Что это говорит о зрелости рынка image APIs

Рынок взрослеет в тот момент, когда разговор смещается с красоты отдельной картинки на надёжность конвейера. У Luma это видно особенно ясно. Компания упаковывает генерацию как программируемую поверхность для команд, которым нужны повторяемость, стоимость и меньше ручной обвязки. Google делает ставку на платформу и контекст. OpenAI давит шириной дистрибуции и общим рабочим интерфейсом. Все трое движутся в одну сторону: изображение становится частью ИИ-процесса, а не автономным аттракционом.

Для русскоязычного разработчика практический смысл простой. Если вы оцениваете image API, смотреть нужно уже не только на визуальный вкус модели. Смотрите на экономику единицы результата, на работу с reference images, на редактирование существующих изображений, на grounding и на то, сколько лишней логики придётся достраивать поверх API. В этой рамке запуск Uni-1.1 выглядит не как проходная новость про ещё один релиз, а как заявка Luma на место в коротком списке image API, которые вообще стоит тестировать.

Если нужен широкий прикладной маршрут по рынку, а не новостной разбор одной компании, дальше логично перейти в наш evergreen-материал Нейросеть для картинок бесплатно: сервисы с рабочими лимитами. Но конкретно эта новость не про «лучшие нейросети для картинок». Она про то, что Luma пытается превратить визуальное рассуждение и генерацию с опорой на референсы в товарный API для продакшена.

Источники и дата проверки

Факты в материале проверены 13 мая 2026 года по официальным страницам Luma: Introducing the Uni-1.1 API, Luma API pricing & setup, Luma Agents Models, Luma Agents Image generation, Luma Agents Pricing, OpenAI image generation API и Google Cloud Agent Platform Pricing.