Google Photos в Gemini: Nano Banana 2 получает личный контекст

Google добавляет в Gemini персональный контекст из Google Photos. Разбираем, что реально меняется, где работает функция и почему важна формулировка opt-in.

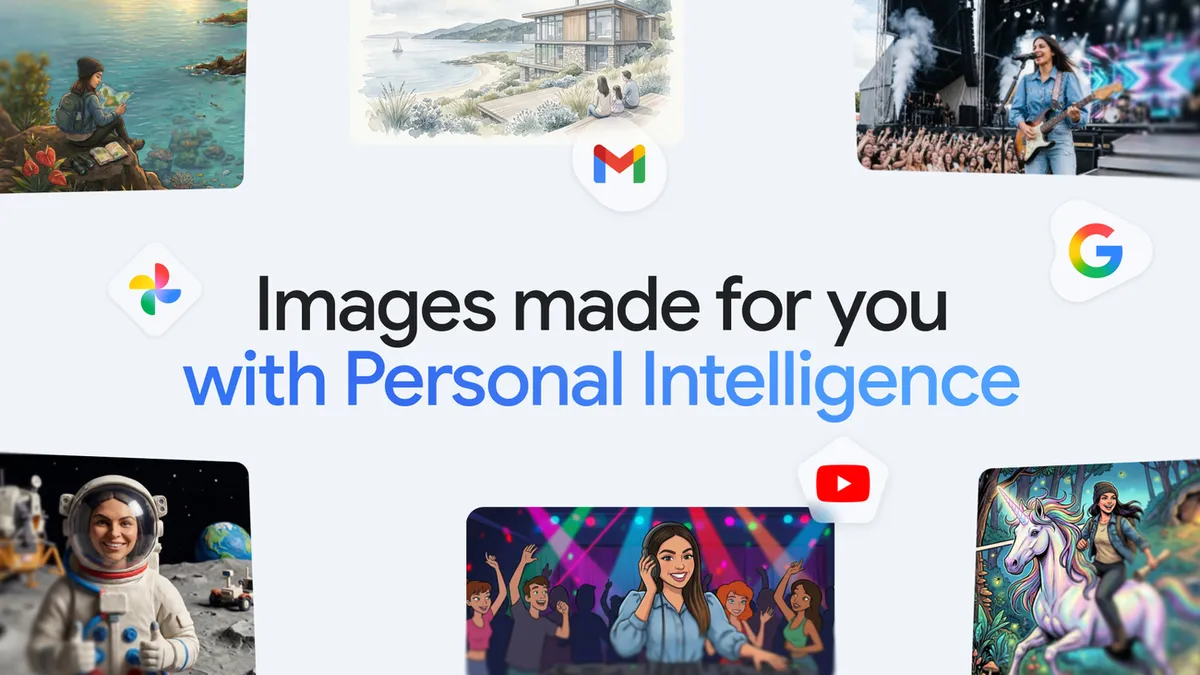

Google Photos в Gemini теперь становится частью генерации изображений. 16 апреля 2026 года Google объявила, что Gemini сможет использовать Personal Intelligence, Nano Banana 2 и подключённую библиотеку Google Photos, чтобы создавать более личные изображения без ручной загрузки референсов и длинных подсказок.

Главная деталь здесь не в том, что Gemini научился делать ещё одну красивую картинку. Google подводит генерацию к личному контексту: фотографии, подписи людей и питомцев, предпочтения из подключённых приложений. Поэтому эту новость стоит читать не как очередное обновление Google Gemini, а как шаг к ассистенту, который всё меньше ждёт подробной инструкции от пользователя.

По состоянию на 16 апреля 2026 года Google пишет о постепенном запуске в США для подходящих подписчиков Google AI Plus, Pro и Ultra. Глобальная доступность и запуск в России официально не подтверждены.

Что именно изменилось в Gemini

Раньше персональная генерация в Gemini требовала обычного набора действий: описать сцену, найти подходящее фото, загрузить его как референс, уточнить стиль. В новом сценарии Google хочет убрать часть этой ручной работы. Если пользователь уже подключил приложения Google, Gemini может брать личный контекст из этих источников при создании изображений.

В официальном анонсе Google приводит простые примеры: дизайн дома мечты, набор вещей для необитаемого острова, изображение пользователя и семьи в заданном стиле. Смысл не в конкретных сценах, а в том, что Nano Banana 2 получает больше исходного контекста до того, как пользователь распишет детали.

Это заметный сдвиг для рынка нейросетей для рисования. Конкуренция постепенно уходит от качества одной картинки к тому, насколько модель понимает пользователя: его лица, окружение, стиль, повторяющиеся предпочтения и ограничения. Для Google это естественное преимущество, потому что у компании уже есть Photos, Gmail, Search и Chrome.

Как Google Photos попадает в генерацию

Google описывает функцию как opt-in: пользователь сам подключает Google Photos к Personal Intelligence. После этого Gemini может использовать изображения людей и близких, а также уже существующие подписи людей и питомцев в библиотеке Photos. То есть модель не просто получает абстрактное описание вроде человек в красной куртке, а может опираться на конкретные визуальные референсы и метки.

Контроль тоже встроен в сценарий. Если результат не тот, можно уточнить подсказку или выбрать другой фото-референс из Google Photos. В Gemini также есть кнопка Sources: она показывает, какая картинка была автоматически выбрана как источник для генерации. Это хороший компромисс: персонализация становится удобнее, но пользователь хотя бы видит, на чём система основывала результат.

Отдельно стоит проговорить то, что легко превратить в кликбейт. Google не заявляет, что обучает Nano Banana 2 на частной фотобиблиотеке пользователя. В анонсе сказано аккуратнее: приложение Gemini не обучает модели напрямую на вашей личной библиотеке Google Photos. Для улучшения работы используются ограниченные данные вроде конкретных подсказок в Gemini и ответов модели. Это всё равно чувствительная зона, но формулировка важна.

Почему это не только про картинки

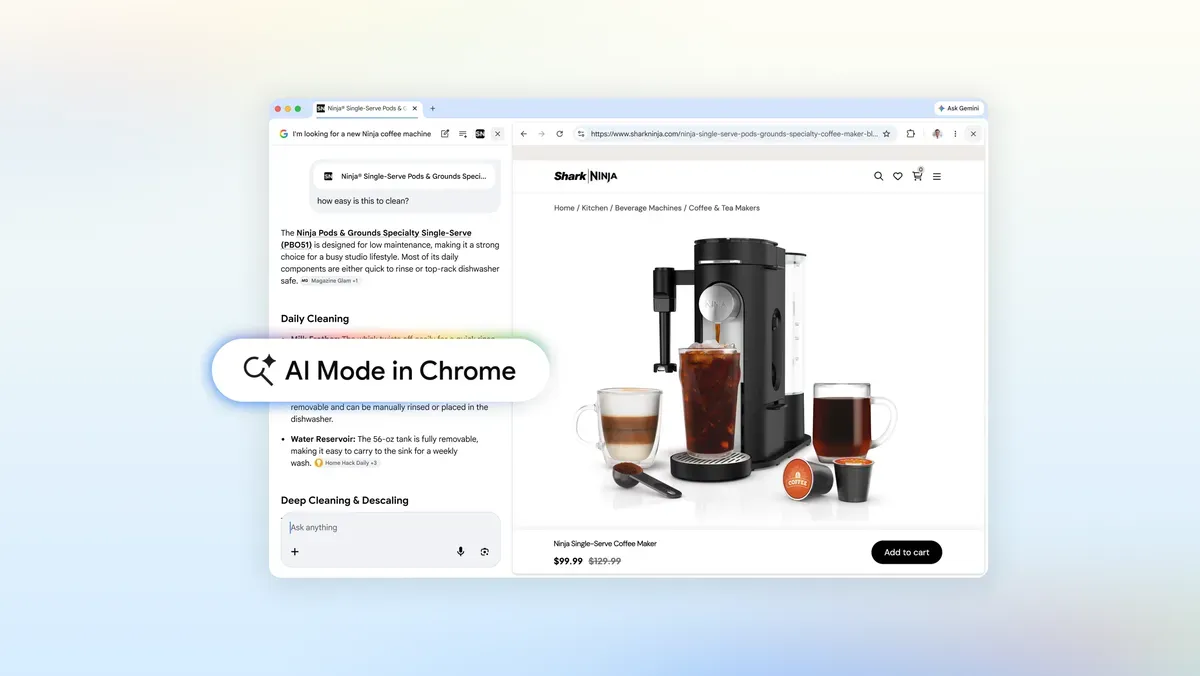

На той же неделе Google выпустила ещё один связанный анонс: AI Mode в Chrome теперь открывает страницу рядом с AI-панелью, чтобы пользователь мог смотреть сайт, задавать уточняющие вопросы и не терять контекст поиска. Плюс AI Mode научился брать в запрос несколько открытых вкладок, изображения и файлы, включая PDF.

Вместе эти две новости показывают один вектор. Google не просто добавляет функции в разные продукты. Компания собирает слой персонального контекста: в Gemini это фотографии и предпочтения для генерации изображений, в Search и Chrome — вкладки, страницы, Gmail, Photos и файлы. Для пользователя это удобнее. Для издателей и владельцев сайтов вопрос сложнее: если всё больше работы происходит внутри AI Mode, переходов на внешние страницы может стать меньше.

Именно поэтому здесь уместно вспомнить не только генерацию изображений, но и поисковые нейросети. Поиск перестаёт быть списком ссылок и становится диалогом с системой, которая знает контекст. Google делает то же самое, но с преимуществом доступа к собственным продуктам и браузеру.

Где граница пользы и риска

Пользовательская польза понятна. Меньше ручных загрузок. Меньше длинных подсказок. Больше шанс получить изображение, где человек, семья, питомец или стиль действительно похожи на нужный референс. Для бытовых сценариев вроде открытки, семейной картинки или визуализации идеи это удобно.

Риск тоже понятен. Фотобиблиотека — один из самых личных массивов данных у обычного пользователя. В ней лица, места, привычки, поездки, дети, домашние животные, иногда документы и медицинские кадры. Даже если функция opt-in и Google заявляет, что частная библиотека не используется напрямую для обучения модели, пользователю всё равно нужно понимать, какие приложения он подключает и где потом выключить доступ.

Для редакций, SEO-специалистов и продуктовых команд это ещё один сигнал. Персональные AI-интерфейсы будут съедать часть действий, которые раньше происходили на сайтах: поиск, сравнение, уточнение, выбор визуального референса. Значит, контенту придётся быть полезным не только для человека, который пришёл из выдачи, но и для AI-систем, которые пересобирают ответ поверх источников.

Что проверить перед использованием

Если функция появится в вашем аккаунте, не стоит включать её на автопилоте. Сначала проверьте три вещи: какой тариф Google AI у вас активен, в какой стране доступен запуск и какие приложения Google подключены к Personal Intelligence. Если вы работаете с корпоративным аккаунтом, обратите внимание на ограничение: Google отдельно пишет, что некоторые персональные функции AI Mode не предназначены для аккаунтов Google Workspace в бизнесе, компаниях и образовании.

Практическое правило простое. Для личных экспериментов с изображениями Google Photos в Gemini выглядит полезно. Для рабочих задач, клиентских данных и чужих фотографий — сначала политика компании, потом кнопка подключения. Иначе удобный сценарий быстро превращается в проблему с доступами и согласием людей на снимках.

Итог

В Google Photos в Gemini интересен не скачок качества картинок, а перенос генерации в личный контекст пользователя. Nano Banana 2 получает возможность работать не только с подсказкой, но и с тем, что Google уже знает из подключённых приложений.

Пока это ограниченный запуск для подписчиков Google AI Plus, Pro и Ultra в США. Но направление видно уже сейчас. Следующая конкуренция между AI-продуктами будет идти не только за качество модели, а за право быть тем интерфейсом, который знает ваш контекст лучше остальных.

Читайте также

- Gemini Google: полный обзор и сравнение с ChatGPT и Claude

- Нейросеть для рисования: топ-5 сервисов в 2026 году

- Perplexity AI: обзор поисковой нейросети