Открытые модели vs закрытые API: как выбирать в 2026 году

Практический разбор open-weight и закрытых API на май 2026 года: Llama 4, Qwen3, Gemma 3, Mistral, GPT-5.4, Claude Opus 4.7, Gemini 2.5 Pro и экономика выбора.

По состоянию на 5 мая 2026 года спор «открытые модели против закрытых» уже бесполезно вести как идеологию. Команда не выбирает между «свободой» и «корпорациями». Команда выбирает, где ей критичен собственный контур, где важнее скорость запуска, где выдержит экономика и где вообще нельзя тащить на себе отдельную эксплуатацию инференса.

Короткий вывод такой. Open-weight модели выигрывают там, где нужны контроль над данными, кастомизация, маршрутизация и понятная экономика на большом объёме. Закрытые API по-прежнему сильнее там, где нужен лучший сервисный слой вокруг модели: инструменты, мультимодальность, управляемый runtime, корпоративная обвязка и минимальная инфраструктурная боль. Ошибка начинается в тот момент, когда эти два класса продуктов сравнивают как будто это один и тот же товар.

Если вам нужен более широкий контекст по всему ландшафту моделей, начните с полного гайда по LLM для разработчиков. Если же вы уже сузили вопрос до decision-layer, держите рядом маршрут выбора языковой модели и разбор open-weight семейств, чтобы не смешивать семейства моделей с выбором ownership-модели.

Если нужен общий фон по сегодняшнему open-weight рынку, держите рядом и наш обзор Llama, Mistral и Qwen в 2026 году. Здесь угол жёстче: не перечислить модели, а помочь выбрать архитектурный класс решения.

Сначала разведите термины

В 2026 году под словом «открытая модель» обычно прячутся три разные сущности. Если не развести их заранее, дальше начинается каша из брендов, лицензий и неправильных выводов про цену.

| Категория | Что вы реально получаете | Главный плюс | Главный минус |

|---|---|---|---|

| Open-weight | Весы модели, локальный или свой серверный запуск, свой стек инференса | Контроль над данными, инфраструктурой и кастомизацией | Нужно самим обслуживать развёртывание, обновления и оценку качества |

| Гибрид | Та же или близкая модельная семья, но через управляемый API поставщика | Проще стартовать и считать пилот | Контроль ниже, а экономика всё равно завязана на вендора |

| Закрытый API | Полностью управляемый сервис с собственной продуктовой и tool-оболочкой | Самый быстрый запуск и минимум операционной работы | Зависимость от поставщика, политики доступа и его ценовой логики |

Поэтому формула «берём открытую модель вместо OpenAI» обычно слишком груба. На практике правильный вопрос звучит так: что держать локально, что отдавать во внешний API и где вообще не лезть в свой контур, пока команда не готова обслуживать его всерьёз.

Что у open-weight сегмента реально есть сейчас

Open-weight рынок уже давно не ограничен «малыми моделями для энтузиастов». У него есть длинный контекст, мультимодальность, MoE-архитектуры и зрелые runtime-пути через vLLM, Ollama, TGI, TensorRT-LLM и другие стеки. Но семейства отличаются не только качеством, а типом компромисса.

| Семейство | Что подтверждено официально | Почему это важно | На что смотреть осторожно |

|---|---|---|---|

| Llama 4 | Meta выпустила Scout и Maverick как native multimodal open-weight MoE-модели. У Scout 17B активных и 109B общих параметров с контекстом 10M; у Maverick 17B активных и 400B общих с контекстом 1M. | Это уже не «ещё одна текстовая модель», а база для длинного контекста, изображений на входе и локальных мультимодальных ассистентов. | Лицензия у Meta не permissive: это Llama 4 Community License, а не Apache 2.0. |

| Qwen3 | Qwen открыла две MoE-модели и шесть dense-моделей. Qwen3-235B-A22B и Qwen3-30B-A3B идут как open-weight, dense-линейка до 32B опубликована под Apache 2.0, для крупных моделей заявлен контекст 128K. | У Qwen очень широкий диапазон размеров: от реально переносимых dense-моделей до больших MoE-вариантов. | Нельзя переносить репутацию семейства на любой размер: 4B, 32B и 235B решают очень разные классы задач. |

| Gemma 3 | Google описывает Gemma 3 как семейство размеров 1B, 4B, 12B и 27B, с 128K контекста, поддержкой 140+ языков и function calling. | Это сильный переносимый вариант для команд, которым нужен открытый стек без захода в экстремально тяжёлые размеры. | Gemma удобна на одном ускорителе и на устройстве, но не заменяет флагманский закрытый API на любой тяжёлой задаче. |

| Mistral Large 3 | Mistral на текущей models page называет Large 3 open-weight флагманской мультимодальной и мультиязычной моделью: 41B active, 675B total, 256K context. | Это важный пример того, что у open-weight рынка есть не только компактные компромиссы, но и большие универсальные модели. | Нужно смотреть на конкретный релиз и задачу, а не на бренд Mistral вообще. |

У этой таблицы есть неудобный, но полезный вывод. Open-weight рынок уже нельзя описывать одной фразой «это для тех, кто хочет бесплатно». Где-то главным аргументом становится лицензия, где-то размер и железо, где-то зрелость runtime-а, а где-то возможность встроить модель в свой контур без внешнего API.

Где open-weight действительно выигрывает

Первый случай очевидный: данные нельзя выносить наружу. Внутренние документы, код, договоры, персональные данные, служебные отчёты, внутренние базы знаний. Здесь open-weight не «альтернатива похуже», а нормальный способ снизить юридический и операционный риск. Если задача живёт внутри компании, свой контур часто важнее лишних нескольких пунктов во внешнем benchmark chart.

Второй случай менее очевиден: стабильный и большой объём инференса. Когда трафик предсказуем, свой стек становится проще считать. Вы управляете пакетной обработкой, квантизацией, очередями, кэшем и самим рантаймом. Цена ошибки уже не сводится к прайсу за миллион токенов. Именно поэтому open-weight модели любят команды, которые думают не только о качестве, но и о себестоимости постоянного продакшна.

Третий случай — кастомизация. Иногда выигрывает не самая сильная модель вообще, а та, которую можно подогнать под свои документы, свой маршрутизатор запросов, свои системные правила и свои ограничения. Если вам нужен не «лучший чат», а прогнозируемый рабочий компонент, open-weight почти всегда даёт больше свободы.

Но свобода здесь платная. Её счёт приходит не токенами, а эксплуатацией. Нужно следить за деградацией после квантизации, памятью, обновлениями, задержкой и тем, как модель ведёт себя после смены версии. В пилоте это обычно недооценивают. Если вы ещё не понимаете, готовы ли к такому контуру, полезно сначала пройти наш гайд по выбору модели под задачу, бюджет и контур данных.

Где закрытые API всё ещё сильнее

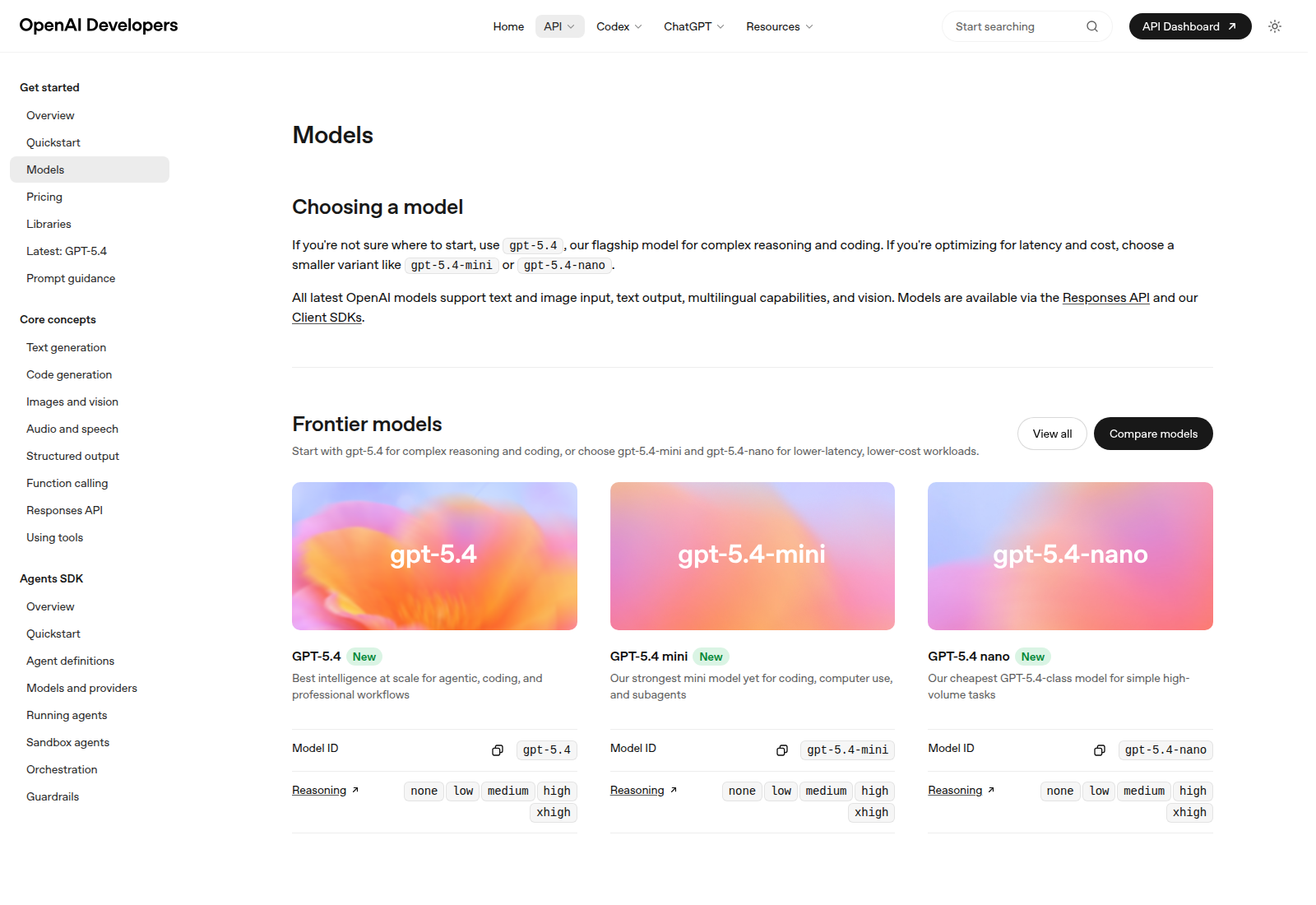

Закрытые API выигрывают там, где команда хочет максимум качества и функций без отдельной эксплуатации моделей. У OpenAI GPT-5.4 официально заявлены 1,050,000 токенов контекста, функция reasoning.effort и встроенные инструменты вроде web search, file search, computer use и hosted shell. Anthropic в актуальном models overview рекомендует начинать с Claude Opus 4.7 для самых сложных задач; у Opus 4.7 и Sonnet 4.6 по 1M token context window, а сам продуктовый слой Claude силён в коде, агентных сценариях и длинном контексте. У Gemini 2.5 Pro на Vertex AI Google указывает 1,048,576 входных токенов, grounding with Google Search и function calling.

Это важно не только для красивого сравнения флагманов. Закрытый API — это ещё и управляемый сервис: лимиты, встроенные инструменты, продуктовая оболочка, файловые потоки, логирование и готовые интеграции. Если у команды нет ресурса держать свой путь инференса, лучший open-weight чекпойнт всё равно проиграет более простому закрытому сервису по скорости внедрения.

Именно здесь многие команды ошибаются сильнее всего. Они видят, что open-weight модели «почти догнали» закрытые по отдельным тестам, и забывают про сервисный слой. В продакшне побеждает не только интеллект модели, но и то, насколько легко её безопасно запускать, обновлять и встраивать в рабочий контур.

Деньги: не путайте цену токена и стоимость системы

Для открытых моделей нет одной честной строки «цена за миллион токенов». Если вы крутите модель сами, вы платите GPU, хранением, сетью, простоями, человеком-часами и риском неудачного обновления. Поэтому полезнее сравнивать не «open против closed по одной цифре», а representative API-маркеры рынка, которые показывают текущую границу ожиданий.

| Модель / сервис | Цена входа | Цена выхода | Контекст | Что это показывает |

|---|---|---|---|---|

| DeepSeek-V4-Flash | $0.14 за 1 млн при cache miss, $0.028 при cache hit | $0.28 за 1 млн | 1M | Гибридный рынок жёстко давит на ценовые ожидания даже без полного отказа от управляемого API |

| GPT-5.4 | $2.50 за 1 млн | $15 за 1 млн | 1.05M | Закрытый флагман берёт не только качеством, но и сервисным стеком вокруг модели |

| Claude Opus 4.7 | $5 за 1 млн | $25 за 1 млн | 1M | Премия за сильный агентный и кодовый слой в верхнем сегменте |

Эта таблица не доказывает, что DeepSeek «лучше OpenAI» или что свой контур автоматически дешевле. Она показывает другое: рынок больше не живёт в мире, где дорогой закрытый API — единственный путь к сильной модели. Но обратное тоже верно: дешёвый токен сам по себе не делает систему дешёвой, если вам всё равно нужно держать команду, железо и поддержку вокруг модели.

Лицензия решает раньше, чем бенчмарк

Лицензии редко любят обсуждать до тех пор, пока юристы не остановили проект в самый неудобный момент. Но именно лицензия часто первой отсекает половину «идеальных» вариантов.

Qwen прямо пишет, что dense-модели Qwen3 опубликованы под Apache 2.0. У Llama 4 другая история: Meta указывает отдельный Llama 4 Community License. Это не делает Llama плохим выбором. Это означает лишь то, что у неё другой организационный профиль риска. Если вам нужен максимально простой permissive-контур, одни семейства отпадут раньше, чем вы вообще дойдёте до сравнительных тестов.

Полезное правило здесь очень простое: сначала лицензия и требования бизнеса, потом benchmark charts. Не наоборот.

Как выбирать в пяти типовых сценариях

| Сценарий | С чего начинать | Почему |

|---|---|---|

| Внутренние документы, код, чувствительные данные | Open-weight или локальный контур | Контроль над данными и инфраструктурой здесь важнее удобства внешнего API |

| Новый продукт, спрос пока неясен | Закрытый API | Быстрее проверить гипотезу и не покупать отдельную эксплуатацию моделей до появления реального трафика |

| Высокий и стабильный объём инференса | Open-weight или гибрид | Появляется шанс выиграть экономику за счёт своей инфраструктуры и маршрутизации |

| Команда без опыта эксплуатации моделей | Закрытый API | Иначе вы купите себе не модель, а новый операционный долг |

| Нужен российский контур и понятная работа с локальными ограничениями доступа | Локальный стек, гибрид или локальные игроки | Здесь уже важны не только модель и цена, но и доступность сервиса, комплаенс и то, что можно реально поддерживать внутри страны |

Если вам нужен не спор про бренды, а практический старт, сначала соберите свои 20-30 реальных примеров. Потом прогоните на них один open-weight вариант и один закрытый API. Для локального контура удобно отталкиваться от наших материалов про Ollama и локальный запуск, а для российского слоя ограничений — от разбора что реально доступно российским компаниям. Сравнивайте не маркетинг, а качество на своих данных, цену одной полезной итерации и объём инфраструктурной боли.

Итог

В 2026 году вопрос звучит уже не как «догнали ли открытые модели закрытые». Догнали в чём именно? В длинном контексте — часто да. В мультимодальности — местами да. В цене управляемого API — рынок уже очень агрессивен. Но закрытые сервисы по-прежнему выигрывают там, где вам нужен зрелый tool-слой, быстрый запуск и минимальная операционная нагрузка.

Поэтому лучший выбор редко выглядит как вечная ставка на один лагерь. Обычно это архитектурное решение: что держать локально, что выносить во внешний API, где нужен permissive-лицензионный режим, а где можно принять ограничения ради зрелого сервиса. Если решать вопрос в таком порядке, open-weight перестаёт быть идеологией и становится обычным инженерным инструментом.

Источники и дата проверки

Факты о Llama 4, Qwen3, Gemma 3, Mistral, DeepSeek, GPT-5.4, Claude Opus 4.7 и Gemini 2.5 Pro перепроверены 5 мая 2026 года по официальным страницам вендоров и официальной документации.

- Meta Llama 4 Scout model card

- Meta: The Llama 4 herd

- Qwen3 official announcement

- Google: Gemma 3

- Mistral models page

- DeepSeek API Docs: Models & Pricing

- OpenAI API Docs: GPT-5.4

- OpenAI API pricing

- Anthropic: Pricing

- Anthropic: Models overview

- Google Cloud: Gemini 2.5 Pro

- Google Cloud: Grounding API