ИИ для российских компаний: что реально доступно в 2026 году

Разбираем три рабочих маршрута для российского бизнеса: Yandex AI Studio, GigaChat API и self-hosted стек на open-weight моделях.

Проверено 3 мая 2026 года. Для российской компании вопрос обычно звучит не так: «какая LLM сильнее на бенчмарке?», а так: «какой стек можно официально купить, интегрировать и сопровождать без хрупких обходных схем». В 2026 году это уже не академический спор. Выбор между локальными API, open-weight моделями и зарубежными закрытыми сервисами напрямую влияет на доступ, биллинг, комплаенс и устойчивость продукта.

Практически у российского бизнеса сейчас есть три реальных маршрута: российские управляемые API, self-hosted стек на open-weight моделях и зарубежные закрытые сервисы, где Россия не входит в официальный контур поддержки. Ниже разберёмся без серого фольклора и устаревших таблиц.

Где проблема на самом деле

Главная ошибка в таких обзорах — смешивать в одну корзину публичный чат, API, облачную платформу и локально развёрнутую модель. Для компании это четыре разных продукта с разными рисками.

- OpenAI API и Claude остаются технологическим ориентиром, но не опорой для российского корпоративного контура.

- Yandex AI Studio и GigaChat API — это официальный локальный маршрут с документацией, рублёвым биллингом и понятным договорным контуром.

- Open-weight модели вроде Llama 4 и Qwen3 дают независимость, но требуют своей инфраструктуры.

По состоянию на 3 мая 2026 года OpenAI прямо пишет, что API поддерживается только в странах и территориях из опубликованного списка, а если локации в списке нет, сервис не поддерживается. У Anthropic та же логика: Claude доступен только в перечисленных странах. Россия в этих списках не указана. Это вывод из официальных списков поддерживаемых стран, а не из «пользовательских наблюдений».

Практический вывод для бизнеса простой: зарубежные закрытые API можно держать как исследовательский ориентир, но не как фундамент production-контура, если вам нужны предсказуемые доступ, оплата и сопровождение.

Три рабочих маршрута для российской компании

| Маршрут | Что даёт | Где силён | Главное ограничение |

|---|---|---|---|

| Yandex AI Studio | Официальный API, рублёвый прайс, OpenAI-compatible интерфейс | Быстрый запуск, русскоязычные сценарии, интеграция в локальный облачный контур | Контекст 32k у актуальной текстовой линейки и более скромный tool-use, чем у западных лидеров |

| GigaChat API | Российский API с пакетами и pay-as-you-go, 128k контекстом у GigaChat 2 | Суммаризация, переписывание, внутренние ассистенты, FAQ и документные сценарии | Нужна аккуратная настройка потоков, ограничений и модельного роутинга под задачу |

| Open-weight стек | Свой периметр, свой роутинг, свои лимиты и выбор модели | Чувствительные данные, RAG, внутренние продукты, независимость от внешнего API | Потребуются инфраструктура, GPU и команда, которая умеет это поддерживать |

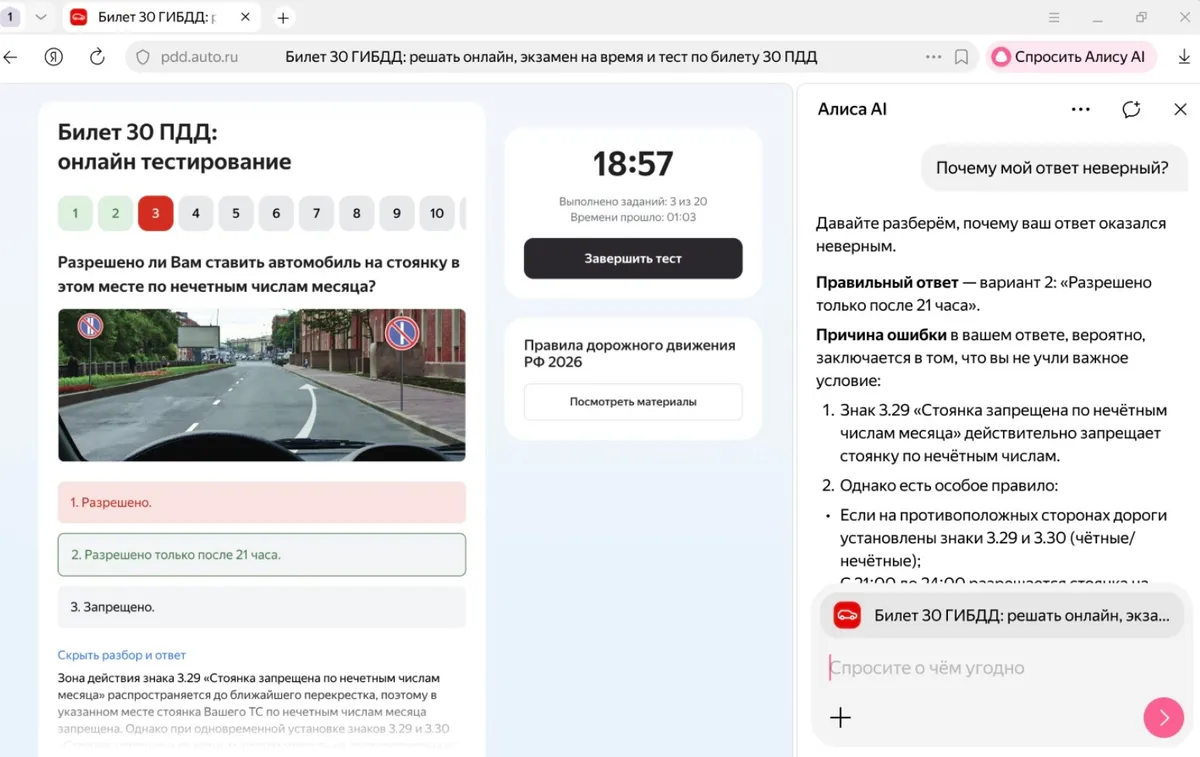

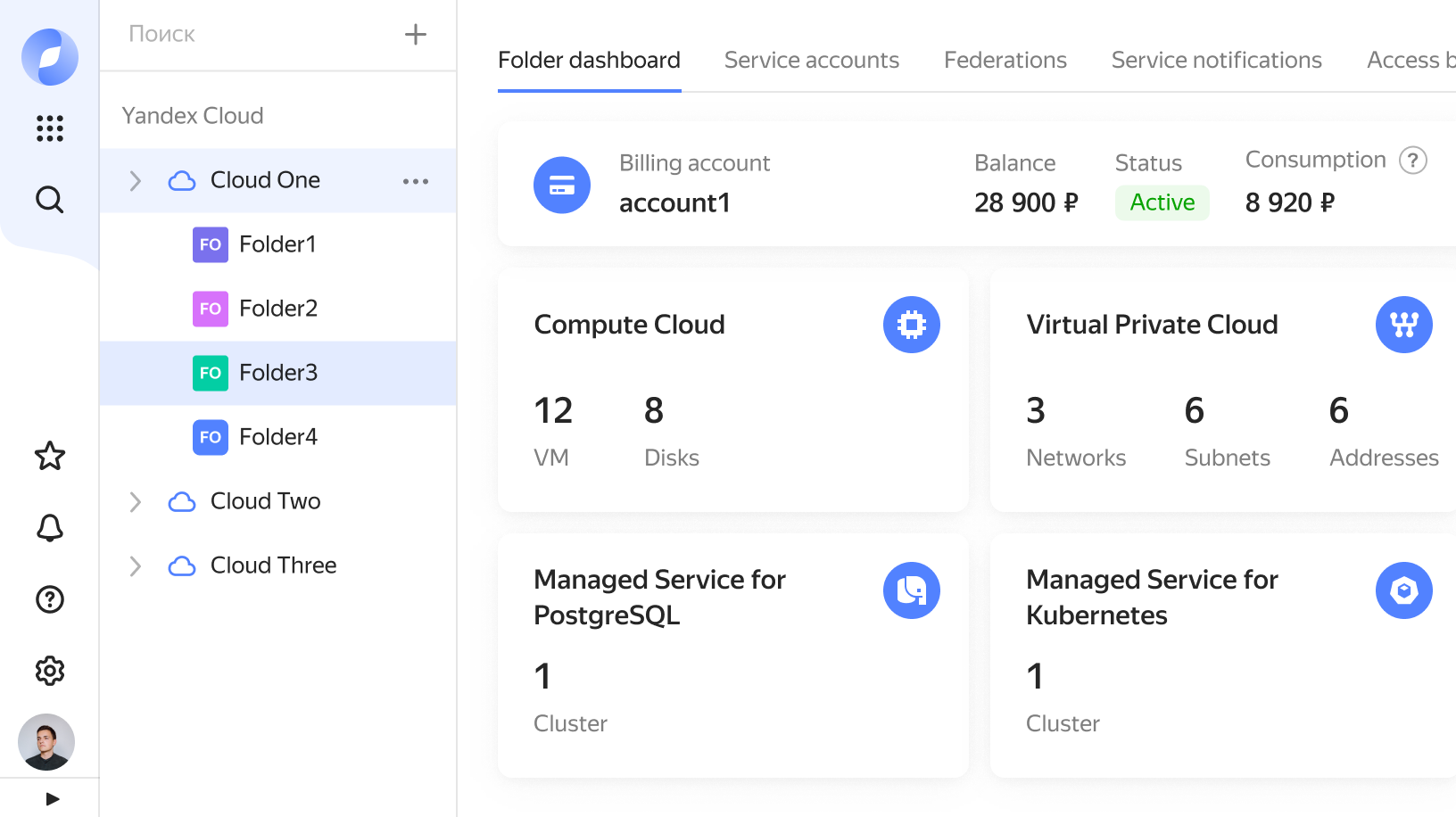

Yandex AI Studio: когда нужен официальный API в рублях

Если компании нужен официальный и быстро внедряемый маршрут, Yandex AI Studio сегодня выглядит самым прямым вариантом. В общей инстанции Yandex AI Studio доступны Alice AI LLM, YandexGPT Pro 5.1, YandexGPT Pro 5 и YandexGPT Lite 5. Для всей этой текстовой линейки в документации указан контекст 32 768 токенов и два интерфейса доступа: обычный text generation API и OpenAI-compatible API.

Ценообразование у Яндекса тоже достаточно прозрачное. На рублёвой странице AI Studio в синхронном режиме указано, что YandexGPT Pro 5.1 стоит 0,8 ₽ за 1000 входящих токенов и 0,8 ₽ за 1000 исходящих, а YandexGPT Lite — 0,2 ₽ и 0,2 ₽. Для бизнеса это удобнее, чем разбирать англоязычные прайс-листы по нескольким сущностям сразу.

Есть и важный операционный нюанс, который часто пропускают. В документации AI Studio сказано, что при включённом логировании запросы хранятся анонимизированно, а чувствительные данные маскируются, но при обработке чувствительной информации Яндекс рекомендует логирование отключать. Для компании это не мелкая настройка, а часть базовой политики безопасности.

Когда выбирать Yandex AI Studio: если вам нужен официальный API, рублёвый биллинг, русскоязычный сценарий и быстрый пилот без собственной GPU-инфраструктуры. Для многих команд սա самый рациональный «первый слой», особенно если задача сводится к суммаризации, классификации, внутреннему помощнику или продуктовой генерации текста.

Если вам важен отдельный выбор между локальным и западным стеком на русскоязычных задачах, у нас уже есть отдельное сравнение YandexGPT и ChatGPT.

GigaChat API: когда важен российский вендор и больший контекст

У Сбера сейчас актуальна линейка GigaChat 2 Lite, GigaChat 2 Pro и GigaChat 2 Max. В разделе обновлений моделей для второго поколения указано, что все три версии работают с контекстом 128 тыс. токенов. Это уже другой класс задач: длинные документы, разбор больших контекстов, внутренние базы знаний и многошаговое переписывание.

В гайде по выбору модели Сбер отдельно отмечает, что GigaChat-2-Pro лучше следует сложным инструкциям и заметно сильнее в суммаризации, переписывании и редактировании текстов, чем базовая версия. Это хороший сигнал для редакторских, knowledge-base и support-сценариев, где нужен не только «ответ на вопрос», но и аккуратное следование формату.

По деньгам GigaChat тоже выглядит предсказуемо. Для юридических лиц и ИП у API есть пакеты и схема pay-as-you-go. В синхронном режиме минимального базового тарифа сейчас указаны 0,065 ₽ за 1000 токенов для GigaChat 2 Lite, 0,5 ₽ для GigaChat 2 Pro и 0,65 ₽ для GigaChat 2 Max. Отдельно в разделе ограничений зафиксировано, что юрлицам и ИП по умолчанию доступно 10 потоков.

Когда выбирать GigaChat: если компании нужен официальный российский API с более длинным контекстом и понятной градацией Lite/Pro/Max, а сценарий связан с документами, внутренними ассистентами, FAQ, поддержкой и переписыванием текстов под бизнес-процесс.

Open-weight маршрут: когда важен свой периметр

Для части компаний лучший ответ вообще не лежит в плоскости «какой API купить». Если данные чувствительные, если нужен полный контроль над маршрутизацией или если компания строит внутреннюю AI-платформу, логичнее сразу смотреть на open-weight стек. В библиотеке Ollama сейчас доступны, например, Llama 4 и Qwen3, а для production-serving разумнее смотреть на vLLM, который сам проект описывает как fast and easy-to-use library for LLM inference and serving и поддерживает OpenAI-compatible server.

На практике это означает три уровня зрелости:

- Пилот и внутренний тест — Ollama и локальная модель на своей машине или сервере.

- Командный контур — одна или несколько open-weight моделей на выделенном сервере с базовым мониторингом и RAG.

- Production-платформа — vLLM, централизованный роутинг, отдельные политики безопасности и инфраструктура под конкретные сценарии.

У этого пути нет магии. Он требует GPU, инженерной дисциплины и ответственности за обновления. Но именно он даёт то, чего не дают управляемые API: собственный периметр, независимость от географии поддержки и возможность выбирать модель под конкретный сценарий, а не под маркетинговый баннер вендора.

Подробнее про выбор между локальными и закрытыми моделями мы отдельно разбирали в материалах «Открытые модели vs закрытые API» и про Llama, Mistral и Qwen.

Как выбирать без самообмана

Для практики полезно отказаться от вопроса «какая модель лучше вообще» и заменить его на четыре более жёстких вопроса:

- Нужен ли вам официальный доступ именно из российского контура? Если да, shortlist резко сужается до локальных API и self-hosted стека.

- Где будут жить данные? Если нельзя выпускать внутренние документы во внешний API, open-weight маршрут становится не экзотикой, а базовым вариантом.

- Есть ли у команды инфраструктурная зрелость? Если нет, лучше брать Yandex AI Studio или GigaChat, а не делать вид, что self-hosted «как-нибудь взлетит».

- Что дороже: токены или операционная сложность? У managed API выше зависимость от вендора, у self-hosted выше стоимость сопровождения. Сравнивать нужно не только цену токена.

Итог

Для российского бизнеса в 2026 году нет единственного «правильного» ответа, но есть плохой ответ: строить критичный контур на сервисе, где у вас нет официальной географической поддержки. Если нужен быстрый и официальный старт, смотрите в сторону Yandex AI Studio. Если нужен российский API с длинным контекстом и более выраженным корпоративным профилем, берите GigaChat API. Если нужны свой периметр и независимость от внешнего доступа, стройте open-weight стек.

Главное — выбирать не по глобальному хайпу вокруг LLM, а по тому, какой маршрут выдержит ваш реальный продукт, ваши данные и вашу операционную модель через полгода, а не до конца демо-недели.