Госданные для нейросетей: зачем проекту закона нужно разрешение ФСБ

Госданные для нейросетей могут открыть только через согласование с ФСБ и ФСТЭК. Разбираем, как это меняет правила для российских LLM и доверенных моделей.

Проверено 5 мая 2026 года. В новой версии проекта закона об ИИ в России национальным и суверенным моделям хотят открыть доступ к государственным данным. Но это не история про то, что разработчикам просто дадут ещё один большой датасет. По сообщениям CNews и «Коммерсанта», доступ предлагают пропускать через согласование с ФСБ и ФСТЭК, а статус доверенной модели жёстче привязать к государственному реестру.

Главная новость здесь не в слове «госданные» само по себе. Главная новость в том, что государство одновременно обещает больше сырья для обучения отечественных моделей и строит более жёсткий контур допуска к этому сырью. Для российского AI-рынка это может оказаться важнее любого нового бенчмарка: сильные модели упираются не только в GPU, но и в доступ к качественным данным, особенно в чувствительных секторах.

При этом важно не перепутать стадии документа. По состоянию на 5 мая 2026 года речь идёт не о принятом законе, а о дорабатываемой версии проекта. Само Минцифры, по данным «Коммерсанта», прямо говорит, что о финальной редакции и конкретных параметрах пока преждевременно говорить как о решённом вопросе.

Что именно сейчас предлагают изменить

Если собрать вместе сообщения CNews и «Коммерсанта» за 5 мая, получается четыре опорных пункта. Во-первых, национальным и суверенным моделям хотят разрешить обучение на государственных данных. Во-вторых, доступ к таким массивам планируют увязать с согласованием со стороны ФСБ и ФСТЭК. В-третьих, статус доверенной модели хотят жёстче привязать к включению в отдельный реестр. В-четвёртых, правительство сможет определять случаи обязательного применения суверенных и национальных моделей в банковской сфере по согласованию с ЦБ.

У этого набора есть важная деталь: он меняет не только правила обучения, но и правила входа в чувствительные сегменты рынка. Если контур доступа к данным и реестр доверенных моделей реально станут рабочим фильтром для КИИ, госинформсистем и банковских кейсов, преимущество получат не все разработчики, а те, кто сможет пройти через новый режим согласований и проверок.

| Что уже подтверждено | Откуда это известно | Что пока остаётся открытым |

|---|---|---|

| В мартовском публичном проекте уже есть реестр доверенных моделей ИИ. | Текст проекта закона от 18 марта 2026 года. | Финальные критерии включения в реестр ещё не опубликованы. |

| В майской доработке фигурирует обучение на госданных после согласования с ФСБ и ФСТЭК. | CNews и «Коммерсант», 5 мая 2026 года. | Не опубликован окончательный механизм, по которому именно будет выдаваться такой доступ. |

| Минцифры подтверждает, что документ ещё дорабатывается с отраслью и ведомствами. | Комментарий министерства «Коммерсанту». | Неясно, какие формулировки сохранятся в финальной версии без изменений. |

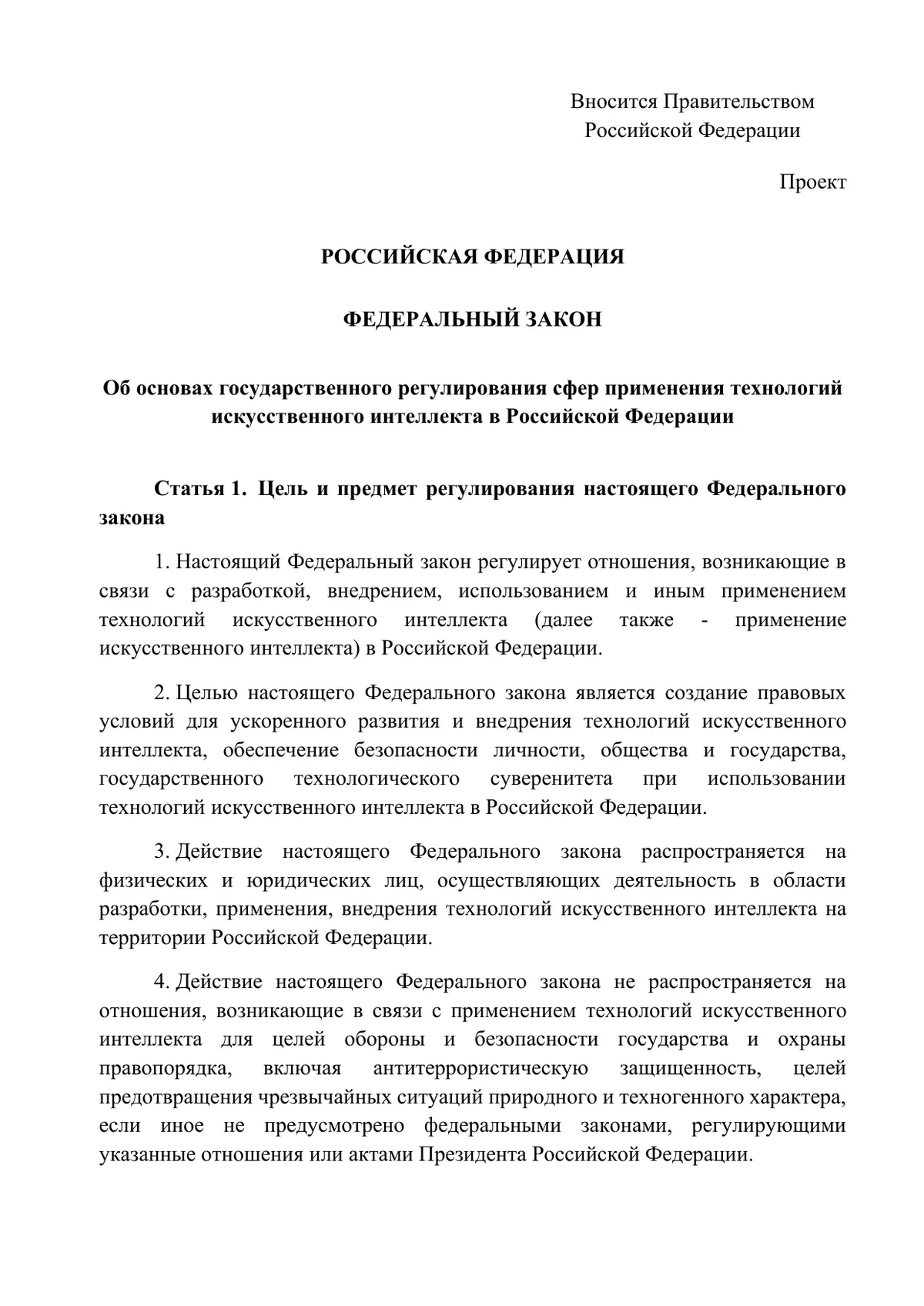

Что в публичном проекте закона уже было до майской правки

Это важный момент, который легко потерять на фоне громкого заголовка про ФСБ. Публичный проект закона от 18 марта 2026 года уже описывает реестр доверенных моделей ИИ и уже связывает его с государственным контуром. В статье 8 прямо сказано, что к применению в государственных информационных системах и на значимых объектах критической информационной инфраструктуры допускаются только модели, включённые в реестр доверенных моделей искусственного интеллекта.

То есть майский сюжет не про внезапное изобретение доверенных моделей с нуля. Он скорее про следующий шаг: государство начинает описывать не только то, где такие модели должны применяться, но и как может выглядеть режим доступа к данным для их обучения.

В той же статье 8 есть ещё более жёсткие пункты. Для доверенной модели проект уже требует подтверждения соответствия требованиям по безопасности, обработки данных исключительно на территории России и подтверждения соответствия требованиям качества. Отдельно прописано, что при взаимодействии таких систем с государственными информационными системами и объектами КИИ должна обеспечиваться защита информации по требованиям уполномоченных органов.

Именно поэтому майская новость выглядит не как локальная правка, а как часть более широкой логики. Сначала государство строит категорию доверенной модели. Затем привязывает её к ГИС и КИИ. Теперь начинает подводить к этому же контуру и доступ к государственным данным.

Почему государственные данные здесь важнее, чем кажется

Разговор об ИИ в России часто сводят к вычислительным мощностям: где взять GPU, кто построит ЦОД, как не проиграть американским и китайским лабораториям по масштабу инфраструктуры. Это реальная проблема, но не единственная. Для сильных LLM и прикладных моделей не менее важен другой ресурс: доступ к большим, качественным и юридически пригодным массивам данных.

Если государство действительно начнёт открывать такие данные не в общем режиме, а через доверенный контур, это создаст новую рыночную развилку. Побеждать будут не только те, у кого есть железо, но и те, кто сумеет встроиться в регуляторный контур вокруг данных, безопасности и допуска к чувствительным секторам.

Здесь стоит помнить и про уже существующий локальный стек. У Toolarium есть отдельный разбор, что реально доступно российским компаниям в 2026 году, и отдельный обзор YandexGPT. Если правила вокруг госданных действительно сдвинутся, выигрыш получат не абстрактные «нейросети вообще», а конкретные игроки, которые уже строят российский LLM-контур и могут претендовать на доверенный статус.

Кто может выиграть, а кто получит новый барьер

Для крупных российских компаний, облачных провайдеров и подрядчиков, уже работающих в тесной связке с государством, такая архитектура может стать преимуществом. Если у тебя есть инфраструктура, юридический контур, ресурсы на сертификацию и доступ к длинному циклу согласований, новый режим выглядит как фильтр против более слабых или менее встроенных конкурентов.

Для независимых команд и средних разработчиков картина обратная. Даже если у них есть сильная инженерная команда или удачная прикладная модель, доступ к данным и право работать в чувствительных сценариях могут оказаться завязаны не только на качество продукта, но и на способность пройти формальные и силовые процедуры. Это уже не просто рынок моделей. Это рынок допуска.

Отсюда и нервная реакция отрасли в публикациях «Коммерсанта». Бизнес боится не самого слова «регулирование», а того, что получение данных для обучения может стать ещё одним узким горлышком. Если критерии останутся расплывчатыми, а механизм согласования окажется длинным и дорогим, новые правила будут усиливать крупнейших игроков быстрее, чем весь рынок в целом.

Почему это не российский AI Act

Есть соблазн быстро назвать эту историю «русским AI Act», но это грубое упрощение. Европейский AI Act построен вокруг риск-классов, ролей provider и deployer, прозрачности и compliance-обязанностей для разных типов систем. Российский проект, по крайней мере в том виде, который публично обсуждается весной 2026 года, выглядит иначе: его нерв — это технологический суверенитет, безопасность, доверенный контур и правила доступа к данным и критическим системам.

Если нужен именно европейский ориентир, у нас есть отдельный материал об AI Act в ЕС. Важный контраст простой: в Европе обсуждают, как классифицировать риск и кто несёт ответственность за вывод системы на рынок. В российском случае всё заметнее крутится вокруг того, кто получает доступ к данным, кто проходит в доверенный реестр и где государство готово делать применение отечественных моделей обязательным.

Что пока нельзя утверждать

- Нельзя писать, что закон уже принят. По состоянию на 5 мая 2026 года речь идёт о дорабатываемом проекте.

- Нельзя утверждать, что доступ к любым госданным уже открыт всем российским разработчикам. Публично обсуждается ровно обратное: доступ через отдельный контур согласований.

- Нельзя утверждать, что каждая ИИ-модель в России теперь должна получать разрешение ФСБ. Пока обсуждается контур для национальных и суверенных моделей и чувствительных сценариев применения.

- Нельзя выдавать реестр доверенных моделей за полностью оформленный и запущенный механизм. Даже Минцифры говорит, что критерии ещё будут определяться отдельными актами.

Вывод

История про госданные для нейросетей на самом деле не про открытость, а про селективный доступ. Государство показывает готовность дать отечественным моделям более ценные источники данных, но одновременно поднимает планку входа в этот режим через безопасность, доверенный статус и согласование с силовыми и техническими ведомствами.

Для рынка это означает сдвиг от простой гонки моделей к гонке за право работать с чувствительными данными и секторами. Если документ примут в логике, которую сейчас описывают CNews и «Коммерсант», выиграют не те, у кого просто лучше чат-интерфейс, а те, кто встроится в новый контур допуска быстрее других.

Читайте также:

- ИИ для российских компаний: что реально доступно в 2026 году

- YandexGPT: обзор моделей, цен и сценариев в 2026 году

- AI Act в ЕС: что нужно знать разработчикам и компаниям

Источники

- Публичный проект федерального закона об ИИ от 18 марта 2026 года

- CNews: Российские госданные откроют для нейросетей. Но только с разрешения ФСБ

- Коммерсант: Модель ИИ-поведения

- Коммерсант: Нейросети будут обучать на госданных после одобрения ФСБ

- Правительство России: Дмитрий Григоренко: В России выстроена единая система взаимодействия органов власти по развитию искусственного интеллекта

- Правительство России: Подкомиссия по развитию и внедрению технологий искусственного интеллекта