Qwen: обзор языковой модели от Alibaba

Модели Qwen от Alibaba: от Qwen 2.5 до Qwen 3.5, сравнение с GPT-4 и Claude, как попробовать бесплатно и запустить локально.

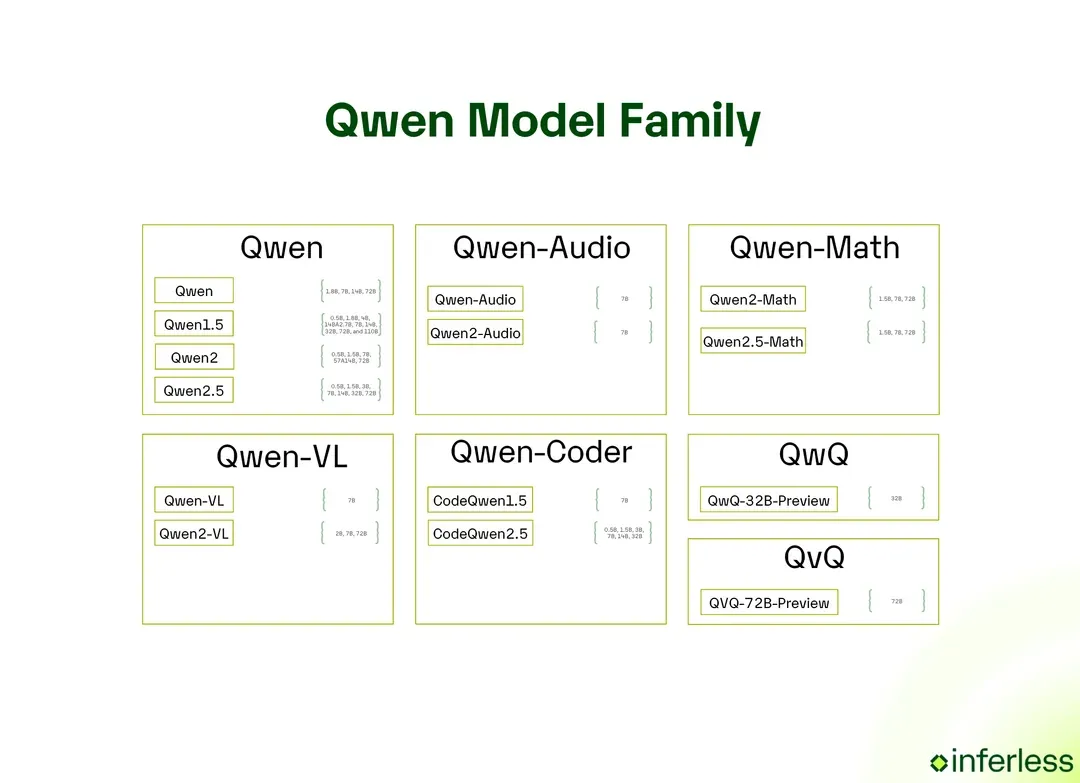

Qwen — семейство языковых моделей от Alibaba Cloud, которое за два года выросло из малоизвестного китайского проекта в серьёзного конкурента GPT-4 и Claude. По состоянию на март 2026 года линейка включает десятки моделей: от компактных на 0,5 миллиарда параметров до гигантов с 480 миллиардами. В этой статье — что из себя представляют модели Qwen, чем отличаются друг от друга и как их попробовать.

Что такое Qwen и кто его разрабатывает

Qwen (сокращение от Qianwen, «тысяча вопросов» на китайском) — проект команды Alibaba Cloud. Первую версию выпустили в августе 2023 года, а к 2026-му Qwen стал одним из крупнейших open-source семейств LLM в мире.

Главное отличие от конкурентов — ставка на открытый код. Большинство моделей Qwen распространяются под лицензией Apache 2.0: их можно скачать, запустить локально, дообучить под свои задачи. Для компаний, которым критична приватность данных или контроль над инфраструктурой, это серьёзный плюс.

Qwen поддерживает более 100 языков, включая русский. На русском модель неплохо справляется с суммаризацией, ответами на вопросы и генерацией текста, хотя качество пока уступает английскому и китайскому.

Модельный ряд Qwen в 2026 году

Актуальные поколения и модели на март 2026 года.

Qwen 2.5

Семейство Qwen 2.5 вышло в сентябре 2024 года и заметно подняло планку. Модели обучены на датасете объёмом до 18 триллионов токенов и доступны в размерах от 0,5B до 72B параметров.

Основные варианты:

- Qwen 2.5 — базовые языковые модели для работы с текстом

- Qwen 2.5-Coder — модели для кода, обученные на 5,5 триллиона токенов

- Qwen 2.5-VL — мультимодальные модели, понимающие изображения и видео

- Qwen 2.5-Max — флагман, набирающий 90% на HumanEval (тест на генерацию кода)

Модели 2.5 остаются основным выбором для локального запуска через Ollama или vLLM — они компактные и хорошо оптимизированные.

Если вам нужен не только бренд Qwen, а выбор всего open-source слоя, держите рядом обзор open-source моделей Llama, Mistral и Qwen и практический материал о том, когда локальную LLM действительно стоит запускать через Ollama.

Qwen 3 и архитектура Mixture-of-Experts

Третье поколение перешло на архитектуру MoE (Mixture-of-Experts): при каждом запросе активируется только часть параметров. Это позволяет строить огромные модели без пропорционального роста вычислительных затрат.

Основные модели:

- Qwen3-235B-A22B — флагман. 235 миллиардов параметров, из которых при запросе работают 22 миллиарда. Умеет переключаться между режимом «размышления» (thinking mode) для сложных задач и обычным режимом для быстрого диалога

- Qwen3-Coder-480B-A35B — модель для программирования с контекстным окном до 1 миллиона токенов. На бенчмарках показывает результаты на уровне Claude Sonnet 4

- QwQ-32B — компактная модель для рассуждений на 32 миллиарда параметров. Конкурирует с DeepSeek-R1 и OpenAI o1-mini по качеству математических и логических задач, при этом её реально запустить на потребительском железе

Qwen 3.5

В феврале 2026 года вышла Qwen 3.5-397B-A17B — нативная мультимодальная модель. Она работает с текстом, изображениями, аудио и видео без отдельных адаптеров. На бенчмарках Qwen 3.5 конкурирует с GPT-5.2 и Claude Opus 4.5 в задачах рассуждения, кодинга и агентных сценариев.

На момент написания статьи Alibaba готовит Qwen3.5-Max-Preview — более мощный вариант, уже доступный для тестирования на Arena.

Qwen против GPT-4 и Claude: сравнение

Результаты зависят от конкретного бенчмарка и задачи, но общая картина складывается так.

В кодинге Qwen3-Coder-480B показывает результаты на уровне Claude Sonnet 4, а Qwen 2.5-Max набирает 90% на HumanEval. Для open-source модели это сильно, хотя на реальных задачах проприетарные модели пока чаще выигрывают за счёт лучшего следования инструкциям.

В рассуждениях QwQ-32B конкурирует с GPT-4o на мультиязычных бенчмарках. Qwen3-Max-Thinking, по данным Alibaba, опережает Claude Opus 4.5 и GPT-5.2 на ряде тестов, хотя независимых подтверждений пока мало.

По стоимости разрыв огромный. QwQ-32B через API обходится в /bin/bash,15 за миллион входных токенов и /bin/bash,58 за миллион выходных. GPT-4 стоит 0 и 0 соответственно. Разница в десятки раз, что делает Qwen привлекательным для проектов с большим объёмом запросов.

На русском языке Qwen работает лучше большинства open-source моделей, но уступает GPT-4 и Claude по стилистике и пониманию культурного контекста.

Подробнее о конкурентах — в наших обзорах Grok от xAI и Character AI.

Как попробовать Qwen

Чат на qwen.ai — самый быстрый способ. Заходите на qwen.ai и начинаете переписку. Бесплатно, без регистрации. Там же доступны генерация изображений, Deep Research (аналог Perplexity), создание веб-страниц и режим размышления.

API через Alibaba Cloud подойдёт разработчикам. Формат совместим с OpenAI API. Регистрация на Alibaba Cloud Model Studio даёт 90-дневный бесплатный триал. API-ключ создаётся в разделе Key Management.

Локальный запуск через Ollama — вариант для тех, кто хочет полный контроль. Компактные модели (Qwen 2.5 7B, 14B, QwQ-32B) запускаются одной командой:

ollama run qwqДля QwQ-32B нужна видеокарта с 24 ГБ VRAM или больше. Модели поменьше (7B) работают даже на MacBook с 16 ГБ RAM.

У Qwen также есть приложения для iOS, Android и десктопа, все бесплатные.

Доступен ли Qwen в России

Да. В отличие от ChatGPT, который формально недоступен в России, Qwen не блокирует российских пользователей:

- Чат на qwen.ai работает без VPN

- API Alibaba Cloud доступен из России

- Open-source модели можно скачать с Hugging Face и запустить локально

Для команд, которые ищут альтернативу западным API без геополитических рисков, Qwen — один из самых практичных вариантов наряду с YandexGPT.

Кому подойдёт Qwen

Разработчикам, которые хотят запустить LLM на своей инфраструктуре и контролировать данные. Open-source лицензия и разнообразие размеров моделей дают гибкость.

Стартапам и малому бизнесу, которым нужен мощный API за разумные деньги. QwQ-32B через API обходится в 30–40 раз дешевле GPT-4.

Исследователям, которые хотят дообучать и модифицировать модели — лицензия Apache 2.0 это позволяет.

Тем, кто работает из России — модели доступны без ограничений и VPN.

Среди других открытых LLM, составляющих конкуренцию Qwen: DeepSeek — китайский стартап, бросивший вызов OpenAI.

За два года Alibaba собрала линейку моделей, которая по ряду задач не уступает лидерам рынка, а по доступности и открытости опережает большинство конкурентов. Если вы ещё не пробовали Qwen — сейчас хороший момент начать.