OpenAI отказалась от SWE-bench Verified: что это меняет

OpenAI перестала опираться на SWE-bench Verified. Разбираем, что сломалось в наборе и почему рынок теперь смотрит на SWE-bench Pro.

23 февраля 2026 года OpenAI опубликовала материал с недвусмысленным заголовком: компания больше не считает SWE-bench Verified подходящей метрикой для оценки передовых моделей для кода. Для рынка это заметный сдвиг. Именно SWE-bench Verified за полтора года успел стать удобным процентом, которым сопровождали релизы агентных систем, Codex-подобных продуктов и моделей для разработки.

Дело не в том, что модели внезапно перестали расти или, наоборот, полностью решили бенчмарк. OpenAI утверждает, что на нынешнем уровне результатов сам бенчмарк начал сильнее измерять дефекты тестов и степень знакомства моделей с задачами, чем реальную способность разбираться в чужом коде.

Если коротко, сигнал такой: старые таблицы результатов по SWE-bench Verified теперь надо читать осторожнее. Особенно когда речь идёт о поздних улучшениях на несколько процентов и о спорах, какая модель «лучшая для кода».

Что именно произошло

По состоянию на 27 апреля 2026 года у OpenAI есть две официальные точки на этой линии. Первая - август 2024 года, когда компания вместе с авторами SWE-bench выпустила SWE-bench Verified как более чистую версию исходного набора. Вторая - 23 февраля 2026 года, когда та же OpenAI публично объяснила, почему перестаёт опираться на этот бенчмарк в отчётности по релизам передовых моделей.

В 2024 году логика была понятной. OpenAI проверила 1 699 задач из тестового набора SWE-bench, а затем собрала отобранное подмножество из 500 задач, которые аннотаторы сочли решаемыми и корректно сформулированными. Тогда компания прямо писала, что новая версия должна заменить исходный SWE-bench и SWE-bench Lite как более надёжный способ измерять автономные инженерные способности моделей.

Этот ход сработал. SWE-bench Verified быстро превратился в де-факто ориентир для моделей для кода. Он был понятен инвесторам, удобен для маркетинга и казался ближе к реальной разработке, чем игрушечные задачники. Поэтому нынешний отказ важен не только как исследовательская поправка. По сути, речь идёт об одном из самых привычных процентов в индустрии агентной разработки.

Почему OpenAI отказалась от SWE-bench Verified

У OpenAI два основных аргумента, и оба неприятны для тех, кто любит сравнивать модели одной строкой в таблице.

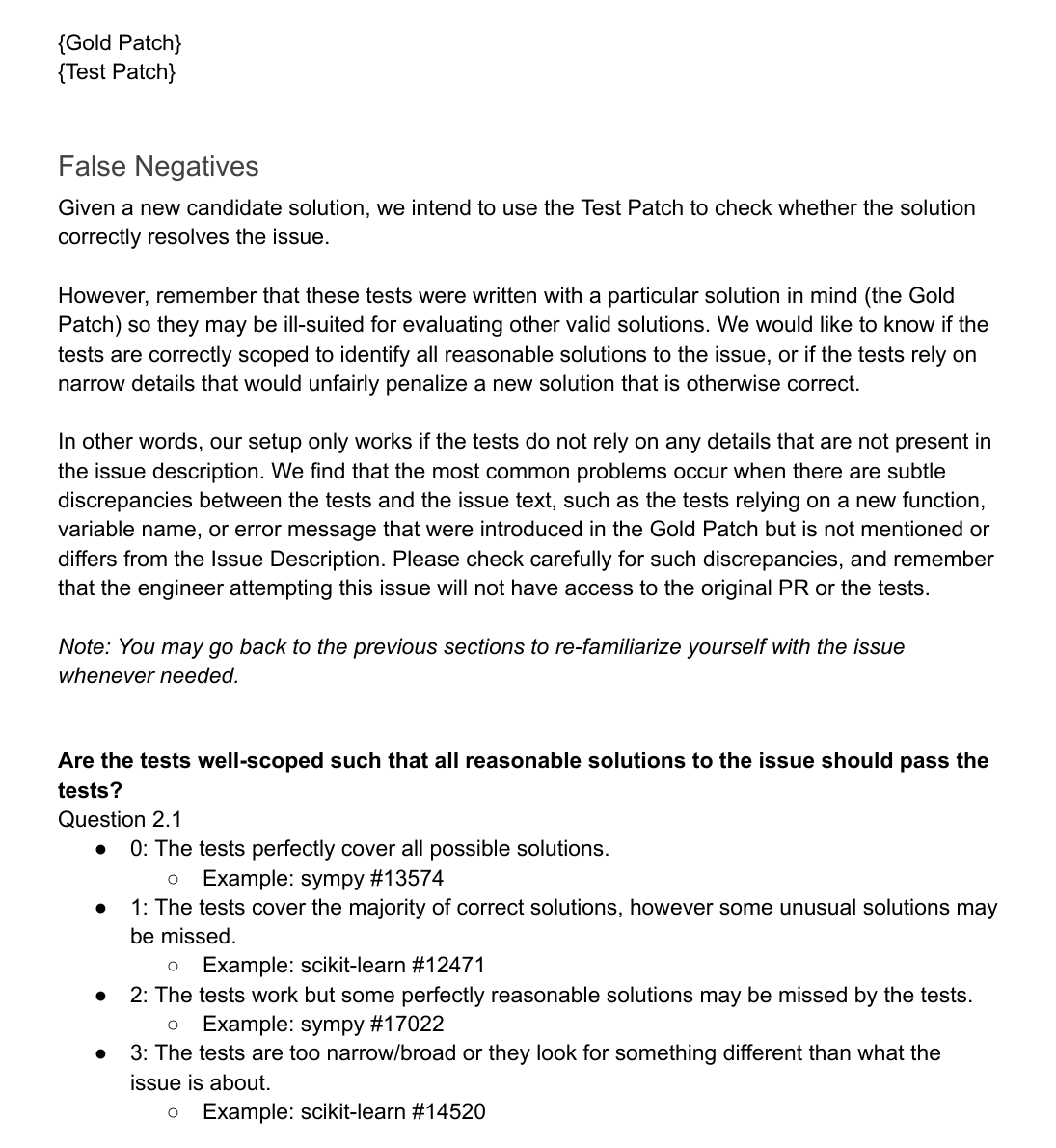

Первый аргумент - сами тесты. Компания взяла 138 задач SWE-bench Verified, которые OpenAI o3 не решал стабильно в 64 независимых прогонах. Это 27,6% всего набора Verified. После ручного аудита OpenAI заявила, что как минимум 59,4% этих задач содержат существенные проблемы в тест-дизайне или в формулировке задачи. Иными словами, заметная часть «трудных» кейсов оказалась трудной не из-за слабости модели, а потому, что бенчмарк наказывает корректные или разумные решения.

Дальше важна разбивка. По данным OpenAI, 35,5% проверенных задач страдали от слишком узких тестов: они требовали конкретной реализации, хотя функционально правильное решение могло выглядеть иначе. Ещё 18,8% задач проверяли дополнительное поведение, которого не было в исходном описании проблемы. Оставшиеся 5,1% OpenAI отнесла к прочим существенным дефектам.

Здесь важна не сноска, а сама логика проверки. Если бенчмарк засчитывает не «починил баг», а «угадал именно тот путь, который когда-то выбрал автор PR», он начинает измерять послушание эталонному патчу, а не инженерную адекватность. Это тот же класс проблемы, о котором мы уже писали в разборе ломающихся бенчмарков ИИ-агентов: красивый итоговый процент может маскировать методологический шум.

Второй аргумент ещё неприятнее - контаминация, то есть попадание задач и решений в обучение. SWE-bench построен на публичных GitHub-репозиториях и давно обсуждается всей индустрией. OpenAI прямо пишет, что все протестированные передовые модели смогли в отдельных случаях воспроизводить либо исходный человеческий эталонный патч, либо дословные детали описания задачи. Это сильный признак того, что модели уже видели по крайней мере часть задач и решений в обучающих данных.

Здесь важен не сам факт «модель что-то помнит». Важен эффект на итоговый балл. OpenAI пишет, что модели, которые сталкивались с задачами во время обучения, чаще проходят недоопределённые кейсы, потому что знают дополнительный контекст, которого нет у честного участника бенчмарка. В таком режиме рост результата отражает не только улучшение рассуждений и работы с инструментами, но и степень знакомства модели с контрольной.

Почему это меняет чтение старых лидербордов

Отказ OpenAI не означает, что все исторические результаты на SWE-bench Verified надо выбросить. В 2024 году сам проект Verified был полезным шагом вперёд по сравнению с исходным SWE-bench: он убирал часть нерешаемых и плохо поставленных задач, а GPT-4o на лучшей открытой агентной обвязке тогда поднялся до 33,2% на Verified против 16% на исходном SWE-bench.

Но в феврале 2026 года ситуация уже другая. OpenAI отдельно отмечает, что лучший результат на SWE-bench Verified за последние шесть месяцев вырос только с 74,9% до 80,9%. Когда вы подходите так близко к потолку набора, особенно опасно путать реальный прогресс моделей с шумом датасета. Если в остатке всё чаще сидят битые тесты и засвеченные задачи, то последние проценты становятся не самым честным способом сравнивать релизы.

Отсюда практический вывод для читателя: старый слайд с результатом на SWE-bench Verified больше нельзя читать как прямой ответ на вопрос «кто лучше пишет код». Такой процент полезен только вместе с деталями: какую агентную обвязку использовали, какие задачи исключили, насколько чист набор от контаминации, как устроены тесты и что вообще считается успешным решением.

Это также хорошо стыкуется с нашей статьёй о Rubric-Based GRM для SWE agents. Проблема не сводится к одному бенчмарку. Когда индустрия судит сложную инженерную работу только по бинарному pass/fail, она слишком легко теряет поведение внутри траектории, качество промежуточных шагов и влияние среды исполнения.

Почему OpenAI предлагает смотреть на SWE-Bench Pro

OpenAI не ограничилась критикой старой метрики. Компания прямо пишет, что до появления новых чистых оценок рекомендует публиковать результаты по SWE-bench Pro. Это важная деталь: рынок не просто теряет старый ориентир, ему сразу предлагают временную замену.

Что OpenAI вкладывает в этот переход, видно и по более поздним релизам. В анонсе GPT-5.3-Codex от 5 февраля 2026 года компания уже делает упор именно на SWE-Bench Pro и отдельно подчёркивает разницу: SWE-bench Verified тестирует только Python, тогда как SWE-Bench Pro покрывает четыре языка и считается более устойчивым к контаминации, более сложным, более разнообразным и более близким к реальной индустрии.

SWE-Bench Pro тоже не идеален и спор не закрывает. Сама OpenAI это оговаривает. Но направление понятно: вместо одного старого публичного Python-набора индустрия пытается перейти к более широким и менее засвеченным оценкам. Для компании, которая строит целую линейку вокруг Codex и более широкой системы оценок, это ещё и сигнал о зрелости процесса. История важна не только сама по себе, но и как часть более широкой траектории OpenAI вокруг агентной разработки, о которой мы собираем материалы в хабе OpenAI: продукты, модели и куда идти дальше.

Что из этого следует командам разработки

Главный урок здесь не в том, что бенчмарки бесполезны. Без них рынок быстро скатывается в чистый маркетинг. Урок в другом: как только бенчмарк становится слишком популярным, открытым и коммерчески важным, он начинает притягивать искажения. Часть задач оказывается плохо поставленной. Часть решений просачивается в обучение. Часть прогресса обеспечивается не моделью, а исполнительной оболочкой, агентной обвязкой и настройками прогона.

Поэтому командам, которые реально внедряют агентные инструменты для кода, стоит задавать более приземлённые вопросы. На каком наборе мерили модель? Есть ли в наборе ваши языки и типы задач? Что известно о контаминации? Сколько в результате ручного труда агентной обвязки, а сколько - способности самой модели? И главное: подтверждается ли успех на вашем собственном репозитории, в вашем CI и в вашей практике код-ревью?

Именно так бенчмарк перестаёт быть культовым числом и становится инструментом. Если он помогает калибровать ожидания, отлично. Если его пытаются продать как окончательный вердикт о «лучшем ИИ для кода», значит пора смотреть глубже, в методику.

Что стоит запомнить

OpenAI не просто слегка поправила сноску в очередной публикации. Компания фактически вывела SWE-bench Verified из списка надёжных витринных метрик для передовых моделей для кода. Основания две: слишком много оставшихся задач ломаются на дефектных тестах, и слишком много знаний о наборе уже успело попасть в обучение.

Для индустрии это неудобная, но полезная новость. Если даже создатель Verified больше не хочет опираться на этот процент, значит рынок агентной разработки действительно упёрся в предел одной публичной таблицы результатов. Следующий этап сравнения моделей придётся строить на более чистых, более широких и менее заезженных оценках.

Источники и дата проверки

Факты и цифры в материале проверены 27 апреля 2026 года по первоисточникам: OpenAI: Why SWE-bench Verified no longer measures frontier coding capabilities, OpenAI: Introducing SWE-bench Verified, OpenAI: Introducing GPT-5.3-Codex и официальная страница SWE-bench Verified.