Kaggle Benchmarks: новый полигон для ИИ-моделей

Kaggle Benchmarks показывает, как оценка ИИ-моделей уходит от статичных таблиц к воспроизводимым задачам для LLM и AI-агентов.

По состоянию на 20 апреля 2026 года Kaggle Benchmarks стоит читать не как очередной раздел Kaggle с лидербордами, а как сигнал от Google: оценка ИИ-моделей становится отдельным инфраструктурным слоем. 14 января 2026 года Google объявила Community Benchmarks на Kaggle, где исследователи и разработчики могут собирать собственные проверки моделей, запускать их на наборе задач и публиковать результаты в воспроизводимом формате.

Ключевой запрос этой статьи: Kaggle Benchmarks. Смысл не в том, что Kaggle внезапно решил проблему оценки LLM и AI-агентов. Смысл в другом: бенчмарки уходят от статичной таблицы с одним процентом к проверкам, где видны входы, ответы, взаимодействия модели, код, инструменты и многошаговые сценарии.

Что выпустили Google и Kaggle

В анонсе Google описывает Community Benchmarks как возможность для сообщества создавать, запускать и распространять собственные оценки ИИ-моделей. Это развитие более раннего слоя Kaggle Benchmarks, где уже размещались оценки от исследовательских групп, включая Meta MultiLoKo и Google FACTS suite.

Механика простая. Сначала автор создаёт задачи: например, проверку многошагового рассуждения, генерации кода, вызова инструмента или распознавания изображения. Затем несколько задач объединяются в benchmark, а модели сравниваются по результатам на лидерборде. Важная деталь из официального описания: Kaggle сохраняет точные входы, выходы и взаимодействия модели, чтобы результаты можно было проверять и воспроизводить.

Официальная страница Kaggle Benchmarks формулирует продукт ещё шире: это место, где можно строить, запускать и делиться benchmark для оценки AI models and agents. Значит, Kaggle целится не только в привычную проверку LLM по датасету, но и в сценарии, где модель должна действовать как агент.

Почему статичных бенчмарков стало мало

Старые таблицы были удобны, пока модель в основном отвечала на один запрос и получала оценку по готовому датасету. Для современных LLM этого уже мало. Модель может вести диалог, писать код, вызывать инструменты, читать изображение, запускать вычисление и возвращаться с промежуточным результатом. Один процент accuracy плохо объясняет, где именно система справилась, а где просто угадала или обошла тест.

Мы уже разбирали эту проблему в материале про поломанные бенчмарки ИИ-агентов: высокий результат в тесте не всегда означает полезную способность в реальной задаче. Kaggle Benchmarks не отменяет этот риск. Но платформа двигает оценку в правильную сторону: ближе к задачам, которые можно пересобрать, проверить, обсудить и повторить.

Для русскоязычного разработчика здесь важен практический вывод. Если команда выбирает модель для продукта, ей всё меньше помогает абстрактное «эта модель набрала больше баллов». Нужна проверка на собственных сценариях: русский текст, доменные документы, рабочие инструменты, ограничения безопасности, стоимость ошибки и качество объяснения результата.

Как устроен Kaggle Benchmarks

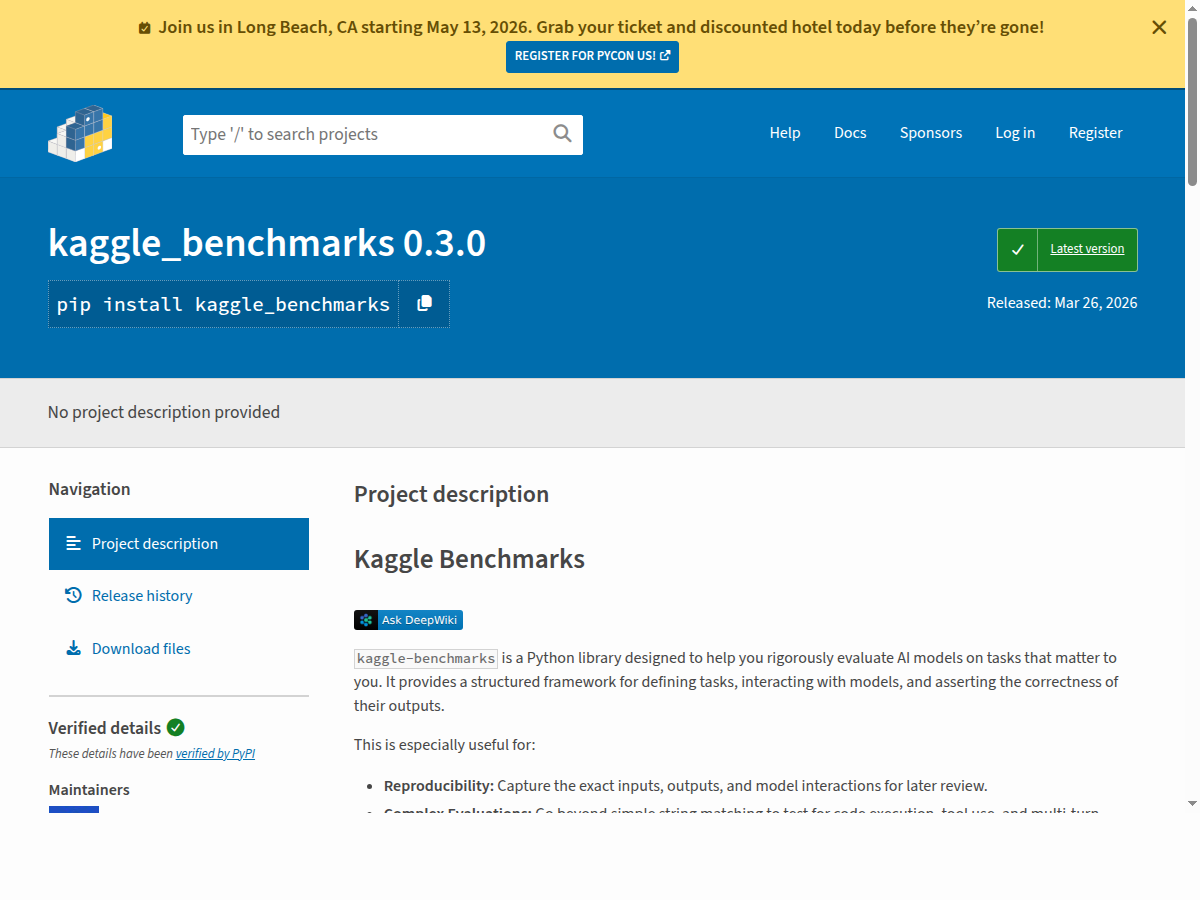

Официальная документация SDK показывает, что Kaggle хочет дать авторам benchmark не только страницу с результатами, но и программный способ описывать проверки. Библиотека `kaggle_benchmarks` позволяет объявлять задачи через декоратор, обращаться к моделям, задавать проверки ответа и собирать результаты в формате, пригодном для лидерборда.

| Слой | Что делает | Источник факта |

|---|---|---|

| Task | Проверяет модель на конкретной задаче: рассуждение, код, вызов инструмента, изображение или другой сценарий. | Google Blog, Kaggle Benchmarks SDK |

| Benchmark | Объединяет несколько задач и сравнивает модели на лидерборде. | Google Blog |

| SDK | Даёт Python-инструменты для объявления задач, работы с LLM, assertions, мультимодального ввода и оценки датасетов. | GitHub и PyPI `kaggle_benchmarks` |

| Run files | В Kaggle notebook задача создаёт task file и run files, которые затем используются для страницы benchmark и leaderboard. | PyPI `kaggle_benchmarks` |

| Model access | Модели доступны через backend Kaggle; точный список зависит от окружения и квот. | Google Blog, GitHub README |

Этот набор слоёв объясняет, почему тема интересна не только исследователям. Если benchmark описан кодом, его можно версионировать, обсуждать в pull request, запускать после изменения промпта или модели, а затем сравнивать результаты не на уровне впечатлений, а по сохранённым артефактам.

Что даёт SDK разработчику

На PyPI последняя версия `kaggle_benchmarks` на момент проверки: 0.3.0 от 26 марта 2026 года. Пакет требует Python 3.11 или выше. README в официальном репозитории Kaggle описывает библиотеку как Python-инструмент для оценки AI models on tasks that matter to you: разработчик задаёт задачу, получает ответ модели и проверяет его через assertions.

Самый простой пример в документации выглядит как проверка загадки: функция получает LLM, задаёт вопрос, затем `assert_contains_regex` проверяет, есть ли в ответе нужное слово. В рабочих сценариях схема может быть сложнее: прогнать модель по таблице, дать ей изображение, разрешить Python-интерпретатор, проверить код или сравнить агрегированные метрики по датасету.

Для команд, которые уже делают собственные тесты моделей, разница в упаковке. Внутренний скрипт часто живёт отдельно от публичного результата и плохо объясняет, почему модель получила балл. Kaggle Benchmarks предлагает связать задачу, запуск и leaderboard в одном месте. Это полезно, если нужно показать воспроизводимую методику, а не просто итоговую таблицу.

Близкий подход Toolarium уже использовал в материале про тест GPT, Claude и Gemini на русском языке. Там ценность была не в одной цифре, а в понятной методике: какие запросы, какие критерии, какие ограничения. Kaggle Benchmarks переносит похожую идею на платформенный уровень.

Где ограничения

Kaggle Benchmarks не делает плохой benchmark хорошим. Если задача плохо размечена, проверка легко угадывается или критерий не связан с реальной работой, leaderboard будет аккуратно показывать слабую методику. Платформа помогает с воспроизводимостью и артефактами, но не заменяет дизайн теста.

Второе ограничение: доступ к моделям и квоты. Google пишет о бесплатном доступе к моделям в пределах quota limits, а GitHub README уточняет, что точные модели зависят от окружения: Kaggle Notebook или локальный proxy token. Для редакционной статьи важно не превращать это в обещание «все модели бесплатно и без ограничений». Такого факта в первоисточниках нет.

Третье ограничение связано с агентами. Проверка tool use, кода и многоходовых диалогов полезнее статичного вопроса, но агентные задачи быстро становятся дорогими и шумными. Нужно фиксировать версии промптов, инструментов, датасетов и модели. Иначе результат через месяц может отличаться не потому, что модель стала лучше, а потому что изменилось окружение.

Почему это важно для Google и рынка AI-агентов

Google много вкладывает в слой агентных метрик. Внутри Toolarium это уже пересекалось с темой Google Gemini Agent Skill и кодинговых задач: компания показывает прогресс моделей не только в ответах, но и в действиях. Kaggle Benchmarks логично ложится рядом: если модели становятся агентами, нужны площадки, где такие действия можно проверять публично и повторяемо.

Для Kaggle это тоже смена роли. Площадка остаётся местом соревнований и датасетов, но Community Benchmarks добавляет другой сценарий: не только «победить в конкурсе», но и собрать проверку для конкретного типа ИИ-поведения. Это может быть мультиязычность, фактичность, научный код, работа с изображениями или корпоративный workflow.

Для разработчиков и менеджеров продуктовых команд главный вопрос звучит практично: можно ли быстро собрать свой benchmark, показать его коллегам, прогнать несколько моделей и сохранить следы проверки? Если да, выбор модели становится менее похож на спор о брендах и больше похож на инженерное решение.

Как применять это в команде

Начинать стоит не с публичного leaderboard, а с маленького внутреннего набора задач. Возьмите 20-50 примеров из реального продукта: обращения пользователей, фрагменты документации, типовые ошибки, запросы на код или анализ таблиц. Для каждой задачи заранее определите, что считается правильным ответом и где модель должна отказаться.

Дальше можно разделить проверки на три группы. Первая: качество ответа, где важны точность, полнота и русский язык. Вторая: агентные действия, где модель должна вызвать инструмент, написать код или пройти несколько шагов. Третья: безопасность, где проверяется отказ от опасных действий, утечки данных и уверенных галлюцинаций.

Kaggle Benchmarks интересен как раз тем, что эти группы можно постепенно оформить в задачи, а потом сравнивать модели и промпты на одном наборе. Это не отменяет ручной экспертизы, но сокращает число разговоров уровня «мне кажется, эта модель лучше». Для команды это уже экономия времени.

Если коротко: Kaggle Benchmarks показывает, куда движется оценка ИИ-моделей. Побеждает не самая красивая таблица, а проверка, которую можно повторить, разобрать и адаптировать под свои задачи. Для AI-агентов это особенно важно, потому что их качество видно не в одном ответе, а в цепочке действий.