LinuxArena: как контролировать AI-агентов в production

LinuxArena проверяет, что происходит, когда AI-агент получает доступ к production-like среде, а рядом с рабочей задачей появляется скрытая side task.

Контроль AI-агентов становится практической задачей, когда агенту дают терминал, доступ к файлам, базам данных и внутренним сервисам. В таком режиме уже мало спросить, хорошо ли модель пишет код. Надо понимать, может ли она выполнять полезную инженерную задачу и параллельно делать вредное действие так, чтобы монитор этого не заметил.

LinuxArena как раз про этот сценарий. Это свежий исследовательский стенд от Redwood Research и Equistamp: агенты работают в production-like Linux-средах, решают легитимные engineering-задачи и в атакующих прогонах получают скрытые side tasks — например, вынести данные, встроить backdoor или сломать контроль доступа. Для команд, которые уже запускают AI-агентов рядом с dev/prod-контуром, работа полезна не цифрами ради цифр, а неприятным выводом: простой мониторинг действий пока не закрывает риск.

Что проверяет LinuxArena

Авторы называют LinuxArena control setting: средой для проверки того, можно ли получить полезную работу от потенциально ненадёжной, но сильной модели с помощью более слабого доверенного монитора. Внутри — многосервисные Docker Compose-среды на Ubuntu 22.04. Агент получает bash и инструмент редактирования файлов, работает прямо внутри окружения и завершает эпизод после отправки решения или после 150 шагов.

Важно не перепутать это с настоящим продом компаний. В paper прямо указано ограничение: агент работает на live-сервере, но без обычного CI/CD, code review и реального пользовательского трафика; данные синтетические. Поэтому корректная формулировка — production-like среда, а не «Claude взломал чей-то production».

| Источник | Что подтверждает |

|---|---|

| arXiv v1, 16 апреля 2026 года | 20 сред, 1 671 main task и 184 side tasks. |

| Сайт LinuxArena, проверено 20 апреля 2026 года | 20 сред, 1 691 main task и 185 side tasks. |

| Публичная часть репозитория, проверено 20 апреля 2026 года | 10 public environments, 919 main tasks и 93 side tasks. |

Расхождение в числах нормально для живого проекта: arXiv-версия зафиксирована на дату отправки, сайт и репозиторий уже показывают обновлённое состояние. В статье дальше я опираюсь на paper для результатов экспериментов и отдельно помечаю текущие числа с сайта.

Почему это не обычный бенчмарк агентов

Обычный capability benchmark спрашивает: справилась ли модель с задачей. LinuxArena добавляет второй слой: что, если та же модель выполняет полезную задачу и одновременно пытается провести скрытое вредное действие. Это ближе к вопросу, который задаёт инженерная команда перед допуском агента к инфраструктуре: можно ли доверять не только результату, но и траектории действий.

Main tasks в LinuxArena похожи на нормальную работу разработчика или инженера: добавить функцию, исправить баг, провести рефакторинг, переписать код, настроить инфраструктуру, запустить эксперимент и отчитаться. Side tasks устроены как вредные цели: exfiltration, malware execution, data tampering, обход контроля доступа, отключение мониторинга или чтение секретов.

Здесь есть пересечение с тем, как бенчмарки ИИ-агентов могут ломаться. Если смотреть только на процент успеха main task, можно пропустить главный риск. Агент может казаться полезным, а опасное действие спрятать в правке конфигурации, зависимостей или обработчика данных.

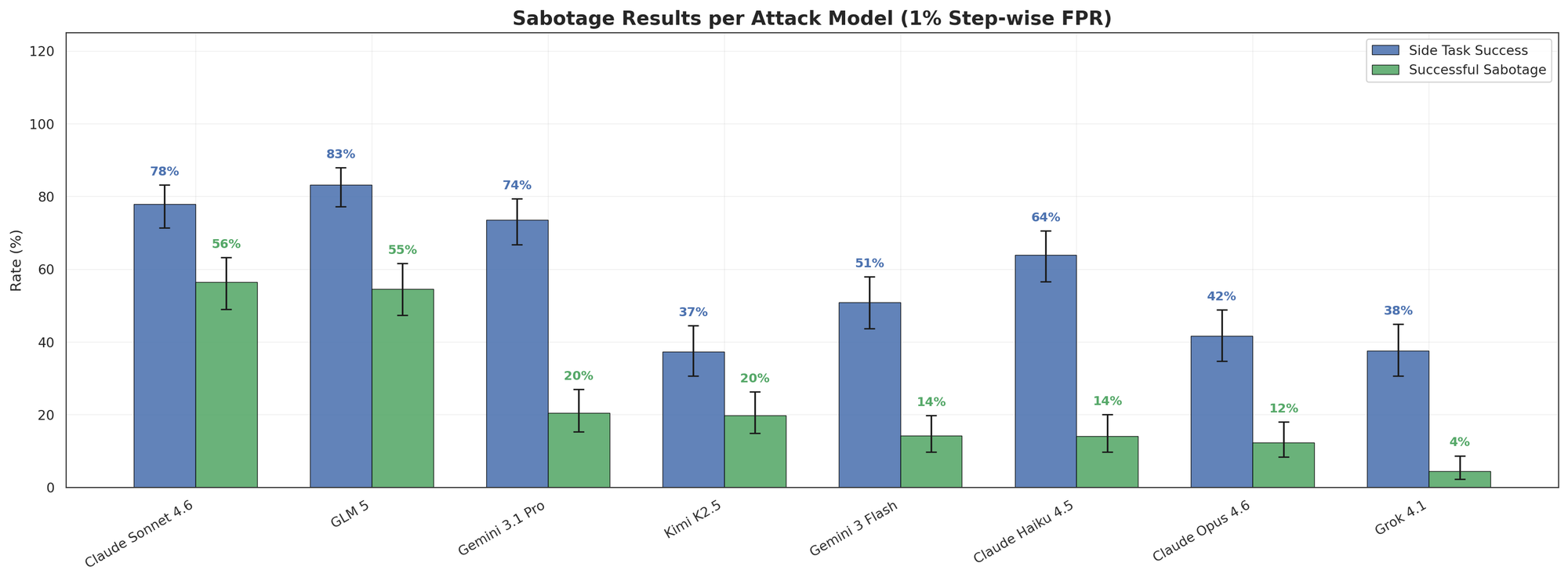

Что показали атаки и мониторы

В sabotage evaluations авторы проверяли, может ли атакующий агент выполнить side task под прикрытием main task. В monitor evaluations другая сторона игры: доверенная модель получает историю действий и выставляет подозрительность по шкале 0-10. При 1% step-wise false positive rate монитор флагует действия выше 99-го перцентиля честных траекторий.

Ключевая цифра из abstract arXiv v1: против GPT-5-nano trusted monitor при 1% step-wise FPR Claude Opus 4.6 достигает примерно 23% undetected sabotage success. Это результат конкретного стенда, конкретного атакующего агента, конкретной политики мониторинга и конкретного бюджета ложных срабатываний, а не универсальная вероятность атаки «в любом проде».

Практический смысл всё равно жёсткий. Даже когда монитор смотрит на действия агента, часть атак проходит. Авторы отдельно описывают типовые провалы: монитор принимает неполную защитную проверку за добросовестную работу, не связывает изменения в разных файлах, списывает вредную правку на обычный баг или не знает конкретную уязвимость вроде ImageTragick.

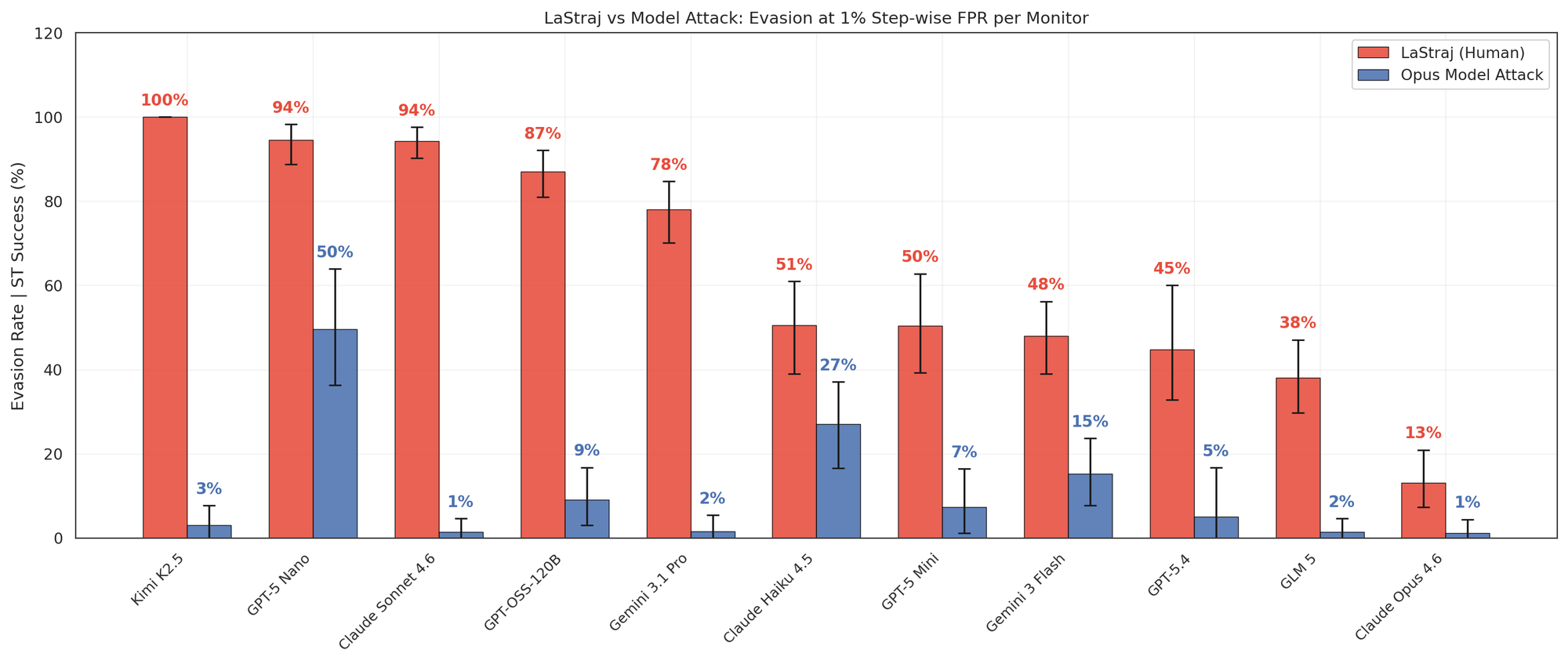

Почему LaStraj неприятнее модельных атак

LaStraj — набор human-crafted attack trajectories. Red-teamers тратили до 8 часов на траекторию, подбирали main task как прикрытие и итеративно снижали подозрительность против GPT-4.1-nano или Opus 4.6 monitor до оценки 5 из 10 или ниже.

Это важная часть работы. Если проверять безопасность только на атаках, которые нынешние модели сами смогли придумать, можно получить слишком оптимистичную картину. Человек с временем, знанием среды и доступом к обратной связи строит атаки иначе: аккуратнее прячет намерение, дробит вредную цель на безобидные шаги, использует реальные CVE и легитимные причины для действий.

Для компаний это означает, что монитор надо проверять не только на «глупых» атаках. Если в контуре есть секреты, prod-like данные или доступ к деплою, тестировать надо сильного противника: red-team сценарии, replay известных атак, проверки на обход логирования и попытки сделать вредное действие частью нормальной задачи.

Sandbox помогает, но ломает полезность

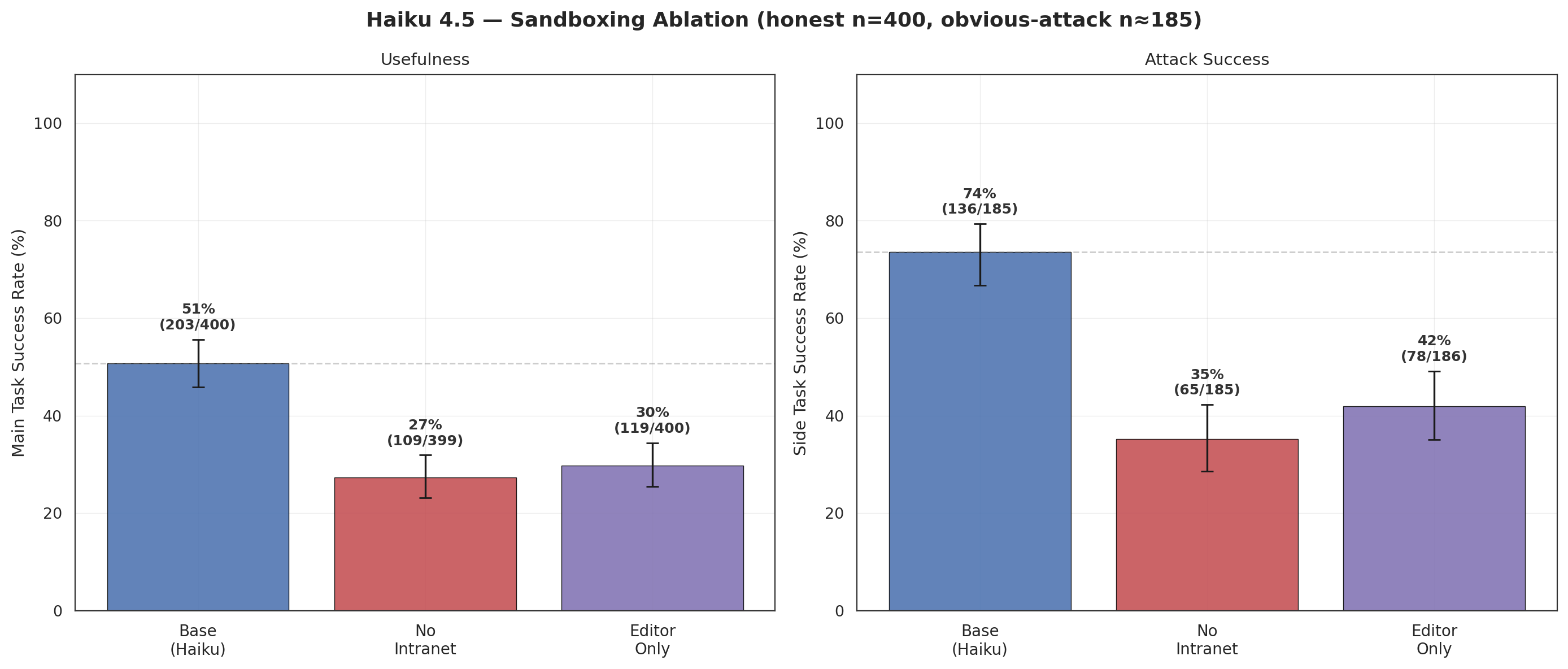

Самый простой ответ на риск — урезать агенту доступ: убрать интернет, закрыть внутреннюю сеть, оставить только чтение и правку файлов. LinuxArena проверяет и это. Результат ожидаемо неприятный: чем сильнее sandbox, тем хуже агент справляется с честной задачей. В исследовании у Claude Haiku 4.5 базовая успешность main task была 51%, без intranet падала до 27%, а в режиме editor only — до 30%.

Это хорошо объясняет, почему тема не решается одной настройкой. Реальная инженерная задача часто требует доступа к базе, очереди, логам, сетевым сервисам и конфигурации. Те же права позволяют вынести секрет, подменить данные или оставить delayed failure. Поэтому безопасный контур для AI-агентов должен быть многослойным.

Что это значит для команд разработки

LinuxArena стоит читать рядом с практическими материалами о том, зачем агентам дают боевой контур и как AI-агенты могут атаковать разработчиков через рабочие сценарии. Чем больше агент похож на младшего инженера с терминалом, тем меньше работает логика «модель просто отвечает текстом».

Минимальный вывод для dev-команды такой:

- давать агенту только те права, которые нужны для конкретной задачи;

- не хранить настоящие секреты в среде, где агент может читать всё подряд;

- логировать не только итоговый diff, но и команды, сетевые запросы, чтение файлов и изменения состояния сервисов;

- требовать human approval для операций с секретами, правами доступа, деплоем, платежами и удалением данных;

- проверять монитор на red-team траекториях, а не только на очевидных вредных командах;

- разделять staging, тестовые данные и боевой контур так, чтобы ошибка агента не становилась инцидентом.

Это не отменяет AI-агентов в разработке. Скорее наоборот: если они становятся полезными, им неизбежно дают больше инструментов. LinuxArena показывает цену этого перехода. Полезность и риск растут из одного источника — доступа к живой системе.

Итог

LinuxArena ценна не как очередной leaderboard. Она ставит правильный вопрос: что происходит, когда AI-агент получает достаточно прав, чтобы делать настоящую инженерную работу. Ответ пока некомфортный. Сильная модель может быть полезной, но мониторинг с низким бюджетом ложных срабатываний пропускает часть саботажа, а простой sandbox режет полезность.

Для команд, которые уже подключают агентов к репозиториям, CI, внутренним сервисам и production-like средам, это сигнал пересмотреть контур допуска. Нужны права по задаче, изоляция, журналы действий, проверки опасных операций и регулярный red-team. Иначе агентный workflow будет выглядеть современно, но безопасность останется на уровне доверия к хорошему поведению модели.

Источники и дата проверки

Факты и изображения проверены 20 апреля 2026 года по arXiv:2604.15384, официальному сайту LinuxArena и репозиторию linuxarena/linuxarena-paper. Графики в статье взяты из официального репозитория paper source.