Промпт-инжиниринг: как писать запросы к ИИ без магии

Практический гайд по промпт-инжинирингу: как писать запросы к ИИ, когда добавлять примеры и когда менять не промпт, а модель или RAG.

Проверено 6 мая 2026 года. Промпт-инжиниринг в 2026 году уже не выглядит как набор магических фраз. Это базовая дисциплина работы с LLM: вы явно задаёте задачу, контекст, ограничения, формат ответа и способ проверки. Чем дороже ошибка, тем ближе хороший промпт к короткому техзаданию, а не к просьбе в чате.

Если нужен короткий ориентир, держите простое правило: сначала уточните, что именно модель должна сделать, на каких данных, в каком формате и что ей запрещено. Если после этого результат всё ещё плавает, проблема часто уже не в формулировке одной фразы, а в выборе модели, системной инструкции, слое поиска и подстановки контекста или тестовом наборе.

Быстрый ответ: что меняет хороший промпт

Промпт-инжиниринг, или проектирование запросов, это работа со входной инструкцией для модели. Он не делает модель умнее сам по себе. Он снимает двусмысленность: отделяет задачу от фона, превращает «напиши что-нибудь» в понятный сценарий и делает ответ пригодным для проверки.

OpenAI, Anthropic и Google в актуальных гидах сходятся в одном: сильный промпт обычно выигрывает не за счёт хитрой формулы, а за счёт ясности. Нужны конкретная цель, понятный контекст, явный формат и примеры там, где вы хотите зафиксировать стиль или структуру.

Куда идти дальше по кластеру

Эта страница отвечает на базовый вопрос: как вообще писать запросы к ИИ так, чтобы ответ перестал быть случайным. Ниже быстрый маршрут по соседним интентам Toolarium, чтобы не смешивать в одной статье вводный уровень, системные инструкции, RAG и агентный контур.

| Если вам нужно | Куда идти дальше | Зачем открывать |

|---|---|---|

| Сначала понять механику LLM | Что такое LLM | Базовый разбор того, как модель вообще обрабатывает текст, токены и контекст. |

| Перейти к более сильным техникам промптинга | Промпт-инжиниринг в 2026: продвинутые техники | Там живут цепочки промптов, пошаговое рассуждение, длинный контекст и другие продвинутые паттерны. |

| Настроить поведение модели на уровне продукта | Системные промпты: продвинутый гайд | Подходит для приложений, ботов и агентных систем, где одной пользовательской реплики уже мало. |

| Подтягивать документы, базу знаний и свежие данные | RAG: что это и когда нужен в продакшне | Нужен, когда проблема не в формулировке запроса, а в доступе модели к внешнему знанию. |

| Понять вызов инструментов, планирование и автономные сценарии | AI-агенты: что это, как работают и где полезны | Полезно, если модель должна не только отвечать, но и вызывать инструменты или выполнять шаги. |

| Разобраться, не упираетесь ли вы в модель, а не в промпт | Как выбрать языковую модель | Помогает не лечить качеством текста то, что на самом деле упирается в качество модели, цену или задержку. |

Из чего состоит сильный запрос

Рабочий промпт обычно состоит из шести частей. Не все нужны каждый раз, но если ответ модели «плавает», почти всегда проблема обнаруживается именно здесь.

| Часть | Зачем нужна | Пример |

|---|---|---|

| Роль | Задаёт профессиональную рамку | «Ты технический редактор B2B-медиа» |

| Задача | Говорит, что именно нужно сделать | «Сократи текст до 1200 знаков без потери фактов» |

| Контекст | Даёт исходные данные и ограничения ситуации | «Аудитория: CTO и тимлиды, продукт: API для финтеха» |

| Критерии | Объясняет, как оценивать результат | «Без рекламных обещаний, с конкретными рисками» |

| Формат | Делает ответ пригодным для использования | «Верни JSON с полями title, summary, risks» |

| Примеры | Показывают модельный образец результата | «Вот плохой и хороший вариант заголовка» |

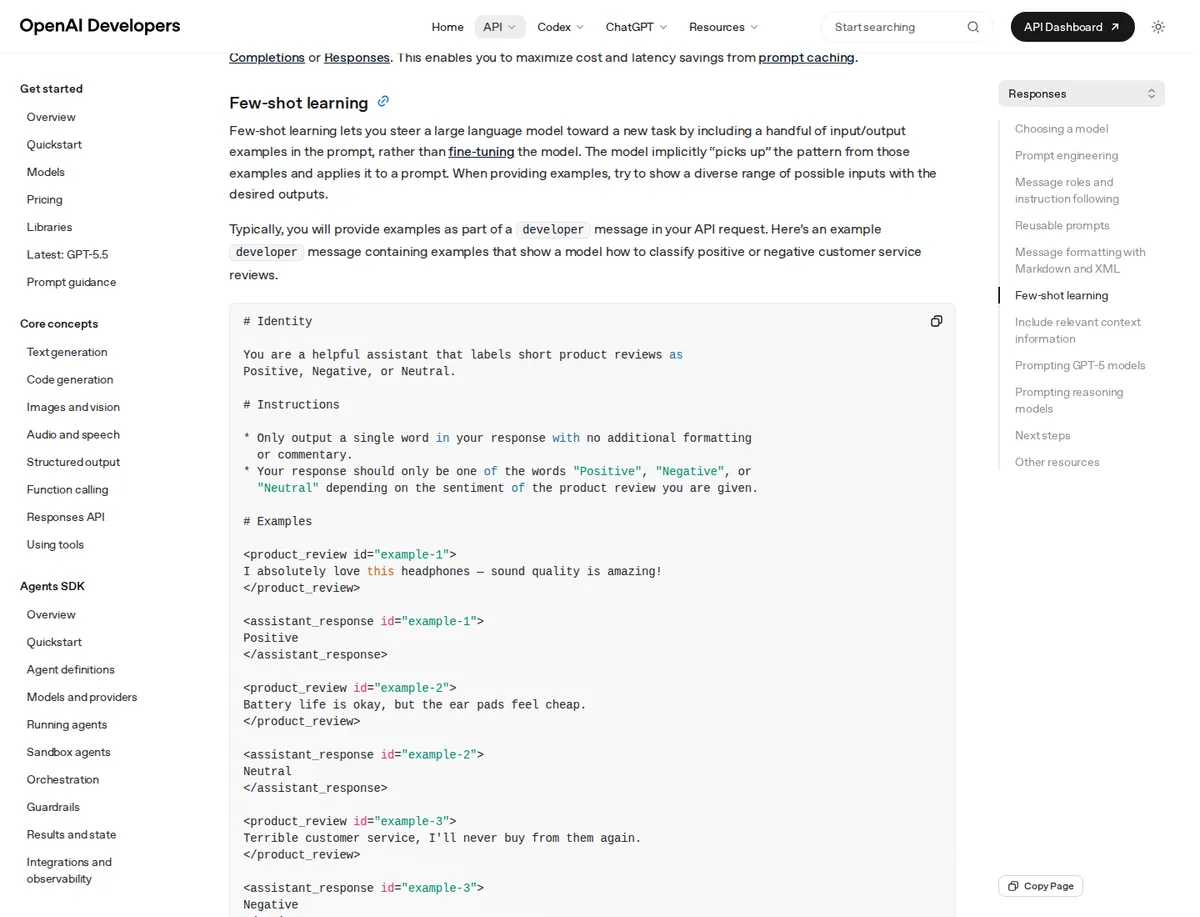

В актуальном OpenAI guide та же логика разложена почти в таком же порядке для developer message: identity, instructions, examples, context. Это полезный sanity-check: если ваш промпт нельзя мысленно разнести по этим полкам, он чаще всего ещё сырой.

Самый приземлённый тест такой: уберите из промпта всё лишнее и покажите его коллеге. Если человеку всё ещё непонятно, что именно нужно сделать, модели тоже будет непонятно.

Базовый шаблон запроса

Для большинства рабочих задач достаточно такого каркаса:

Роль:

Ты [специалист/редактор/аналитик/разработчик].

Задача:

Сделай [конкретное действие] с [исходными данными].

Контекст:

[аудитория, продукт, ограничения, цель]

Требования:

- [требование 1]

- [требование 2]

- [что нельзя делать]

Формат ответа:

[таблица / JSON / список / текст до N знаков]

Критерии качества:

[как понять, что ответ хороший]Пример для редакционной задачи:

Ты редактор русскоязычного медиа об ИИ.

Перепиши лид статьи так, чтобы он объяснял ценность материала за первые 2 предложения.

Аудитория: разработчики и продакт-менеджеры.

Тон: умный, но без канцелярита.

Нельзя:

- начинать с общих фраз про «мир технологий»;

- использовать англицизмы, если есть нормальный русский эквивалент;

- обещать то, чего нет в статье.

Верни 3 варианта лида и коротко объясни, чем они отличаются.Такой запрос не гарантирует идеальный ответ, но заметно уменьшает разброс. Модель уже знает, кто она в этой задаче, что нужно сделать, для кого, в каком стиле и как вернуть результат.

Когда нужны примеры: zero-shot и few-shot

Zero-shot означает, что вы даёте задачу без примеров. Для простых действий этого часто достаточно: перевести текст, кратко объяснить термин, собрать список шагов.

Few-shot означает, что вы показываете несколько пар «вход - хороший выход». Это особенно полезно, когда нужно зафиксировать формат, тон или границы ответа. В документации Gemini такой приём прямо советуют для сценариев, где нужен стабильный вывод, а не разовый удачный ответ.

| Сценарий | Что лучше | Почему |

|---|---|---|

| Разовая простая просьба | Zero-shot | Примеров не нужно, задача очевидна |

| Нужен стабильный формат | Few-shot | Модель видит образец структуры |

| Нужен фирменный тон | Few-shot | Инструкции про стиль хуже работают без примеров |

| Нужен машинно-читаемый ответ | Схема плюс примеры | Проще проверять JSON, CSV или таблицу |

Пример few-shot для классификации обращений:

Классифицируй обращение в одну из категорий:

billing, bug, feature_request, account.

Примеры:

Текст: «Списали деньги два раза»

Категория: billing

Текст: «После обновления кнопка сохранить не работает»

Категория: bug

Текст: «Добавьте экспорт в XLSX»

Категория: feature_request

Теперь классифицируй:

Текст: «Не могу войти, письмо восстановления не приходит»

Категория:Если примеров становится слишком много, это уже сигнал остановиться и пересобрать подход. Иногда нужен не ещё один длинный промпт, а отдельный тестовый набор, системная инструкция или retrieval через RAG.

Как задавать формат ответа

Формат нужно задавать явно. Не «сделай структурно», а «верни таблицу с колонками: проблема, причина, исправление». Не «дай JSON», а «верни только валидный JSON без Markdown».

Для API и автоматизации лучше использовать жёсткую схему:

Верни только JSON:

{

"summary": "одно предложение",

"risks": ["риск 1", "риск 2"],

"next_actions": ["действие 1", "действие 2"]

}

Если данных недостаточно, поставь null и добавь причину в поле "missing_data".Для текста, который читает человек, задавайте длину, структуру и запреты:

Напиши ответ клиенту.

Длина: до 900 знаков.

Структура: признать проблему, объяснить следующий шаг, назвать срок.

Тон: спокойный, без юридических формулировок.

Не обещай компенсацию и не называй причину сбоя, если её нет в данных.Когда одного базового промпта уже недостаточно

Здесь проходит самая полезная граница для продуктовой работы. Anthropic прямо пишет в актуальном prompt engineering overview, что не каждый проваленный eval нужно лечить только формулировкой запроса: задержку и стоимость иногда быстрее улучшает выбор другой модели. На практике это хороший фильтр и для OpenAI-, и для Gemini-сценариев. Не всё, что выглядит как слабый промпт, на самом деле является проблемой одного текста.

| Что вы видите на тестах | Первый рычаг | Почему это не всегда лечится только промптом | Куда идти дальше |

|---|---|---|---|

| Ответ в одном и том же сценарии уходит не в тот формат или забывает важное условие | Уточнить задачу, критерии и few-shot примеры | Это ближайший к задаче слой: проблема часто в двусмысленности запроса, а не в архитектуре | Продвинутые техники |

| Нужно держать одинаковое поведение модели на всём диалоге или во всём продукте | Системная инструкция, правила и запреты | Пользовательский промпт может быть хорошим, но глобальная рамка поведения живёт выше | Системные промпты |

| Модель отвечает гладко, но не знает свежие факты из документов, базы знаний или логов | Поиск и подстановка внешнего контекста | Проблема не в формулировке, а в отсутствии данных внутри запроса | RAG |

| Нужно не только ответить, но и вызвать инструменты, проверить результат и довести задачу до действия | Агентный контур, права и проверки | Один промпт не добавляет модели память, состояние и безопасный tool use | AI-агенты |

| Даже на хорошем промпте качество упирается в потолок, а цена или задержка не сходятся | Смена модели или маршрутизация между моделями | Это уже ограничение самого движка, а не текста инструкции | Как выбрать языковую модель |

Полезное правило: сначала меняйте ближайший слой, который реально объясняет симптом. Если модель не знает фактов, не надо бесконечно шлифовать формулировку. Если всё ломается на каждом ходу диалога, не стоит притворяться, что это проблема одного пользовательского сообщения.

Эта развилка важна, потому что базовая страница про промпт-инжиниринг не должна притворяться гидом сразу по архитектуре RAG, агентам и выбору модели. Здесь мы закрываем вводный слой. Всё остальное лучше разбирать в соседних URL, где у проблемы уже свой собственный интент.

Антипаттерны: как не надо писать запросы

| Плохой запрос | Почему плохо | Как исправить |

|---|---|---|

| «Напиши красиво» | Нет задачи, аудитории и критерия качества | «Перепиши для CTO, тон деловой, до 700 знаков, без рекламных обещаний» |

| «Не делай ошибок» | Запрет слишком общий | «Проверь даты, цены и названия моделей по источникам. Если факт не подтверждается, пометь это явно» |

| «Проанализируй всё» | Непонятно, что считать результатом анализа | «Найди 5 рисков, оцени влияние по шкале 1-5, предложи действие для каждого» |

| «Сделай как эксперт» | Роль без критериев почти ничего не даёт | «Действуй как инженер SRE: проверь отказоустойчивость, наблюдаемость и rollback-план» |

Плохой промпт часто выглядит коротко и уверенно. Хороший бывает длиннее, зато снимает двусмысленность и экономит итерации.

Промпт для русскоязычного текста

Для русского языка полезно отдельно задавать языковую политику. Модели до сих пор охотно тянут кальки с английского, канцелярит и безличные клише. Если нужен живой русский текст, это лучше написать прямо, а не надеяться, что модель сама догадается.

Пиши по-русски.

Не используй англицизмы, если есть нормальный русский эквивалент.

Избегай клише, канцелярита и английских калек.

Не начинай абзацы с общих фраз.

Каждый тезис подкрепляй примером или ограничением.Если нужен стиль конкретного продукта или издания, одних прилагательных мало. Дайте 2-3 удачных примера и один заведомо плохой. Это быстрее, чем долго объяснять, что такое «умно, но не занудно».

Как проверять промпт перед внедрением

Промпт, который сработал на одном примере, ещё не готов к продукту. Минимальная проверка выглядит так:

- Соберите 20-50 реальных запросов пользователей или рабочих задач.

- Добавьте сложные случаи: неполные данные, конфликтующие инструкции, длинный контекст, русский и английский вперемешку.

- Определите, что считается успешным ответом.

- Прогоните несколько версий промпта на одном наборе.

- Сравните ответы не только по гладкости текста, но и по точности, полноте, формату и числу ручных правок.

- Зафиксируйте версию промпта и меняйте её только через тесты.

Если промпт живёт внутри AI-агента, добавьте ещё один слой: что агенту запрещено делать, какие инструменты доступны, какие данные нельзя раскрывать и когда он обязан остановиться и спросить человека.

Вывод

Промпт-инжиниринг не сводится к подбору красивых фраз. Это работа с требованиями: цель, контекст, ограничения, формат, примеры и проверка. Чем дороже ошибка, тем меньше промпт должен быть похож на дружескую просьбу и тем больше на короткую спецификацию.

Для личной работы часто хватает шаблона с ролью, задачей, контекстом и форматом. Для продукта нужны версии, тестовый набор и понимание, где заканчивается сила одного промпта и начинается выбор другой модели, системной инструкции, слоя поиска и подстановки контекста или агентной архитектуры.

Источники и дата проверки

- OpenAI API Docs: Prompt engineering, проверено 6 мая 2026 года.

- Anthropic Docs: Prompt engineering overview, проверено 6 мая 2026 года.

- Anthropic Docs: Claude prompting best practices, проверено 6 мая 2026 года.

- Google AI for Developers: Prompt design strategies, проверено 6 мая 2026 года.

- Chain-of-Thought Prompting Elicits Reasoning in Large Language Models, Wei et al., 2022.

- Self-Consistency Improves Chain of Thought Reasoning in Language Models, Wang et al., 2022.