OpenAI Privacy Filter: локальная маскировка PII для AI-разработки

OpenAI выпустила Privacy Filter — open-weight модель для локального поиска и маскирования PII. Разбираем, куда её ставить в AI-пайплайне и где границы.

По состоянию на 22 апреля 2026 года OpenAI Privacy Filter — новый open-weight фильтр для персональных данных в тексте. Он ищет PII: имена частных лиц, адреса, телефоны, почту, даты, номера счетов, приватные URL и секреты вроде паролей или API-ключей. Главное здесь не брендовый релиз сам по себе. OpenAI вынесла приватность в отдельный локальный слой, который можно поставить перед обучением, индексацией, логированием и ревью данных.

Для разработчиков это практичная вещь. Если модель запускается локально или on-premise, сырой текст с чувствительными данными не нужно сначала отправлять во внешний сервис для очистки. Но у релиза есть жёсткая граница: Privacy Filter не превращает текст в юридически безопасную анонимизацию и не заменяет политику обработки данных.

Что именно выпустила OpenAI

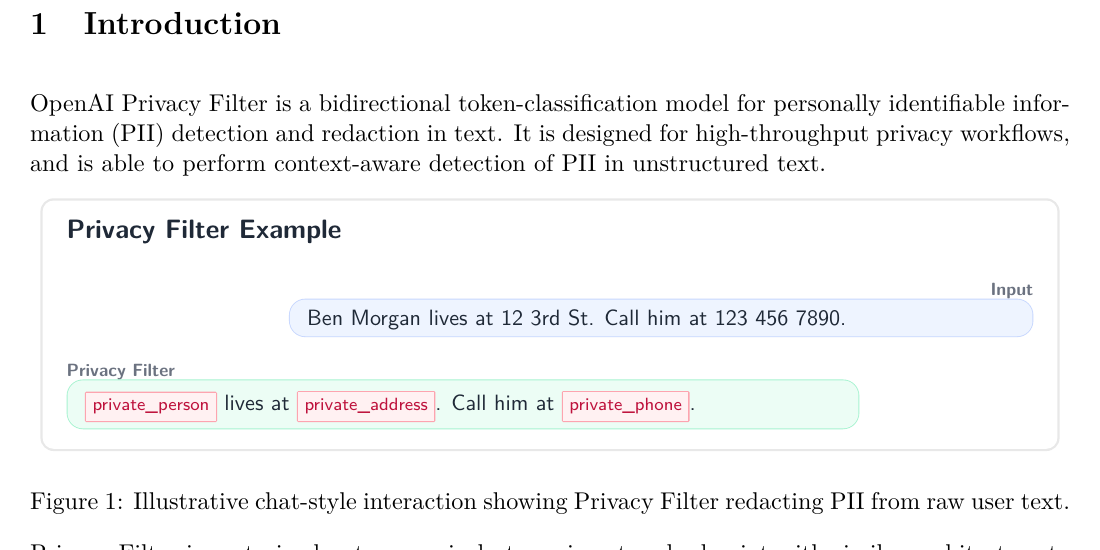

OpenAI описывает Privacy Filter как bidirectional token-classification модель со span decoding. Проще: модель не генерирует новый текст по токенам, а за один проход размечает входную последовательность и собирает найденные фрагменты в цельные span-границы через constrained Viterbi decoding. Это важно для производительности: такие задачи часто стоят на входе в пайплайн и должны работать на больших объёмах текста.

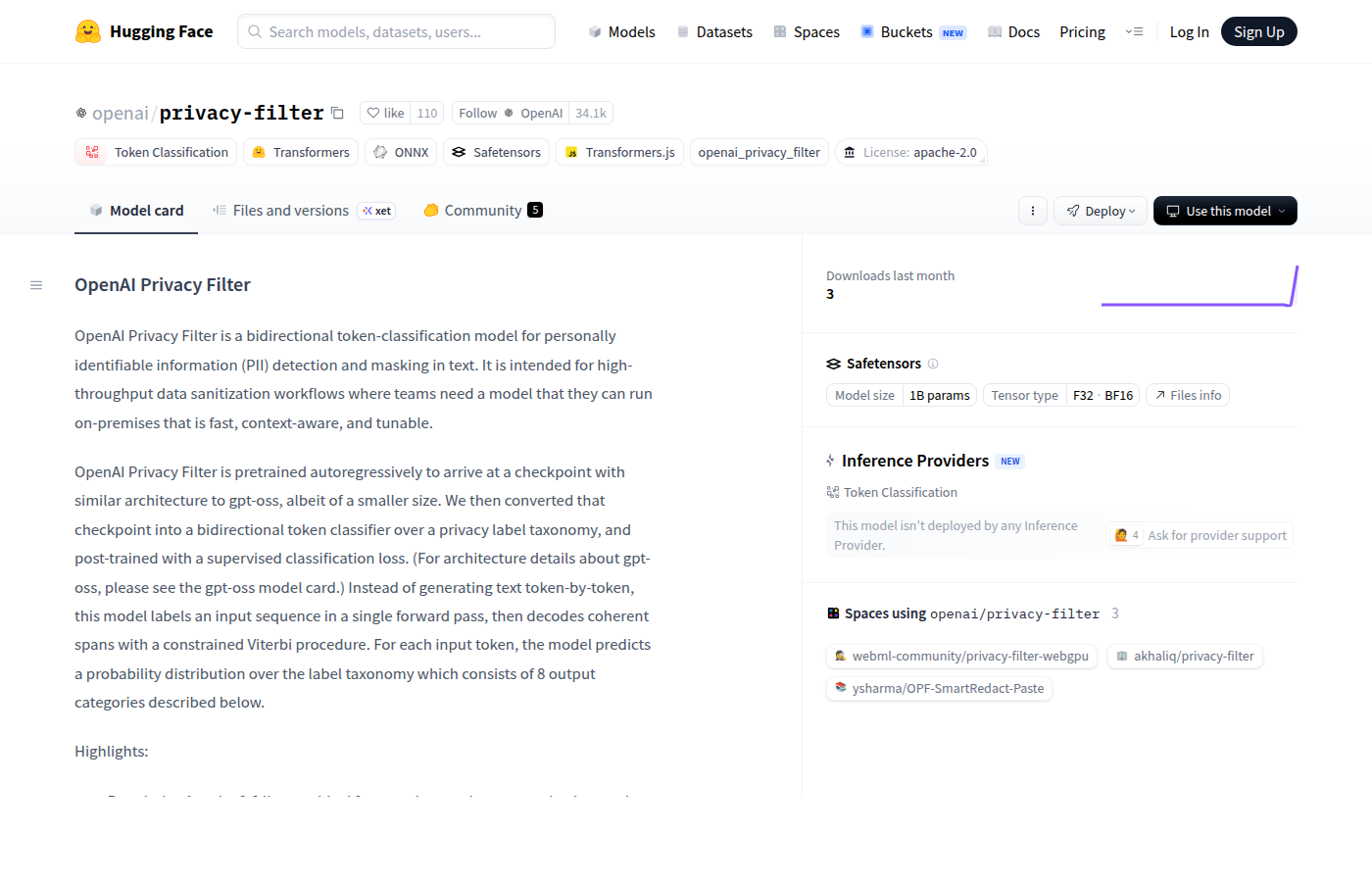

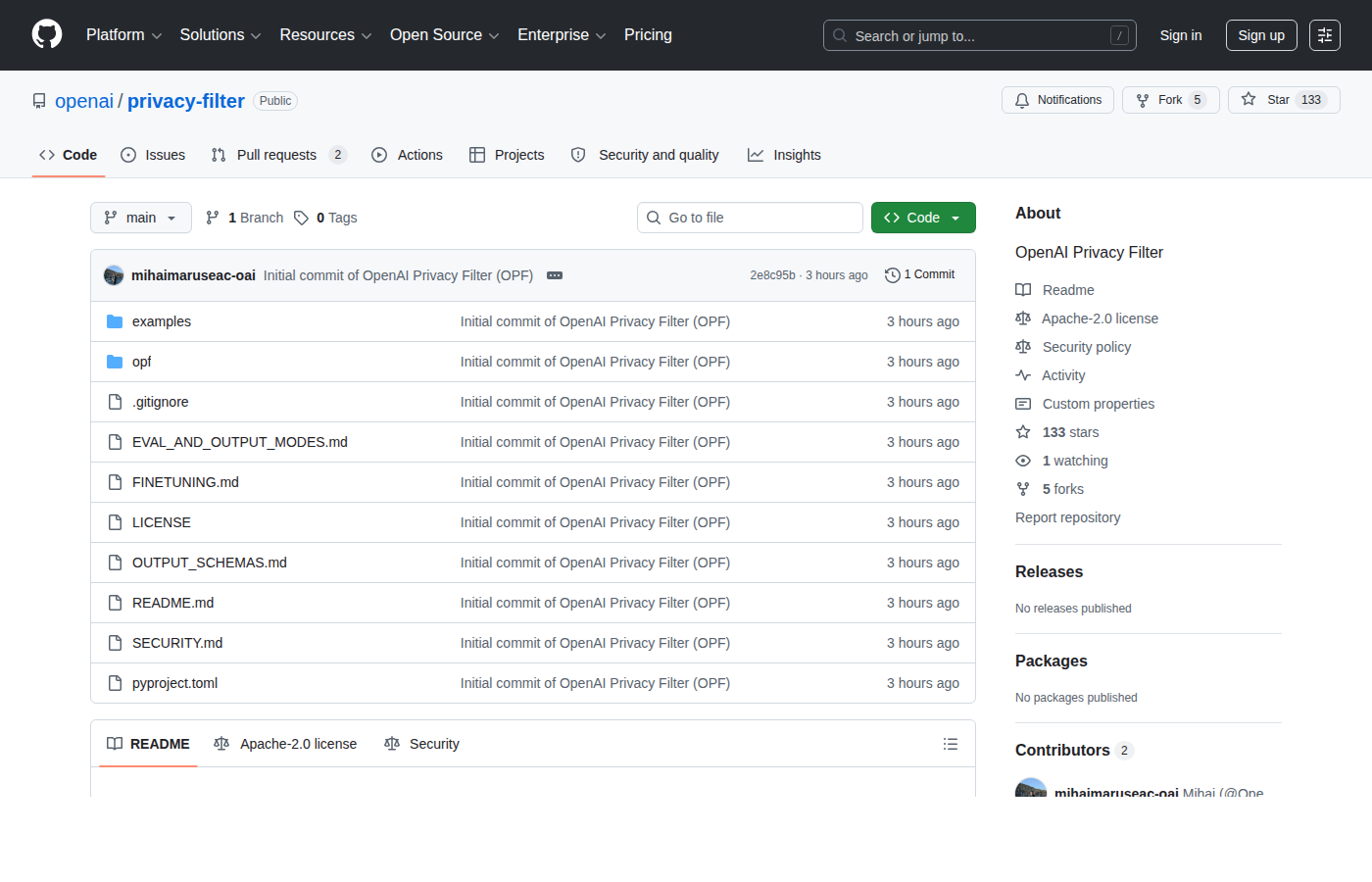

Релиз вышел под лицензией Apache 2.0 и доступен на Hugging Face и GitHub. В официальном анонсе OpenAI пишет, что released model поддерживает до 128 000 токенов контекста, имеет 1,5 млрд total parameters и 50 млн active parameters. В model card и на Hugging Face отдельно указано, что язык модели — primarily English, а мультиязычная устойчивость проверялась ограниченно. Для русского текста это не запрет, но точно повод тестировать на своих данных, а не переносить английские метрики как гарантию.

| Параметр | Проверенный факт | Источник |

|---|---|---|

| Назначение | Детекция и маскирование PII в неструктурированном тексте | OpenAI release, Hugging Face model card |

| Архитектура | Bidirectional token-classification model with span decoding | OpenAI model card |

| Размер | 1,5 млрд total parameters и 50 млн active parameters | OpenAI release, model card |

| Контекст | До 128 000 токенов | OpenAI release, Hugging Face model card |

| Лицензия | Apache 2.0, разрешены эксперименты, кастомизация и коммерческое использование | Hugging Face, GitHub repo |

| Категории | 8 span-категорий: person, address, email, phone, URL, date, account number, secret | OpenAI release, model card |

| Бенчмарк | F1 96% на PII-Masking-300k; 97,43% на исправленной версии benchmark labels | OpenAI release, model card |

Зачем это нужно в ИИ-пайплайне

Самое полезное место для Privacy Filter — до того, как текст попадёт в систему, где его трудно контролировать. Например, перед загрузкой документов в RAG-индекс, перед сохранением пользовательских чатов в аналитическое хранилище, перед обучением или до того, как логи уйдут в общий observability-стек. В этих местах обычно и появляются неприятные утечки: не потому что команда хотела нарушить правила, а потому что чувствительные фрагменты тихо переезжают из одного инструмента в другой.

OpenAI в model card называет модель компонентом data minimization. Она находит кандидатов на чувствительные span-фрагменты и отдаёт их в downstream-систему, а уже та решает, что делать: маскировать, удалять, заменять, псевдонимизировать, отправлять на ревью или поднимать alert. Это нормальная инженерная граница. Модель не должна единолично решать юридическую судьбу данных, но может резко сократить объём сырого PII, который вообще доживает до следующих этапов обработки.

В этом смысле Privacy Filter хорошо ложится рядом с другими проверками приватности AI-инструментов для разработчиков. Мы уже разбирали, что нужно проверить в настройках GitHub Copilot до opt-out. Там проблема была в том, какие данные уходят поставщику. Здесь акцент другой: как заранее очистить данные, которые команда сама собирается отправить в ИИ-инфраструктуру.

Почему это не просто ещё одна модель OpenAI

22 апреля OpenAI выпустила не только Privacy Filter. В тот же день компания отдельно описала WebSocket-режим Responses API для агентных циклов: persistent connection, кеширование previous response state и до 40% ускорения agentic workflows у альфа-пользователей. Эти два анонса выглядят разными, но сигнал у них общий. Узким местом ИИ-продуктов всё чаще становится не только качество модели, а инфраструктура вокруг неё: транспорт, кеши, безопасность, приватность, контроль доступа и обработка данных до inference.

Privacy Filter попадает ровно в этот слой. Он не отвечает на вопрос, какая LLM умнее. Он отвечает на вопрос, что делать с текстом до того, как его увидит большая модель, индекс, лог-система или человек на ревью. Для команд, которые строят внутренние ассистенты, это может быть важнее очередного прироста в бенчмарке: утечка API-ключа или персонального адреса в логах обычно бьёт больнее, чем лишние 200 миллисекунд задержки.

Есть и рыночный контекст. Безопасность OpenAI всё чаще оформляет как отдельный инфраструктурный слой: от доверенного доступа к кибермоделям до инструментов для приватной предобработки данных. Мы писали об этом в материале про то, как OpenAI ограничивает доступ к модели для кибербезопасности. Privacy Filter продолжает ту же линию, только со стороны данных, а не атакующих и защитных возможностей.

Где у Privacy Filter границы

Самое опасное прочтение релиза — «теперь можно автоматически анонимизировать всё». OpenAI прямо пишет обратное: Privacy Filter не даёт anonymization, compliance certification или substitute for policy review. Это помощь для редактирования и минимизации данных, а не юридический штамп безопасности.

В model card перечислены типовые ошибки. Модель может пропустить редкие имена, региональные форматы, необычные идентификаторы, секреты в новом формате или куски credential, разбросанные по соседнему синтаксису. Бывает и обратное: лишняя маскировка публичных сущностей, организаций, общих слов, плейсхолдеров, хэшей или синтетических примеров, похожих на секреты. Для медицинских, юридических, финансовых, HR, образовательных и государственных данных OpenAI отдельно рекомендует осторожность, in-domain оценку и human review path.

Для русскоязычных команд ключевое ограничение — язык. В Hugging Face model card указано: primarily English; selected multilingual robustness evaluation reported. Значит, перед production нужно собрать свой набор примеров: ФИО на кириллице, отчества, адреса по российским форматам, номера договоров, внутренние id, локальные шаблоны телефонов, смешанные строки из кода и русского текста. Если на таком наборе модель пропускает важные span, её нужно дообучать или ставить рядом с правилами и ручной проверкой.

Как использовать без самообмана

Практичный стартовый сценарий выглядит так. Сначала команда выбирает одну точку входа: например, очистку support-транскриптов перед индексацией или фильтрацию логов перед отправкой в аналитику. Затем собирает небольшой валидационный набор из реальных, но безопасно подготовленных примеров. После этого проверяет precision, recall и долю ложной маскировки именно на своих данных, а не на абстрактном benchmark.

- Определите, какие категории из восьми вам действительно нужны: человек, адрес, почта, телефон, дата, приватный URL, номер счёта, secret.

- Проверьте модель на русском, смешанном английском и технических логах, если такие данные есть в продукте.

- Решите, что делать с найденными span: маскировать типом, удалять, заменять псевдонимом или отправлять на ревью.

- Не отключайте ручной контур для медицинских, юридических, финансовых и HR-сценариев.

- Зафиксируйте policy: какие данные нельзя отправлять в LLM даже после автоматической маскировки.

Если пайплайн уже сложный, отдельно проверьте логи и интеграции AI-инструментов. Они уже стали инфраструктурным риском, о чём хорошо видно на примере истории со взломом Vercel через AI-инструмент. Privacy Filter снижает один класс риска, но не закрывает доступы, токены, права плагинов и цепочки поставки.

Короткий вывод

OpenAI Privacy Filter стоит читать как инфраструктурный релиз. Это небольшая по меркам LLM модель, которая решает узкую задачу: найти и замаскировать чувствительные фрагменты текста до того, как они попадут в обучение, индекс, логи или ревью. Сильные стороны понятны: локальный запуск, permissive license, длинный контекст, один проход по тексту и неплохие benchmark-цифры.

Слабые места тоже понятны. Модель не гарантирует анонимность, не выдаёт compliance-сертификат и требует проверки на локальных данных. Для русскоязычной разработки это особенно важно: английские метрики помогают понять потенциал, но не заменяют тест на ваших документах, логах и пользовательских сообщениях.

Читайте также

- GitHub Copilot 24 апреля: что проверить до opt-out

- OpenAI ограничивает доступ к модели для кибербезопасности

- Взлом Vercel: AI-инструмент стал входом в инфраструктуру

Источники и проверка фактов

- OpenAI: Introducing OpenAI Privacy Filter, опубликовано 22 апреля 2026 года, проверено 22 апреля 2026 года.

- OpenAI Privacy Filter Model Card, 22 апреля 2026 года, проверено 22 апреля 2026 года.

- Hugging Face: openai/privacy-filter, проверено 22 апреля 2026 года.

- GitHub: openai/privacy-filter, проверено 22 апреля 2026 года.

- OpenAI: Speeding up agentic workflows with WebSockets in the Responses API, опубликовано 22 апреля 2026 года, проверено 22 апреля 2026 года.