OpenAI ограничивает доступ к модели для кибербезопасности

OpenAI ещё в декабре описала доверенный доступ к кибермоделям. После Project Glasswing этот подход уже выглядит новой нормой рынка.

OpenAI ограничивает доступ к модели для кибербезопасности, но здесь важно не перепутать дату инфоповода с датой самого решения. 9 апреля 2026 года The Decoder со ссылкой на Axios написал, что OpenAI готовит продвинутый ИИ-продукт для кибербезопасности только для узкого круга компаний. Однако сама логика ограниченного доступа у OpenAI была публично описана раньше: 18 декабря 2025 года компания связала GPT-5.2-Codex с пилотом доступа по приглашениям, а 5 февраля 2026 года запустила Trusted Access for Cyber как отдельную программу.

Поэтому главная новость не в том, что OpenAI «сегодня внезапно закрыла новую модель». Новость в другом: после запуска Anthropic Project Glasswing стало окончательно видно, куда идёт рынок. Самые сильные модели для оборонительной кибербезопасности и поиска уязвимостей всё реже выводят в обычный публичный доступ. Вместо этого разработчики строят режим доверенного доступа, проверку личности и отдельные программы для исследователей и корпоративных защитных команд.

По состоянию на 9 апреля 2026 года OpenAI не объявляла массовый публичный релиз отдельной модели для взлома. Подтверждённый факт другой: компания последовательно переводит самые сильные кибербезопасностные возможности в режим ограниченного доступа для защитных сценариев.

Что именно OpenAI подтвердила официально

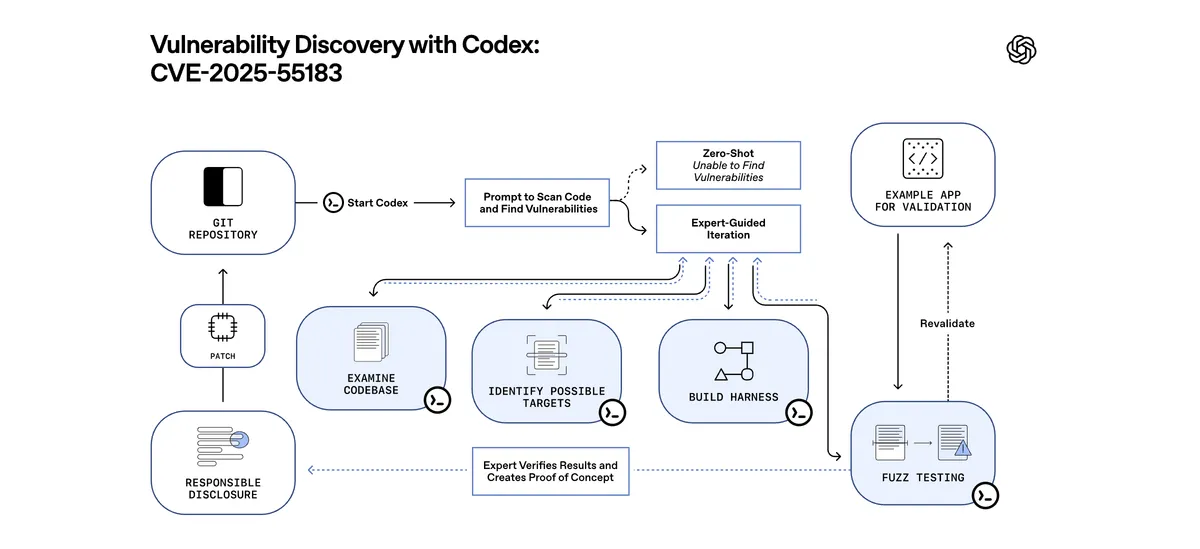

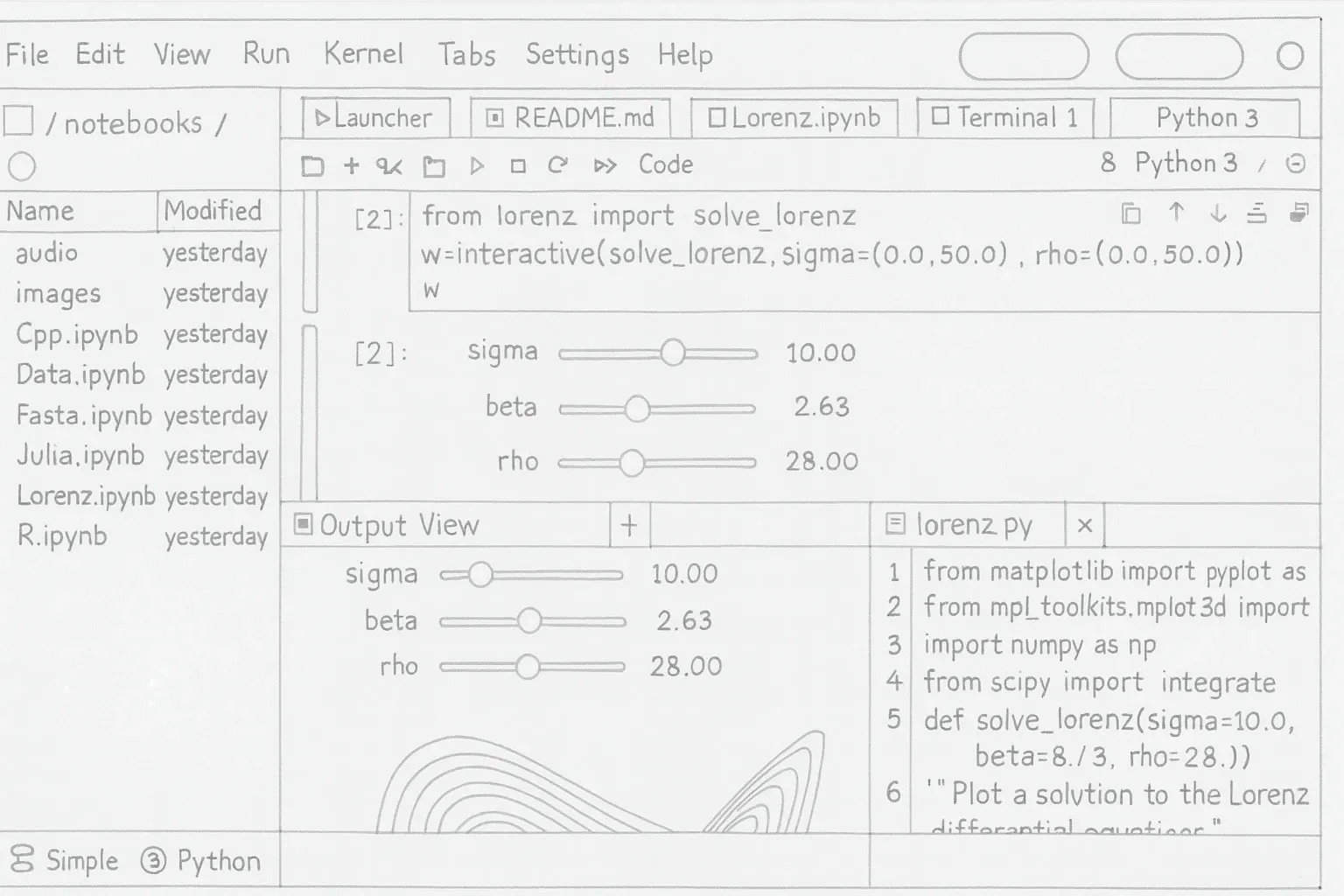

Самая важная официальная точка отсчёта — анонс GPT-5.2-Codex от 18 декабря 2025 года. Тогда OpenAI прямо написала, что GPT-5.2-Codex сильнее предыдущих выпущенных моделей в задачах кибербезопасности, но пока не достигает уровня High по Preparedness Framework. В том же тексте компания отдельно заявила, что параллельно пилотирует доступ по приглашениям к будущим возможностям и моделям с более мягкими ограничениями для проверенных специалистов и организаций, которые занимаются оборонительной кибербезопасностью.

Через несколько недель, 5 февраля 2026 года, OpenAI вынесла эту логику в отдельный материал Introducing Trusted Access for Cyber. Там сказано ещё жёстче: GPT-5.3-Codex — это самая сильная кибербезопасностная модель OpenAI на тот момент, а сама программа Trusted Access for Cyber строится как система доверенного доступа на основе проверки личности и статуса пользователя. Для потенциально рискованной работы в кибербезопасности компания предлагает три контура: верификацию личности через chatgpt.com/cyber, командный доверенный доступ для корпоративных клиентов и отдельную программу по приглашениям для тех, кому нужны ещё менее зажатые модели.

Важна и экономическая деталь. В этом же анонсе OpenAI пообещала $10 млн в кредитах API через Cybersecurity Grant Program. То есть речь идёт не только об ограничениях, но и о попытке направить сильные модели в защитную работу раньше, чем ими начнут массово пользоваться атакующие.

Почему об этом снова заговорили именно 9 апреля

Новый виток обсуждения запустила публикация The Decoder от 9 апреля 2026 года со ссылкой на Axios. В ней говорится, что OpenAI работает над новым ИИ-продуктом с продвинутыми возможностями в кибербезопасности и планирует оставить доступ к нему только у небольшой группы компаний. Даже если смотреть только на эту публикацию, она не выглядит как анонс массового запуска. Напротив, медиа прямо описывает модель распространения, где сильные кибербезопасностные возможности изначально попадают в ограниченный контур.

Именно здесь многие могут запутаться в датах. Если читать только заголовок The Decoder, легко решить, что OpenAI ввела ограничения только сейчас, в апреле 2026 года. Официальные страницы компании показывают другую картину: курс на закрытый контур доступа был обозначен ещё в декабре 2025-го и формализован в феврале 2026-го. Апрельская новость важна скорее как рыночный сигнал: теперь этот подход читается уже не как внутренняя мера OpenAI, а как общая траектория крупных разработчиков.

Это хорошо сочетается и с более ранним декабрьским текстом OpenAI Strengthening cyber resilience as AI capabilities advance. Тогда компания писала, что результаты в capture-the-flag задачах выросли с 27% у GPT-5 в августе 2025 года до 76% у GPT-5.1-Codex-Max в ноябре 2025-го. И там же OpenAI заранее предупреждала: по мере роста кибербезопасностных возможностей придётся менять не только защитные меры, но и сам режим доступа к таким системам.

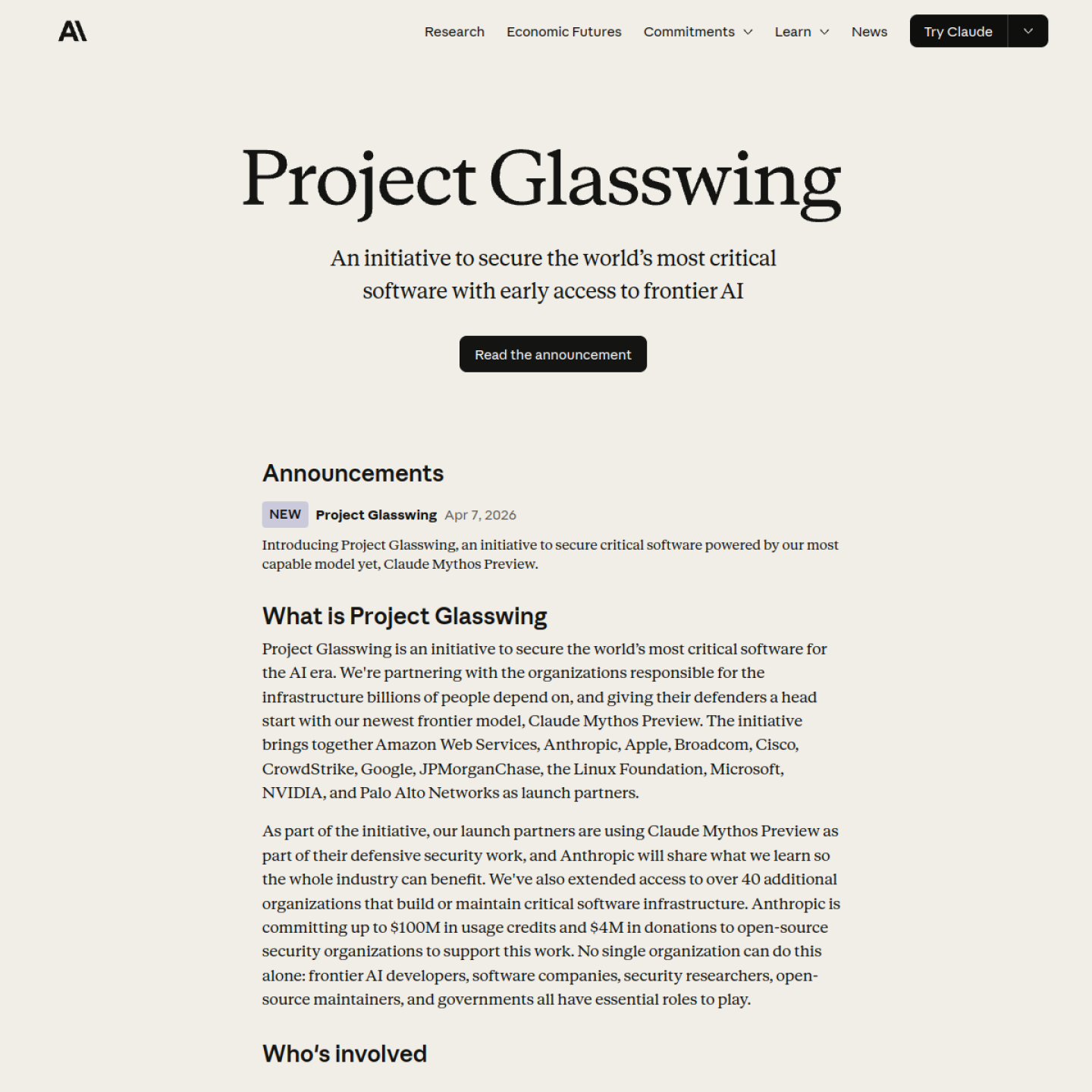

Чем это похоже на Anthropic Project Glasswing

Сходство стало особенно заметно после запуска Project Glasswing у Anthropic 7 апреля 2026 года. В официальном анонсе компания написала, что Claude Mythos Preview доступна не широкой публике, а стартовым партнёрам вроде AWS, Apple, Google, Microsoft, Cisco, CrowdStrike и ещё более чем 40 организациям, которые отвечают за критически важное ПО и инфраструктуру. Формально это не «ещё один релиз модели», а отдельная оборонительная программа раннего доступа.

Если убрать брендинг, логика у Anthropic и OpenAI сейчас очень похожая. Обе компании исходят из одного допущения: сильные модели для поиска и проверки уязвимостей полезны защитникам, но слишком опасны для режима «открыли всем и посмотрели, что будет». Разница пока в степени жёсткости. Anthropic с самого старта Glasswing делает акцент на закрытом исследовательском доступе и партнёрской программе. OpenAI, судя по официальным материалам, строит более ступенчатую схему: обычные защитные меры для всех, доверенный доступ для проверенных пользователей и отдельный контур по приглашениям для более свободного режима работы.

Это важный разворот и для истории отношений двух компаний. Ещё недавно OpenAI и Anthropic публично расходились по риторике безопасности и коммерческого давления, о чём мы подробно писали в материале Anthropic vs OpenAI. Но в вопросе самых сильных моделей для кибербезопасности они сейчас неожиданно двигаются в одну сторону: не к свободному массовому релизу, а к режиму доверенного доступа.

Что это меняет для рынка ИИ и безопасности

Для рынка это, пожалуй, важнее любого очередного сравнения бенчмарков. Ещё год назад разговор про сильные модели в кибербезопасности обычно сводился к тому, насколько хорошо они пишут код, проходят CTF или помогают разбирать баги. Теперь появляется новый слой: кто вообще может пользоваться этими возможностями, в каком режиме, с какой верификацией и под какие обязательства.

Проще говоря, передовые модели для кибербезопасности начинают жить по правилам инфраструктуры повышенного риска. Они всё ещё остаются продуктом, но уже не похожи на обычный сервис по подписке, который можно раздать всей аудитории одним переключателем. Здесь важны проверка личности, правила использования, мониторинг, ограничение более свободных режимов и отдельные программы для доверенных защитных команд.

Для команд безопасности это одновременно хорошая и неудобная новость. Хорошая — потому что крупнейшие разработчики явно хотят дать защитникам преимущество и готовы субсидировать такой доступ грантами и кредитами. Неудобная — потому что эпоха «просто купим API и будем делать всё сами» для самых сильных кибербезопасностных возможностей, похоже, заканчивается. Чем ближе модель к реальному поиску zero-day уязвимостей и сложным агентным сценариям, тем выше шанс, что доступ к ней будет не общим, а договорным.

На этом фоне особенно логично выглядит и другая линия OpenAI вокруг оборонительной безопасности. В марте компания запустила Safety Bug Bounty для рисков злоупотребления и безопасностных сбоев, связанных в том числе с агентными продуктами. В отрыве от сегодняшней темы это могло бы выглядеть как отдельная инициатива. Вместе с Trusted Access for Cyber складывается более цельная картина: OpenAI одновременно усиливает контроль, расширяет исследовательские каналы и пытается направить наиболее опасные возможности в оборонительный контур.

Итог

На 9 апреля 2026 года главный вывод звучит так: OpenAI не просто «ограничила доступ к одной модели». Компания вместе с Anthropic фактически помогает закрепить новую норму для рынка. Если передовая модель заметно усиливает защитную кибербезопасность, она одновременно повышает и риск злоупотребления. Значит, вопрос уже не только в качестве модели, но и в режиме её допуска.

Поэтому апрельский инфоповод стоит читать не как локальную новость про один продукт, а как подтверждение более крупного сдвига. Самые опасные и полезные ИИ-возможности для кибербезопасности уходят от логики массового релиза к логике доверенного доступа. И это, скорее всего, только начало.