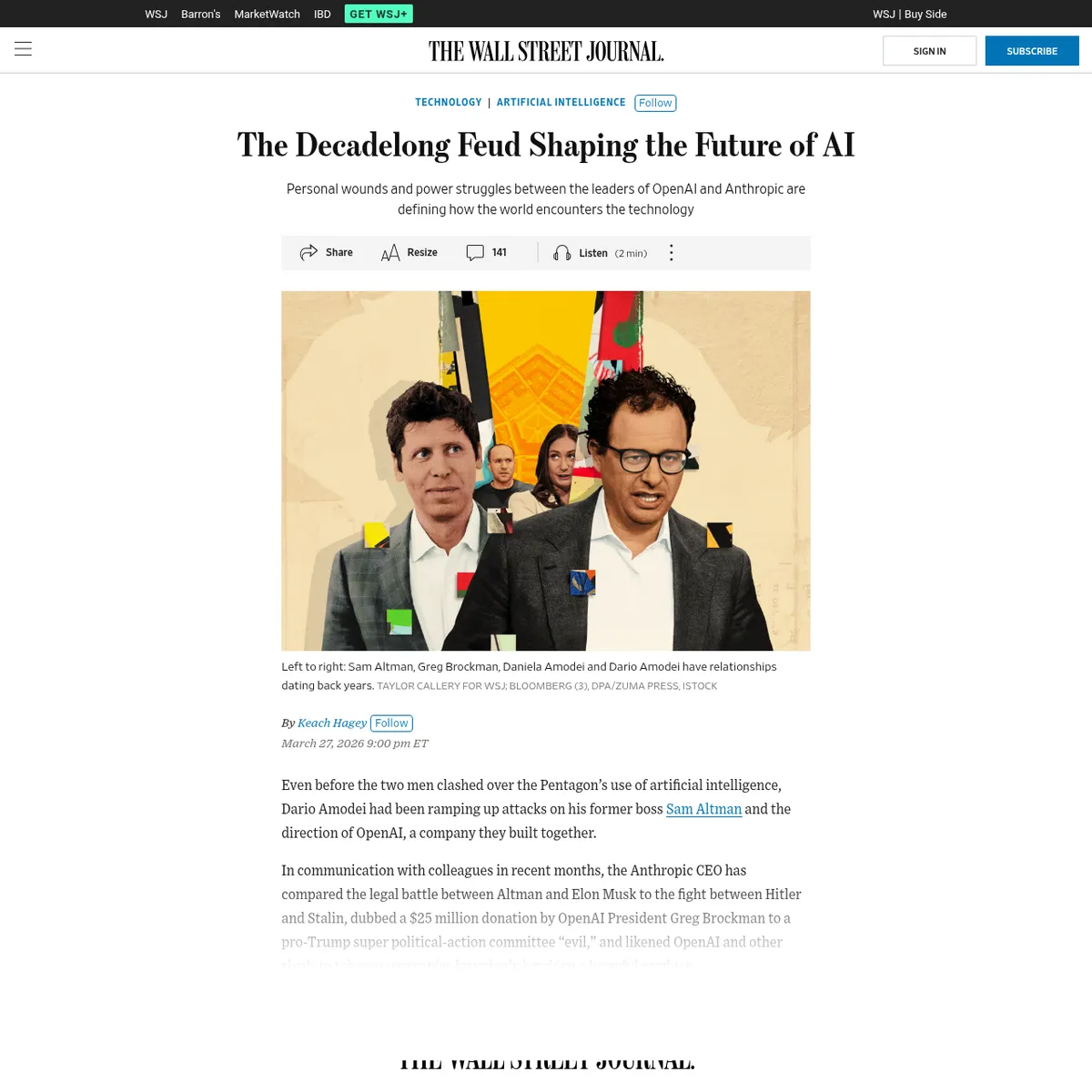

Anthropic vs OpenAI: «табачная индустрия», контракт Пентагона и десятилетняя вражда

Биограф Сэма Альтмана Кич Хейги опубликовала расследование о расколе OpenAI и Anthropic. Внутри Anthropic сравнивают OpenAI с табачной индустрией, а Дарио Амодеи назвал заявления Альтмана «прямой ложью».

Биограф Сэма Альтмана Кич Хейги (Keach Hagey) из Wall Street Journal опубликовала расследование о причинах раскола между OpenAI и Anthropic. Внутри Anthropic сравнивают OpenAI с табачной индустрией, а Дарио Амодеи в записке сотрудникам назвал заявления Альтмана «прямой ложью». Хронология конфликта от 2016 года до контракта с Пентагоном в марте 2026-го.

С чего всё началось: 2016–2020

Дарио Амодеи пришёл в OpenAI в 2016 году как исследователь, а потом стал вице-президентом по исследованиям. По данным расследования Хейги, философские расхождения с сооснователем OpenAI Грегом Брокманом начались практически сразу.

Один из первых серьёзных споров касался будущего AGI. Обсуждался вопрос, допустимо ли продавать технологию искусственного общего интеллекта правительствам или ядерным державам, членам Совета Безопасности ООН. Амодеи считал это абсолютно неприемлемым. Брокман не разделял эту позицию.

Конфликт углублялся. Амодеи был одной из ключевых фигур при создании GPT-2 и GPT-3 и, по данным Хейги, пытался минимизировать влияние Брокмана на эти проекты. Одновременно сам Амодеи чувствовал, что его оттесняют: не приглашали на важные встречи (включая встречу с Бараком Обамой), не давали должного признания. К концу 2020 года терпение лопнуло — Дарио и его сестра Даниэла Амодеи покинули OpenAI вместе с несколькими сотрудниками.

В 2021 году они основали Anthropic.

«Табачная индустрия»: как Anthropic видит OpenAI

Кич Хейги описывает, как внутри Anthropic укоренился вполне определённый взгляд на бывших коллег. Сотрудники компании сравнивают OpenAI Сэма Альтмана с табачной индустрией, имея в виду, что компания сознательно продвигает потенциально опасный продукт ради прибыли, при этом публично заявляя о приверженности безопасности.

Anthropic позиционирует себя как «здоровую альтернативу» — компания, которая серьёзно относится к безопасности, а не только декларирует её.

Контракт Пентагона: точка кипения

В феврале 2026 года конфликт стал публичным и политическим.

Anthropic с июля 2025 года работала с Пентагоном по контракту стоимостью до $200 миллионов. Но в ходе переговоров о новых условиях компания отказалась от сделки — по данным Reuters, из-за недостаточных гарантий безопасности при использовании AI в военных целях. Anthropic не смогла согласовать условия к дедлайну 27 февраля 2026 года.

Реакция оказалась жёсткой. Министр обороны Пит Хегсет объявил Anthropic «риском для цепочки поставок» (supply chain risk) — беспрецедентное для технологической компании обозначение. В тот же день OpenAI объявила о собственном соглашении с Пентагоном.

4 марта 2026 года Дарио Амодеи отправил сотрудникам меморандум на 1 600 слов. По данным TechCrunch и The Information, он назвал заявления OpenAI по поводу военного контракта «прямой ложью» (straight up lies) и написал, что Альтман «ложно представляет себя защитником безопасности». Амодеи также обвинил OpenAI в том, что компания получила контракт потому что, в отличие от Anthropic, «давала диктаторски-льстивые комплименты Трампу».

Отдельно Амодеи назвал пожертвование Грега Брокмана в $25 миллионов про-трамповскому Super PAC «злом» (evil).

На следующей неделе у офиса OpenAI в Сан-Франциско появились надписи мелом на тротуаре: «Where are your redlines?» («Где ваши красные линии?»). По данным CNN, часть сотрудников OpenAI были недовольны решением руководства.

Хронология конфликта

| Год | Событие |

|---|---|

| 2016 | Дарио Амодеи приходит в OpenAI. Первые разногласия с Грегом Брокманом о подходе к безопасности |

| 2018–2019 | Спор за контроль над проектами GPT-2 и GPT-3. Амодеи пытается ограничить влияние Брокмана |

| 2019–2020 | Амодеи чувствует себя оттеснённым: не приглашён на ключевые встречи, включая встречу с Обамой |

| Конец 2020 | Дарио и Даниэла Амодеи покидают OpenAI с группой сотрудников |

| 2021 | Основание Anthropic. Фокус на «ответственный» подход к AI |

| Июль 2025 | Anthropic получает контракт с Пентагоном на $200 млн |

| Февраль 2026 | Anthropic отказывается от военного контракта. Пентагон объявляет компанию «supply chain risk». OpenAI забирает контракт |

| Март 2026 | Амодеи называет заявления Альтмана «прямой ложью» в меморандуме. Хейги публикует расследование о причинах раскола |

Почему это больше чем корпоративная драма

Конфликт Anthropic и OpenAI давно вышел за рамки личных обид двух менеджеров. За ним стоит практический вопрос: можно ли одновременно гнаться за оценкой в сотни миллиардов и реально контролировать безопасность AI?

OpenAI выбрала агрессивное масштабирование: контракт с Пентагоном, конвертация в коммерческую структуру, гонка за $110 миллиардами оценки. Эта же развилка позже стала одной из центральных тем в споре Маска и OpenAI о миссии, контроле и коммерческой модели. Anthropic пошла другим путём и заплатила за это потерей военного контракта и ярлыком «supply chain risk» от правительства США.

При этом Anthropic тоже не свободна от противоречий. В феврале 2026 года Дарио Амодеи публично заявил, что «глубоко обеспокоен» тем, что компании сами себя регулируют в сфере AI (Fortune, 19 февраля 2026). Но его собственная компания при этом тоже налаживала контакты с администрацией Трампа, до тех пор, пока переговоры не провалились.

Между тем исследователи безопасности уходят и из OpenAI, и из Anthropic (Medium, 22 марта 2026). Ни одна из двух компаний пока не доказала, что способна ставить безопасность выше коммерческих интересов на практике, а не на словах.

Книга Кич Хейги: «The Optimist»

Расследование о расколе — часть более широкой работы Хейги. Её книга «The Optimist: Sam Altman, OpenAI, and the Race to Invent the Future» вышла в 2025 году в издательстве W.W. Norton. New York Times Book Review назвал книгу «отлично написанной и глубоко проработанной» (excellent and deeply reported). Это первая крупная биография Альтмана, основанная на интервью с десятками бывших и действующих сотрудников OpenAI.

28 марта 2026 года Хейги опубликовала отдельное расследование специально о расколе OpenAI–Anthropic, которое и легло в основу этой статьи.

За заявлениями о «миссии» и «безопасности» в крупнейших AI-компаниях стоит борьба за влияние, деньги и государственные контракты. Расследование Хейги показывает это в деталях, которые ни OpenAI, ни Anthropic обычно не афишируют.