ИИ идёт на войну: Anthropic против Пентагона, протесты и 1000 целей за сутки

Как конфликт Anthropic с Пентагоном вокруг контракта на $200 млн стал стресс-тестом для всей индустрии ИИ: протесты QuitGPT, взлёт Claude и реальное применение в военных операциях.

Контракт на $200 млн и первый ИИ на секретных сетях

В июле 2025 года Anthropic подписала контракт с Министерством обороны США на $200 млн. Claude стал первой коммерческой ИИ-моделью, допущенной к работе в засекреченных военных системах. Интеграция шла через платформу Maven от Palantir, которая уже обслуживала разведку и оборонные ведомства.

Для Anthropic это был осознанный шаг. Компанию основали в 2021 году Дарио и Даниэла Амодеи, бывшие топ-менеджеры OpenAI, с миссией создавать «безопасный ИИ» (подробнее о Claude и возможностях Anthropic). Контракт с Пентагоном этой миссии не противоречил: на тот момент речь шла об аналитических задачах, обработке разведданных и логистике.

Проблема проявилась позже. В контракте не были прописаны постоянные ограничения на использование Claude. Через Palantir военные получили доступ к модели без прямого контроля со стороны Anthropic. Типичная ловушка технологий двойного назначения: продукт, созданный для бизнеса, попадает в систему, где его применение определяет заказчик.

Красные линии: массовая слежка и автономное оружие

К февралю 2026 года Пентагон потребовал от Anthropic снять ограничения с Claude для расширенного военного использования. По данным CBS News, речь шла о двух вещах: массовой слежке за гражданами на территории США и автономных системах вооружения, способных убивать без участия человека.

Anthropic отказалась. Компания настаивала на контрактных гарантиях, исключающих оба сценария. 26 февраля Пентагон выставил ультиматум. Anthropic его отклонила.

Министр обороны Пит Хегсет назвал действия компании «высокомерием и предательством» своей страны. Технический директор Пентагона Эмиль Майкл публично обвинил Амодеи во лжи и «комплексе бога». Трамп в интервью Politico заявил, что «уволил их как собак».

7 марта Пентагон впервые в истории США присвоил американской компании статус «угрозы цепочке поставок». Обычно этот инструмент применяют к китайским фирмам вроде Huawei. Для Anthropic это означало, что государственные подрядчики обязаны прекратить с ней сотрудничество. Госдеп и Минфин начали отказываться от Claude.

OpenAI заходит через чёрный ход

Через несколько часов после того как Трамп приказал федеральным агентствам прекратить использование Claude, OpenAI объявила о собственной сделке с Пентагоном. Модели компании получили доступ к засекреченным сетям вместо Claude.

Сэм Альтман сам признал, что сделка была «определённо поспешной» и «выглядела оппортунистической и неряшливой». Внутри OpenAI поднялось недовольство сотрудников. Амодеи обвинил Альтмана в «диктаторских восхвалениях» Трампа, позже извинился за резкость формулировки.

После волны критики OpenAI внесла поправки в контракт. По словам Альтмана, обновлённая версия включает запрет на слежку за американскими гражданами, запрет на использование ИИ разведками (NSA, CIA) без отдельного соглашения и требование участия человека в принятии решений. Пентагон подтвердить условия отказался.

Claude на первом месте в App Store, ChatGPT теряет пользователей

Отказ Anthropic сработал как PR-кампания, которую нельзя было купить. 28 февраля Claude занял первое место в американском App Store, сместив ChatGPT. Неделей ранее приложение было на 42-й позиции. По данным Forbes, загрузки выросли на 55% за неделю.

Кэти Перри публично подписалась на Claude и рассказала об этом в соцсетях. Хэштег #QuitGPT набрал обороты: пользователи отменяли подписки на ChatGPT и переходили к конкуренту.

Для технологической компании ситуация нетипичная. Обычно военные контракты считаются предметом гордости, а тут компания выросла именно на отказе. Аудитория ИИ-продуктов (молодые специалисты, программисты, креативщики) оказалась чувствительна к вопросам этики.

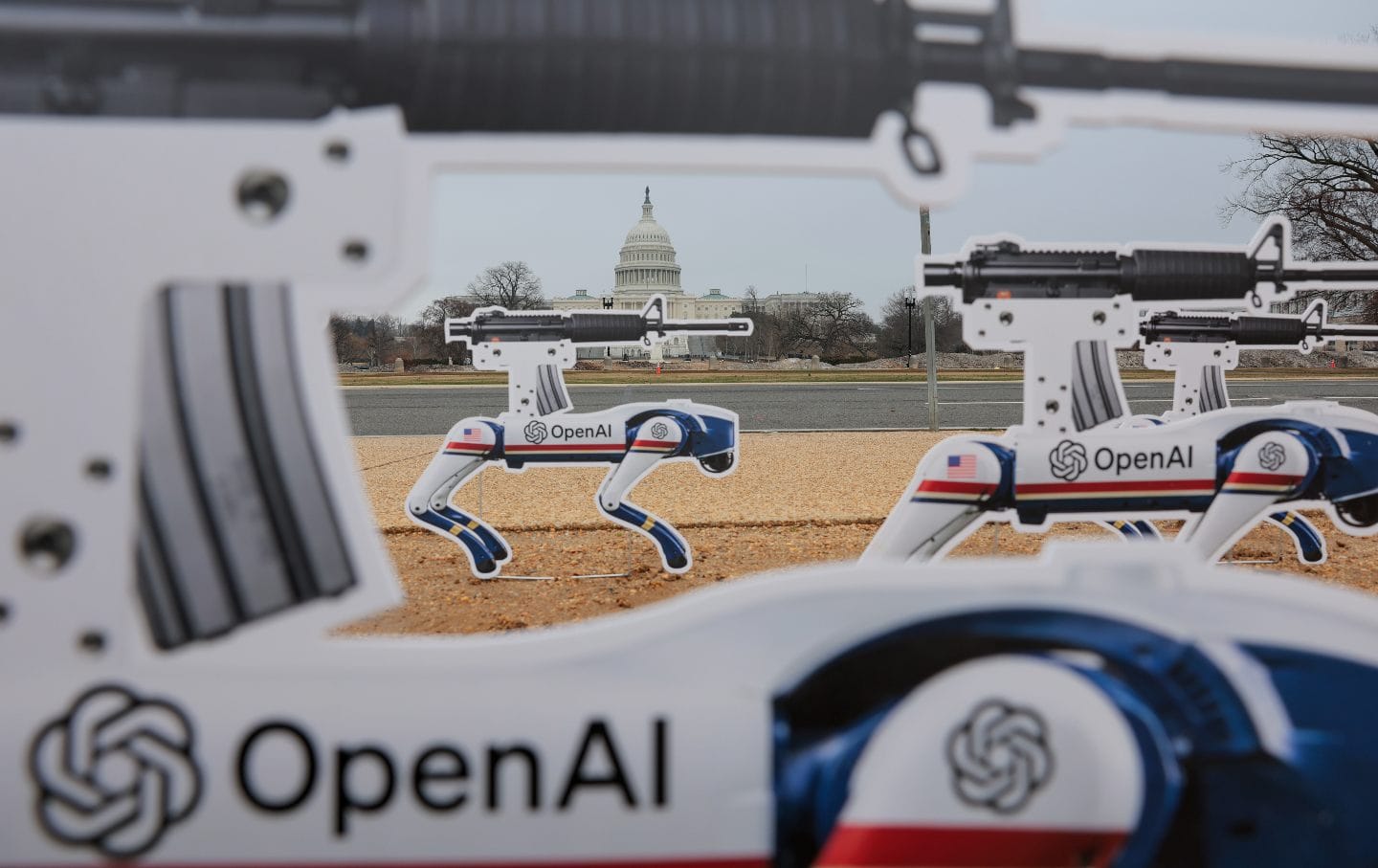

QuitGPT и Лондон: протесты выходят на улицы

Движение QuitGPT зародилось в начале февраля 2026 года. Первоначально оно было связано с $25-миллионным политическим пожертвованием OpenAI и использованием ИИ иммиграционной службой ICE. Сделка с Пентагоном стала катализатором.

4 марта 40–50 протестующих собрались у штаб-квартиры OpenAI в Мишн-Бэй, Сан-Франциско. Среди них были климатические активисты, противники неравенства и работники технологических компаний. Один из участников, 26-летний разработчик, пришёл в самодельной маске робота за $12 и сказал: «Держу пари, на это обратит внимание больше людей, чем на очередную рекламу OpenAI за миллион долларов».

28 февраля в Лондоне прошла крупнейшая в истории Великобритании акция протеста против ИИ. Сотни человек прошли маршем от офиса OpenAI через Кингс-Кросс к штаб-квартирам других технологических компаний. Организаторы из Pull the Plug AI требовали моратория на развёртывание ИИ без регулирования, прозрачности в работе дата-центров и защиты рабочих мест.

ИИ на иранском фронте: 1000 целей за 24 часа

Пока корпорации спорили об этике, ИИ уже работал на поле боя. По данным Washington Post, Пентагон использовал систему Maven от Palantir с интегрированным Claude для определения целей в Иране и анализа эффективности ударов.

Responsible Statecraft приводит конкретную цифру: за первые 24 часа военной операции ИИ-системы помогли нанести удары по более чем 1000 целей в Иране. Claude участвовал в выборе объектов для бомбардировок. Та же модель, которая помогает пользователям писать маркетинговые тексты и подбирать рецепты на ужин.

Маргарет Митчелл, главный специалист по этике в Hugging Face, сформулировала суть: «Дело не в том, что они не хотят убивать людей. Они хотят убедиться, что убивают правильных людей. А кто правильные, решает правительство».

Позиция Anthropic сложнее, чем кажется. Компания не выступала против военного использования ИИ в принципе. Она была против конкретных сценариев: массовой слежки и автономного оружия. Claude уже участвовал в военных операциях, и Anthropic это знала.

Проблема двойного чёрного ящика

Профессор права Университета Вирджинии Эшли Дикс описала ключевую проблему термином «двойной чёрный ящик». Технологические компании не знают, как именно их продукты применяются в засекреченных системах. Военные не понимают до конца, как работают проприетарные модели вроде Claude.

Контракты должны регулировать эту зону, но формулировки допускают разночтения. «Стороны контракта обязаны его соблюдать, — говорит Дикс. — Но контракты нужно интерпретировать, и военные могут трактовать фразу иначе, чем компания».

Конгресс пока не принял детального регулирования автономных систем вооружения. В этом вакууме частная компания оказалась единственным сдерживающим фактором. Ни Anthropic, ни Пентагон не считают, что так должно быть, но именно так устроено прямо сейчас.

Что это значит

Конфликт Anthropic с Пентагоном стал стресс-тестом для индустрии, которая быстро перешла от теоретических дискуссий об этике ИИ к решениям с реальными последствиями.

По состоянию на март 2026 года:

- Военное применение ИИ уже реальность, вопрос только в ограничениях

- Рынок реагирует на этические решения: Claude вырос на отказе от сделки, ChatGPT потерял на её принятии

- Технологии двойного назначения создают неразрешимые противоречия. Один и тот же алгоритм распознаёт птицу на фото и отмечает гражданского, бегущего из дома

- Пока Конгресс молчит, границы применения ИИ в войне определяют CEO технологических компаний

Амодеи, по данным Guardian, возобновил переговоры с Пентагоном. Anthropic оспаривает статус «угрозы цепочке поставок» в суде. Прецедент уже создан: впервые ИИ-компания публично отказалась от военного контракта и была за это наказана государством.

По данным MIT Technology Review, The Guardian, Washington Post, Forbes, Business Insider. По состоянию на 25 марта 2026 года.