Open WebUI: когда веб-интерфейс поверх Ollama действительно нужен

Практический разбор Open WebUI на май 2026 года: когда он полезен поверх Ollama, как избежать типичных ошибок подключения и где начинаются командные сценарии.

Проверено 5 мая 2026 года. Open WebUI нужен не вместо Ollama, а поверх него. Сам Ollama решает запуск модели и локальный API. Open WebUI добавляет другой слой: браузерный интерфейс, общий доступ, документы, инструменты, разграничение прав и подключение не только к локальным моделям, но и к OpenAI-совместимым провайдерам.

Если вы работаете один, общаетесь с одной локальной моделью и вам хватает терминала или простого клиента, Open WebUI может оказаться лишней прослойкой. Но как только появляется команда, несколько моделей, знания из файлов, внешние инструменты или необходимость вынести локальный стек из CLI в общий веб-контур, продукт становится заметно полезнее. Для базового слоя запуска сначала посмотрите наш материал про Ollama и локальный запуск LLM: он отвечает на вопрос, когда локальный стек нужен вообще.

Если нужен более широкий контекст по стеку локальных и облачных моделей, начните с полного гайда по LLM для разработчиков. А если вы ещё не определились с самим семейством моделей, держите рядом разбор open-weight моделей и маршрут выбора языковой модели.

Где Open WebUI даёт реальную пользу

Есть четыре сценария, в которых Open WebUI обычно оправдан.

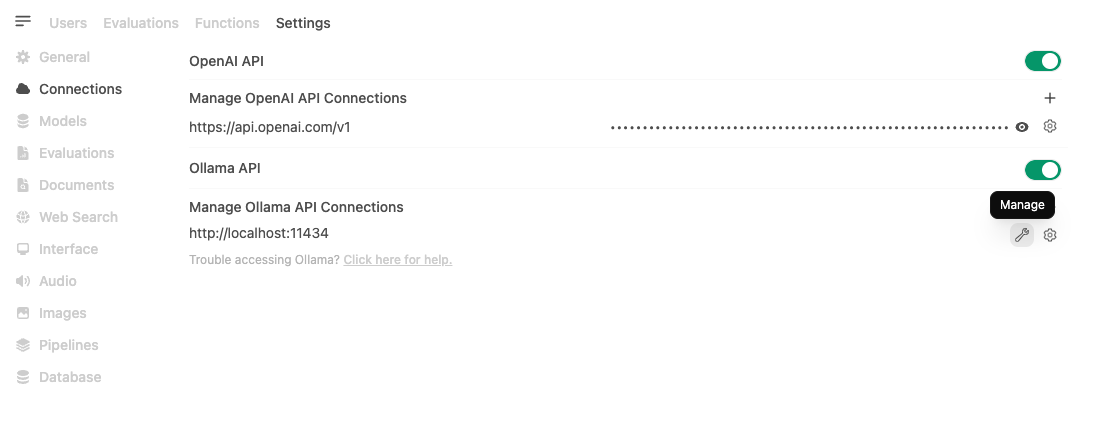

- Локальные модели надо отдать не только себе, но и коллегам через нормальный веб-интерфейс, а не через shell-команды и разрозненные локальные клиенты.

- Нужен один интерфейс сразу для Ollama, облачных API и совместимых inference-серверов, чтобы не плодить разные окна, учётки и UX-паттерны.

- Надо прикрутить документы, поиск, инструменты, внутренние API или agent-поведение поверх моделей, не собирая свой фронтенд с нуля.

- Нужны базовые админские механизмы: роли, группы, права, общие настройки и контроль того, кто вообще может создавать инструменты или подключать внешние серверы.

Если же ваш сценарий звучит как «поднять одну модель на ноутбуке и иногда спросить у неё кодовый фрагмент», Open WebUI не является обязательным. В таком случае чаще достаточно голого Ollama или другого локального клиента. Эта развилка важнее любого списка фич.

Что такое Open WebUI в 2026 году

На главной странице проекта Open WebUI описан как self-hosted AI platform, рассчитанная на полностью offline-режим и поддерживающая Ollama и OpenAI-compatible API. Это точное описание, если убрать маркетинговую пыль: продукт не привязан к одной модели и не ограничивается только локальным inference. Он работает как универсальная веб-оболочка над разными модельными бэкендами.

Из актуальной документации видно, что у проекта уже давно не один путь установки. Есть Docker, pip, uv и desktop-приложение. Но сама документация отдельно предупреждает: desktop app пока experimental, а для production-сценариев лучше ставить Open WebUI через Docker или Python. Это правильный сигнал. Если вы делаете командный контур, стабильность и предсказуемое обновление важнее «красивой» локальной упаковки.

Ещё один признак зрелости: по состоянию на 5 мая 2026 года GitHub-репозиторий Open WebUI показывает около 135 тысяч звёзд, а последним релизом указан v0.9.2 от 24 апреля 2026 года. Это не гарантия качества архитектуры, но хороший индикатор того, что проект давно вышел из режима нишевой обвязки над Ollama и живёт как самостоятельная платформа.

Быстрый старт: Docker, Python или uv

Самый прямой путь из официальной документации остаётся Docker-вариант. Он хорош тем, что не требует ручной сборки и сразу даёт воспроизводимую установку.

docker run -d -p 3000:8080 \

--add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:mainПосле этого интерфейс обычно открывается на http://localhost:3000. Если Docker вам не нужен, документация даёт и Python-путь:

pip install open-webui

open-webui serveЕсть и вариант через uv:

DATA_DIR=~/.open-webui uvx --python 3.11 open-webui@latest serveПрактически выбор простой. Docker удобнее для сервера, командного доступа и обновлений. Python или uv удобнее для локальных экспериментов и отладки. Desktop-режим пока стоит воспринимать как удобный бонус, а не как базу для продакшена.

Как подключить Ollama без типичных ошибок

У Open WebUI есть важная архитектурная оговорка: режим Ollama в настройках означает именно работу с протоколом Ollama API, обычно на порту 11434. Документация прямо пишет, что этот тип подключения оптимизирован под возможности самого Ollama, включая нативное управление моделями и загрузку моделей из админского интерфейса. Если ваш backend на деле говорит по OpenAI-совместимому API, как LocalAI или Docker Model Runner, Open WebUI рекомендует не маскировать его под Ollama, а использовать OpenAI-compatible path.

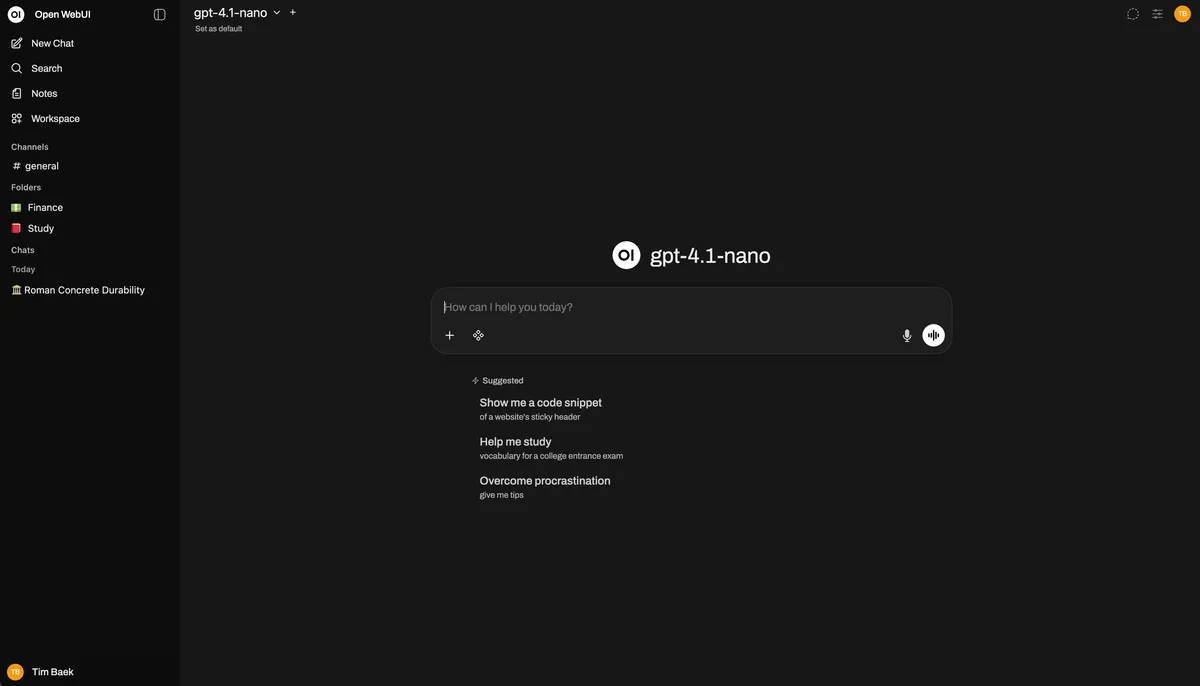

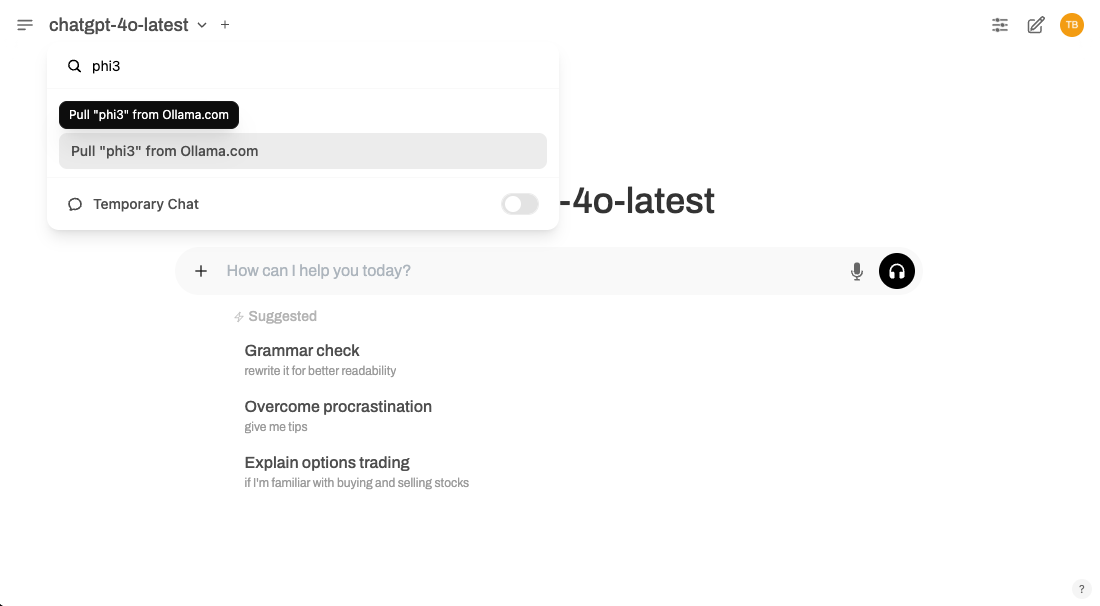

В обычной установке Open WebUI после запуска сам пытается достучаться до Ollama. Если всё прошло нормально, вы сразу получите доступ к моделям. Управление находится в Admin Settings → Connections → Ollama → Manage: оттуда можно смотреть соединение, скачивать модели и менять конфигурацию. Документация отдельно отмечает и более быстрый путь: модель можно стянуть прямо из model selector, если её ещё нет на стороне Ollama.

Самый частый сбой прозаичен: Ollama слушает только 127.0.0.1, а Open WebUI запущен в контейнере и физически не может достучаться до localhost на хост-машине. В troubleshooting Open WebUI рекомендует сначала сделать Ollama доступным снаружи локальной петли через OLLAMA_HOST=0.0.0.0, а затем уже проверять сетевую схему развёртывания. Для Docker-сценариев документация по starting with Ollama советует URL http://host.docker.internal:11434, а в отдельных кейсах troubleshooting предлагает и --network=host вместе с OLLAMA_BASE_URL=http://127.0.0.1:11434.

Есть и более взрослый сценарий: несколько Ollama-инстансов. В официальном гайде по Ollama Open WebUI пишет, что умеет раскидывать запросы между несколькими инстансами случайным образом, если model IDs совпадают. Для команды это полезно, когда один ноутбук уже не тянет всех пользователей или когда вы разносите inference по нескольким машинам.

Что Open WebUI добавляет поверх голого Ollama

Главный вопрос надо ставить жёстко: за что вы платите сложностью ещё одного слоя? Ответ не в том, что у Open WebUI «красивый чат». Ответ в том, что он собирает вокруг модели рабочую поверхность, которой у голого Ollama из коробки нет.

- Один интерфейс для нескольких провайдеров. В документации features Open WebUI описан как единая оболочка для conversations, knowledge, tools и models, а connect-a-provider покрывает не только Ollama, но и OpenAI-compatible API, Anthropic, llama.cpp, vLLM и Open Responses.

- Работа с файлами и знаниями. В features отдельный блок посвящён Knowledge & RAG: документы, knowledge base, выбор между vector search и full-content injection.

- Инструменты и agent-поведение. Open WebUI умеет подключать встроенные и внешние инструменты, а для сильных моделей использовать native function calling.

- Общий браузерный доступ. Это банально, но именно он переводит локальную модель из режима «у меня на машине работает» в режим, где её можно показать команде, аналитику, редактору или внутреннему заказчику.

И здесь есть важная практическая поправка. Если вам нужен просто локальный inference и максимальная простота, Open WebUI действительно лишний. Но если вы уже добрались до сценария «загружаем документы, даём доступ нескольким людям, подключаем инструменты и сравниваем модели», то именно отсутствие такого слоя обычно и начинает тормозить работу сильнее, чем сама локальная модель. По выбору открытых моделей для этого слоя полезно держать рядом и наш разбор Llama, Mistral и Qwen в 2026 году.

Интеграции: Tools, OpenAPI и MCP

Здесь Open WebUI становится интересным уже не как чат, а как рабочая шина вокруг LLM. Документация по Tools делит расширения на несколько типов: встроенные возможности, Workspace Tools на Python, нативный MCP и OpenAPI servers. Важно не спутать эти слои.

Workspace Tools — самый мощный и самый опасный режим. Это Python-скрипты, которые исполняются прямо внутри окружения Open WebUI. Документация прямо предупреждает: давать право на импорт или создание таких tools непроверенным пользователям нельзя, потому что это фактически право выполнить произвольный код на сервере.

OpenAPI servers в документации названы предпочтительным путём для большинства развёртываний. Логика здравая: обычный HTTP, понятные схемы, стандартная наблюдаемость, audit и совместимость с привычным enterprise-контуром.

MCP в Open WebUI тоже уже нативный, но с оговорками. Официальная страница MCP пишет, что встроенная поддержка появилась начиная с v0.6.31 и работает в режиме Streamable HTTP. Для OAuth-связанных MCP tools в Docker нужно обязательно задавать постоянный WEBUI_SECRET_KEY, иначе после рестарта контейнера Open WebUI не сможет расшифровать токены и попросит проходить авторизацию заново. Там же документация делает важный выбор за администратора: для большинства развёртываний OpenAPI остаётся предпочтительным путём, а MCP стоит брать тогда, когда у вас уже есть MCP-экосистема или нужен именно этот протокол.

Есть и чисто прикладной вывод для локальных моделей. В documentation по tool calling Open WebUI отдельно различает Default Mode и Native Mode. Default Mode работает практически с любой моделью, включая старые и небольшие локальные модели. Native Mode быстрее и лучше для agent-сценариев, но сама документация предупреждает: маленькие локальные модели нередко ломают JSON, плохо выбирают инструменты и в целом ведут себя хуже. Если вы подключаете Open WebUI к скромной локальной модели, не надо автоматически включать «агентный режим» только потому, что он красиво звучит. Сначала проверьте, как модель вообще держит схемы и многошаговый tool flow.

Командный режим: RBAC и общий доступ

Как только Open WebUI перестаёт быть игрушкой на личном ноутбуке, всплывает вопрос доступа. В документации RBAC описан через три слоя: роли, разрешения и группы. Причём модель прав additive: пользователь получает базовые возможности от своей роли, а затем группы добавляют новые права и общий доступ к ресурсам.

Это важно по двум причинам. Первая: можно отделить обычных пользователей от тех, кто имеет право менять модели, включать web search, работать с workspace-инструментами или редактировать общие ресурсы. Вторая: можно не превращать общий LLM-контур в дикое поле, где любой сотрудник случайно импортирует Python-tool из сообщества и запускает произвольный код на сервере.

Если вы строите локальный стек для команды, именно здесь Open WebUI начинает выглядеть как настоящий внутренний интерфейс, а не просто ещё один клиент для чата. Для одиночного пользователя RBAC почти не нужен. Для отдела — уже нужен.

Когда Open WebUI не нужен

- Вы работаете один и не выходите за пределы локального CLI или одного простого десктоп-клиента.

- Вам не нужны роли, группы, общий веб-доступ и документы в браузере.

- У вас нет сценариев с tools, knowledge base или внешними API поверх модели.

- Вы хотите минимальный стек с наименьшим количеством движущихся частей и готовы пожертвовать удобством интерфейса.

Проще говоря: Open WebUI окупается там, где локальная модель перестаёт быть личной игрушкой и становится общей рабочей поверхностью.

Матрица выбора

| Сценарий | Open WebUI | Почему |

|---|---|---|

| Один разработчик, один локальный чат, минимум UI | Скорее нет | Голого Ollama или простого клиента обычно достаточно; лишний слой только усложняет стек. |

| Несколько локальных или облачных провайдеров в одном интерфейсе | Да | Open WebUI собирает Ollama и OpenAI-compatible API в одну веб-оболочку. |

| Командный доступ к локальным моделям через браузер | Да | Здесь ценность дают общий интерфейс, роли, группы и централизованная настройка. |

| Локальный RAG, документы, knowledge base и tool calling | Да | Это уже не задача для чистого inference-слоя; нужна управляемая пользовательская поверхность. |

| Агентные сценарии на маленькой локальной модели | Осторожно | Интерфейс поможет, но Native tool mode часто упирается в качество самой модели, а не в UI. |

| Строгий enterprise-контур с наблюдаемостью и стандартными API | Да, но через OpenAPI first | Сама документация рекомендует OpenAPI как основной путь, а MCP использовать точечно. |

Вывод

Open WebUI в 2026 году — это не просто красивый фронт для локальной модели. Это слой, который переводит локальный или гибридный LLM-стек в более взрослый режим: с браузерным доступом, документами, инструментами, ролями и несколькими типами интеграций.

Но относиться к нему стоит трезво. Если вам не нужен общий контур, не нужны инструменты и не нужен админский слой, ставить Open WebUI только ради того, чтобы «было как ChatGPT, но локально», не обязательно. Если же задача уже переросла личный ноутбук и CLI, Open WebUI часто оказывается самым коротким путём к рабочему интерфейсу без разработки собственного front-end слоя. А когда вы выбираете уже не только интерфейс, но и сами модели под него, держите рядом и наш материал о выборе языковой модели под задачу, бюджет и контур данных.

Источники и дата проверки

Факты, команды установки, сведения о supported connection types, RBAC, MCP, tool modes и troubleshooting перепроверены 5 мая 2026 года по официальным страницам Open WebUI и GitHub-репозиторию проекта.

- Open WebUI Home — self-hosted/offline позиционирование, поддержка Ollama и OpenAI-compatible API, quick start и варианты установки.

- Open WebUI Features — единая оболочка для conversations, knowledge, tools и models.

- Starting with Ollama — протокол Ollama, auto-connect, управление через Admin Settings и советы по подключению.

- Connect a Provider — список поддерживаемых типов провайдеров и connection protocols.

- Connection Errors —

OLLAMA_HOST=0.0.0.0, host-network и типовые сетевые ошибки. - RBAC — роли, permissions, groups и additive model.

- Tools — taxonomy tools, security warning для Python-tools, Default vs Native mode.

- Model Context Protocol (MCP) — поддержка с

v0.6.31, Streamable HTTP,WEBUI_SECRET_KEYи предпочтение OpenAPI для большинства развёртываний. - open-webui/open-webui on GitHub — актуальные GitHub stars и дата последнего релиза.