Llama на русском: как запустить модели Meta и с какой версии начать

Практический разбор Llama на русском на май 2026 года: официальные ограничения по языкам, локальный запуск через Ollama, разница между Llama 4 Scout, Maverick и Llama 3.3.

Проверено 5 мая 2026 года. Запустить Llama на русском можно, но с важной оговоркой: Meta не относит русский к официально поддерживаемым языкам ни у Llama 4, ни у Llama 3.3. Поэтому правильный вопрос звучит не как «умеет ли Llama русский вообще», а как «какая версия Llama даст приемлемый русский результат на моей инфраструктуре и в моём рабочем сценарии».

В 2026 году под запросом Llama на русском на практике скрываются три разные дороги. Первая — Llama 4 Scout, если вам нужен мультимодальный локальный стек и есть серьёзный запас по железу. Вторая — Llama 4 Maverick, если вы вообще не считаете серверную инфраструктуру проблемой. Третья — Llama 3.3, если нужен более реалистичный текстовый старт через Ollama без попытки превратить каждый ноутбук в демонстрацию frontier-модели.

Если вам нужен общий фон по открытым моделям, держите рядом и наш обзор Llama, Mistral и Qwen в 2026 году. Здесь угол уже другой: не рынок вообще, а практический запуск именно Meta-моделей под русскоязычную работу.

Короткий выбор: с чего начинать

| Маршрут | Что подтверждено официально | Когда выбирать | Главный компромисс |

|---|---|---|---|

Llama 4 Scout |

109B total / 17B active, image input, 10M context; в Ollama — llama4:scout или llama4:16x17b, 67GB |

Нужны локальные изображения на входе, длинный контекст и open-weight контур | Тяжёлая модель и русский язык без официальной гарантии качества |

Llama 4 Maverick |

400B total / 17B active, image input, 1M context; в Ollama — llama4:maverick или llama4:128x17b, 245GB |

Есть серверный запас и вам действительно нужен большой мультимодальный open-weight контур | Для обычного локального старта почти всегда избыточна |

Llama 3.3 |

70B text-only multilingual model; в Ollama — llama3.3, 43GB, 128K context |

Нужен более реалистичный текстовый запуск без image-input и без 67GB+ пакета Scout | Нет мультимодальности, русский тоже не в официальном списке языков |

Практический вывод короткий. Если вам нужна именно Llama на русском для текста, начинать чаще разумнее с Llama 3.3. Если нужен локальный мультимодальный контур и вы готовы к тяжёлой модели, тогда уже смотрите на Llama 4 Scout. Maverick стоит брать только там, где инфраструктура и сценарий действительно требуют такого масштаба.

Русский язык: что Meta обещает и чего не обещает

Здесь важно не подменять факты маркетингом. В официальном описании Llama 4 поддерживаемыми указаны Arabic, English, French, German, Hindi, Indonesian, Italian, Portuguese, Spanish, Tagalog, Thai и Vietnamese. В русскоязычной среде это означает простую вещь: модель может отвечать на русском, но Meta не берёт на себя ту же планку safety и helpfulness, что для этих 12 языков.

С Llama 3.3 ситуация не мягче. На странице Ollama у неё указаны English, German, French, Italian, Portuguese, Hindi, Spanish и Thai. Русского опять нет. И там же есть знакомая оговорка: модель обучалась на более широком наборе языков, чем список официальной поддержки, но для языков вне списка разработчик должен сам брать на себя ответственность за качество и безопасность.

- Llama умеет понимать русские инструкции и отвечать по-русски.

- Но Meta не обещает для русского тот же уровень качества, что для официально поддерживаемых языков.

- Если русский язык для вас основной рабочий контур, тест на своих данных обязателен и для Llama 4, и для Llama 3.3.

Именно поэтому фраза «модель мультиязычная» в такой статье бесполезна без уточнения, на каких языках она официально поддерживается и что это значит для продакшена.

Что у Llama 4 подтверждено официально

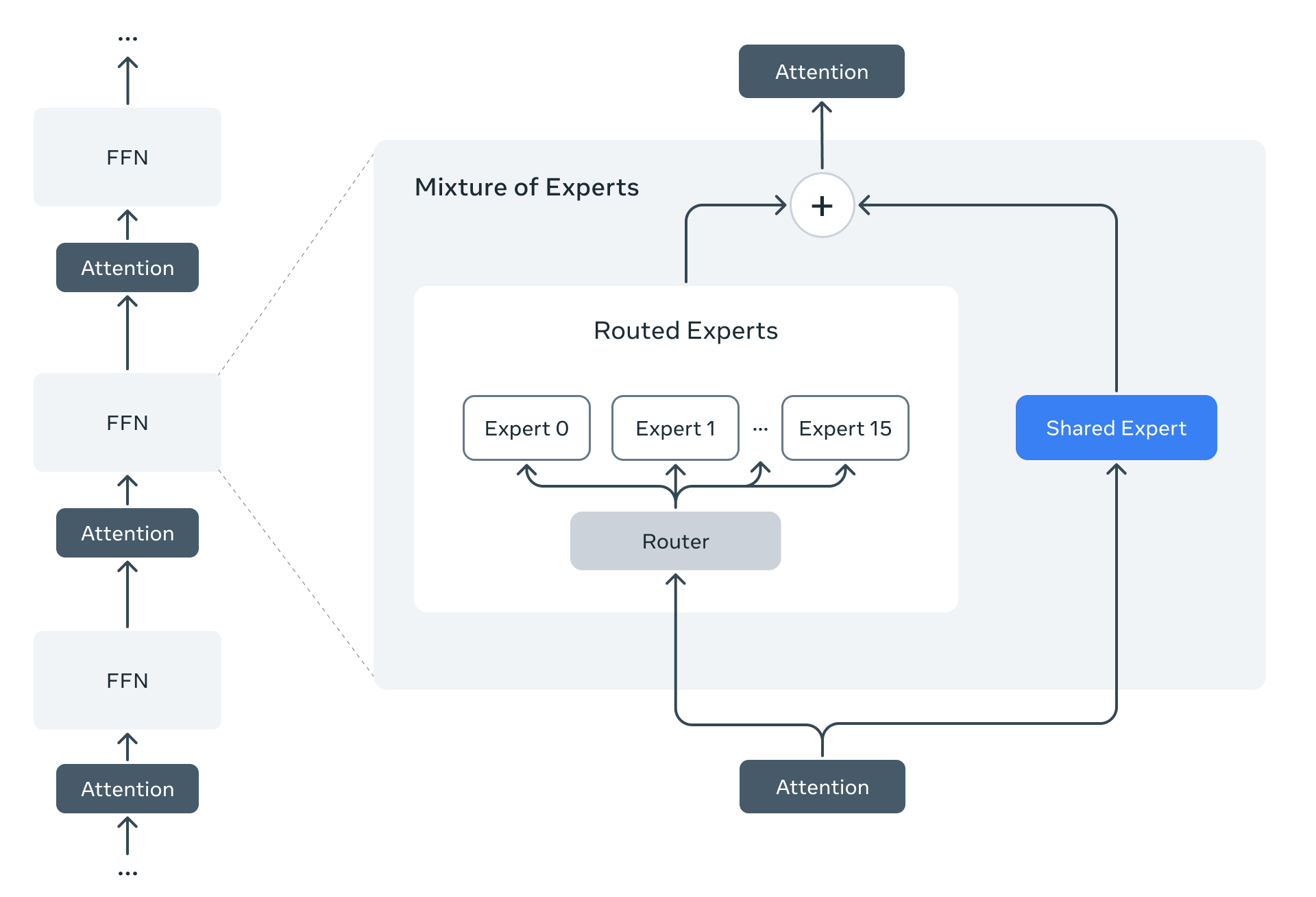

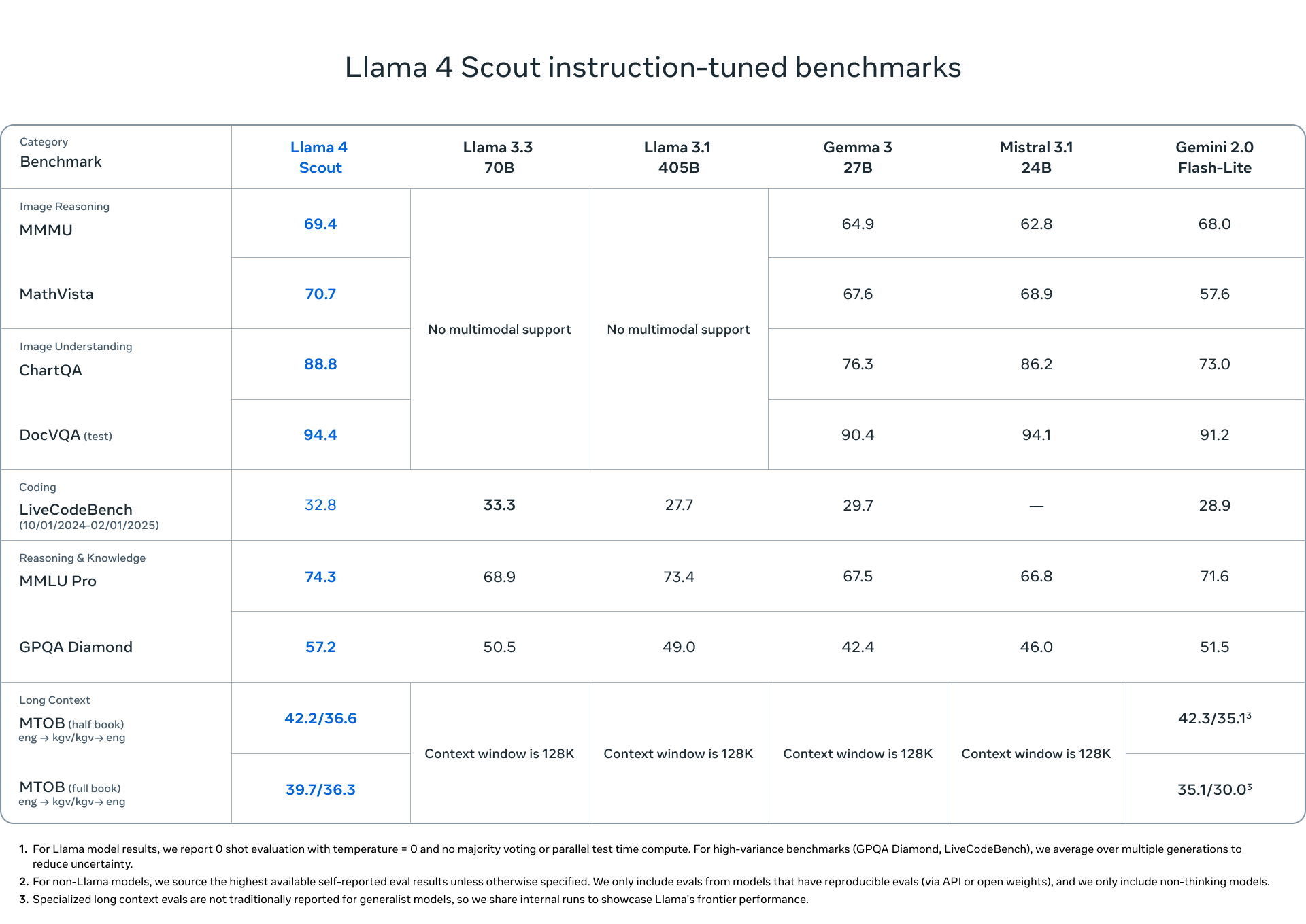

Llama 4 — это не просто следующий номер в линейке Meta. В официальном анонсе и model card речь идёт о мультимодальном семействе с MoE-архитектурой, image input и очень длинным контекстом. Для Scout заявлены 109 миллиардов общих параметров и 17 миллиардов активных, для Maverick — 400 миллиардов общих и те же 17 миллиардов активных. Scout рассчитан на 10 миллионов токенов контекста, Maverick — на 1 миллион.

Это важная граница. Llama 4 интересна не потому, что «умеет русский», а потому, что совмещает открытые веса, изображения на входе и длинную рабочую память. Если вам нужен локальный визуальный анализ документов, приватный RAG по картинкам или собственный мультимодальный контур без внешнего API, Llama 4 попадает в короткий список. Если вам нужен просто хороший русский текстовый ассистент, её преимущества становятся менее очевидными.

Лицензионный слой тоже надо называть честно. Это не permissive-мир Apache 2.0, а Llama 4 Community License. Для многих команд это всё равно приемлемо, но путать open weights с максимально свободной лицензией нельзя.

Что Ollama быстро возвращает на землю

Официальная библиотека Ollama полезна тем, что убирает из разговора лишнюю романтику. На странице llama4 базовый Scout указан как пакет 67GB с 10M context window и поддержкой текста плюс изображения. Maverick указан как 245GB с 1M context window. Это уже достаточно, чтобы понять: Llama 4 — не история про «попробую вечером на случайном ноутбуке».

На этом фоне Llama 3.3 выглядит гораздо более реалистичным стартом для текстовой русскоязычной работы. Та же официальная библиотека Ollama показывает 43GB и 128K context window. Это тоже не маленькая модель, но переход от 67GB и image-input стека к 43GB и text-only сценарию часто решает судьбу пилота лучше, чем спор о том, какая модель звучит моднее.

Именно отсюда редакционный вывод: если вам нужен Llama на русском под локальный текстовый контур, слишком часто люди начинают не с той версии. Они видят Llama 4, тянут Scout, а потом удивляются инфраструктурной цене вопроса. Для текстовых сценариев стоит сначала проверить, не закрывает ли задачу Llama 3.3 с меньшей сложностью.

Как запускать через Ollama

Для общего локального контура полезно иметь рядом наш подробный материал про Ollama и запуск LLM на своём компьютере. Здесь оставим короткий маршрут именно под Llama.

1. Установите Ollama

curl -fsSL https://ollama.com/install.sh | sh2. Выберите реалистичный стартовый маршрут

Если вам нужен текстовый локальный пилот на русском без image-input, начинайте с Llama 3.3:

ollama pull llama3.3

ollama run llama3.3Если вам нужна именно мультимодальная Llama 4, начинайте со Scout, а не с Maverick:

ollama pull llama4:scout

ollama run llama4:scoutОт Maverick имеет смысл стартовать только в инфраструктуре, где вы заранее понимаете цену 245GB-пакета и действительно готовы к такому весу.

3. Сразу проверяйте русский на своей задаче

Напиши краткую сводку этого текста на русском.

Сохрани факты, не выдумывай детали и не переходи на английский.Тестируйте не анекдоты и не абстрактный чат, а свои рабочие сценарии: сводки, структурирование заметок, извлечение фактов, ответы по документам, классификацию. Только так становится понятно, где модель действительно полезна на русском, а где вы воюете не с задачей, а с языковой деградацией.

4. Если нужен русский по умолчанию, закрепите поведение через Modelfile

FROM llama3.3

PARAMETER temperature 0.2

PARAMETER num_ctx 8192

SYSTEM """Отвечай на русском языке, если пользователь не просит иное.

Если не уверен в фактах, скажи об этом прямо.

Не подменяй русский язык кальками с английского."""ollama create llama-ru -f Modelfile

ollama run llama-ruЭто не делает Meta-модель официально русскоязычной, но снимает часть поведенческого шума и помогает получить более стабильную подачу в повседневных задачах.

Если нужен уже не только запуск, но и браузерный интерфейс для команды, посмотрите отдельно наш разбор Open WebUI поверх Ollama. Там Llama часто чувствует себя удобнее, чем в голом CLI.

Когда Llama на русском действительно имеет смысл

- У вас чувствительные данные, и внешний API нежелателен или запрещён.

- Нужен свой open-weight контур, который можно адаптировать, логировать и донастраивать под внутренние правила.

- Для

Llama 4— если вам реально нужны изображения на входе и длинный контекст, а не просто громкий бренд. - Для

Llama 3.3— если нужен более реалистичный локальный текстовый старт и вы готовы отдельно валидировать русский язык.

Когда лучше не брать Llama

- Вам нужен лучший русский результат из коробки без отдельного тестирования и системного контроля.

- У вас нет аппаратного запаса даже под 43GB-пакет

Llama 3.3, не говоря уже проScoutиMaverick. - Вы хотите только быстрый внешний API без инфраструктурной нагрузки.

- Ваша команда не готова поддерживать локальный inference и разбираться, почему качество на русском плавает от задачи к задаче.

В такой развилке часто полезнее сначала вернуться к общему выбору модели и контура данных, а уже потом решать, нужен ли вам именно Meta-стек. Для этого у нас есть отдельный гайд по выбору языковой модели под задачу, бюджет и ограничения.

Вывод

Llama на русском в 2026 году — это не один продукт, а выбор между очень разными классами моделей Meta. Llama 4 Scout и Maverick интересны там, где действительно нужны мультимодальность и длинный контекст. Llama 3.3 чаще оказывается более честной отправной точкой для локального русскоязычного текста.

Главное не покупать красивый маркетинговый ярлык вместо практики. Ни Llama 4, ни Llama 3.3 не дают официальной гарантии качества на русском. Поэтому берите их не потому, что они «теперь знают русский», а потому, что у вас есть конкретная причина строить свой open-weight контур и отдельный план проверки качества на собственных задачах.

Источники и дата проверки

Факты о Llama 4, Llama 3.3, официально поддерживаемых языках, размерах пакетов в Ollama, командах запуска и Modelfile перепроверены 5 мая 2026 года по официальным страницам Meta, Meta на Hugging Face и Ollama.

- Meta: The Llama 4 herd

- Hugging Face: meta-llama / Llama-4-Scout-17B-16E-Instruct

- Ollama library: llama4

- Ollama library: llama3.3

- Ollama Linux install docs

- Ollama Modelfile reference