LangChain vs LlamaIndex: что выбрать для production RAG в 2026 году

LangChain vs LlamaIndex для production RAG: где важнее orchestration, data layer, observability и когда выгоднее гибридный стек.

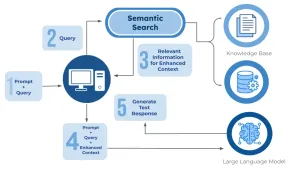

Сравнение LangChain vs LlamaIndex в 2026 году больше не сводится к старой формуле «один фреймворк для агентов, другой только для RAG». Оба проекта выросли, и именно поэтому выбор стал сложнее. LangChain сегодня идёт в сторону готовой агентной архитектуры поверх LangGraph и операционного контура через LangSmith. LlamaIndex, наоборот, всё сильнее выглядит как слой данных для приложений поверх собственных документов и баз знаний: загрузка, индексация, retrieval, workflow и наблюдаемость.

По состоянию на 26 апреля 2026 года нормальный вопрос звучит не «кто популярнее», а так: где у вас главная сложность. Если команда тонет в оркестрации, длинных workflow, вызовах инструментов и отладке агентных сценариев, чаще выигрывает стек LangChain + LangGraph. Если боль в документах, загрузке данных, retrieval и качестве ответа по собственной базе знаний, чаще сильнее выглядит LlamaIndex. Если проект зрелый, нередко побеждает гибрид, а не один фреймворк.

Короткий вывод для занятых

| Вопрос | Скорее LangChain | Скорее LlamaIndex |

|---|---|---|

| Что у вас сложнее всего | Оркестрация агентов, вызовы инструментов, длинные процессы с состоянием, контроль исполнения | Подключение данных, индексация, retrieval, оценка качества ответов по базе знаний |

| Центр тяжести продукта | Агентная архитектура поверх LangGraph и операционный контур через LangSmith | RAG и приложения «поверх ваших данных» с загрузкой, запросами и workflow-слоем |

| Самый естественный старт | Когда нужен агент с моделями, инструментами и предсказуемым контуром исполнения | Когда нужен быстрый путь от документов и коннекторов к рабочему retrieval |

| Главный риск | Собрать слишком сложный стек раньше времени | Недооценить orchestration и production-операции вокруг retrieval-слоя |

Что изменилось в 2026 году

По официальным страницам двух проектов видно важное смещение. LangChain сейчас подаёт себя как open-source framework с prebuilt agent architecture, интеграциями для моделей и инструментов и связкой с LangGraph для durable execution, human-in-the-loop и persistence. Это уже не просто набор цепочек. Это удобная точка входа в агентные приложения с более явным слоем исполнения.

LlamaIndex с другой стороны не выглядит как «только обёртка над векторной базой». В официальной документации он развёрнут как framework для приложений поверх собственных данных: loading, indexing, querying, storing, evaluation, tracing and debugging, privacy and security. Плюс отдельный workflow-слой с event-driven исполнением. То есть у него тоже выросли амбиции, но вокруг сценариев, где в центре стоят данные.

Из-за этого старый спор «что лучше для RAG» стал неточным. Правильнее сравнивать два разных центра тяжести: у LangChain это оркестрация и агентный runtime, у LlamaIndex это слой данных и retrieval-пайплайн вокруг корпоративных или продуктовых данных.

Когда разумнее брать LangChain

LangChain стоит брать первым кандидатом, если вы строите не только retrieval, а целый агентный контур. В официальной документации LangChain отдельно подчёркивает standard model interface, prebuilt agents и то, что агенты работают поверх LangGraph. А LangGraph уже прямо описывается как low-level orchestration framework и runtime для long-running, stateful agents.

Практически это означает три сильных сценария.

- У вас есть вызовы инструментов, внешние API, ветвления, human approval и долгие задачи, которые нельзя просто свести к «нашли документы - ответили».

- Вам важен durable execution: возможность переживать сбои, паузы и ручные вмешательства без потери состояния.

- Вам нужна наблюдаемость уровня runtime, а не только качество retrieval. LangSmith записывает traces, runs, threads, автоматически цепляет интеграции и подходит именно к агентным системам как к последовательности шагов.

Отсюда и редакторский вывод: если команда называет проект словами «assistant», «agent», «workflow», «approval», «loop», «tool call», то у LangChain чаще естественнее стартовая позиция. Не потому что LlamaIndex этого не умеет, а потому что весь нарратив экосистемы LangChain вокруг этого и построен.

Если вам нужен более общий контекст по retrieval и месту RAG в архитектуре, держите рядом наш материал про RAG и подключение своих документов к модели. Он объясняет базовый слой, который comparison-страница не должна дублировать.

Когда разумнее брать LlamaIndex

LlamaIndex лучше смотреть первым, когда главным ограничением становится не агентный runtime, а собственные данные. В high-level concepts и component guides документация проекта разбита именно вокруг loading data, indexing, querying, storing, LlamaHub-коннекторов, evaluation и tracing/debugging. Это хороший сигнал: продукт мыслит не через «агент как центр мира», а через путь от сырого контента к ответу по данным.

В 2026 году у этого есть несколько практических плюсов.

- У LlamaIndex очень естественный словарь для data-centric команд: documents, nodes, ingestion pipeline, query engine, retrievers, evaluation.

- Workflow-слой у проекта event-driven и step-based. Это хороший компромисс для сложных retrieval-пайплайнов, где уже нужны ветвления и циклы, но не хочется сразу провалиться в более тяжёлый агентный runtime.

- Официальная observability-документация прямо обещает контроль над inputs/outputs, component-level quality и call traces для indexing и querying. Для RAG-команд это ближе к реальной боли, чем общие разговоры про «умных агентов».

Поэтому LlamaIndex часто логичнее в сценариях, где команда говорит на языке knowledge base, policy docs, product docs, search quality, reranking и evaluation. Особенно когда retrieval-качество и структура данных важнее, чем богатая оркестрация инструментов.

Где команды всё чаще смешивают оба стека

Самый зрелый вывод из comparison в 2026 году звучит не романтично, зато полезно: LangChain и LlamaIndex всё чаще работают вместе. LlamaIndex берут как слой загрузки, индексации, retrievers и query engines поверх данных. LangGraph и LangSmith - как слой оркестрации, stateful execution, отладки и эксплуатации сложного агентного процесса.

Это особенно заметно в production-RAG, где нужно одновременно решить две разные задачи.

- Собрать и обслуживать хороший retrieval по внутренним данным.

- Оркестрировать многошаговый runtime вокруг модели, инструментов, проверок и ручных approvals.

Если ваш проект действительно упирается в оба класса задач, спор «или/или» только мешает. В такой архитектуре LlamaIndex отвечает за качество контекста, а LangGraph - за качество исполнения. Для соседнего решения по хранилищам держите под рукой и наш обзор векторных баз данных для RAG.

Практическая матрица выбора

| Сценарий | Что брать первым | Почему |

|---|---|---|

| Чат по внутренней документации, где главный риск в качестве retrieval | LlamaIndex | Документация и продуктовый язык у проекта вращаются вокруг ingestion, indexing, query engines и evaluation. |

| Агент с инструментами, паузами, approvals и длинным execution path | LangChain + LangGraph | LangGraph напрямую заточен под durable execution, human-in-the-loop, stateful runtime и long-running agents. |

| Production-RAG для команды, где нужны и хорошие данные, и сложная оркестрация | Гибрид | LlamaIndex закрывает data layer, LangGraph и LangSmith закрывают orchestration и наблюдаемость исполнения. |

| Небольшой пилот, где нужно быстро проверить ценность retrieval | LlamaIndex | Чаще проще стартовать от документов и query engine, чем сразу собирать тяжёлый агентный стек. |

| Продукт, где retrieval - лишь один шаг внутри большого ассистента | LangChain | Когда retrieval не центр, а одна из стадий, удобнее мыслить через agent architecture и orchestration. |

Три ошибки, которые портят выбор

Первая ошибка - мерить фреймворки по GitHub stars и числу интеграций в отрыве от архитектуры. Это быстрый способ выбрать не тот инструмент и потом два месяца таскать чужую абстракцию по проекту.

Вторая ошибка - превращать эту comparison-страницу в generic-гайд «что такое RAG». Для этого у нас уже есть отдельный базовый материал. Здесь нужно отвечать именно на брендовый comparison-intent, иначе страница начинает каннибализировать соседние RAG-URL.

Третья ошибка - ждать, что один стек одинаково хорошо решит и ingestion/retrieval, и сложный stateful runtime, и observability, и approvals. На маленьком пилоте это иногда сходится. На production-проекте почти всегда выясняется, что у команды есть доминирующая боль, и именно под неё надо выбирать стартовый центр тяжести.

Если сравнение упирается уже не в RAG, а в устройство агентного слоя, полезно рядом открыть и наш разбор агентного ИИ и моделей, которые действуют. Он помогает не смешивать retrieval-архитектуру с агентным runtime в одну кашу.

Вывод

LangChain в 2026 году разумнее выбирать как основной стек там, где проект строится вокруг агентного поведения, orchestration и операционного контроля исполнения. LlamaIndex разумнее ставить первым там, где успех зависит от качества data layer: загрузки, индексации, retrieval и evaluation по собственным данным.

Если нужен короткий практический совет, он такой: не выбирайте победителя без формулировки главной боли проекта. Для RAG-команды без этого сравнение бессмысленно. Один и тот же набор требований почти всегда приводит либо к «LlamaIndex first», либо к «LangChain runtime + data layer отдельно», и это нормальный итог, а не компромисс от слабости.

Источники и дата проверки

Факты и продуктовые формулировки перепроверены 26 апреля 2026 года по официальным страницам LangChain и LlamaIndex. Быстро меняющиеся цифры вроде GitHub stars, «количества интеграций» и маркетинговых рейтингов сознательно не используются как главный аргумент, потому что они слишком быстро устаревают и плохо помогают архитектурному выбору.

- LangChain overview - позиционирование LangChain как open-source framework с prebuilt agent architecture и интеграциями.

- LangGraph overview - durable execution, human-in-the-loop, memory и production-ready deployment.

- LangSmith observability concepts - traces, runs, threads и automatic/manual instrumentation.

- LlamaIndex high-level concepts - loading, indexing, querying, storing, evaluation, privacy and security.

- LlamaIndex workflows - event-driven, step-based workflows и применение к сложным AI-flows.

- LlamaIndex observability - inputs/outputs, component quality и call traces для indexing/querying.