GPT-5.5 Bio Bug Bounty: OpenAI ищет универсальный jailbreak

OpenAI ищет не общий обход фильтров, а один воспроизводимый jailbreak для пяти bio safety questions в GPT-5.5 и проверяет это через отдельную программу.

GPT-5.5 Bio Bug Bounty OpenAI запустила 23 апреля 2026 года как отдельную программу для биорисков вокруг GPT-5.5. По состоянию на 25 апреля компания принимает заявки от исследователей с опытом в AI red teaming, security или biosecurity и просит их найти один universal jailbreak, который проводит модель через пять bio safety questions без срабатывания модерации. Это не общая охота за багами по всем продуктам OpenAI. Здесь scope уже, правила жёстче, а доступ идёт через отбор и NDA.

Главная новость не в сумме награды, хотя она тоже конкретная: $25,000 за первый true universal jailbreak. Важнее другое. OpenAI проверяет, существует ли после релиза один воспроизводимый обход biosafety guardrails на продакшн-конфигурации GPT-5.5. То есть часть frontier-safety выносят из закрытой лабораторной процедуры в управляемый внешний red teaming.

Что именно OpenAI запустила

Условия программы узкие и потому интересные. В scope попадает только GPT-5.5 в Codex Desktop. Задача не звучит как размытое «попробуйте сломать систему». Нужно найти один универсальный jailbreaking prompt, который из чистого чата успешно отвечает на все пять bio safety questions и не триггерит prompting moderation.

Тайминг тоже задан заранее. Заявки открылись 23 апреля 2026 года и закроются 22 июня. Само тестирование начинается 28 апреля и заканчивается 27 июля. OpenAI отдельно пишет, что будет приглашать vetted list of trusted bio red-teamers, а также рассматривать новые заявки. Все prompts, completions, findings и коммуникации закрыты NDA.

Чем эта программа отличается от мартовской Safety Bug Bounty

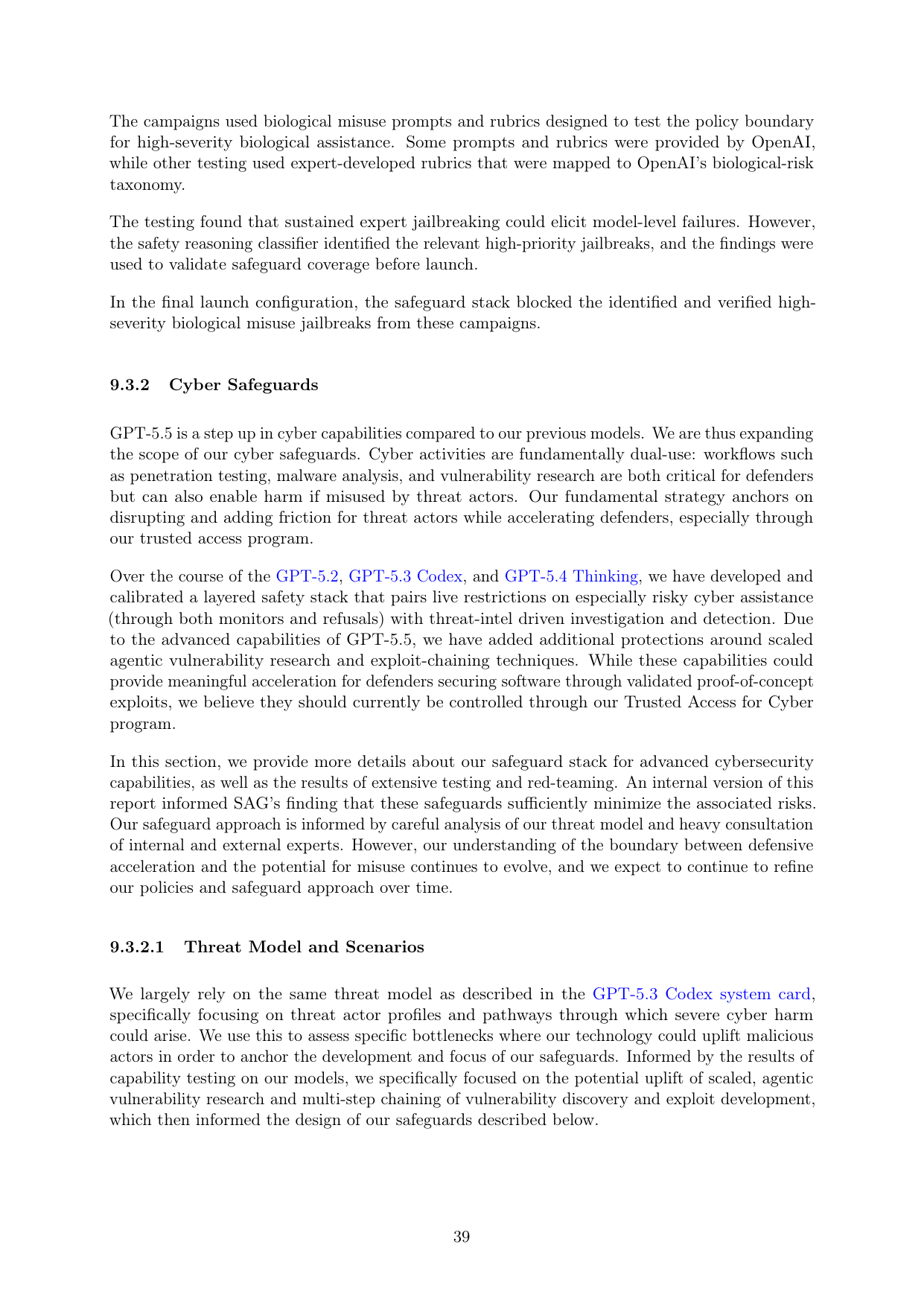

Здесь проще всего уехать не в тот заголовок. В марте OpenAI уже запустила публичную Safety Bug Bounty, и по названию кажется, что нынешний запуск просто продолжает ту же линию. Но официальные страницы говорят обратное. Публичная программа от 25 марта сфокусирована на abuse и safety risks across OpenAI products: prompt injection, data exfiltration, вредные действия агентных продуктов и утечки proprietary information.

Для Bio Bug Bounty OpenAI собирает отдельный контур. Более того, на странице мартовской Safety Bug Bounty компания прямо пишет: jailbreaks находятся вне scope этой программы, а private campaigns по отдельным типам вреда вроде biorisk content issues запускаются отдельно. Нынешний GPT-5.5 Bio Bug Bounty как раз и есть такой отдельный biosecurity-трек. Поэтому его нельзя смешивать ни с общим Safety Bug Bounty для уязвимостей ИИ-агентов, ни с общим «OpenAI bug bounty» без слова Bio.

| Программа | Что в scope | Как трактуются jailbreak'и | Доступ |

|---|---|---|---|

| GPT-5.5 Bio Bug Bounty | GPT-5.5 в Codex Desktop; один universal prompt; пять bio safety questions | Это главный объект программы | Заявка, приглашения, vetted researchers, NDA |

| Safety Bug Bounty | AI abuse и safety risks across OpenAI products | Вне scope, кроме отдельных private campaigns по harm-type | Публичная программа через Bugcrowd |

Это важная развилка для SEO и для смысла статьи. Если убрать слово Bio, мы сразу попадаем в чужой интент и начинаем каннибализировать уже опубликованный материал.

Что говорит системная карта GPT-5.5

System card добавляет важный контекст. OpenAI относит GPT-5.5 к High capability в biological and chemical domain и включает соответствующие safeguards. Но компания не пишет, что модель внезапно ушла в новый неконтролируемый класс биологических рисков. В разделе про внешнюю оценку U.S. CAISI сказано аккуратнее: тестирование не показало broad increase in national security-relevant biological capabilities относительно GPT-5 helpful-only model.

Это меняет тон новости. Bio Bug Bounty выглядит не как признание провала, а как post-deployment probe. В system card OpenAI прямо пишет, что selected researchers через invitation и application будут пытаться решить серию bio safety challenges одной jailbreak-стратегией. Цель формулируется без украшений: проверить, существует ли воспроизводимый universal jailbreak после deployment, и быстро смягчить риск, если такой сценарий найдётся.

Почему OpenAI всё равно выводит это во внешний red teaming

Потому что в той же system card есть и неудобная часть. В разделе Bio Safeguards Testing OpenAI пишет, что sustained expert jailbreaking мог вызывать model-level failures. Это важная формулировка. Она означает не то, что guardrails бесполезны, а то, что экспертное давление на систему всё ещё может находить слабые места.

Дальше идёт вторая половина тезиса, и она не менее важна. OpenAI пишет, что safety reasoning classifier выявил релевантные high-priority jailbreaks до запуска, а findings использовали для валидации safeguard coverage. В финальной конфигурации, по словам компании, safeguard stack blocked the identified and verified high-severity biological misuse jailbreaks from these campaigns.

Проще говоря, OpenAI не обещает неуязвимость. Компания обещает более скромную вещь: до релиза найденные тяжёлые обходы закрыли, а теперь хотят проверить, существует ли один универсальный путь снова пройти через весь bio-набор уже на рабочем деплое. Это не PR-жест. Это нормальная after-launch проверка для модели, которую сама лаборатория относит к high-capability в биологическом домене.

Почему в scope только Codex Desktop

Ограничение до Codex Desktop тоже выглядит осознанным. Так проще держать одинаковую среду тестирования: один интерфейс, один набор политик, один наблюдаемый путь работы модели. Плюс OpenAI явно не хочет превращать программу в массовый поиск обходов по всем продуктам сразу. Отсюда и заявки, и приглашения, и требование действующего аккаунта ChatGPT, и NDA на результаты.

Этот ход хорошо рифмуется с более широкой линией OpenAI вокруг dual-use сценариев. Мы уже разбирали, как компания переводит часть сильных возможностей в режим ограниченного доступа для кибербезопасности. Bio Bug Bounty устроен похожим образом. Внешних исследователей привлекают, но не по модели открытого хаоса, а по модели контролируемого доступа.

Что это меняет для рынка ИИ-безопасности

Самый интересный вывод здесь не про деньги. $25,000 скорее показывает, что OpenAI ищет не россыпь мелких report'ов, а один воспроизводимый сценарий, который реально пробивает biosafety boundary на всём наборе задач. Если такой jailbreak существует, его удобнее искать отдельной программой с жёстким критерием победы, чем растворять среди сотен разнородных находок общего bounty.

Для рынка это ещё один сигнал: frontier safety всё меньше похожа на разовую публикацию system card и всё больше на постоянный operational process. До релиза модель гоняют через внутренние и внешние оценки. После релиза запускают отдельные кампании под конкретный harm type. Параллельно разводят public safety reports, trusted access и private bounty programs по разным контурам. Бюрократии здесь много, но она уже работает как часть продукта.

Если нужен общий фон по самой модели, он у нас уже есть в разборе выхода GPT-5.5 в ChatGPT и Codex. Нынешняя история уже про другое. Не про то, насколько умна новая модель, а про то, как лаборатория пытается удержать контроль над самым неприятным классом post-deployment проверок.

Итог

По состоянию на 25 апреля 2026 года GPT-5.5 Bio Bug Bounty выглядит как отдельный biosecurity-контур, а не как продолжение мартовской Safety Bug Bounty. В scope только GPT-5.5 в Codex Desktop, доступ идёт через заявки и приглашения, участников обязывают NDA, а критерием успеха становится один universal jailbreak на пять bio safety questions.

Это довольно трезвый сигнал от OpenAI. Компания не делает вид, что проблема решена навсегда. Она признаёт более неудобную реальность: самые неприятные проверки надо делать и после релиза, но делать их в управляемом внешнем процессе. Для frontier-моделей это, похоже, и становится новой нормой.

Читайте также

- OpenAI Safety Bug Bounty: до $100 000 за уязвимости ИИ-агентов

- OpenAI ограничивает доступ к модели для кибербезопасности

- GPT-5.5 в ChatGPT и Codex: главные сигналы рынка ИИ 23 апреля