GPT-5.4-Cyber: зачем OpenAI расширяет Trusted Access for Cyber

OpenAI расширяет Trusted Access for Cyber: проверенные защитники получат GPT-5.4-Cyber с меньшим числом отказов, но не без контроля.

GPT-5.4-Cyber показывает, как OpenAI меняет доступ к сильным ИИ-инструментам для кибербезопасности. Компания расширяет Trusted Access for Cyber: закрытый контур для нескольких партнёров превращается в многоуровневую программу для проверенных защитников.

14 апреля 2026 года OpenAI объявила, что доступ к программе получат не только 10 альфа-партнёров, но и тысячи проверенных индивидуальных исследователей, а также сотни организаций и поставщиков защитных решений. Одновременно компания представила GPT-5.4-Cyber - специализированную версию GPT-5.4 для кибербезопасности с меньшим числом отказов в подтверждённых защитных сценариях.

Публичного доступа к GPT-5.4-Cyber OpenAI не объявляла. По состоянию на 15 апреля 2026 года компания описывает её как инструмент для проверенных защитников: специалистов и команд, которые прошли проверку, работают в легитимном защитном контуре и соглашаются на дополнительные правила доступа.

Что изменилось после первого Trusted Access for Cyber

Ранее мы разбирали, почему OpenAI ограничивает доступ к сильным моделям для кибербезопасности. Тогда главный тезис был простой: самые мощные возможности для поиска уязвимостей слишком рискованны для обычного публичного релиза. Новый анонс уточняет стратегию: вместо закрытого ящика OpenAI строит систему допуска с разными уровнями доверия.

По официальному описанию, программа масштабируется сразу в две стороны. Индивидуальные исследователи смогут проходить проверку и получать доступ к расширенным возможностям. Организации и поставщики защитных продуктов смогут получать более высокий уровень доступа для командной работы, интеграции в процессы безопасности и обратной связи с OpenAI.

Это меняет тон разговора. Речь уже не о бинарной схеме «разрешить или запретить». Речь о том, кому можно дать более свободную модель, на каких условиях, с какой телеметрией, ответственностью и возможностью быстро закрыть доступ при нарушениях.

Что такое GPT-5.4-Cyber

OpenAI называет GPT-5.4-Cyber специализированной версией GPT-5.4 для задач кибербезопасности. В анонсе прямо сказано, что модель настроена так, чтобы меньше отказывать в подтверждённых рабочих процессах, но при этом сохранять защитные барьеры против вредоносного использования.

Это важная инженерная деталь. Обычная политика безопасности часто режет слишком широко: модель может отказать защитнику, который пишет детект, анализирует уязвимость или готовит учебный пример. Но если просто снять ограничения, получится подарок для атакующих. Trusted Access пытается решить эту дилемму не одним глобальным правилом, а контекстом доступа: кто спрашивает, зачем, в каком режиме и под какой ответственностью.

OpenAI перечисляет защитные сценарии, где такой доступ должен помогать: обнаружение уязвимостей, безопасная разработка, реагирование на инциденты, обучение безопасности и анализ угроз. Формулировка принципиальна. Компания говорит об оборонительной кибербезопасности, исследовании уязвимостей и обучении, а не о свободной автоматизации атак.

Почему базовые возможности уже требуют отдельного режима

Чтобы понять, почему OpenAI вообще понадобился отдельный контур доступа, полезно смотреть не только на продуктовый анонс GPT-5.4-Cyber, но и на системную карту GPT-5.4 Thinking. Это не бенчмарк GPT-5.4-Cyber. Но он показывает уровень возможностей базовой линейки, вокруг которой строится новый специализированный доступ.

В системной карте, опубликованной 5 марта 2026 года, OpenAI пишет, что GPT-5.4 Thinking стала первой моделью общего назначения компании с мерами смягчения для высокого уровня возможностей в категории кибербезопасности. Иными словами, речь уже не о лабораторной игрушке: модель достаточно сильна, чтобы к ней применяли отдельный режим оценки и защиты.

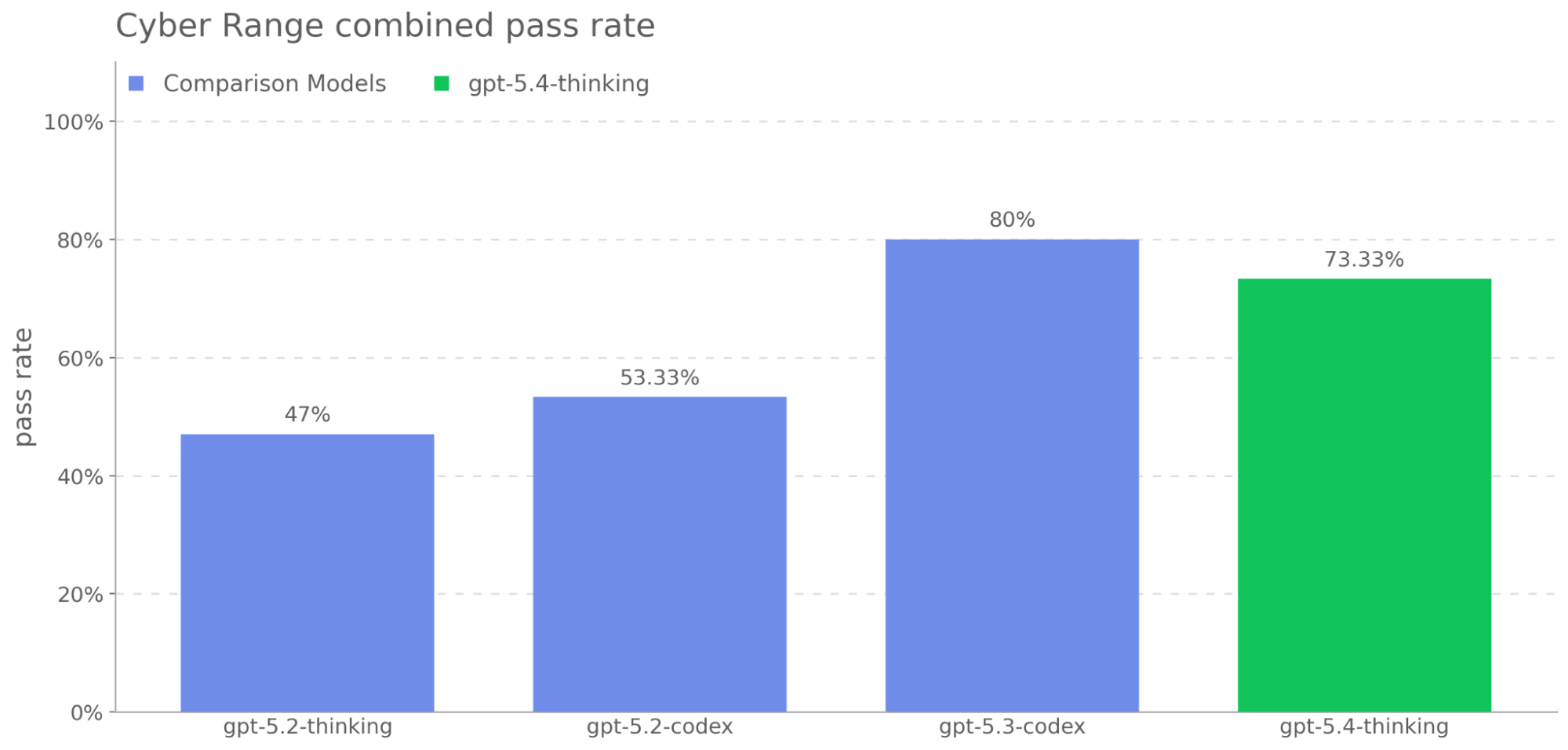

В суммарном показателе Cyber Range GPT-5.4 Thinking получила 73,33%. Специализированная модель gpt-5.3-codex в этой же диаграмме выше - 80%. Эти цифры не доказывают, что GPT-5.4 «побеждает всех». Они показывают другое: возможности в задачах кибербезопасности уже достаточно высоки, а специализированные контуры всё ещё могут обгонять универсальные модели рассуждения на отдельных тестах.

Меньше отказов, тот же контроль

Самая рискованная фраза в анонсе - «меньше отказов». Её легко прочитать как «OpenAI ослабила безопасность». Но в официальной логике компании смысл другой: модель должна меньше отказывать проверенным защитникам в легитимных задачах, где обычная модель часто перестраховывается.

Это хорошо стыкуется с тем, как OpenAI описывает поведение моделей в Model Spec: политика безопасности должна учитывать намерение, контекст и допустимый сценарий, а не только наличие слов вроде exploit, vulnerability или malware. Для кибербезопасности это особенно важно. Один и тот же технический запрос может быть частью атаки, обучения, внутреннего тестирования на проникновение или срочного расследования инцидента.

Поэтому Trusted Access for Cyber строится вокруг контроля доступа, договорных обязательств, мониторинга, обратной связи и уровней допуска. Если пользователь или организация выходят за рамки разрешённых сценариев, OpenAI оставляет за собой возможность ограничить или убрать доступ. Это не отменяет риски, но делает модель распространения ближе к инфраструктуре повышенной опасности, чем к обычной подписке на чат-бота.

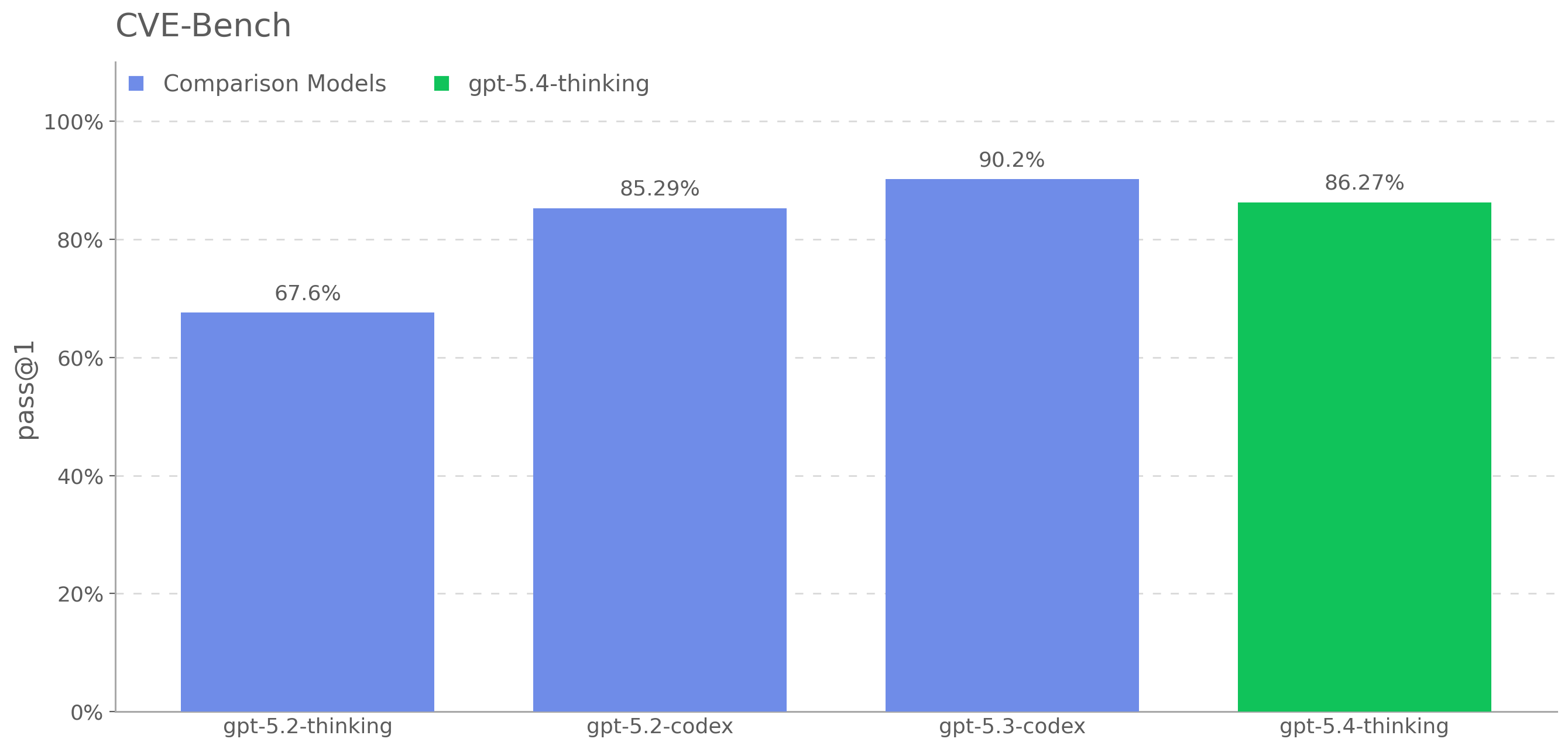

На CVE-Bench GPT-5.4 Thinking получила 86,27%, а gpt-5.3-codex - 90,2%. Это ещё один повод не превращать анонс GPT-5.4-Cyber в простую гонку процентов. Важнее режим применения: кому модель помогает, в каких задачах и как разработчик снижает риск двойного назначения.

Чем это отличается от Anthropic Mythos

Параллель с Anthropic здесь неизбежна. В материале о Claude Mythos и Project Glasswing мы писали, что сильные модели для киберзащиты всё чаще уходят в закрытые партнёрские программы. OpenAI теперь показывает более масштабируемую версию той же идеи.

Anthropic делает акцент на раннем доступе для ограниченного круга организаций, связанных с критически важным ПО и инфраструктурой. OpenAI пытается построить лестницу допуска: от проверенных индивидуальных исследователей до команд и поставщиков защитных решений. В обоих случаях рынок уходит от простого вопроса «какая модель сильнее» к вопросу «какой режим доверия вокруг неё построен».

Для индустрии это зрелый, но неудобный поворот. Защитникам нужны более свободные модели, потому что слишком строгие отказы мешают реальной работе. Обществу нужны ограничения, потому что те же возможности можно использовать для атак. Простого решения здесь нет. Доверенный доступ - попытка заменить грубый запрет управляемым риском.

Что это значит для команд безопасности

Для SOC, AppSec и исследовательских групп главный вывод практический: доступ к самым сильным возможностям в кибербезопасности будет всё чаще зависеть от зрелости самой команды. Вендору мало знать, что вы «занимаетесь безопасностью». Ему нужно понимать, кто вы, какие задачи решаете, как храните данные, кто отвечает за использование модели и как быстро можно расследовать спорный запрос.

Это особенно важно для русскоязычных команд, которые не всегда могут рассчитывать на прямой доступ к западным программам. Даже если конкретная программа OpenAI недоступна или доступна ограниченно, организационный урок остаётся: сильные ИИ-инструменты для безопасности будут требовать верификации, журналирования, политики допустимого использования и понятной ответственности внутри команды.

Хорошая новость: эти требования полезны и без OpenAI. Если команда уже умеет документировать разрешённые сценарии, вести аудит запросов, отделять обучение от боевых расследований и контролировать передачу чувствительных данных, ей проще внедрять любые ИИ-инструменты для кибербезопасности. Плохая новость: «просто дать всем доступ к мощной модели» будет всё хуже проходить проверку рисков.

Где остаются риски

Trusted Access не решает проблему двойного назначения. Он лишь переносит её из плоскости публичного запрета в плоскость доверия и контроля. Там тоже есть слабые места.

- Проверка участников может ошибаться: легитимная организация не гарантирует легитимное поведение каждого пользователя.

- Разные уровни доступа создают неравенство между командами: крупные вендоры получают больше возможностей, независимые исследователи - меньше.

- Телеметрия и мониторинг улучшают безопасность, но поднимают вопросы приватности расследований и чувствительных данных.

- Слишком строгий контроль может снова привести к избыточным отказам, только уже внутри доверенной программы.

Поэтому главный вопрос к OpenAI на ближайшие месяцы - не только «насколько хороша GPT-5.4-Cyber». Важнее, как компания будет проверять участников, обрабатывать пограничные запросы, объяснять отказы и публиковать данные о злоупотреблениях без раскрытия чувствительной информации.

Итог

GPT-5.4-Cyber - инфраструктурный анонс, а не очередной релиз модели ради релиза. OpenAI расширяет Trusted Access for Cyber, потому что обычная политика отказов плохо подходит для зрелой киберзащиты, а полный публичный доступ слишком рискован.

Если подход сработает, рынок получит промежуточную модель распространения: сильные ИИ-возможности попадут к защитникам после проверки, с правилами и журналированием. Это менее эффектно, чем «модель взламывает всё». Зато ближе к тому, как на практике придётся жить с моделями уровня GPT-5.4 и выше.