ARC-AGI-3 показал три системные ошибки frontier-моделей

ARC Prize разобрала 160 прогонов GPT-5.5 и Claude Opus 4.7 и показала три повторяющихся сбоя, которые потом ломают и реальные агентные сценарии.

По состоянию на 2 мая 2026 года самый интересный материал вокруг ARC-AGI-3 - не сам leaderboard, а разбор 160 реплеев GPT-5.5 и Claude Opus 4.7, который ARC Prize Foundation опубликовала 1 мая. На semi-private наборе GPT-5.5 набрала 0,43%, Opus 4.7 - 0,18%. Но важнее не эти доли процента, а три повторяющихся сбоя, которые команда увидела в reasoning traces и пошаговых логах.

Это показательно еще и потому, что речь идет о свежих frontier-релизах. Anthropic объявила Claude Opus 4.7 16 апреля 2026 года, OpenAI представила GPT-5.5 23 апреля 2026 года. Обе компании продают эти модели как более сильные в длинных задачах, работе с инструментами и автономном выполнении сложных сценариев. ARC-AGI-3 проверяет именно этот слой, где агенту нужно не угадать ответ, а освоиться в незнакомой среде.

Факты, даты релизов, названия моделей и числа ниже проверены 2 мая 2026 года по официальным источникам ARC Prize, OpenAI и Anthropic. У ARC-AGI-3 и страниц моделей данные могут обновляться, поэтому для сравнений после этой даты лучше перепроверять первоисточники.

Что именно измеряет ARC-AGI-3

ARC Prize описывает ARC-AGI-3 как серию из 135 новых окружений, собранных вручную. В техническом отчете набор разбит на 25 public demo-окружений, 55 semi-private и 55 fully private. Важна не только разбивка, а сам принцип: модели не дают инструкцию, как играть, и не объясняют механику заранее. Им нужно исследовать интерфейс, вывести правила из скупой обратной связи, проверить гипотезу, отказаться от неверной догадки и перенести найденную закономерность на следующий уровень.

Это делает ARC-AGI-3 полезным не только как соревнование для лабораторий, но и как инструмент аудита. В блоге ARC Prize прямо пишет, что каждый запуск сохраняется вместе с reasoning traces, а всего в ARC-AGI-3 уже сыграли больше миллиона партий. Для нынешнего разбора команда выгрузила публичные логи GPT-5.5 и Opus 4.7, написала эталонную стратегию для каждой игры, попросила Codex и Claude Code выделить failure mode, а затем вручную проверила выводы.

Есть еще один важный фильтр качества. По техотчету, каждое окружение перед включением в набор должны были независимо решить как минимум два человека без специальной подготовки. Иными словами, ARC-AGI-3 не пытается поймать модель на нечестной головоломке. Он проверяет, может ли система быстро построить рабочую модель мира в новой среде.

Сбой 1. Модель видит локальный эффект, но не собирает из него правило

ARC Prize называет этот паттерн true local effect, false world model. Модель замечает, что конкретное действие что-то меняет на экране, но не может собрать из этого локального наблюдения общее правило среды. Проще говоря: кнопка сработала, но что именно она значит для всей задачи, модель так и не поняла.

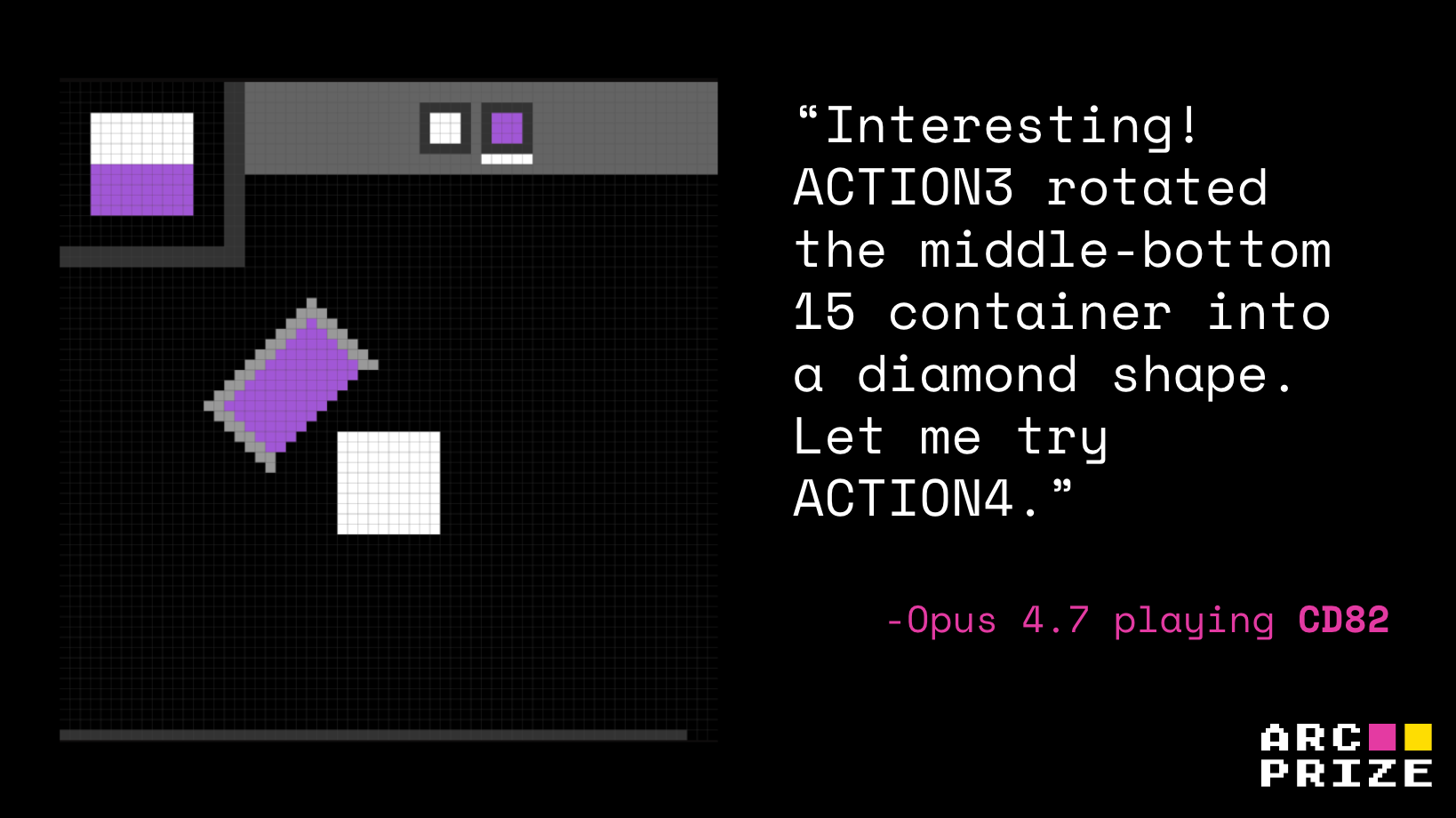

В разборе Opus 4.7 по уровню cd82 видно именно это. Модель замечает, что ACTION3 вращает объект, а другой ход меняет состояние контейнера, но не приходит к рабочей гипотезе уровня вида «сначала поверни форму, потом примени действие так, чтобы получить нужный результат в целевой зоне». На другом уровне, cn04, Opus нащупывает верную идею rotate-then-place, но затем уходит в ложную теорию про общий прогресс и начинает тратить ходы на неправильную цель.

Это опасный сбой для реальных агентных систем, потому что он выглядит как частичный успех. Агент нажал кнопку, открыл меню, вызвал инструмент, увидел изменение и даже может правдоподобно объяснить, что произошло. Но от наблюдения до устойчивой модели среды он не доходит. В продакшене так ломаются формы, админки, внутренние панели и API, где локальный ответ системы еще не означает, что агент правильно понял весь workflow. Мы уже видели похожую проблему в материале «Бенчмарки ИИ-агентов ломаются: почему 100% не значит способность», только ARC-AGI-3 показывает ее не на сломанной метрике, а на живых реплеях.

cd82: модель замечает локальный эффект вращения, но не собирает из него рабочее правило среды. Источник: ARC Prize.Сбой 2. Модель тащит в новую среду ложную аналогию из обучающих данных

Второй failure mode ARC Prize формулирует как wrong level of abstraction from training data. На практике это выглядит так: модель видит что-то немного похожее на знакомую игру или паттерн и слишком рано решает, что уже поняла жанр задачи. После этого вся стратегия строится на неверной аналогии.

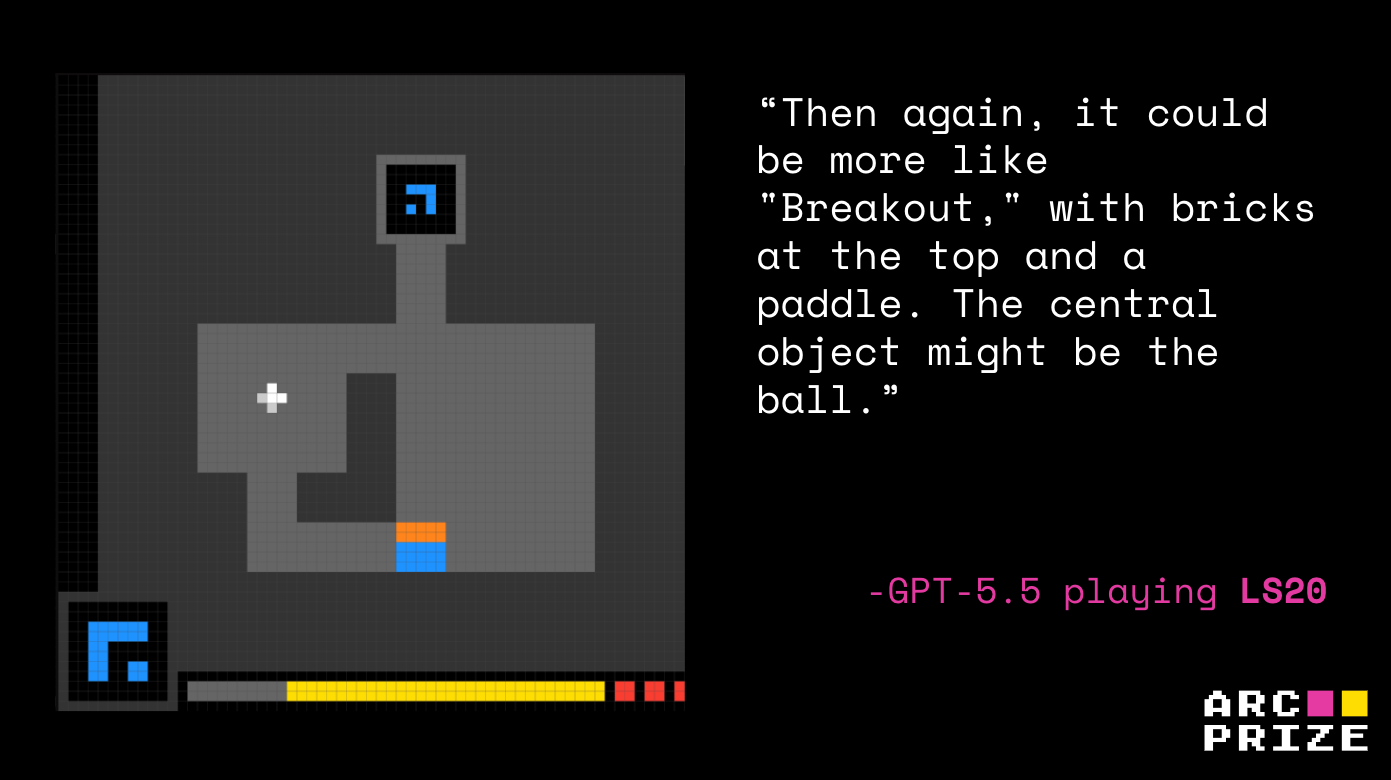

В блоге приводят длинный список ложных ассоциаций: Tetris, Frogger, Sokoban, Flood-It, Breakout, Pong и другие. Для GPT-5.5 особенно показателен уровень ls20, который модель начинает трактовать как разновидность Breakout, хотя механика там другая. Похожая история случается и на cd82, где GPT-5.5 цепляется за образы песка, физики и Flood-It. Локальное сходство превращается в полную теорию игры, а затем модель тратит ходы на проверку неверных affordance.

Это уже не проблема «модель ничего не видит». Наоборот, она видит слишком много знакомого там, где нужна дисциплина. Для агента, который работает с сайтом, корпоративной системой или десктопным приложением, такой перенос особенно вреден. Интерфейс может напоминать другую систему, но реальные правила доступа, порядок шагов и поведение кнопок будут иными. Если агент рано уверует в чужую аналогию, он начинает уверенно ломать задачу, а не просто медленно ошибаться.

ls20: локальное сходство превращается в ложную теорию игры, и модель уходит в неверную аналогию. Источник: ARC Prize.Сбой 3. Модель проходит уровень, но не учится на собственной победе

Третий failure mode звучит обманчиво мягко: solved the level, didn’t learn the game. На деле это один из самых неприятных сценариев для любой автономной системы. Модель формально получает награду за уровень, но эта награда не помогает ей понять механику и пройти дальше.

ARC Prize разбирает здесь два прогона Opus 4.7. На ka59 модель проходит первый уровень за 37 действий, но ее теория клика оказывается неправильной: удачный проход был следствием совпадения между неверно понятой примитивной механикой и достаточно forgiving-структурой уровня. Когда второй уровень требует настоящего правила, модель цементирует ложную интерпретацию и застревает в цикле. На ar25 картина похожая: Opus сначала правильно считывает зеркальное движение, позже даже обнаруживает новую механику подвижной оси, но все равно уходит в выдуманные правила и не переносит найденное понимание дальше.

Это важный холодный душ для рынка AI-агентов. Победа на одном шаге, одном уровне или одном экране еще не доказывает, что агент понял процесс. Она может означать лишь то, что текущая среда простила ошибочную гипотезу. Именно поэтому длинные сценарии и многошаговые workflow до сих пор роняют даже сильные системы. В этом смысле ARC-AGI-3 хорошо рифмуется с нашими выводами по GTA-2 benchmark AI-агентов: агент может неплохо стартовать, но проваливает перенос понимания на следующую стадию задачи.

ka59: удачный первый этап не превращается в перенос понимания на следующий уровень. Источник: ARC Prize.GPT-5.5 и Opus 4.7 ломаются по-разному

Отдельная ценность ARC Prize в том, что разбор не сводится к одной цифре. Команда прямо пишет: Opus compressed its observations into a confident-but-wrong theory, GPT-5.5 had difficulty compressing at all. По-русски это можно перевести так: Opus 4.7 быстрее схватывает механику короткого горизонта, но охотнее строит цельную и уверенную, хотя ложную теорию. GPT-5.5, наоборот, чаще озвучивает правильные куски наблюдений, но хуже превращает их в устойчивый план действий.

Это различие легко потерять, если смотреть только на итоговый счет. Но для инженерной команды оно важнее score. Один тип модели будет опасен ранней самоуверенностью и жестким зацикливанием на неверном правиле. Другой будет опасен бесконечным расширением пространства гипотез, когда верная идея уже рядом, а агент все еще перебирает Tetris, Frogger, Pong и Tower of Hanoi вместо того, чтобы зафиксировать рабочую стратегию.

У ARC Prize есть и методическая оговорка: в стандартных тестах GPT-5.5 не возвращала reasoning traces, поэтому качественный анализ делали на отдельном analysis mode, который лучше вытягивает явные рассуждения модели. При этом официальный score GPT-5.5 в 0,43% остается score из обычного ARC-AGI-3 harness. Это важная деталь: qualitative-разбор и leaderboard здесь не подменяют друг друга.

Почему этот разбор важнее обычной новости про benchmark

Удобство ARC-AGI-3 в том, что он показывает не просто «модель не решила задачу», а как именно она дошла до провала. Для рынка AI-агентов это полезнее красивого процента в таблице. Реальные агенты работают не в стерильном промпте, а на чужих сайтах, во внутренних формах, в CRM, таблицах, API и документах, где почти каждый сбой выглядит как одна из трех историй выше: локальный эффект без понимания системы, ложная аналогия из прошлого опыта или формальный промежуточный успех без настоящего обучения.

Поэтому ARC-AGI-3 стоит читать не как доказательство, что «AGI не будет» и не как повод списать frontier-модели со счетов. Вывод намного приземленнее и полезнее: агентный стек надо оценивать не по способности эффектно открыть уровень, а по тому, как он строит модель мира, обновляет ее после ошибки и переносит найденное правило на следующий шаг. Если этого нет, то даже сильная модель будет вести себя как стажер, который быстро нажимает кнопки, но не понимает, почему вчерашний удачный обход сегодня уже не работает.

Если нужен общий фон, почему именно автономное исполнение становится главным полем борьбы, его лучше смотреть в нашем базовом разборе что такое AI-агенты и где они реально работают. А ARC-AGI-3 полезен как более жесткая проверка того, чего этим агентам пока не хватает.

Главное

ARC Prize Foundation показала не просто слабый score GPT-5.5 и Opus 4.7 на ARC-AGI-3. Она показала три повторяющихся поломки, которые выглядят знакомо любому, кто уже пытался дать агенту реальную работу: модель замечает локальный эффект, но не строит модель мира; тащит в новую среду ложную игру из обучающих данных; случайно проходит этап, но не учится на собственной победе. Для новостной ленты это звучит как очередной benchmark. Для разработчиков и продуктовых команд это намного полезнее: здесь видно, где именно у frontier-моделей сегодня заканчивается автономность.