OpenClaw без Claude: как перейти на открытые модели через Hugging Face

Anthropic закрутила гайки: использовать токены подписки Claude Pro/Max в сторонних инструментах теперь нельзя. Hugging Face предложил конкретный путь миграции — на GLM-5 или Qwen3.5-35B-A3B.

Anthropic закрутила гайки: использовать токены подписки Claude Pro/Max в сторонних инструментах теперь нельзя. Для 214 тысяч пользователей OpenClaw это выбор — платить за API или искать альтернативу. Hugging Face предложил конкретный путь миграции на GLM-5 через облачный Inference Providers или на Qwen3.5-35B-A3B локально через llama.cpp. Ниже — пошаговая настройка обоих вариантов, сравнение с Claude и реальные ограничения.

Что произошло с OpenClaw и Anthropic

OpenClaw — open-source фреймворк для автономных AI-агентов, который за четыре месяца набрал больше 214 000 звёзд на GitHub. Проект запустился в ноябре 2025-го под именем Clawdbot (отсылка к Claude от Anthropic), пережил два переименования после претензии Anthropic по товарному знаку и в итоге стал OpenClaw. Создатель проекта, австрийский разработчик Петер Штайнбергер, в феврале 2026-го перешёл в OpenAI для работы над персональными агентами, а сам OpenClaw передали независимому open-source фонду.

OpenClaw работает как фоновый процесс на вашей машине. Он подключается к мессенджерам — WhatsApp, Telegram, Slack, Discord — и выполняет задачи: запускает команды в терминале, управляет файлами, ходит в браузер, обрабатывает почту. По умолчанию рекомендованная модель — Claude Opus 4.6 за счёт большого контекстного окна и устойчивости к prompt injection.

В феврале 2026 года Anthropic обновила документацию Claude Code, добавив прямой запрет на использование OAuth-токенов подписок Pro и Max в сторонних инструментах. Формулировка: «Anthropic does not permit third-party developers to offer Claude.ai login or to route requests through Free, Pro, or Max plan credentials on behalf of their users». Это ударило по OpenClaw, NanoClaw и другим агентам, которые использовали токены подписки вместо платного API.

После волны возмущения на Reddit и X Anthropic пошла на попятную. Сотрудник компании Тарик Шихипар написал: «Ничего не меняется в том, как вы можете использовать Agent SDK и подписки Max». Но уточнил: если вы строите бизнес поверх Agent SDK — используйте API-ключ. Многие в сообществе восприняли это как сигнал: эпоха дешёвого безлимитного доступа к мощным моделям подходит к концу.

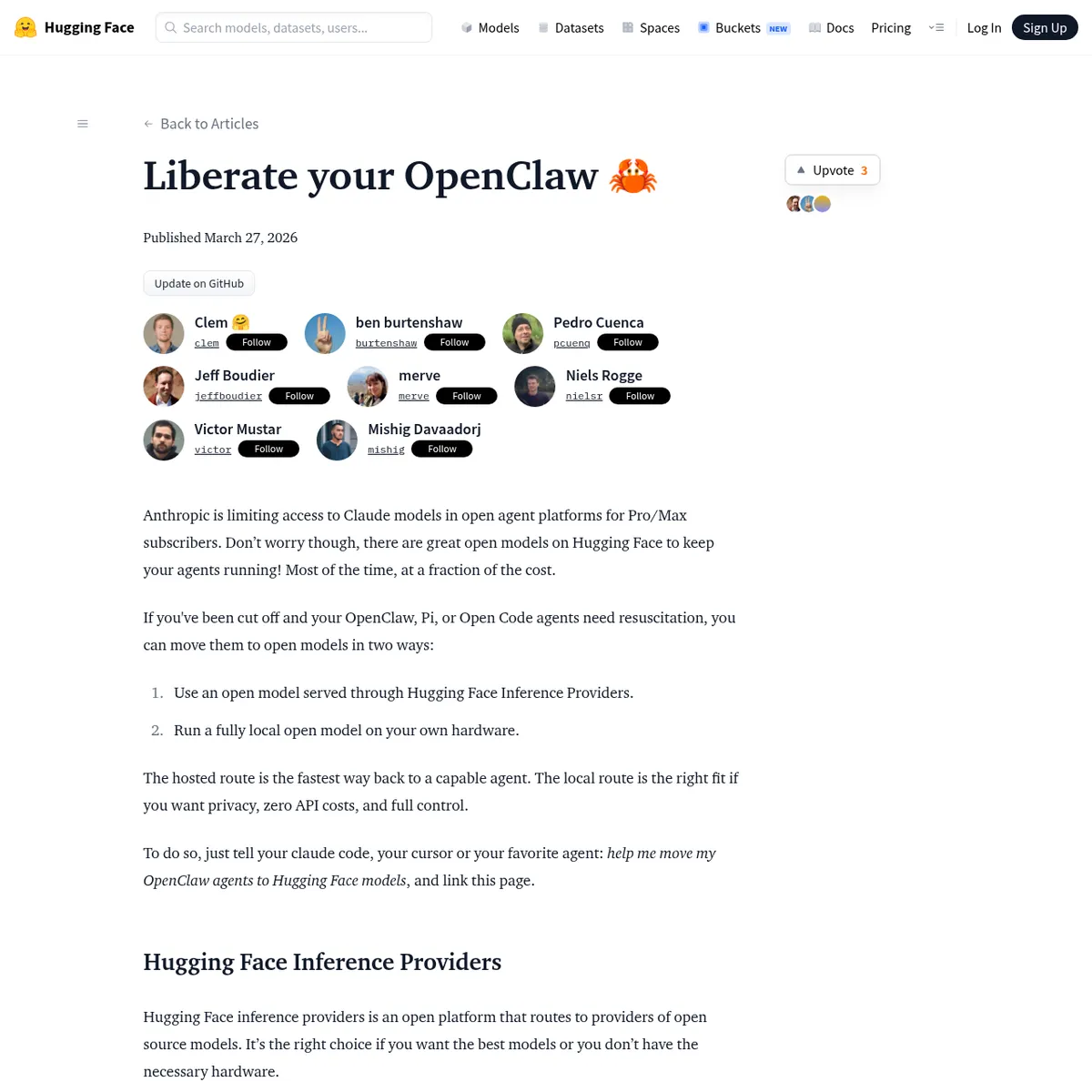

Что предлагает Hugging Face

Hugging Face опубликовал гайд «Liberate your OpenClaw» с пошаговой инструкцией по переносу агентов с Claude на открытые модели. Два варианта: через облако или локально.

Облачный путь: Hugging Face Inference Providers

Inference Providers — платформа, которая маршрутизирует запросы к провайдерам open-source моделей. Подключение занимает пару минут:

- Создать токен на huggingface.co

- Запустить

openclaw onboard --auth-choice huggingface-api-key - Выбрать модель из каталога

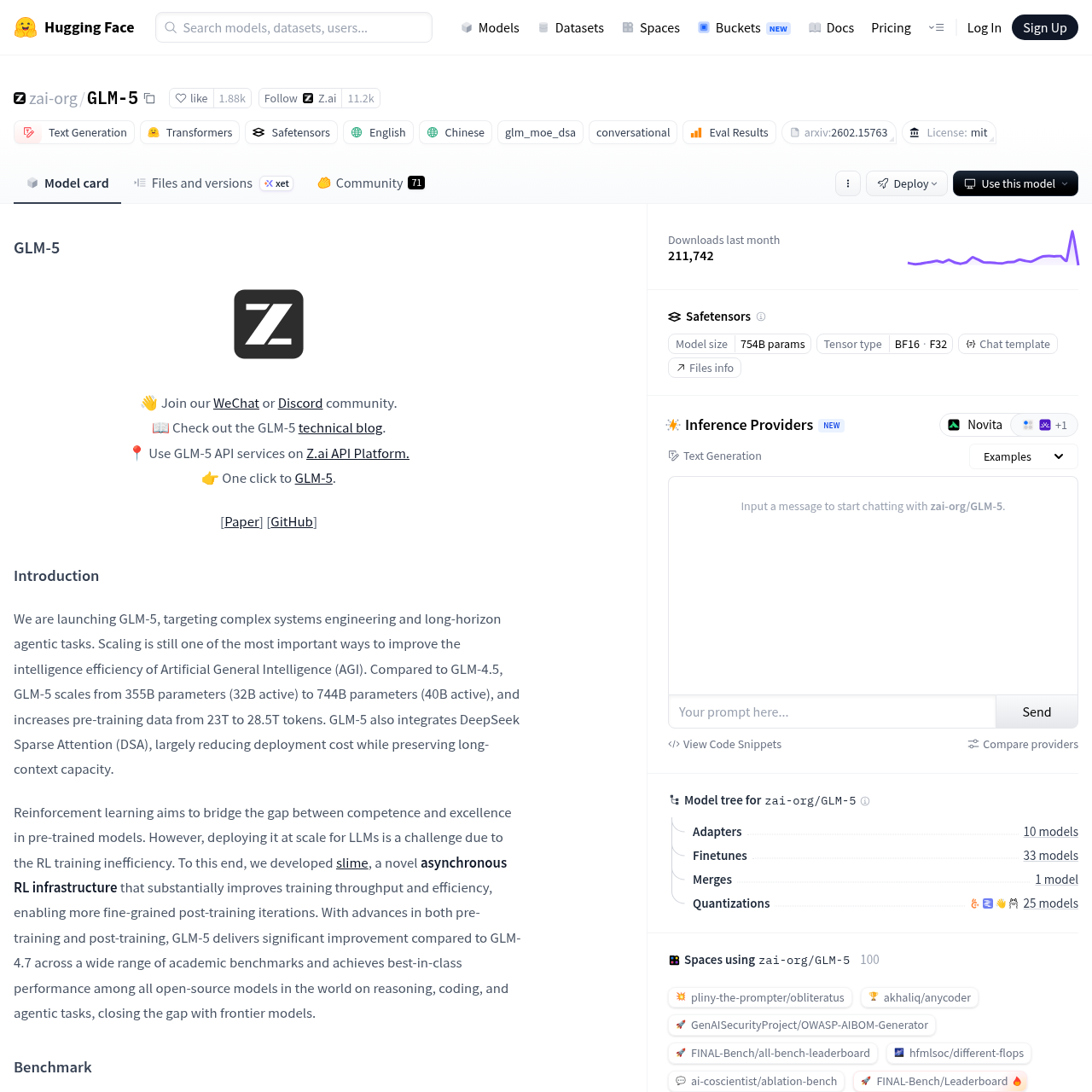

Hugging Face рекомендует GLM-5 от Z.ai — 744-миллиардную модель с архитектурой Mixture-of-Experts. По данным HuggingFace, она показывает лучшие результаты на Terminal Bench среди open-source моделей. Бенчмарки по состоянию на март 2026:

| Бенчмарк | GLM-5 | Claude Opus 4.6 |

|---|---|---|

| SWE-bench Verified | 77,8% | ~80,8% |

| Terminal-Bench 2.0 (Terminus) | 56,2–60,7 | — |

| Terminal-Bench 2.0 (Claude Code) | 56,2–61,1 | — |

| HLE with Tools | 50,4 | — |

| BrowseComp | 75,9 | — |

Конфигурация в OpenClaw:

{

"agents": {

"defaults": {

"model": {

"primary": "huggingface/zai-org/GLM-5:fastest"

}

}

}

}Подписчики HF PRO получают $2 бесплатных кредитов в месяц на Inference Providers.

Локальный путь: llama.cpp + Qwen3.5-35B-A3B

Второй вариант — запуск модели локально через llama.cpp. Подходит тем, кому критична приватность и кто не хочет платить за API вообще.

Qwen3.5-35B-A3B — модель от Alibaba Cloud (команда Qwen), выпущенная 24 февраля 2026 года. Это Mixture-of-Experts: 35 миллиардов параметров, из которых активны только 3 миллиарда на каждый токен. Контекстное окно — 262 144 токена. Гибридная архитектура: линейное внимание + разреженный MoE.

Установка:

# macOS или Linux

brew install llama.cpp

# Windows

winget install llama.cppЗапуск сервера с веб-интерфейсом:

llama-server -hf unsloth/Qwen3.5-35B-A3B-GGUF:UD-Q4_K_XLМодель работает с 32 ГБ RAM. На Apple M1 с 64 ГБ пользователи сообщают о скорости около 27 токенов в секунду. Подключение к OpenClaw:

openclaw onboard --non-interactive \

--auth-choice custom-api-key \

--custom-base-url "http://127.0.0.1:8080/v1" \

--custom-model-id "unsloth-qwen3.5-35b-a3b-gguf" \

--custom-api-key "llama.cpp" \

--secret-input-mode plaintext \

--custom-compatibility openaiОблако или локально: что выбрать

| Параметр | HF Inference Providers | Локальный llama.cpp |

|---|---|---|

| Время настройки | 2–3 минуты | 15–30 минут |

| Стоимость | По токенам (есть $2 бесплатно/мес) | Бесплатно (только железо) |

| Приватность | Данные идут на сервер провайдера | Полная |

| Качество моделей | GLM-5, тысячи вариантов | Ограничено мощностью железа |

| Минимальные требования | Интернет + API-ключ | 32 ГБ RAM для Qwen3.5-35B-A3B |

| Контекстное окно | Зависит от модели, до 256K+ | 262K у Qwen3.5-35B-A3B, но качество падает при заполнении |

Если нужно быстро вернуть агента в строй — облачный вариант. Если критична приватность и нулевой счёт за API — локальный.

Реальные ограничения открытых моделей

Открытые модели пока не заменяют Claude Opus 4.6 один в один. OpenClaw требует контекстные окна от 64K токенов — на таких масштабах локальные модели теряют в качестве. GLM-5 отстаёт от Opus 4.6 на 3 пункта по SWE-bench Verified (77,8% против ~80,8%).

На простых задачах (утренние сводки, управление умным домом, мониторинг почты) разница незаметна. На сложных — ночная автономная работа, многошаговый рефакторинг кода — Claude пока сильнее.

Про стоимость. OpenClaw на Claude Sonnet 4.5 обходится в $15–50 в месяц при умеренном использовании. GLM-5 через Inference Providers тоже стоит денег — просто оплата идёт по токенам, а не через подписку. Реальная экономия появляется только при локальном запуске, но там нужно железо: Mac Mini M4 (~$640 разово) или VPS от €4/месяц.

Безопасность: о чём помнить

OpenClaw, независимо от модели, остаётся инструментом с серьёзными рисками:

- Более 21 000 экземпляров OpenClaw обнаружены в открытом доступе в интернете — с утечками API-ключей и историй чатов

- Cisco проверила 31 000 навыков (skills) для OpenClaw — 26% содержали уязвимости

- Атака ClawHavoc загрузила 341 вредоносный навык на ClawHub, устанавливавших стилер для macOS

- Microsoft рекомендовала относиться к OpenClaw как к «недоверенному выполнению кода с постоянными учётными данными»

Смена модели эти проблемы не решает. Зависимость от Anthropic уходит, но необходимость изолировать агента на отдельной машине, использовать отдельные аккаунты и проверять навыки перед установкой — остаётся.

Как мигрировать за 10 минут

Для тех, кто хочет быстро переключить работающий OpenClaw:

- Зарегистрируйтесь на huggingface.co и создайте API-токен

- Запустите

openclaw onboard --auth-choice huggingface-api-key - Вставьте токен и выберите GLM-5 (или другую модель)

- Проверьте, что агент отвечает: отправьте тестовое сообщение через привычный мессенджер

- Если нужна тонкая настройка — укажите

repo_idмодели в конфиге OpenClaw

На всё уходит меньше 10 минут.

Hugging Face предложил рабочий путь миграции. Открытые модели пока уступают Claude на сложных задачах, но для повседневных сценариев GLM-5 через Inference Providers или Qwen3.5-35B-A3B локально справляются не хуже. Главное — OpenClaw продолжает работать без привязки к подписке Anthropic.

Зависимость от одного провайдера модели — это риск, и история с Anthropic в феврале 2026-го наглядно это подтвердила. Открытые модели дают страховку, даже если до коммерческих лидеров пока не дотягивают.