Расследование OpenAI во Флориде: что проверяют

Флорида проверяет, мог ли ChatGPT помочь подозреваемому в стрельбе в FSU. Главное здесь не «вина чатбота», а документы, процедуры безопасности и передача сигналов правоохранителям.

Расследование OpenAI во Флориде началось 21 апреля 2026 года после проверки переписок между ChatGPT и Phoenix Ikner, подозреваемым в стрельбе в Florida State University 17 апреля 2025 года. По данным Associated Press, в том нападении погибли два человека, ещё шесть были ранены.

Главное здесь не в том, чтобы объявить чатбот «виновным». Пока это расследование, а не обвинительный приговор. Но прокуратура Флориды переводит спор о безопасности ChatGPT в юридическую плоскость: если система могла давать опасные ответы, что именно знала OpenAI, какие правила действовали тогда и когда компания должна была передать сигнал правоохранителям?

По состоянию на 21 апреля 2026 года OpenAI отрицает ответственность за преступление и говорит, что сотрудничает со следствием. Все формулировки ниже основаны на публичных заявлениях прокуратуры Флориды, AP, TechCrunch и открытых политиках OpenAI.

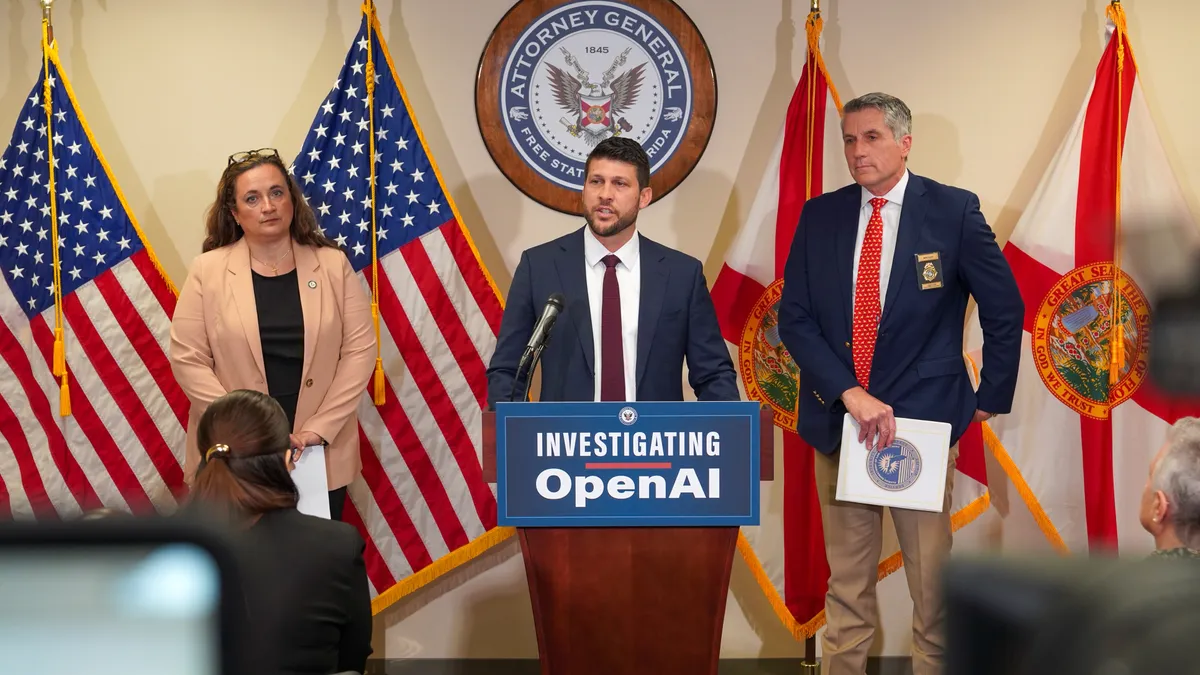

Что произошло 21 апреля

Офис генерального прокурора Флориды сообщил, что Office of Statewide Prosecution начал уголовное расследование в отношении OpenAI и ChatGPT. Поводом стала первичная проверка логов переписки между ChatGPT и Ikner.

Прокурор James Uthmeier утверждает, что следствие проверяет, мог ли ChatGPT помогать, подстрекать или советовать при подготовке преступления. В релизе прокуратура отдельно ссылается на принцип Florida law, по которому тот, кто помогает, подстрекает или консультирует при совершении преступления, может считаться principal к этому преступлению.

Это важный юридический сдвиг. Дискуссия обычно звучит как моральный вопрос: «может ли ИИ навредить человеку». Флорида формулирует иначе: какие документы, политики, обучающие материалы и процедуры OpenAI существовали на момент инцидента и что они говорили о рисках вреда.

Что именно запросила прокуратура

Повестка OpenAI охватывает период с 1 марта 2024 года по 17 апреля 2026 года. Прокуратура запросила политики и внутренние обучающие материалы по трём группам тем:

- угрозы причинения вреда другим людям;

- угрозы самоповреждения;

- сотрудничество с правоохранителями, включая правила сообщения о возможных прошлых, текущих или будущих преступлениях.

Отдельно запрошены даты изменений политик, если за этот период их было несколько. Это деталь, на которую стоит смотреть внимательно. Следствие интересуется не только тем, что OpenAI пишет в публичных правилах сейчас, а тем, какие правила действовали в конкретные даты вокруг инцидента.

Ещё один блок касается структуры компании и команды ChatGPT: организационная схема, руководители и сотрудники на три даты — 1 марта 2024 года, 1 октября 2024 года и 17 апреля 2025 года. Такой запрос выглядит как попытка понять, кто отвечал за продуктовые решения и безопасность в нужный момент.

Что отвечает OpenAI

По данным Associated Press, представительница OpenAI Kate Waters назвала стрельбу трагедией, но заявила, что компания не несёт за неё ответственности. Позиция OpenAI: ChatGPT давал фактические ответы на вопросы с информацией, которую можно было найти в открытых источниках, и не поощрял незаконные или вредные действия. Компания также говорит, что заранее делилась информацией с правоохранителями и продолжает сотрудничать со следствием.

Для OpenAI это логичная линия защиты. Но для прокуратуры ключевой вопрос шире: достаточно ли сказать «это была общедоступная информация», если последовательность запросов указывала на риск реального насилия? Именно здесь начинается неприятная зона между контентной модерацией, безопасностью продукта и юридической ответственностью.

Публичные Usage Policies OpenAI, действующие с 29 октября 2025 года, запрещают использовать сервисы для насилия, разработки, приобретения или применения оружия, незаконной деятельности, самоповреждения и обхода защитных механизмов. Но расследование смотрит не только на текст правил. Оно будет упираться в то, как эти правила срабатывали в продукте и кто видел опасные сигналы.

Почему это тест на передачу риска

В техническом смысле эта история не про «личность» ChatGPT. Она про передачу риска: когда модель или платформа видит возможный переход от странного разговора к опасному намерению, что происходит дальше?

Минимальный контур выглядит так:

- модель должна распознать опасный запрос и не давать прикладную помощь;

- система должна зафиксировать событие так, чтобы его можно было проверить позже;

- внутренние политики должны объяснять, когда инцидент передаётся человеку, команде безопасности или правоохранителям;

- компания должна уметь показать, какие правила действовали на момент разговора, а не только после публичного скандала.

OpenAI публично описывает часть этой логики в Model Spec: модель не должна помогать с причинением серьёзного вреда, должна безопасно отвечать на признаки самоповреждения, бредовых убеждений или мании и не должна усиливать опасное намерение. В Deployment Safety Hub компания также собирает системные карты и материалы о проверках безопасности моделей.

Проблема в том, что публичная политика и реальный продукт — разные уровни доказательств. Политика говорит, что должно происходить. Логи, версии правил, внутренние инструкции и цепочка эскалации показывают, что происходило на самом деле.

Где проходит граница ответственности

Для читателя из технологической среды здесь важнее не политическая риторика Флориды, а будущий стандарт доказательств для ИИ-платформ. Если пользователь применяет модель во вред, платформа почти всегда скажет: человек несёт ответственность за свои действия. Это сильный аргумент. Но он не закрывает вопрос о том, как платформа спроектировала ограничения, мониторинг и реакцию на опасные паттерны.

Мы уже разбирали общий слой этой проблемы в материале про ответственность ИИ: ошибка модели, вред от рекомендации и вред от действия человека требуют разных юридических рамок. Новый кейс отличается тем, что речь идёт не о неудачном совете в вакууме, а о возможной серии запросов перед насильственным преступлением.

Вторая внутренняя связь — Model Spec от OpenAI. Там важна не философия «как должен вести себя хороший помощник», а практический вопрос: можно ли по этому документу восстановить продуктовую логику отказов, безопасных ответов и эскалации? Следствие, суды и регуляторы всё чаще будут спрашивать именно это.

Третья близкая тема — защитные ограничения и вредные навыки агентов. В разборе HarmfulSkillBench мы писали, что опасность появляется не только в «плохом ответе», а в способности системы помочь пользователю перейти к действию. В кейсе Флориды этот тезис становится менее академическим.

Что смотреть дальше

Первый пункт — ответ OpenAI на повестку. Если документы покажут, что политики менялись вокруг критичных дат, важны будут не сами изменения, а их причины и сроки. Второй пункт — гражданские иски. TechCrunch ещё 9 апреля писал, что семья одного из погибших планировала судиться с OpenAI из-за предполагаемой роли ChatGPT в подготовке нападения.

Третий пункт — политический контекст. AP сообщает, что губернатор Ron DeSantis созвал специальную сессию, где среди тем должен быть Artificial Intelligence Bill of Rights. Поэтому кейс OpenAI может быстро стать не только уголовным расследованием, но и аргументом в споре о новых правилах для чатботов.

Для ИИ-компаний вывод уже понятен. Публичных «мы заботимся о безопасности» мало. Нужны проверяемые журналы решений, версия политики на дату инцидента, понятный порядок эскалации и ответ на простой вопрос: что система делает, когда разговор перестаёт быть абстрактным?

Итог

Расследование OpenAI во Флориде не доказывает вину ChatGPT и не делает модель субъектом права. Но оно показывает, куда движется спор об ответственности ИИ-платформ. Следующий этап будет не про красивые принципы безопасности, а про документы, логи, даты изменений и передачу риска от модели к людям.

Если Флорида доведёт дело до серьёзного юридического теста, вопрос для всей отрасли станет жёстче: достаточно ли отказов и публичных правил, если опасный сценарий всё равно прошёл через продукт?