GPT-Rosalind: зачем OpenAI нужна модель для биологии

GPT-Rosalind — новая модель OpenAI для биологии и разработки лекарств. Разбираем доступ, Codex-плагин, бенчмарки и ограничения.

GPT-Rosalind — не очередное название для общего ChatGPT. 16 апреля 2026 года OpenAI представила отдельную модель для исследований в биологии, разработке лекарств и трансляционной медицине. По состоянию на 18 апреля 2026 года это не публичный релиз для всех пользователей: доступ идёт через предварительную исследовательскую программу для проверенных корпоративных клиентов, сначала в США.

Главный смысл новости в том, что OpenAI выделяет науки о жизни в отдельный продуктовый и безопасностный контур. Модель обещает лучше работать с химией, белками, геномикой, научной литературой, базами данных и планированием экспериментов. Но вместе с этим OpenAI сразу ставит ограничения: корпоративный договор, проверка сценария применения, правила управления доступом и запрет на внешние коммерческие приложения на этапе предварительного доступа.

Это важный сигнал для рынка ИИ в фарме. Сильные модели для биологии не будут распространяться так же просто, как универсальный чат-бот. В этой области полезные и опасные возможности слишком близко лежат друг к другу.

Что именно запустила OpenAI

Официальный анонс OpenAI описывает GPT-Rosalind как передовую модель рассуждения для биологии, разработки лекарств и трансляционной медицины. Компания пишет, что это первый релиз в серии моделей для наук о жизни. Модель доступна в ChatGPT, Codex и API для клиентов, прошедших отбор по программе доверенного доступа.

Сухая версия фактов выглядит так.

| Факт | Что подтверждено | Источник |

|---|---|---|

| Дата анонса | 16 апреля 2026 года | OpenAI |

| Каналы доступа | ChatGPT Enterprise, Codex и OpenAI API | OpenAI Help Center |

| Кто может получить доступ | корпоративные клиенты в США, соответствующие требованиям и имеющие Enterprise-договоры; индивидуальные исследователи пока не поддерживаются | OpenAI Help Center |

| Коммерческое использование | на этапе предварительного доступа модель не предназначена для продуктов, обращённых к внешним клиентам, и внешних коммерческих приложений | OpenAI Help Center |

| Оплата в preview | использование не расходует уже оплаченные корпоративные кредиты или токены; возможны лимиты | OpenAI Help Center |

OpenAI также отдельно говорит о Life Sciences research plugin для Codex. По отношению к GPT-Rosalind это инфраструктурный слой: он помогает подключать модель к источникам, инструментам и базам данных, которыми реально пользуются исследователи.

Почему OpenAI понадобилась отдельная модель для биологии

Науки о жизни плохо ложатся в формат «модель ответила на вопрос». Исследовательская задача обычно распадается на цепочку: найти литературу, проверить гены, белки или варианты, свериться с базами, сформулировать гипотезу, спланировать эксперимент и не перепутать уровень доказательности. Ошибка в одном месте тянет за собой плохие решения дальше.

OpenAI прямо пишет, что разработка нового лекарства в США в среднем занимает 10-15 лет от поиска мишени до одобрения регулятором. Поэтому компания делает акцент не на финальном «ИИ изобрёл препарат», а на ранних стадиях: биология мишени, понимание механизма, синтез литературы, интерпретация омикс-данных, формулировка гипотез и планирование экспериментов.

Это более честная рамка. GPT-Rosalind не заменяет биолога и не становится регуляторным инструментом. OpenAI позиционирует её как помощника для ранних исследовательских этапов: там, где нужно быстро связать разрозненные источники и подготовить следующий шаг для команды.

Как здесь связан Codex research plugin

Codex в этой истории нужен не ради программирования как такового. Он становится средой, где модель может выполнять научный рабочий процесс: выбирать нужные источники, вызывать инструменты, нормализовать сущности и собирать ответ с доказательствами.

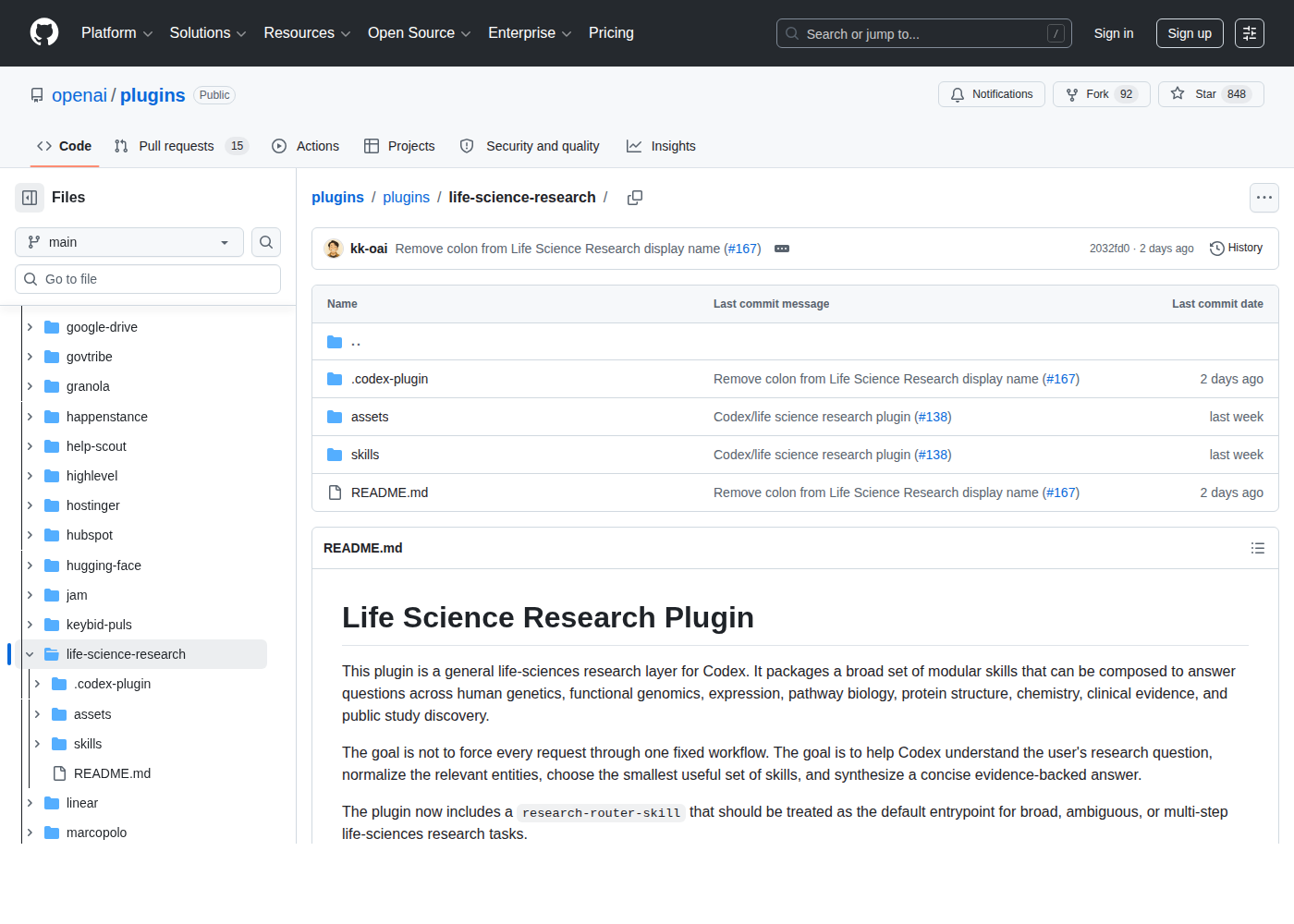

В репозитории OpenAI плагин описан как исследовательский слой для Codex. README перечисляет 50 встроенных модульных навыков: от генетики человека и анализа вариантов до структуры белков, химии, клинических данных, поиска литературы и публичных наборов данных. В официальном анонсе OpenAI формулирует это немного шире: плагин помогает подключаться к более чем 50 публичным омикс-базам, источникам литературы и биологическим инструментам.

Разграничение темы здесь принципиально. Мы уже писали про плагины OpenAI Codex и MCP-интеграции, но в этой статье Codex остаётся вспомогательным слоем. В центре доменная модель и контролируемый доступ к ней. Плагин показывает, как OpenAI собирается встраивать эту модель в практику исследователя.

Что говорят бенчмарки и где нужна осторожность

OpenAI заявляет несколько сильных результатов. На BixBench GPT-Rosalind показала лучший результат среди моделей с опубликованными оценками. На LABBench2 она превзошла GPT-5.4 в 6 из 11 задач. В совместной оценке с Dyno Therapeutics на задаче RNA sequence-to-function лучшие из десяти ответов модели в Codex оказались выше 95-го перцентиля человеческих экспертов в задаче предсказания и около 84-го перцентиля в задаче генерации последовательностей.

Эти числа стоит читать аккуратно. Они показывают, что OpenAI видит прогресс в задачах, близких к реальной исследовательской работе. Но это не независимый вывод о том, что GPT-Rosalind «лучше биологов» вообще. Часть оценок описана самой OpenAI. Dyno-задача сравнивалась с историческими результатами 57 экспертов в конкретном поле AI-bio. Даже хороший результат в бенчмарке не снимает вопросы о воспроизводимости, безопасности, качестве данных и ответственности за экспериментальные решения.

Для читателя-практика вывод проще: модель может быть полезной там, где задача требует работы с несколькими источниками и инструментами. Самые громкие цифры пока лучше воспринимать как сигнал направления, а не как готовое доказательство эффективности в лаборатории.

Почему доступ ограничен

Биология — типичная зона двойного назначения. Один и тот же инструмент может помочь в разработке терапии и упростить опасные сценарии. Поэтому OpenAI запускает GPT-Rosalind через доверенный доступ: сначала для корпоративных клиентов в США, с проверкой соответствия требованиям, управлением доступом и организационным надзором.

В справке о Life Science Research Special Access Program OpenAI объясняет логику прямо: стандартные защитные ограничения могут мешать части полезных исследовательских задач, но более свободный доступ нужно давать только проверенным организациям. Даже в special access модели должны блокировать weaponization и другие острые риски. Это тот же общий тренд, который мы разбирали на примере специализированных моделей OpenAI с ограниченным доступом: чем ближе модель к чувствительной области, тем важнее не только качество, но и режим допуска.

Для рынка это неудобная, но ожидаемая развилка. Если модель действительно хорошо работает с биологическими гипотезами, базами и экспериментальным планированием, её нельзя просто выкатить всем по подписке. Нужны договоры, роли, журналы доступа, контроль данных и понятная ответственность внутри организации.

Что это значит для фармы и исследовательских команд

Если отбросить маркетинговую оболочку, OpenAI делает ставку на корпоративные исследования и разработку. В списке клиентов и партнёров в анонсе названы Amgen, Moderna, Allen Institute, Thermo Fisher Scientific, Novo Nordisk, NVIDIA, Benchling, UCSF School of Pharmacy и другие. Массовый потребительский рынок тут вторичен; компания заходит туда, где исследования уже устроены как сложная связка людей, данных, инструментов и требований к безопасности.

Для фармы главный вопрос не в том, сможет ли GPT-Rosalind красиво пересказать статью. Это умеют многие модели. Вопрос в другом: сможет ли она стабильно помогать с выбором targets, проверкой механизма, поиском противоречий в литературе и подготовкой экспериментов так, чтобы команда быстрее принимала проверяемые решения.

Здесь у OpenAI есть сильный рынок, но и сильная конкуренция. Сделки вокруг рынка ИИ-препаратов и drug discovery уже показывают: крупные фармкомпании готовы платить за системы, которые сокращают раннюю неопределённость. GPT-Rosalind интересна тем, что OpenAI идёт не только через отдельную модель, но и через рабочую среду Codex, API и плагины для научных источников.

Итог

GPT-Rosalind стоит читать не как сенсацию «ИИ теперь делает лекарства», а как более трезвый шаг OpenAI в сторону доменных моделей. Компания признаёт, что биология требует отдельной настройки, инструментов и правил доступа. Это уже не универсальный чат с красивым именем, а корпоративная система для ранней исследовательской работы.

Главный вопрос теперь не в пресс-релизе, а в практике. Если GPT-Rosalind действительно поможет исследовательским командам быстрее связывать данные, гипотезы и эксперименты, она станет важной частью ИИ-инфраструктуры для фармы. Если нет, останется дорогим preview для узкого круга клиентов. Проверить это можно будет только по реальным кейсам, а не по одному анонсу.

Источники

- OpenAI: Introducing GPT-Rosalind for life sciences research

- OpenAI Help Center: Introducing GPT-Rosalind for life sciences research

- OpenAI Help Center: Life Science Research Special Access Program

- OpenAI GitHub: Life Science Research Plugin

- SEPE / Reuters: OpenAI launches AI model GPT-Rosalind for life sciences research