GPT-5.5 в API OpenAI: что показал суточный зазор с Codex

23 апреля GPT-5.5 появилась в ChatGPT и Codex, а 24 апреля дошла до официального API. Разбираем, почему рынок успел поискать серый маршрут через Codex и что это говорит о новой архитектуре доступа OpenAI.

GPT-5.5 в API OpenAI стала не просто ещё одним пунктом в changelog. История вокруг модели показала, что у OpenAI теперь есть как минимум два разных контура доступа к frontier-моделям: продуктовый, через ChatGPT и Codex, и штатный API-контур для разработчиков. 23 апреля 2026 года компания вывела GPT-5.5 в ChatGPT и Codex, но публичный API пообещала добавить «very soon». Уже на следующий день, 24 апреля, этот доступ открылся официально.

На первый взгляд разрыв меньше суток не выглядит отдельной новостью. На практике он оказался достаточно длинным, чтобы сообщество успело нащупать серый маршрут через Codex-авторизацию и назвать его semi-official backdoor API. Именно поэтому к 26 апреля главный вопрос звучит уже не так: не «можно ли достать GPT-5.5 через обходной путь», а «почему рынок вообще успел туда пойти, и что это говорит о новой границе между подпиской, продуктом и API».

Если коротко, история полезна не как инструкция по обходу. Она полезна как сигнал. Frontier-модель вышла сначала туда, где OpenAI контролирует продуктовую поверхность и лимиты, а уже потом в чистый разработческий контур. Для команд, которые строят агентные инструменты, это важнее самой сенсации про backdoor: меняется порядок, в котором новые модели доходят до разработчиков.

Как образовался суточный зазор

В официальном анонсе Introducing GPT-5.5 OpenAI 23 апреля 2026 года представила модель как новый флагман для coding и professional work. В тот день компания выкатила GPT-5.5 в ChatGPT и Codex, а про API написала отдельно: доступ появится very soon, потому что для API нужны другие safeguards и отдельная подготовка к масштабированию.

Это важная деталь, потому что именно она создала окно неопределённости. Модель уже можно было использовать внутри продуктовых поверхностей OpenAI, но ещё нельзя было вызывать через привычный разработческий маршрут. Для обычного пользователя это неудобство на несколько часов. Для разработчика, который хочет прогнать модель через свой harness, benchmark или production-like workflow, это уже заметная разница.

| Дата | Что открылось | Почему это важно |

|---|---|---|

| 23 апреля 2026 | GPT-5.5 в ChatGPT и Codex | Модель уже доступна в продуктовых поверхностях OpenAI, но не в публичном API. |

| 23 апреля 2026 | OpenAI обещает API «very soon» | Появляется серое окно, в котором сообщество ищет обходной путь через Codex-авторизацию. |

| 24 апреля 2026 | GPT-5.5 и GPT-5.5 Pro появляются в API | История перестаёт быть новостью про «доступа нет» и становится новостью про разрыв между продуктом и API. |

Когда OpenAI обновила анонс 24 апреля, сюжет изменился. На той же странице появилось прямое уточнение: GPT-5.5 и GPT-5.5 Pro уже доступны в API. Это значит, что любая статья на 26 апреля, которая подаёт тему как «модель доступна только через backdoor», уже промахивается по фактам. Но промахиваться по фактам здесь нельзя: именно точная хронология и делает историю интересной.

Почему разработчики вообще пошли через Codex

Хорошее объяснение дал Simon Willison в заметке A pelican for GPT-5.5 via the semi-official Codex backdoor API, опубликованной 23 апреля. Он прямо пишет, что для своих бенчмарков предпочитает API-путь, а не ChatGPT или другой готовый агентный интерфейс: так меньше скрытых системных подсказок, лишней orchestration-магии и продуктовых ограничений, которые вмешиваются в результат.

Это и есть ключ к истории. Для разработчика frontier-модель важна не только как кнопка в чате. Её нужно вызывать из своих скриптов, своих проверок, своих цепочек инструментов и своих сравнительных прогонов. Если модель уже есть внутри Codex, но ещё не дошла до официального API, рынок почти автоматически начнёт искать промежуточный путь.

Simon назвал этот путь backdoor, но это важно держать в кавычках и с атрибуцией. Речь не о взломе OpenAI и не о тайном сливе модели. Речь о том, что у компании уже существовал контур доступа через Codex-подписку и авторизацию по ChatGPT-аккаунту, а сообщество быстро проверило, можно ли использовать его для более программистского сценария, чем сама веб-поверхность Codex.

В этом смысле история похожа не на утечку, а на нормальную реакцию зрелого developer-рынка. Как только frontier-модель оказывается доступна в одной поверхности, разработчики почти сразу пытаются перенести её в свои контуры: терминал, IDE, benchmark harness, плагины и автоматизации. Именно это и случилось с GPT-5.5.

Что у OpenAI уже было открыто официально

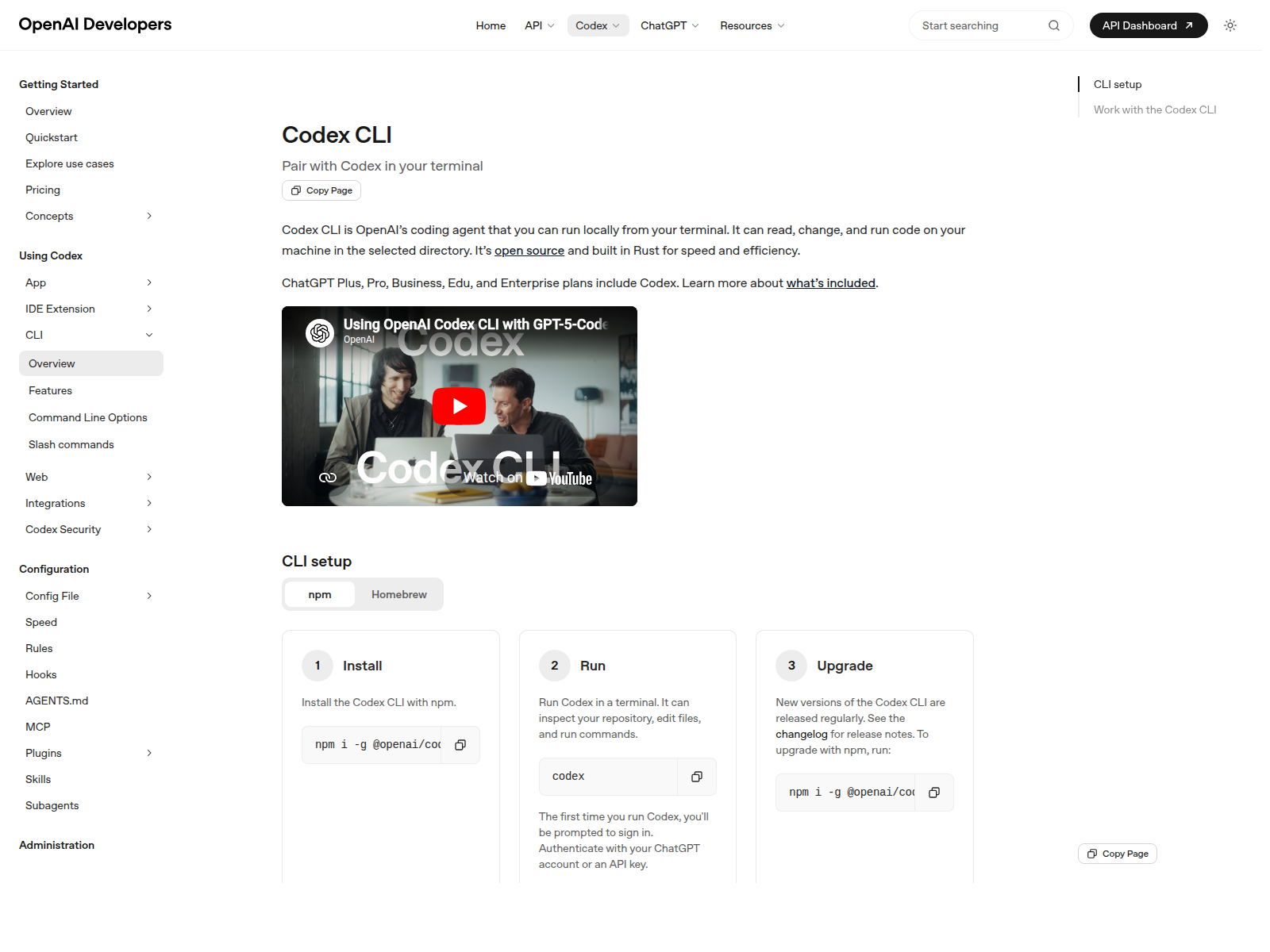

Важно не путать серый маршрут с полностью неофициальной экосистемой. OpenAI сама подтверждает, что Codex included with ChatGPT Plus, Pro, Business, and Enterprise/Edu plans. Более того, в Help Center компания отдельно объясняет, как подключить Codex к ChatGPT-аккаунту через разные клиенты: app, CLI, IDE extension и web.

То есть базовая идея «использовать Codex через ChatGPT-подписку» официальна. Неофициальность начинается там, где сообщество пытается превратить этот продуктовый доступ в замену привычному API-контру до того, как сам API был открыт публично.

Документация Codex CLI делает различие ещё нагляднее. В ней прямо сказано, что при первом запуске Codex предложит аутентифицироваться через ChatGPT account or an API key. Это не мелкая UX-деталь, а явный сигнал, что OpenAI сама поддерживает два параллельных режима доступа: подписочный вход через аккаунт и разработческий вход через ключ.

Дополнительный штрих есть и в GitHub discussion openai/codex. Там OpenAI отдельно описывает, какие модели доступны при входе через ChatGPT account, а для части устаревающих моделей советует использовать свой API key. То есть даже внутри официального Codex-контура компания уже разделяет поверхности доступа не только по интерфейсу, но и по типу авторизации.

Для редакционного угла это принципиально. История про GPT-5.5 не сводится к одному endpoint и не должна подаваться как «хитрый хак». Она показывает, что OpenAI уже строит и документирует несколько слоёв доступа к одним и тем же модельным возможностям.

Почему после 24 апреля серый маршрут быстро потерял новостную ценность

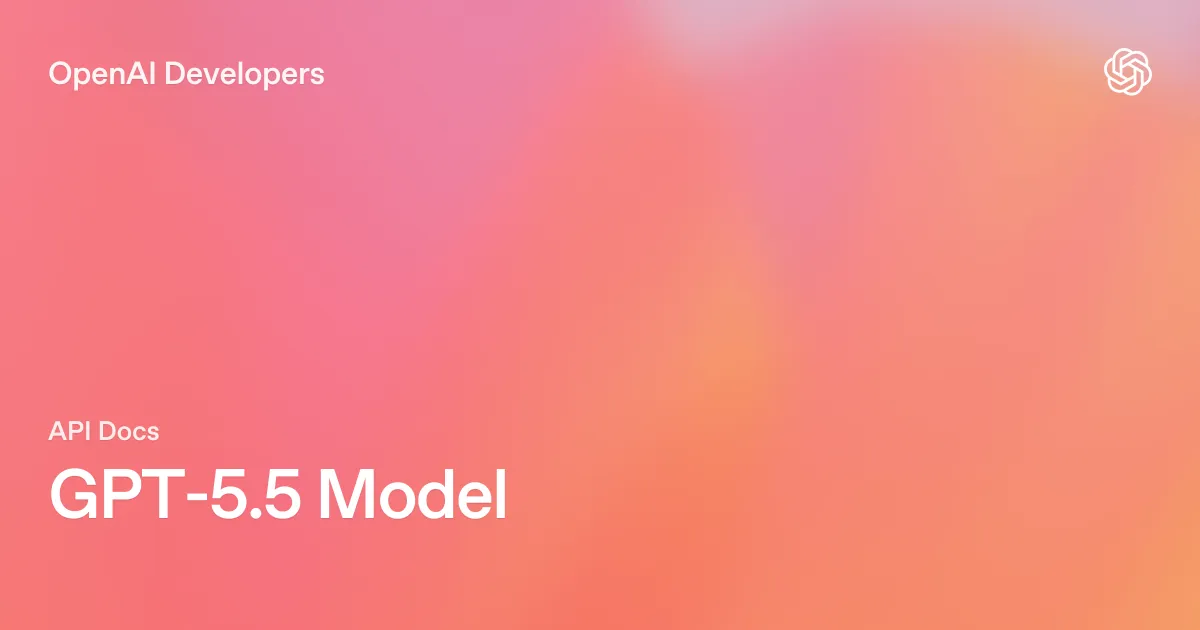

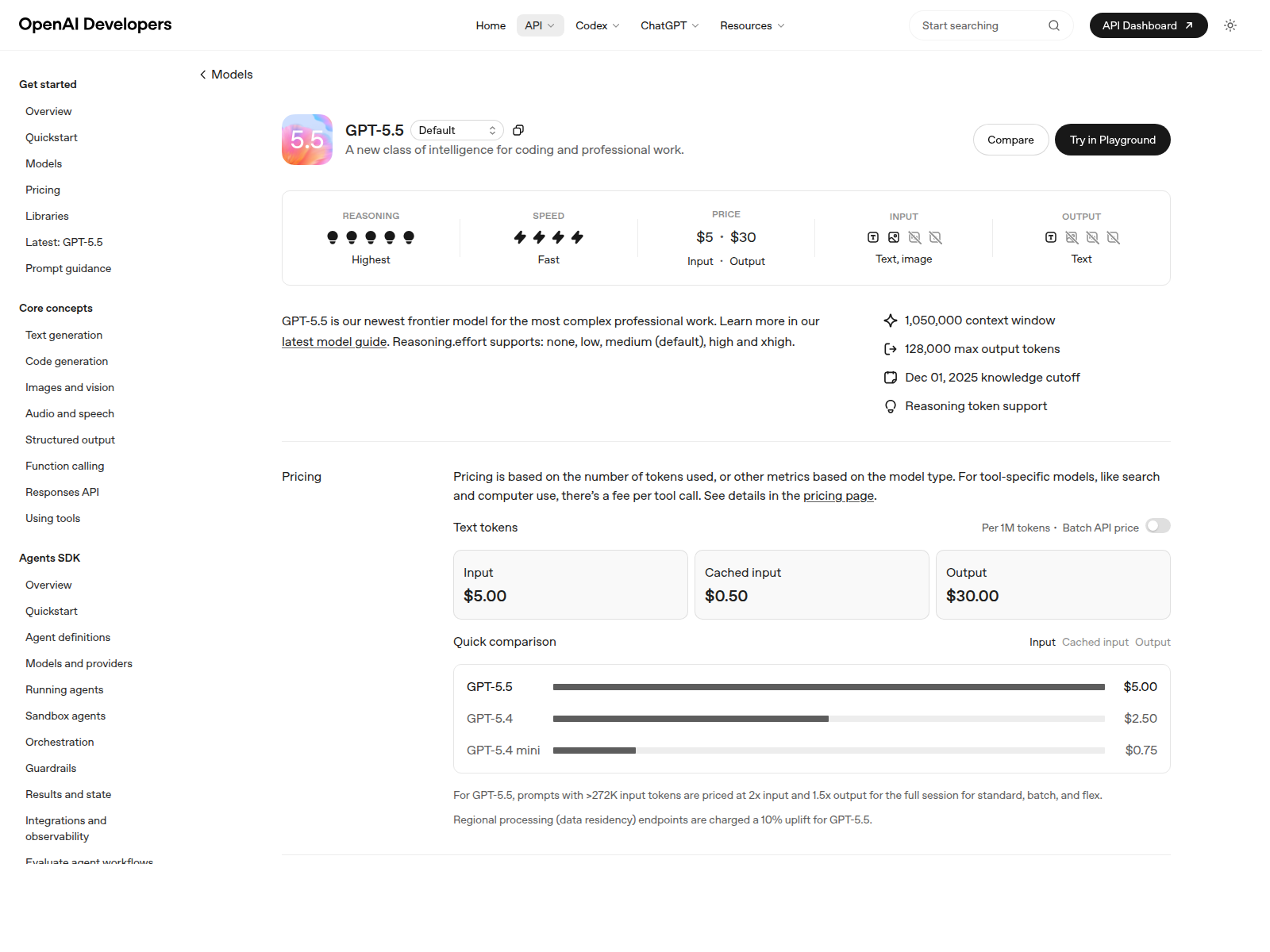

Как только OpenAI открыла GPT-5.5 и GPT-5.5 Pro в официальном API, практический смысл обходного маршрута резко сузился. На странице API Pricing компания указывает для GPT-5.5 стандартные цены $5 за 1 млн входных токенов, $0,50 за cached input и $30 за 1 млн выходных токенов. Для GPT-5.5 Pro в API действует уже другой тариф: $30 за вход и $180 за выход, без cached input discount.

То есть после 24 апреля разработчик снова получил то, что ему обычно и нужно: официальную биллинговую модель, прозрачные лимиты, формальную документацию, стандартный production-контур и возможность встроить модель в собственный стек без оглядки на продуктовые обходы. На этом фоне серый путь через Codex перестаёт быть главным сюжетом и превращается скорее в историческую сноску на один конкретный день.

Но именно этот один день и показывает, почему рынок так нервно реагирует на разрыв между продуктом и API. Для агентных сценариев разработчикам нужен не просто доступ к лучшей модели, а доступ к ней в воспроизводимом, автоматизируемом и управляемом контуре. Мы уже разбирали это в материале про OpenAI Agents SDK и production AI-агентов: сильная модель без штатной среды исполнения, инструментов и интеграций быстро упирается в потолок.

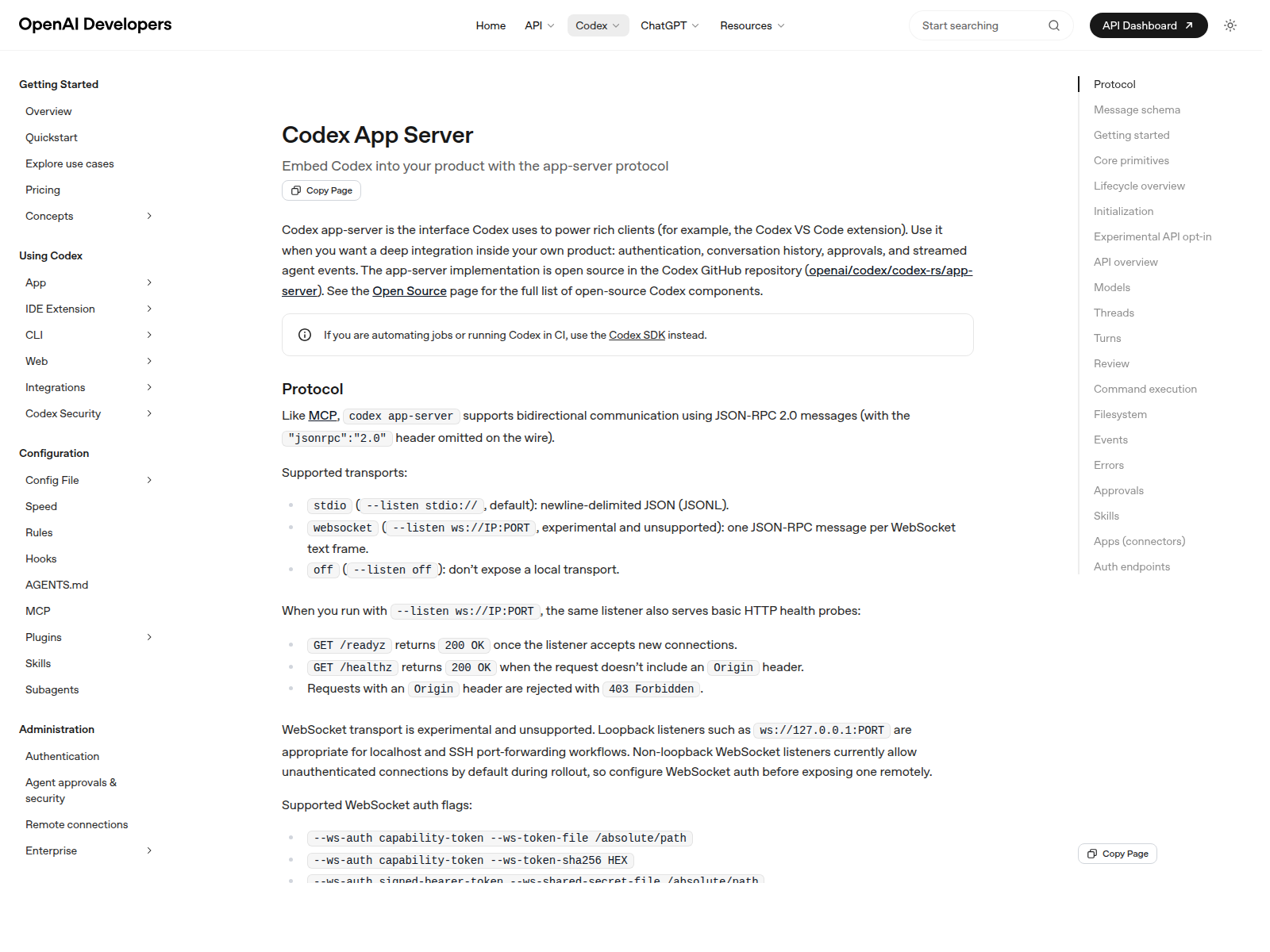

Это видно и по странице Codex App Server. OpenAI описывает app server как интерфейс, который нужен для rich clients, conversation history, approvals и streamed agent events. Иначе говоря, продуктовый слой уже сильно богаче простого текстового вызова модели. Если frontier-модель сначала появляется именно там, а потом доезжает до API, разработчики получают не просто задержку. Они получают асимметрию доступа между продуктом и платформой.

Что эта история говорит о стратегии OpenAI

Самый слабый вывод здесь звучал бы так: «люди нашли лазейку». Это правда, но она почти ничего не объясняет. Сильный вывод другой: OpenAI всё больше разводит модельный релиз на несколько этапов. Сначала модель может прийти в собственные поверхности компании, где проще контролировать сценарии использования, безопасность, rate limits и продуктовую упаковку. Потом она приходит в общий API, где её уже можно подключать к любым внешним контурам.

Для самой OpenAI это рационально. Продуктовые поверхности дают лучший контроль над запуском и снижают риск того, что новую модель сразу начнут массово использовать в непредсказуемых сценариях. Для рынка это означает другую вещь: если вы строите инструменты вокруг frontier-моделей, вам придётся всё внимательнее следить не только за модельными анонсами, но и за тем, в какой именно поверхности этот анонс уже живёт.

На этом фоне становится понятнее и интерес к Codex-подписке. Месячный продуктовый доступ, терминальный клиент, IDE-расширения и app server образуют собственную экосистему вокруг frontier-модели. Для части задач этого уже достаточно. Но как только команда хочет повторяемый benchmark, production integration или тонкий контроль над вызовами, она всё равно упрётся в официальный API. Именно поэтому рынок так остро реагирует даже на суточный лаг.

Мы уже видели похожую логику в материале о ценах и лимитах AI-агентов для программирования. На зрелом рынке важна не только «самая сильная модель», но и то, через какой канал к ней дешевле, стабильнее и удобнее добраться. GPT-5.5 просто показала это в очень концентрированном виде.

Итог

По состоянию на 26 апреля 2026 года история с GPT-5.5 больше не про то, что официальный API якобы отсутствует. Он уже открыт. История про другое: как быстро developer-сообщество реагирует на любые разрывы между продуктовым доступом и платформенным доступом к frontier-модели.

Поэтому правильный вывод здесь не «все бросились в backdoor». Правильный вывод такой: у OpenAI оформляется новая архитектура доступа к моделям, где ChatGPT и Codex могут стать первым уровнем входа, а публичный API - вторым. И если между этими уровнями даже ненадолго появляется зазор, рынок почти мгновенно заполняет его своими инструментами.

Источники и дата проверки

Факты, даты, доступность моделей и тарифы проверены 26 апреля 2026 года по официальным источникам OpenAI и по заметке Simon Willison от 23 апреля 2026 года. Для статьи использованы: анонс OpenAI GPT-5.5, OpenAI API Pricing, модельные страницы GPT-5.5 и GPT-5.5 Pro, Help Center по Codex в ChatGPT, документация Codex CLI и Codex App Server, а также GitHub discussion репозитория openai/codex.