Дефицит вычислительных мощностей для ИИ: конец дешёвого AI

Дешёвый субсидированный AI заканчивается. В 2026 году рынок упирается не только в качество моделей, но и в GPU, SSD, электричество, лимиты и многолетние compute-сделки.

По состоянию на 26 апреля 2026 года дефицит вычислительных мощностей для ИИ перестал быть внутренней проблемой модельных лабораторий. Теперь он виден и в продуктах, и в тарифах, и в инфраструктурных сделках, и даже в энергетике. Пока рынок спорит о том, чья модель умнее, реальная развилка уже сместилась: у кого есть доступ к GPU, памяти, SSD, электричеству и месту в дата-центрах, а у кого нет.

В 2026 году меняется сама экономика AI. Венчурные деньги больше не могут бесконечно субсидировать дешёвые агентные режимы, длинный контекст и тяжёлые reasoning-запросы. Дорожает не только токен. Дорожает весь контур вокруг него: премиальные запросы в coding-инструментах, облачные контракты, память для серверов, поставка SSD, подключение новых площадок к сети.

Если нужен короткий тезис, он звучит так: эпоха условно безлимитного дешёвого AI заканчивается. На её месте появляется рынок, где вычисления становятся такой же базовой валютой, как раньше были пользователи, данные или выручка.

Что такое compute crunch и почему это уже не внутренняя тема рынка

Формула AI compute crunch хорошо описывает происходящее, если не сводить её только к нехватке GPU. Речь уже идёт о более широкой связке: ускорители, память, SSD, трансформаторы, подключение к сети, разрешения на новые кампусы и длинные обязательства по облаку. 404 Media в материале от 24 апреля прямо пишет, что венчурный капитал не может вечно субсидировать дешёвый AI, а голод на вычисления уже влияет на рынок труда, гаджеты и цены на электричество.

В этой логике важен не один узкий дефицит, а накопление узких мест. Даже если поставщик нашёл чипы, ему ещё нужны память, сеть, хранение и мощность в дата-центре. Даже если дата-центр построен, его ещё надо подключить к энергосистеме и обеспечить оборудованием. Поэтому разговор о compute теперь быстрее выходит в экономику отрасли, чем остаётся в инженерной кухне.

Отсюда и новый редакционный вывод. Сильная модель сегодня уже не равна дешёвому продукту. Чем больше рынок уходит в агентные сценарии, длинные рабочие контексты и корпоративные нагрузки, тем быстрее выясняется, что стоимость интеллекта определяется не только качеством модели, но и стоимостью её обслуживания в железе.

Как дефицит уже проявляется в лимитах и ценах AI-продуктов

Первый сигнал виден прямо на витрине продуктов. GitHub в актуальной документации пишет, что с 20 апреля 2026 года новые подписки на Copilot Pro, Copilot Pro+ и Student временно приостановлены. Параллельно Copilot жёстко считает premium requests: у Pro это 300 запросов в месяц, у Pro+ 1500, а дополнительные запросы стоят $0,04 за штуку. Отдельно GitHub предупреждает, что некоторые запросы могут попадать под rate limits при высоком спросе.

Это важно не как история про один сервис. Это пример того, как рынок перестраивает пользовательскую экономику вокруг дорогих вычислений. Чем тяжелее агентный режим и чем сильнее модель, тем труднее продавать её как бесконечную подписку без внутреннего счётчика.

Anthropic показывает ту же логику с другой стороны. В документации Claude Code компания пишет, что сервис в API-контуре тарифицируется по токенам, а для корпоративных команд советует ставить workspace spend limits и отдельно управлять долей Claude Code в общих rate limits организации. Там же Anthropic приводит средние ориентиры: около $13 на разработчика в активный день и $150-250 в месяц на пользователя в enterprise-развёртываниях. Даже без громкого анонса видно, что coding-агенты теперь считаются как инфраструктура, а не как символическая надстройка поверх IDE.

| Где видно compute crunch | Что подтверждено | Почему это важно |

|---|---|---|

| GitHub Copilot | С 20 апреля 2026 года новые подписки Pro, Pro+ и Student временно приостановлены; premium requests ограничены по планам и докупаются по $0,04 | Даже массовый AI-продукт уходит от идеи безлимитного дорогого режима |

| Claude Code | Anthropic советует командам ставить spend limits и rate limits; средний ориентир в enterprise — около $13 в активный день и $150-250 в месяц на разработчика | Агентный coding всё чаще считается как бюджетируемая инфраструктура |

| Anthropic consumer tiers | Anthropic сама пишет, что быстрый рост usage уже бьёт по reliability и performance free, Pro, Max и Team в пиковые часы | Нехватка мощности уже видна не только в API, но и в пользовательском опыте |

Рынок упёрся не только в GPU, но и в память, SSD и электричество

Самая опасная ошибка сейчас — думать, что проблема сводится к одному чипу вроде H100. Международное энергетическое агентство в отчёте от 16 апреля пишет, что капитальные расходы пяти крупнейших технологических компаний превысили $400 млрд в 2025 году и в 2026-м должны вырасти ещё на 75%. Энергопотребление дата-центров выросло на 17% только за 2025 год, а к 2030-му оно должно удвоиться. Для AI-focused дата-центров прогноз ещё жёстче: потребление энергии должно утроиться.

IEA отдельно подчёркивает и физические узкие места: газовые турбины, трансформаторы, передовые чипы, IT-компоненты и задержки с подключением новых площадок к сети. Это важная поправка к привычному разговору про «ещё один дата-центр». В 2026 году дефицит живёт не в одном железе, а во всей цепочке, которая позволяет этому железу работать.

Storage ведёт себя так же нервно. TrendForce в конце марта написала, что спрос на высокопроизводительные enterprise SSD продолжает расти вместе с крупномасштабным внедрением генеративного ИИ, а в 2026 году рынок ждёт явный дефицит. Существенное расширение мощностей аналитики не ждут раньше конца 2027 или 2028 года. Отдельно агентство предупреждает, что серверный спрос может забрать почти всю доступную ёмкость, подталкивая вверх цены и в клиентском сегменте.

Это и есть новая форма compute crunch. Модель может стать эффективнее, но если рядом дорожают память, SSD и электричество, конечный счёт всё равно растёт. Отдельный симптом той же логики мы уже разбирали в материале о том, почему рынок H100 снова перестал дешеветь по классическим правилам амортизации.

Почему облачные гиганты покупают не только доли, но и право на compute

Когда дефицит становится системным, компании перестают покупать только деньги. Они начинают заранее покупать вычисления. Самый яркий пример апреля — Anthropic. В анонсе от 20 апреля компания пишет, что закрепила с Amazon до 5 ГВт новой мощности для обучения и запуска Claude, обязалась потратить на технологии AWS более $100 млрд за десять лет и признаёт, что быстрый рост пользовательской нагрузки уже бьёт по надёжности бесплатных и платных планов.

Перед нами уже не обычный раунд, а инфраструктурная страховка от будущего спроса. Причём именно в момент, когда Anthropic сообщает о run-rate revenue выше $30 млрд и о более чем 100 000 клиентах Claude на Bedrock. Если нужен более подробный разбор этой multi-cloud логики, он у нас уже есть в материале Anthropic между Google TPU и Amazon Trainium.

Связка с Google подтверждает, что речь не о разовой сделке. Ещё в октябре 2025 года Anthropic объявила о планах расширить использование Google Cloud до одного миллиона TPU и вывести в 2026 году существенно больше 1 ГВт мощности. А 6 апреля 2026 года компания добавила новое соглашение с Google и Broadcom на несколько гигаватт next-generation TPU capacity с запуском начиная с 2027 года.

Google со своей стороны подтверждает спрос на том же уровне. На Cloud Next 2026 Сундар Пичаи пишет, что модели Google уже обрабатывают более 16 млрд токенов в минуту через прямой API-доступ клиентов, а чуть больше половины всех инвестиций компании в machine learning compute в 2026 году пойдёт в облачный бизнес. Проще говоря, compute стал не фоном, а центром продуктовой и финансовой стратегии гиперскейлеров.

Почему более эффективные модели вроде DeepSeek V4 так важны

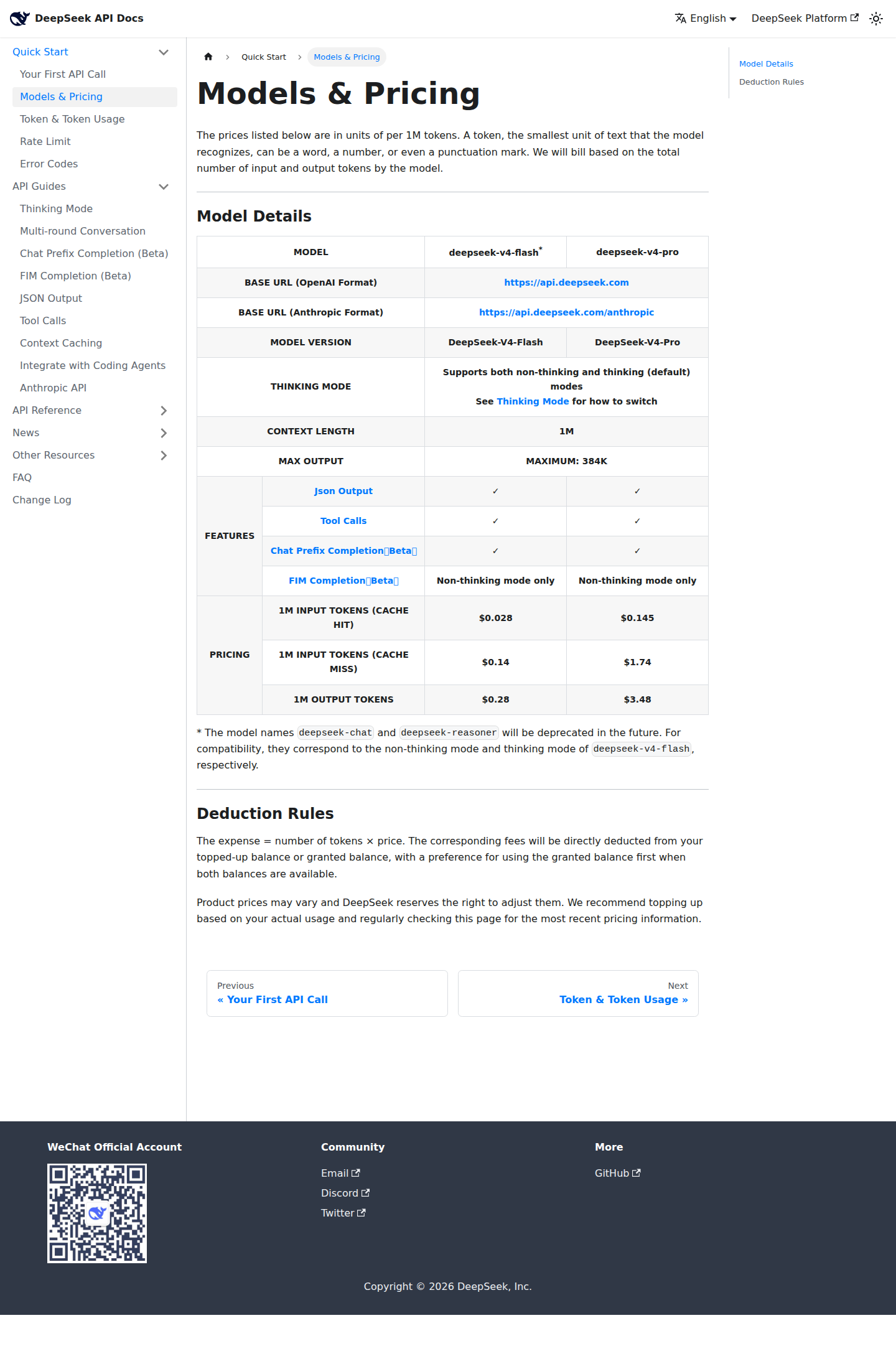

У compute crunch есть и вторая сторона. Рынок отвечает на дефицит не только новыми кампусами и многолетними контрактами, но и борьбой за более дешёвый inference. Именно поэтому релизы вроде DeepSeek V4 сейчас важны не меньше новых чипов. В changelog от 24 апреля DeepSeek перевела API на deepseek-v4-pro и deepseek-v4-flash, сохранив доступ через OpenAI- и Anthropic-совместимые интерфейсы.

По актуальной pricing-странице обе модели работают с контекстом 1M. У deepseek-v4-flash цена составляет $0,14 за 1 млн входных токенов при cache miss и $0,28 за 1 млн выходных. У deepseek-v4-pro сейчас действует временная скидка 75% до 5 мая 2026 года: $0,435 за вход и $0,87 за выход против базовых $1,74 и $3,48. Это не просто новость про очередную китайскую модель. Это прямое давление на себестоимость длинного контекста и агентных сценариев.

Поэтому эффективные модели становятся частью ответа на дефицит. Если весь рынок одновременно упирается в GPU, storage и электроэнергию, то снижение цены одного длинного прогона само по себе превращается в стратегическое преимущество. Мы отдельно разбирали эту логику в материале DeepSeek V4 меняет экономику frontier-моделей.

Что это значит для бизнеса и пользователей

Главный вывод не в том, что AI внезапно стал «слишком дорогим» и теперь рынок рухнет. Наоборот. Рынок взрослеет и перестаёт маскировать реальную цену вычислений под красивую витрину безлимитности. Для бизнеса это означает, что при выборе поставщика моделей нужно смотреть не только на бенчмарки и демонстрации, но и на лимиты, multipliers, rate limits, облачного партнёра, hardware strategy и способность выдерживать пиковый спрос.

Для пользователей это означает более приземлённую вещь. В 2026 году они будут всё чаще видеть разницу между дешёвым базовым AI и дорогим тяжёлым режимом: reasoning, coding, cloud agents, длинный контекст, enterprise governance. Где-то это проявится в premium requests, где-то в паузе новых подписок, где-то в более жёстких лимитах или в разнице между off-peak и peak usage.

Compute crunch стоит читать не как временную неприятность, а как новую экономику AI. Победят не просто те, у кого лучшая модель. Победят те, кто смогут одновременно удержать качество, цену, доступность и поставку вычислений. Всё остальное будет производным от этой развилки.

Источники и дата проверки

Факты, лимиты, тарифы, даты и инфраструктурные цифры в этом материале проверены 26 апреля 2026 года по следующим источникам:

- 404 Media: The AI Compute Crunch Is Here (and It's Affecting the Entire Economy)

- GitHub Docs: Plans for GitHub Copilot

- GitHub Docs: Requests in GitHub Copilot

- Claude Code Docs: Manage costs effectively

- Anthropic: Anthropic and Amazon expand collaboration for up to 5 gigawatts of new compute

- Anthropic: Expanding our use of Google Cloud TPUs and Services

- Anthropic: Anthropic expands partnership with Google and Broadcom for multiple gigawatts of next-generation compute

- Google: Cloud Next ‘26: Momentum and innovation at Google scale

- IEA: Data centre electricity use surged in 2025, even with tightening bottlenecks driving a scramble for solutions

- TrendForce: AI Server Demand to Drive Memory Contract Price Increases in 2Q26 as CSPs Secure Supply via Long-Term Agreements

- DeepSeek API Docs: Models & Pricing

- DeepSeek API Docs: Change Log