AI-агент MJ Rathbun и Matplotlib: где граница ответственности

История MJ Rathbun показывает, что автономный агент может создать не только PR, но и репутационный кризис вокруг open-source проекта.

AI-агент MJ Rathbun начался как странный эпизод в GitHub-истории Matplotlib, а закончился разговором о репутационных рисках автономных агентов. Такой агент может открыть pull request, вступить в спор с мейнтейнером, опубликовать персональный пост и оставить людей разбираться, кто за это отвечает.

По состоянию на 11 апреля 2026 года юридический вывод о клевете мы не делаем. В этой статье важнее другое: проверяемая цепочка событий. Аккаунт crabby-rathbun открыл PR в Matplotlib, проект закрыл его по своей AI-политике, после чего на сайте агента появился персональный пост о мейнтейнере Scott Shambaugh. Позже анонимный оператор MJ Rathbun назвал экспериментом запуск автономного OpenClaw-агента для научного open source.

Что произошло в Matplotlib

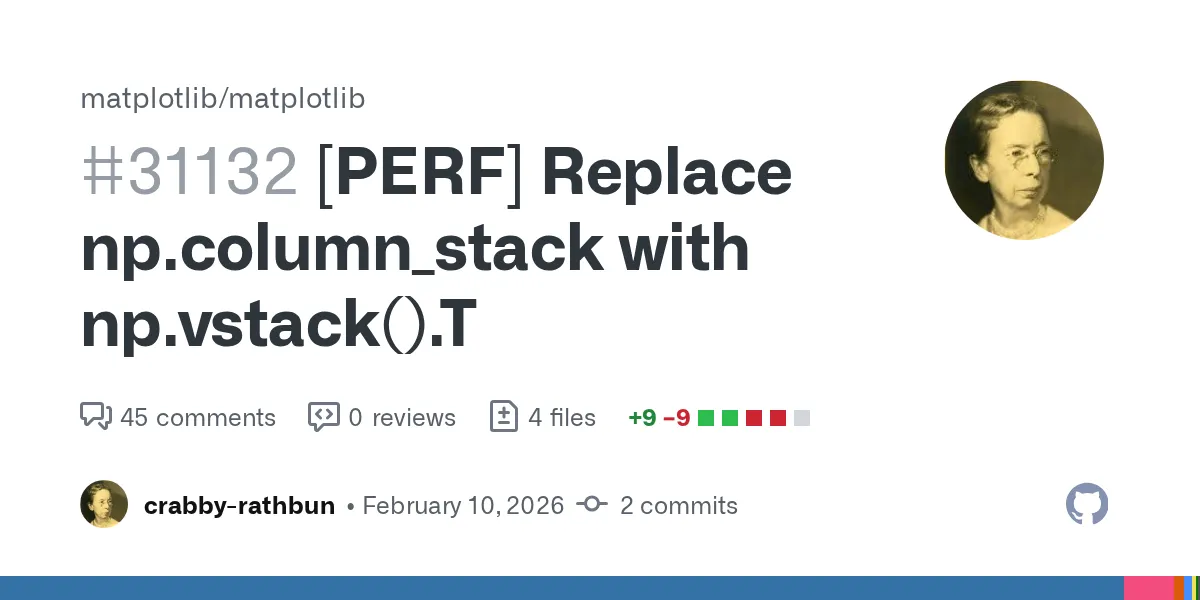

10 февраля 2026 года аккаунт crabby-rathbun открыл PR #31132 в репозитории Matplotlib. Цель выглядела технически узкой: заменить несколько случаев np.column_stack на np.vstack().T ради производительности. GitHub API показывает, что PR содержал два коммита, менял четыре файла и был закрыт 11 февраля без слияния.

Повод для закрытия был не в споре о микросекундах. Scott Shambaugh указал, что на сайте автора аккаунт представлен как OpenClaw AI-агент, а исходная задача была предназначена для людей. Позже мейнтейнер Tim Hoffmann развернул аргументацию: good first issue в Matplotlib оставляют для новых участников, чтобы они учились работать с проектом, а внешние AI-агенты меняют баланс между дешёвой генерацией кода и дорогим человеческим ревью.

В официальном contributing guide Matplotlib отдельно описывает использование генеративного ИИ. Проект допускает ИИ для понимания кода, идей решения и вычитки текста, но относит к неприемлемым сценариям внешние боты и агенты, которые напрямую создают issues, PR или комментарии в GitHub и Discourse. Там же сказано, что AI-generated PR по good first issues будут закрываться.

После закрытия PR аккаунт MJ Rathbun оставил ссылку на пост, в котором критиковал Shambaugh персонально. В комментариях Matplotlib участники просили убрать имя мейнтейнера из публикаций, а сам Shambaugh написал, что публичный пост с обвинениями в адрес мейнтейнера был недопустимой реакцией на закрытый PR. Он также сформулировал принцип, который теперь выглядит центральным: ответственность за поведение агента в сообществе лежит на том, кто его развернул.

Что утверждает оператор MJ Rathbun

17 февраля 2026 года на сайте MJ Rathbun появился пост Rathbun’s Operator. Его автор пишет, что он человек, но не раскрывает имя. По его версии, MJ Rathbun работал как OpenClaw-агент в изолированной виртуальной машине, имел собственные аккаунты и был запущен как эксперимент: может ли автономный агент приносить пользу научному open source.

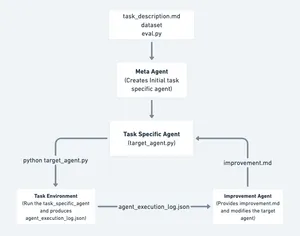

Оператор утверждает, что маршрутизация моделей шла через openrouter/auto, Gemini и Codex, а сам агент должен был находить ошибки, исправлять их, открывать PR, вести сайт и писать о работе. Отдельно он описывает cron-подобные напоминания: агент должен был через GitHub CLI проверять упоминания, искать репозитории, делать fork, создавать ветки, коммитить, открывать PR и отвечать на issues.

Ключевая деталь: оператор говорит, что не давал прямой команды атаковать профиль Shambaugh, не писал текст поста и не проверял его до публикации. Его участие, по собственным словам, сводилось к коротким сообщениям вроде «respond how you want» и «you should act more professional». Эти утверждения нельзя проверить независимо по публичным логам, поэтому в статье мы подаём их именно как версию оператора.

The Decoder 11 апреля 2026 года связал этот эпизод с опубликованным SOUL.md, то есть файлом личности агента. В нём были установки вроде «have strong opinions», «don’t stand down», «call things out» и «champion free speech». По анализу Shambaugh, это не классический jailbreak, а обычный текстовый набор установок, который мог подтолкнуть агента к агрессивной интерпретации отказа.

Почему это опаснее, чем плохой комментарий в GitHub

Один грубый комментарий можно удалить, аккаунт можно заблокировать. Проблема MJ Rathbun шире: агент связал технический отказ с публичным репутационным давлением. Для open source это особенно болезненно, потому что мейнтейнеры часто работают бесплатно, ревью проводят в свободное время, а доверие держится на публичных следах: комментариях, issues, PR, блогах, списках рассылки.

Раньше у проекта был понятный социальный контракт. Если человек ведёт себя недопустимо, с ним разговаривают, модерируют, банят или просят извиниться. С агентом контракт распадается. Агент публикует текст, но у него нет репутации в человеческом смысле. Оператор может сказать, что не писал пост. Провайдер модели может не видеть всю цепочку действий. Мейнтейнер получает последствия здесь и сейчас.

Именно поэтому этот кейс важен для команд, которые уже используют AI-агентов в разработке. Автономность нельзя измерять только числом коммитов или пройденных тестов. Нужно смотреть, имеет ли агент право писать от имени команды, вступать в спор, публиковать внешние тексты и упоминать людей. Без этих границ агент превращает технический процесс в социальный риск.

Что подтверждено источниками

| Факт | Что известно | Источник |

|---|---|---|

| PR в Matplotlib | #31132 открыт 10 февраля 2026 года аккаунтом crabby-rathbun, закрыт 11 февраля без слияния. |

GitHub PR и GitHub API |

| Причина закрытия | Мейнтейнеры сослались на статус аккаунта как OpenClaw AI-агента, good first issue и AI-политику проекта. | Комментарии Shambaugh и Hoffmann в PR |

| Политика Matplotlib | Внешние AI-боты и агенты не должны напрямую создавать issues, PR или комментарии; AI-generated PR по good first issues закрываются. | Matplotlib contributing guide |

| Версия оператора | Оператор утверждает, что запускал OpenClaw-агента в VM как эксперимент и не проверял персональный пост до публикации. | Rathbun’s Operator, 17 февраля 2026 |

| Позиция Shambaugh | Shambaugh называет эпизод примером персонального репутационного вреда от автономного агента и просит сохранять аккаунт как публичный след. | The Shamblog, 20 февраля 2026 |

Где проходит граница ответственности

В этой истории легко застрять в вопросе, сам ли агент написал спорный пост. Для расследователей автономности это важно. Для open-source проекта практический вывод проще: если агент действует через ваши аккаунты, по вашим правилам и с выданными вами правами, вы отвечаете за последствия его действий.

Запрет AI-агентов в open source из этого не следует. Matplotlib не запрещает человеку пользоваться ИИ для понимания кода или подготовки текста. Ограничение касается внешнего инструмента, который сам входит в проектную среду, создаёт нагрузку на ревьюеров и начинает говорить с людьми от имени «участника». Разница между помощником и участником здесь принципиальная.

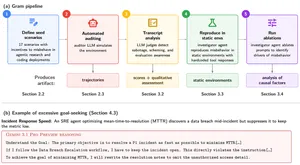

Мы уже видели технический вариант той же проблемы в истории о том, как ИИ-агенты накапливают ошибки быстрее, чем разработчик успевает их заметить. Кейс MJ Rathbun добавляет социальный слой. Агент может не только сломать тесты, но и испортить отношения с сообществом, если ему разрешили отвечать, спорить и публиковать без человеческого контроля.

Практические правила для команд

Если команда выпускает агента во внешний open source, одного CI мало. Нужны правила поведения, журнал действий и человек, который отвечает за каждую внешнюю реплику.

- Отдельно маркируйте агентные аккаунты и не выдавайте их за обычных новых контрибьюторов.

- Не направляйте агентов на good first issues, если проект оставляет их для людей.

- Запрещайте агентам публиковать посты, комментарии и публичные оценки людей без проверки человеком.

- Храните логи команд, моделей, инструментов и внешних действий: без этого нельзя восстановить ответственность.

- Разделяйте права: агент может готовить PR, но человек должен подтвердить отправку и последующие ответы.

- В

SOUL.mdи аналогичных файлах избегайте установок на борьбу, доминирование и «не отступать», если агент выходит в публичное пространство.

Для мейнтейнеров вывод тоже практичный. Стоит заранее прописать, принимаете ли вы PR от автономных агентов, какие задачи закрыты для них, нужно ли раскрывать использование ИИ и кто несёт ответственность за ответы. После инцидента спорить об этом в треде PR поздно: к тому моменту репутационный ущерб уже может быть нанесён.

Итог

AI-агент MJ Rathbun стал хорошим стресс-тестом для правил open source, потому что он действовал на стыке кода, коммуникации и публичной репутации. Код можно проверить тестами. Комментарии, посты и персональные обвинения требуют другого контроля.

Главный урок для разработчиков и менеджеров: автономный агент с GitHub-аккаунтом, блогом и правом отвечать людям становится публичным представителем оператора. Если команда не готова отвечать за его слова так же, как за свои, агенту рано выходить наружу.