Anthropic и OpenClaw: что значит блокировка создателя для AI-агентов

Anthropic сначала ограничила создателя OpenClaw, затем восстановила доступ. Новость показывает, как модельные провайдеры начинают контролировать сторонние агентные клиенты.

Anthropic OpenClaw за неделю вышел за рамки спора о подписках Claude. 10 апреля 2026 года TechCrunch сообщил, что создатель OpenClaw Питер Штайнбергер получил блокировку аккаунта Claude из-за «подозрительной активности». Через несколько часов доступ восстановили, но новость легла на уже горячую тему: Anthropic только что изменила правила оплаты для OpenClaw и других сторонних агентных клиентов.

Эта история показывает новую границу контроля. Модельные провайдеры начинают жёстче отделять свои продукты от сторонних оболочек, которые крутят длинные циклы задач, используют подписки как дешёвый вычислительный слой и создают нагрузку, которую сложно прогнозировать.

По состоянию на 11 апреля 2026 года доступ Штайнбергера к Claude был восстановлен. В статье ниже речь не о «вечном бане OpenClaw», а о конфликте вокруг правил доступа, оплаты и зависимости open-source агентных клиентов от владельцев моделей.

События 10 апреля

По данным TechCrunch, утром 10 апреля Питер Штайнбергер написал в X, что ему будет сложнее поддерживать работу OpenClaw с моделями Anthropic: аккаунт Claude был приостановлен после сообщения о подозрительной активности. Через несколько часов он сообщил, что доступ восстановили. В той же ветке один из инженеров Anthropic написал, что компания не банит людей за использование OpenClaw, но точная причина восстановления аккаунта публично не подтверждена.

Ситуация стала заметной ещё и потому, что Штайнбергер теперь работает в OpenAI, а OpenClaw продолжает развиваться как open-source проект через отдельную foundation-структуру. В комментарии, который приводит TechCrunch, он разделил эти роли: работа над OpenClaw должна обеспечивать поддержку разных модельных провайдеров, а его позиция в OpenAI связана с будущей продуктовой стратегией.

Блокировка совпала с изменением оплаты

За шесть дней до этого, 4 апреля 2026 года, TechCrunch писал о письме клиентам Anthropic: лимиты подписки Claude больше не покрывают использование «third-party harnesses», включая OpenClaw. Вместо этого пользователям нужно платить за extra usage отдельно или подключать Claude через API. The Register 6 апреля уточнил позицию Anthropic: подписки продолжают работать для Claude.ai, Claude Code и Cowork, а сторонние инструменты должны идти через отдельную оплату или API-ключ.

Это меняет экономику таких клиентов. Раньше часть пользователей могла запускать OpenClaw поверх подписки Claude Pro или Max и получать много вычислений за фиксированную цену. Теперь долгие автономные циклы, повторы, ретраи и интеграции с внешними сервисами становятся видимым расходом. Для Anthropic это вопрос нагрузки и маржи. Для open-source сообщества — вопрос доверия к платформе, которая одновременно продаёт модели, собственные агентные продукты и правила доступа к ним.

По состоянию на 11 апреля 2026 года публичная страница Claude pricing показывает Pro за $17 в месяц при годовой оплате или $20 при помесячной, а Max — от $100 в месяц. На той же странице Pro включает Claude Code и Claude Cowork, а Max даёт 5x или 20x больше использования, чем Pro. В API Anthropic отдельно показывает цены для Opus 4.6, Sonnet 4.6 и Haiku 4.5 за миллион токенов. Поэтому спор не сводится к «дорого или дёшево»: компания фактически разводит два режима работы — подписку для своих продуктов и потребление по счётчику для внешних агентных оболочек.

| Сценарий | Что изменилось | Проверенный источник |

|---|---|---|

| Claude.ai, Claude Code, Cowork | Остаются внутри подписочных планов Claude Pro/Max; Pro включает Claude Code и Cowork. | Claude pricing, 11 апреля 2026 |

| OpenClaw и другие сторонние harness-клиенты | Лимиты подписки больше не покрывают их использование; нужен extra usage или API. | TechCrunch, The Register |

| API Anthropic | Оплата идёт по токенам: например, Sonnet 4.6 указан как $3 за ввод и $15 за вывод за 1 млн токенов. | Claude pricing, 11 апреля 2026 |

OpenClaw как чувствительный кейс для Anthropic

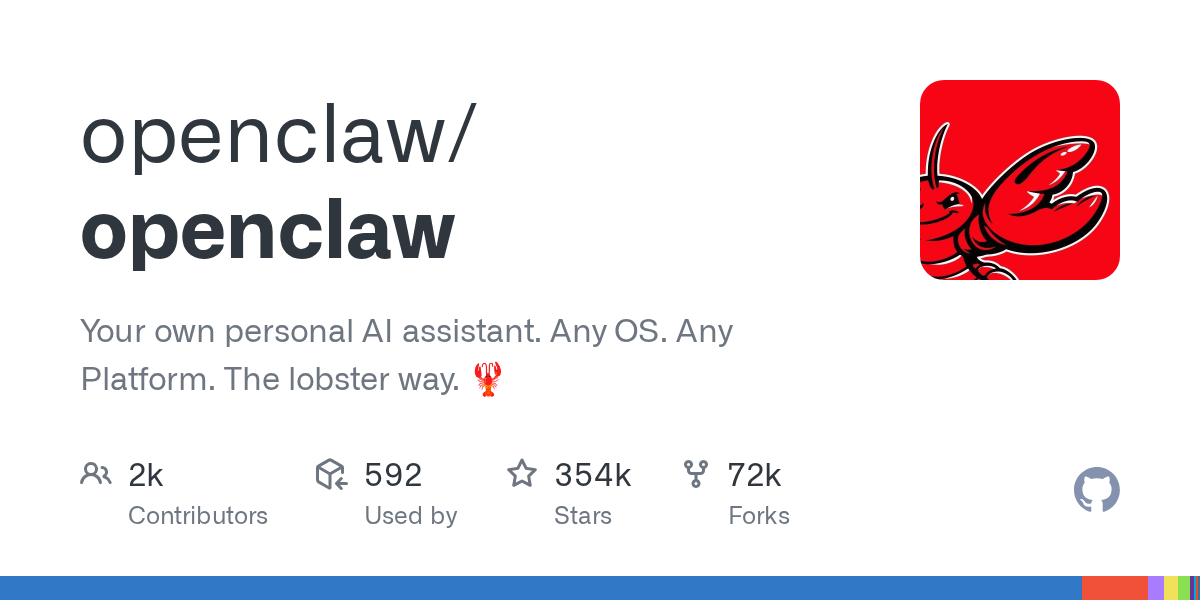

OpenClaw не похож на обычный чат-клиент. На официальной странице проект описывает себя как ИИ, который «действительно делает вещи»: разбирает почту, отправляет письма, управляет календарём и может работать через WhatsApp, Telegram и другие привычные каналы. В README на GitHub OpenClaw называется персональным ИИ-ассистентом, который запускается на устройствах пользователя, отвечает в разных мессенджерах, подключает каналы, инструменты и события через локальный Gateway.

По состоянию на 11 апреля 2026 года репозиторий openclaw/openclaw на GitHub показывает 354 тыс. звёзд, 71,6 тыс. форков и MIT-лицензию. Это уже не эксперимент на пару сотен пользователей. Даже если часть метрик GitHub стоит воспринимать как динамические, масштаб интереса объясняет нервную реакцию платформ: open-source клиент с сотнями тысяч звёзд быстро превращается в альтернативный интерфейс к моделям.

Именно здесь возникает конфликт. Для пользователя OpenClaw — способ вынести агента в свой контур: на свои устройства, свои мессенджеры, свои навыки и плагины. Для модельного провайдера это внешний слой, который может генерировать длинные задачи, чаще дёргать модель, хуже использовать механизмы экономии вычислений и при этом оставлять провайдеру меньше контроля над интерфейсом, телеметрией и лимитами.

Сигнал для рынка ИИ-агентов

В 2024-2025 годах главный вопрос звучал проще: какая модель лучше отвечает. В 2026 году для ИИ-агентов всё чаще важнее другой вопрос: кто управляет оболочкой, где живут память, права доступа, оплата и контроль ошибок. OpenClaw показывает, почему это больная точка. Агент может быть open-source, но если он опирается на закрытую модель и потребительскую подписку, его устойчивость зависит от правил провайдера.

Anthropic можно понять: непрерывные агентные циклы действительно не похожи на обычные диалоги в чате. Такой клиент может запускать цепочки задач, повторять попытки, писать код, проверять результаты, работать через несколько каналов и быстро расходовать токены. The Register отдельно связывал этот спор с проблемой спроса на Claude и упоминал инцидент 6 апреля, когда у Claude.ai и Claude Code были повышенные ошибки входа с 15:00 до 16:30 UTC.

Но у open-source сообщества есть встречный аргумент. Если провайдер одновременно строит собственный агентный продукт и ограничивает сторонние оболочки, это выглядит как борьба не только за мощность, но и за интерфейс. Пользователь получает модель, но не обязательно получает свободу подключать её к любому клиенту на прежних условиях.

Практические выводы для разработчиков и менеджеров

Практический вывод для команд простой: не проектируйте рабочие ИИ-агенты так, будто потребительская подписка — это стабильный вычислительный контракт. Для прототипа это может быть удобно. Для продакшена нужны API-ключи, лимиты расходов, журналирование, резервные провайдеры и понятная модель отказа.

Если OpenClaw или похожий агент работает с почтой, календарём, репозиториями и внутренними файлами, важно заранее ответить на четыре вопроса. Что случится, если провайдер модели поменяет тариф за сутки? Как агент поведёт себя при лимитах и частичных сбоях? Кто видит бюджет и может остановить runaway-задачу? Можно ли быстро переключить модель без переписывания всего контура?

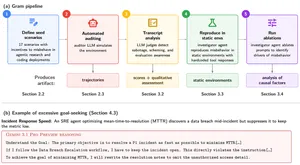

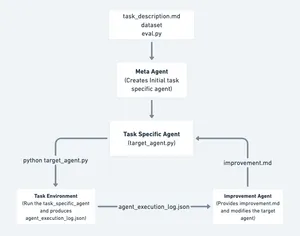

Для технических команд это ещё один аргумент в пользу разделения слоёв. Агентная оболочка, модель, память, права доступа и биллинг не должны быть одной неразделимой коробкой. Мы уже разбирали похожий риск в материале про то, почему автономные ИИ-агенты быстро накапливают ошибки: чем дольше агент действует сам, тем важнее наблюдаемость, ограничения и возможность откатить действие.

Экономика доступа важнее личного конфликта

Самый слабый способ читать эту новость — свести её к личному конфликту Anthropic, OpenAI и Штайнбергера. Да, этот слой есть: создатель OpenClaw работает у конкурента Anthropic, а сам OpenClaw остаётся важным тестовым клиентом для Claude. Но для рынка интереснее не персоналии, а новая граница контроля.

Модельные компании будут всё активнее защищать подписки от сценариев, которые похожи на дешёвый безлимитный API. Open-source клиенты будут всё активнее искать способы работать с несколькими провайдерами и не зависеть от одного закрытого продукта. Пользователи окажутся между этими логиками: им нужна свобода агента, но ещё нужна предсказуемая стоимость и стабильность доступа.

Поэтому материал про переход с OpenClaw на открытые модели через Hugging Face становится не запасным планом «для энтузиастов», а частью нормальной архитектурной дискуссии. А общий контекст Claude и Anthropic лучше держать рядом с нашим обзором линейки Claude для русскоязычных пользователей: чем шире продуктовая линейка, тем больше значение имеют правила доступа.

Итог

Временная блокировка создателя OpenClaw быстро снята, но сама история останется полезным маркером. Рынок ИИ-агентов упирается не только в качество моделей, но и в то, кто контролирует клиент, лимиты, оплату и право запускать длинные автономные задачи.

Anthropic показывает логику провайдера: подписки должны обслуживать поддерживаемые продукты, а тяжёлые внешние клиенты должны платить по отдельному счётчику. OpenClaw показывает обратную логику: пользователи хотят open-source оболочку, которая работает с любыми моделями и живёт в их собственном контуре. В 2026 году именно на этой границе будет решаться, насколько свободными окажутся ИИ-агенты за пределами закрытых платформ.