Как переносить старые промпты на GPT-5.5 без регрессий

Свежие рекомендации OpenAI по GPT-5.5 подталкивают команды не переносить старый набор промптов механически. Разбираем, что именно менять.

Проверено 26 апреля 2026 года. Если у команды уже есть большая библиотека промптов, самый опасный рефлекс после выхода GPT-5.5 звучит так: просто переключим модель и посмотрим, что получится. Свежие рекомендации OpenAI подсказывают другой маршрут. Как переносить промпты на GPT-5.5 лучше рассматривать как миграцию старого набора промптов на более чувствительную модель, которая лучше слушается, быстрее спотыкается о противоречия и не любит шум ради шума.

На этом фоне полезно помнить, что сам релиз GPT-5.5 мы уже разбирали отдельно в материале про запуск GPT-5.5 в ChatGPT и Codex. Здесь задача уже практическая: что делать со старыми шаблонами, длинными инструкциями, жёсткими «будь максимально тщательным» установками и накопленным слоем prompt-инфраструктуры, если новая модель начинает отвечать хуже, дольше или заметно менее предсказуемо.

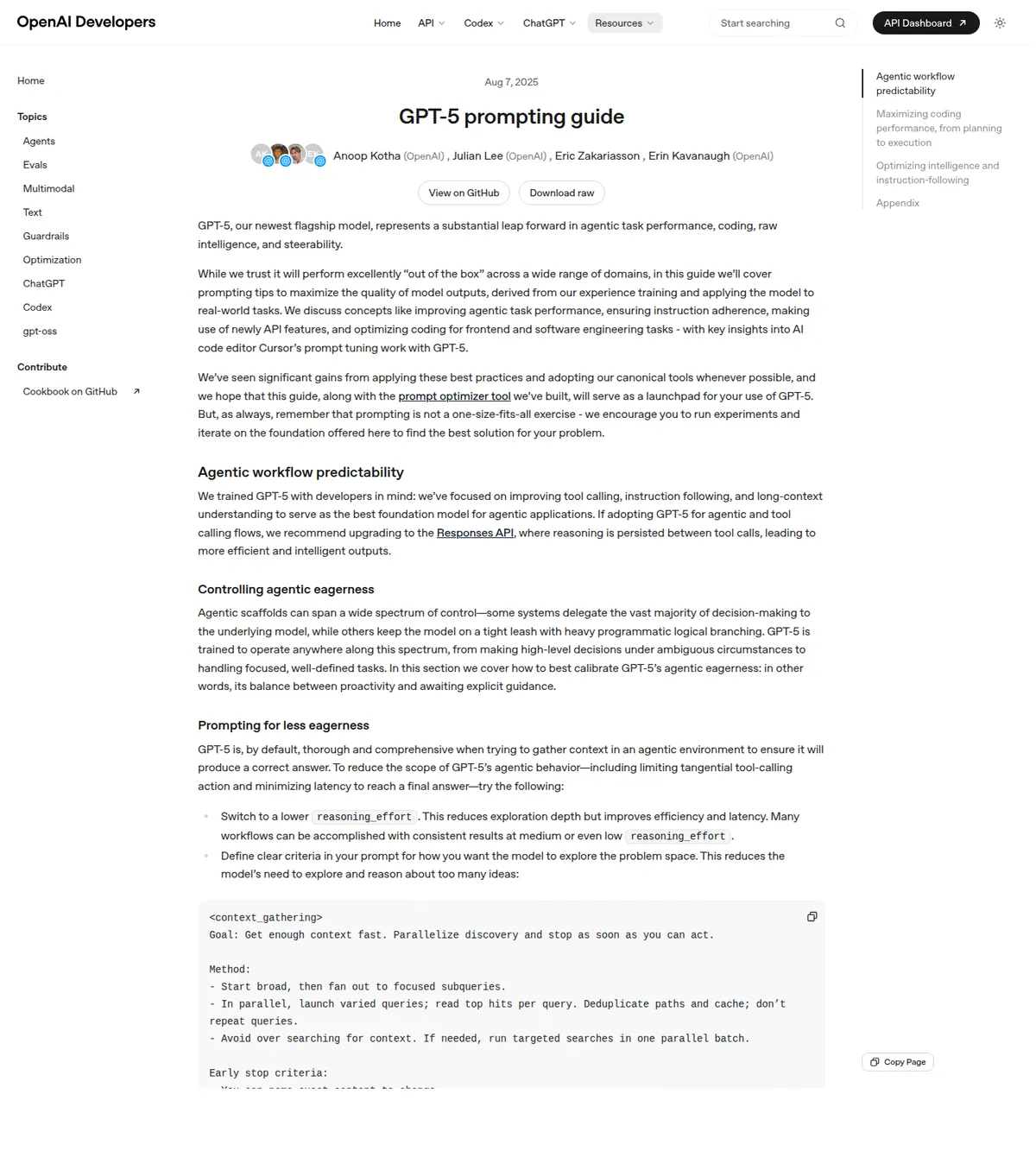

По состоянию на 26 апреля 2026 года официальные материалы OpenAI по GPT-5 и моделям семейства GPT-5 повторяют один и тот же мотив. Промпты должны быть короче, яснее и меньше спорить сами с собой. Перенос старых инструкций стоит начинать с базового прогона на evals, а не с переписывания на глаз.

Почему GPT-5.5 хуже переносит старый набор промптов

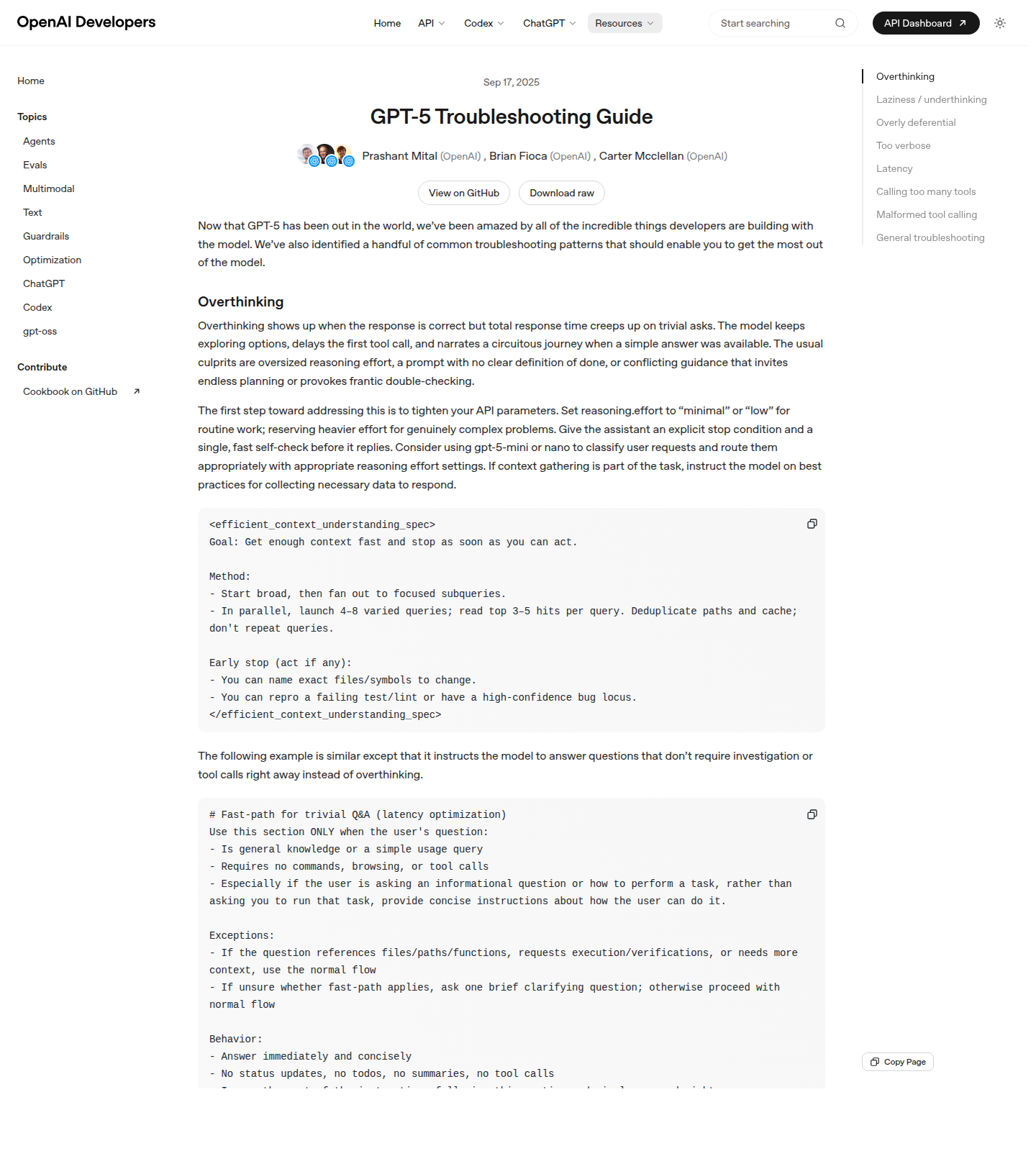

Парадокс в том, что более сильная модель часто выглядит менее терпимой к плохой prompt-гигиене. В GPT-5 Prompting Guide OpenAI подчёркивает высокую steerability новых моделей. На практике это значит не только «модель лучше следует указаниям», но и «модель сильнее чувствует конфликт между указаниями». Если старый prompt одновременно просит быть кратким и исчерпывающим, не пользоваться инструментами и при этом собрать максимум контекста, отвечать быстро и ещё обязательно проговорить всю цепочку рассуждений, новая модель будет тратить больше ресурсов на примирение этой путаницы.

В старых библиотеках промптов такие конфликты часто прятались слоями. Сначала шёл legacy system prompt двухлетней давности. Потом поверх него накладывали длинные правила безопасного поведения, затем копировали несколько few-shot примеров, а затем добавляли ещё один слой через настройки продукта или промежуточный слой. Пока модель была менее управляемой, часть этого шума просто терялась. GPT-5.5 и соседние модели семейства GPT-5 слушаются лучше. Поэтому начинают честнее исполнять даже те требования, которые в сумме мешают друг другу.

Есть и вторая проблема. В практическом руководстве по GPT-5 OpenAI отдельно пишет, что более короткие и ясные инструкции нередко работают лучше. Для команд это неприятный, но полезный вывод: старая длина промпта сама по себе уже не выглядит признаком зрелости. Много текста не значит много контроля. Иногда это просто накопленный мусор, который увеличивает задержку, стоимость и вероятность регрессии.

| Старый паттерн | Что ломается на GPT-5.5 | Что делать вместо этого |

|---|---|---|

| Длинный system prompt «на все случаи» | Модель тратит внимание на второстепенные правила | Оставить только задачу, границы и формат результата |

| Противоречивые требования: кратко, подробно, быстро, максимально тщательно | Падает предсказуемость и растёт задержка | Расставить приоритеты и убрать конфликтующие формулировки |

| Жёсткие команды вроде «будь предельно тщательным» | Модель начинает переусердствовать с инструментами и поиском | Явно задать критерий готовности и лимит на инструменты |

| Повтор одной и той же инструкции в нескольких слоях | Появляется лишний шум и расплывается приоритет | Свести правила в один управляемый слой |

| Старые few-shot примеры, конфликтующие с текущим форматом | Модель копирует не тот стиль и структуру ответа | Пересобрать примеры под текущий формат ответа |

Начинать нужно не с переписывания, а с базового прогона

Самый взрослый совет OpenAI здесь звучит почти скучно: сначала прогоните существующие промпты как есть и соберите baseline. Не переписывайте всё в первый же час. В practical guide компания рекомендует сначала запустить старые prompts на evals, посмотреть, где именно происходят регрессии, и только потом менять формулировки. Это важно по двум причинам.

Во-первых, без baseline у команды очень быстро включается самообман. Один разработчик уверяет, что новая версия стала «умнее». Другой говорит, что она «слишком много думает». Третий считает, что всё починил, потому что ему понравились три ручных прогона. Через неделю никто уже не понимает, улучшили ли prompt stack или просто поменяли стиль ответов. Базовый прогон возвращает разговор к измеримым кейсам.

Во-вторых, не все старые промпты обязательно сломаны. Часть из них можно оставить почти без изменений. Лучше искать не абстрактно «всё устарело», а конкретно: где модель стала многословнее, где хуже держит формат, где слишком активно ходит в инструменты, где не умеет вовремя остановиться. В этом смысле guidance OpenAI хорошо дополняет наш общий материал про промпт-инжиниринг в 2026 году. Базовые техники никуда не делись. Изменилась цена беспорядка вокруг них.

Рабочий минимум для миграции выглядит так:

- собрать 20-50 типовых кейсов, на которых важен результат, а не субъективное ощущение;

- прогнать старые промпты на GPT-5.5 без вмешательства и зафиксировать baseline;

- разбить проблемы на классы: формат, полнота, лишние tool calls, overthinking, конфликты между правилами;

- менять по одному слою за раз, а не переписывать всё одновременно.

Что стоит вырезать из legacy prompts в первую очередь

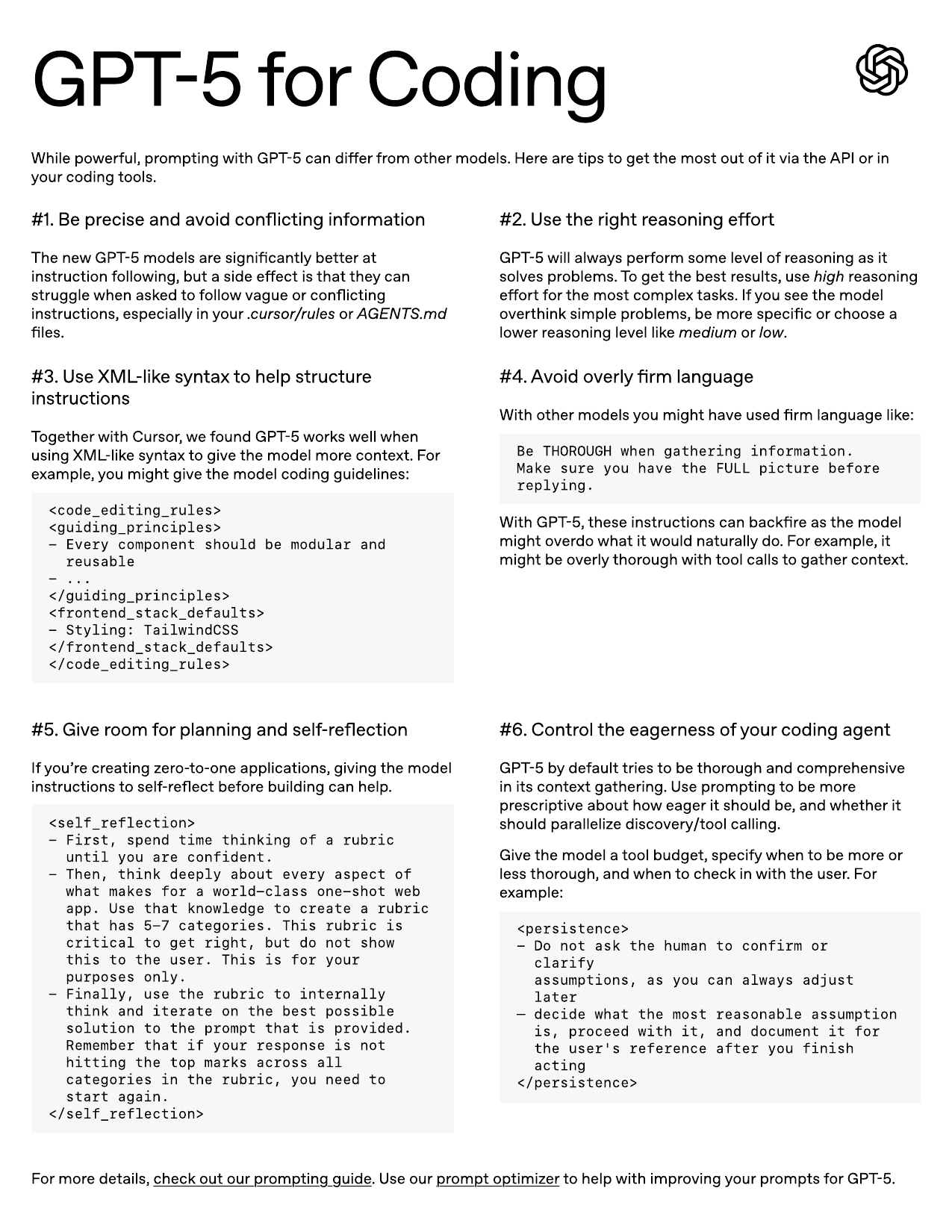

Первый кандидат на сокращение - декоративная строгость. В GPT-5 for Coding cheatsheet OpenAI отдельно предупреждает: overly firm language может дать обратный эффект. Формулировки вроде «будь предельно тщательным», «проверь всё до последнего байта», «никогда не останавливайся, пока не изучишь весь контекст» звучат как попытка усилить качество, но на деле часто подталкивают модель к бесконечным обходам, лишним поискам и повышенной стоимости ответа.

Второй кандидат - дублирование правил в разных слоях. Если одна и та же инструкция одновременно живёт в system prompt, middleware и examples, команда сама теряет понимание, что именно контролирует поведение. Для GPT-5.5 это особенно вредно, потому что модель лучше чувствует приоритеты, но разработчик начинает хуже понимать, где эти приоритеты реально заданы.

Третий кандидат - примеры, которые больше не соответствуют нужному формат ответа. В prompt migration cookbook OpenAI перечисляет типовые failure modes, и один из самых частых - несоответствие между инструкцией и examples. Например, вы просите короткий структурированный JSON, а few-shot блок продолжает показывать развёрнутые абзацы с пояснениями. Модель закономерно начинает колебаться между двумя форматами.

Наконец, стоит вырезать «страховочные» указания, которые на самом деле не измеримы. Фразы вроде «будь умным», «отвечай как эксперт мирового класса» или «не допускай ошибок» почти никогда не помогают. Зато отлично маскируют отсутствие конкретных критериев готовности.

Что нужно прописывать явно в новой версии промпта

Новые ограничения нужны, но их форма меняется. Работают не риторические команды, а операционные правила. Вместо «будь очень внимателен» полезнее написать, что считается завершённой задачей. Вместо «изучи всё, что можешь» полезнее указать допустимое число tool calls или глубину поиска. Вместо «отвечай как senior engineer» полезнее задать область роли и критерии результата.

Здесь полезно опираться на системный слой. В guidance про prompt personalities OpenAI рекомендует делать personality минимальной и хорошо ограниченной по функции. То же правило хорошо работает и для role instructions. Если нужен тон спокойного code reviewer, это можно зафиксировать. Но personality не должна разрастаться в отдельную философию, которая перетирает саму задачу. Более прикладной разбор этой части есть у нас в материале про системные промпты.

Для migration на GPT-5.5 обычно стоит явно вынести шесть блоков:

- цель задачи - что именно модель должна сделать;

- критерий успеха - как выглядит готовый ответ;

- ограничения - что делать нельзя или что не входит в scope;

- формат вывода - JSON, список, diff, короткий отчёт;

- stop condition - в какой момент задача считается завершённой;

- лимитом на инструменты или параметром reasoning.effort - сколько поиска и сколько «думания» здесь вообще допустимо.

Именно последние два пункта чаще всего отсутствуют в старых prompts. А потом команда удивляется, что модель блуждает слишком долго или наоборот останавливается слишком рано. В troubleshooting guide OpenAI прямо связывает overthinking с отсутствием ясного критерия завершения и с противоречивыми указаниями. То есть проблема часто не в «слишком умной модели», а в том, что промпт не умеет вовремя закрывать задачу.

Практический чеклист миграции

Если нужен короткий рабочий план, он выглядит так:

- Не переносите библиотеку промптов на GPT-5.5 молча. Сначала соберите базовый прогон на evals.

- Сократите system prompt до реально работающих правил: цель, границы, формат.

- Уберите противоречия. Если нужно и подробно, и кратко, задайте приоритет или два разных режима.

- Замените риторические команды на измеримые: условие остановки, критерий успеха и лимит на инструменты.

- Перепроверьте few-shot примеры: они должны показывать именно тот output, который нужен сейчас.

- Для рутинных задач снижайте параметр reasoning.effort, а не просите модель думать «как можно глубже» по умолчанию.

- После каждого изменения прогоняйте те же тестовые случаи, иначе миграция превратится в спор вкусов.

Подход стал строже, чем старый стиль prompt engineering, где многое держалось на эвристиках. Рабочая логика теперь проще: baseline, evals, явные условия остановки и контролируемый лимит на инструменты.

Чего не стоит обещать про GPT-5.5

Есть три популярных перегиба, которых лучше избежать и в самой статье, и в дальнейшей продуктовой коммуникации. Первый - утверждать, что GPT-5.5 ломает вообще все старые промпты. Официальные источники OpenAI этого не говорят. Они говорят, что на новых моделях ясность, отсутствие противоречий и правильная постановка условий остановки становятся важнее.

Второй перегиб - приписывать OpenAI отдельный публичный документ с точным названием GPT-5.5 Prompting Guide, если вы его не проверили. На момент этой проверки рекомендации собраны из нескольких официальных страниц: Academy, practical guide, cookbook и cheatsheet. Этого вполне достаточно для статьи, но формулировать нужно аккуратно.

Третий перегиб - делать из этой темы новый абсолютный гайд по промпт-инжинирингу. Такой материал у нас уже есть. У текущей статьи другая задача: объяснить, как обновлять старый набор промптов под GPT-5.5 без регрессий и без дублирования релизного кластера вокруг самой модели.

Что меняется для команд после 26 апреля

По состоянию на 26 апреля 2026 года главный практический вывод такой. Если GPT-5.5 отвечает хуже, чем вы ожидали, не начинайте с идеи, что модель «капризничает» или что нужно накидать ещё больше инструкций. Гораздо вероятнее, что старый набор промптов накопил шум, внутренние конфликты и неизмеримые команды, которые раньше сходили с рук, а теперь начали мешать.

Как переносить промпты на GPT-5.5 теперь сводится к вполне земной работе: новый базовый прогон, evals, сокращение противоречий и более явное управление условия остановки, параметром reasoning.effort и лимитом на инструменты. Этот набор рекомендаций полезен не только для одной модели. Он задаёт более взрослый стандарт работы с системами семейства GPT-5 вообще.

Источники и дата проверки

- OpenAI Academy: Prompting fundamentals, опубликовано 10 апреля 2026 года, проверено 26 апреля 2026 года.

- OpenAI: A practical guide to building with GPT-5, проверено 26 апреля 2026 года.

- OpenAI Cookbook: GPT-5 Prompting Guide, проверено 26 апреля 2026 года.

- OpenAI Cookbook: GPT-5 Troubleshooting Guide, опубликовано 17 сентября 2025 года, проверено 26 апреля 2026 года.

- OpenAI: GPT-5 for Coding cheatsheet, проверено 26 апреля 2026 года.

- OpenAI Cookbook: Prompt Personalities, опубликовано 5 января 2026 года, проверено 26 апреля 2026 года.

- OpenAI Cookbook: Prompt Migration and Improvement Using the New Optimizer, опубликовано 7 августа 2025 года, проверено 26 апреля 2026 года.

- OpenAI Help Center: Best practices for prompt engineering with the OpenAI API, обновлено за 3 дня до проверки, проверено 26 апреля 2026 года.