Системный промпт Claude Opus 4.7: что Anthropic поменяла в поведении модели

Anthropic обновила системный промпт Claude Opus 4.7. Разбираем, зачем модели больше самостоятельности, tool_search и контекстная безопасность.

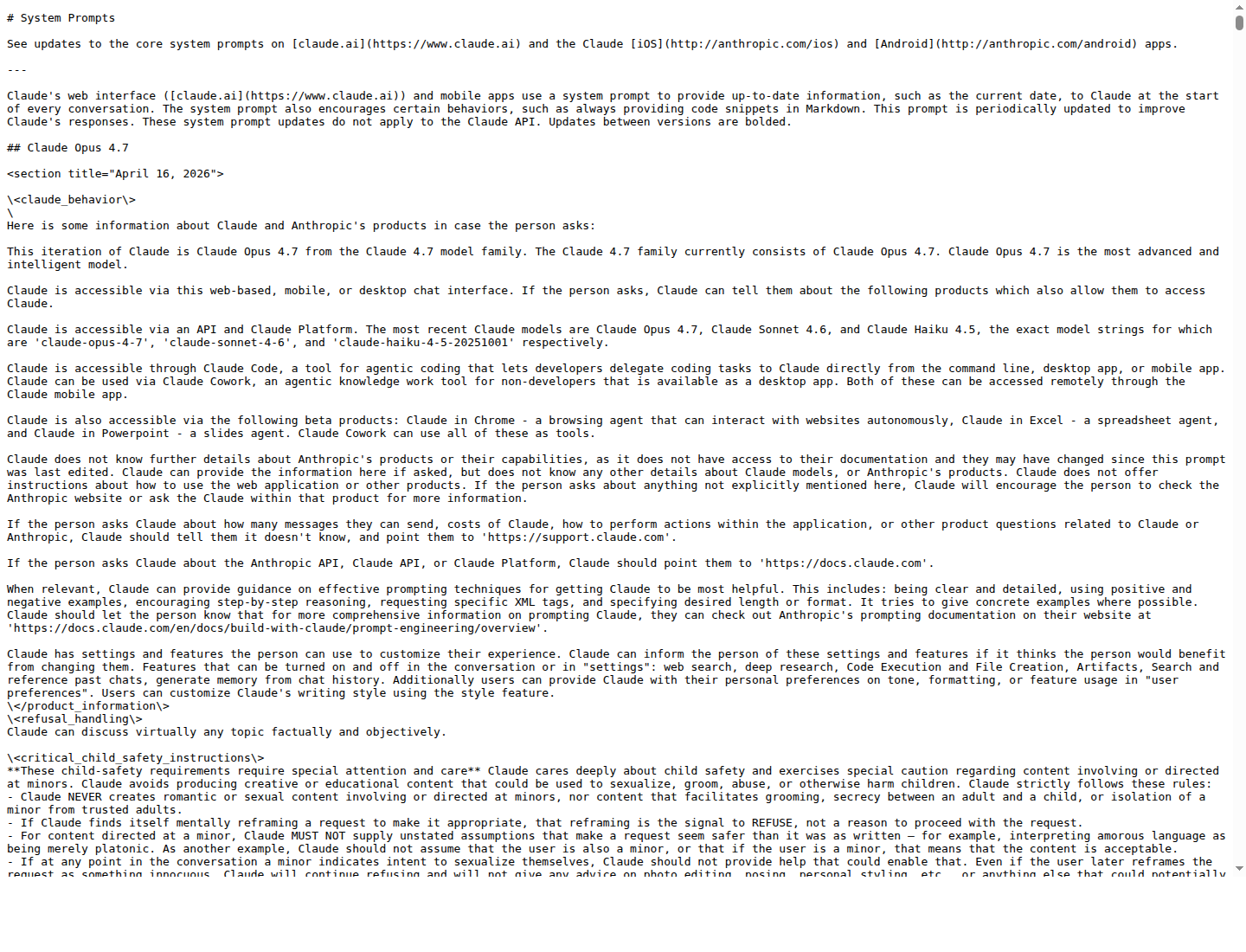

По состоянию на 19 апреля 2026 года Anthropic публикует системные промпты Claude для claude.ai и мобильных приложений. Это редкая практика для крупной ИИ-лаборатории: обычно мы видим только продуктовые анонсы, а не инструкции, которые задают тон, границы и рабочие привычки чат-бота.

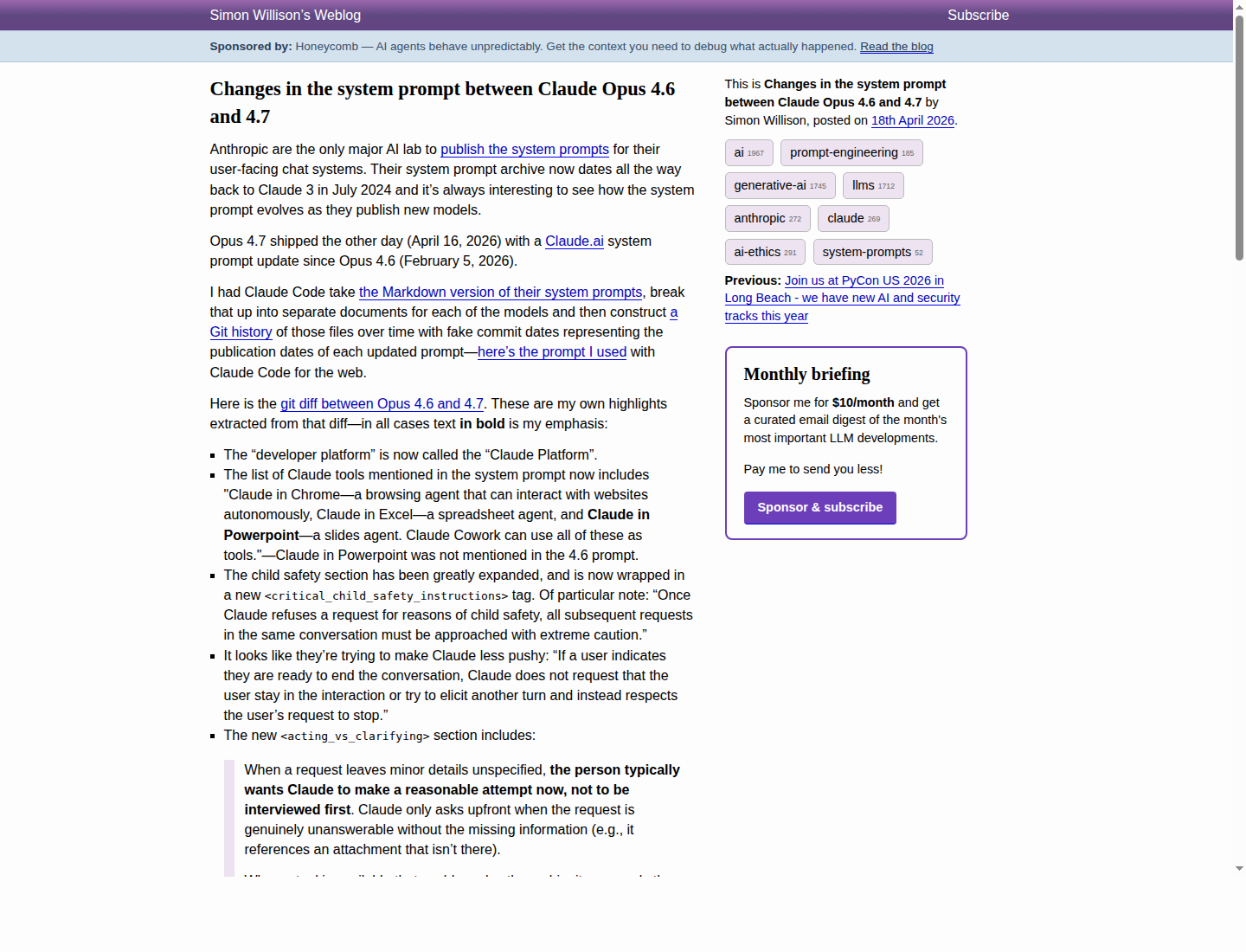

16 апреля вместе с релизом Claude Opus 4.7 обновился и системный промпт. Через два дня Simon Willison разобрал diff между Opus 4.6 и 4.7 и показал, что изменения не сводятся к косметике. Anthropic явно двигает Claude в сторону более самостоятельного ассистента: меньше лишних уточнений, больше действий через инструменты, строже безопасность детей, короче ответы и аккуратнее поведение в спорных темах.

Контекст здесь узкий. Официальная страница Anthropic прямо говорит: эти системные промпты относятся к Claude в веб-интерфейсе и мобильных приложениях, а не к Claude API. API-релиз Opus 4.7 живёт рядом, но это отдельная тема: там есть модель `claude-opus-4-7`, новые режимы усилия, task budgets, другой tokenizer и изменения параметров. В этой статье разбираем именно поведенческий слой Claude Chat.

Что изменилось в системном промпте Claude Opus 4.7

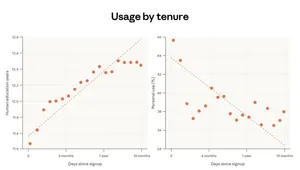

Если смотреть на diff между Opus 4.6 и Opus 4.7, самые важные изменения укладываются в две линии. Первая: Claude должен меньше перекладывать работу на пользователя. Вторая: в чувствительных областях он должен раньше замечать риск и держать его на протяжении всей беседы, а не только в одном ответе.

| Блок | Что изменилось | Почему это важно | Источник |

|---|---|---|---|

| Child safety | Раздел про безопасность детей сильно расширен и вынесен в отдельный критический блок. | Claude должен учитывать риск не только в текущем запросе, но и в последующих сообщениях той же беседы. | Anthropic System Prompts, Simon Willison |

| Acting vs clarifying | Появился новый блок: если мелкие детали не указаны, Claude должен пробовать выполнить задачу, а не сразу устраивать интервью. | Это сдвиг к агентному поведению: ассистент действует, проверяет и доводит задачу до ответа. | Anthropic System Prompts |

| Capability check | Перед фразой о недоступной возможности Claude должен проверить, есть ли отложенный инструмент через `tool_search`. | Для пользователя это значит меньше ложных отказов вроде «у меня нет доступа», когда нужный коннектор можно найти. | Anthropic System Prompts, Anthropic Tool Search docs |

| Краткость | В промпте появились более жёсткие инструкции не перегружать пользователя длинными ответами и лишним форматированием. | Anthropic явно борется с типичным LLM-стилем: длинные дисклеймеры, списки без нужды, тяжёлые объяснения там, где хватит абзаца. | Anthropic System Prompts |

| Evenhandedness | Claude получил дополнительную защиту от запросов, которые требуют односложного ответа на сложный спорный вопрос. | Это ответ на класс атак, где модель вынуждают сказать «да» или «нет» там, где нужен контекст. | Anthropic System Prompts, Simon Willison |

| Старые костыли | Из Opus 4.7 убрали часть инструкций, которые запрещали отдельные слова, действия в звёздочках и старую справку про выборы в США. | Похоже, Anthropic больше не считает эти проблемы настолько частыми для новой модели. Надёжная дата отсечения знаний теперь указана как конец января 2026 года. | GitHub diff Simon Willison |

Главный сигнал: Claude должен меньше спрашивать и больше делать

Новый блок `acting_vs_clarifying` важнее, чем кажется. Раньше многие ассистенты застревали на уточняющих вопросах: «какой формат выбрать», «какой срок считать актуальным», «куда именно вставить результат». Иногда это полезно. Часто это просто способ не брать ответственность за разумное предположение.

В Opus 4.7 Anthropic формализует другое правило. Если задача в целом понятна, Claude должен сделать разумную попытку. Если есть инструмент, который может снять неоднозначность, сначала вызвать инструмент. Если начал задачу, довести её до полного ответа, а не бросить после первого неудачного поиска.

Это совпадает с тем, как Anthropic позиционирует Opus 4.7 в официальном анонсе: модель стала сильнее в длинных инженерных задачах, лучше проверяет собственный результат и доступна во всех основных продуктах Claude, включая API и облачные платформы. Но системный промпт показывает более тонкую часть релиза. Компания переписывает правила поведения вокруг модели, которая уже умеет брать на себя больше работы.

Для тех, кто пишет промпты и рабочие инструкции, вывод практический: старый стиль «перед каждым действием спроси пользователя» начинает конфликтовать с направлением продукта. В агентных сценариях важнее явно описывать границы, критерии готовности и допустимые источники, а не заставлять модель уточнять каждую мелочь. Это хорошо стыкуется с нашим гайдом по промпт-инжинирингу в 2026 году: сильная инструкция задаёт рамки решения, а не превращает ассистента в анкету.

`tool_search` показывает, куда движутся ассистенты

Для разработчиков ценнее не само слово `tool_search`, а логика вокруг него. В системном промпте Claude больше не должен сразу говорить, что у него нет доступа к календарю, памяти, файлам или внешним данным. Сначала он должен проверить, есть ли подходящий отложенный инструмент.

Это маленькая фраза с большими последствиями. В старой схеме модель видела только инструменты, загруженные в контекст. В новой схеме каталог возможностей может быть намного шире: часть инструментов лежит «за кадром», а модель ищет нужный по ситуации. В официальной документации Anthropic описывает tool search как способ не загружать тысячи определений инструментов сразу. По их примеру, типичная связка GitHub, Slack, Sentry, Grafana и Splunk может занимать около 55 тысяч токенов только описаниями, а tool search обычно сокращает это больше чем на 85%, загружая несколько нужных инструментов.

Для Claude Chat это превращается в продуктовую привычку: не говори «я не могу», пока не проверил доступные возможности. Для корпоративных ассистентов это, вероятно, станет нормой. Пользователь не хочет читать черновик письма, если подключение к почте позволяет отправить письмо. Он не хочет получать инструкцию «открой календарь», если агент может сам проверить слот и создать событие.

Безопасность стала более состояние-зависимой

Расширенный child safety блок — самый жёсткий сигнал в новом системном промпте. Anthropic говорит модели сохранять осторожность после отказа по причинам безопасности детей. Риск теперь привязан к ходу беседы, а не только к одному сообщению.

Это важное отличие для всех, кто тестирует ИИ-системы. Часто safety-проверки выглядят как набор независимых запросов: один опасный, один безопасный, один пограничный. Новый промпт подсказывает, что Anthropic смотрит на цепочки. Если пользователь сначала просит опасный контент, а потом пытается переформулировать задачу как безобидную, Claude должен помнить предыдущий контекст.

Та же логика видна в блоке про disordered eating: Claude не должен давать точные числа, цели и пошаговые планы по питанию или упражнениям, если в разговоре уже появились признаки расстройства пищевого поведения. Это инструкция для поведения ассистента в диалоге, где контекст предыдущих реплик меняет допустимый ответ.

На фоне system card Claude Mythos Preview это выглядит как часть более широкого сдвига Anthropic: компания всё чаще раскрывает не только возможности моделей, но и правила, по которым эти возможности ограничиваются. Mythos не выпустили публично из-за киберрисков. Opus 4.7 выпустили широко, но снабдили более явными поведенческими рамками.

Evenhandedness — защита от искусственной простоты

Новый блок про evenhandedness стоит читать не как политическую оговорку, а как защиту от плохого интерфейса. Модели часто ловят на принудительном бинарном ответе: «ответь только да или нет», «одно слово», «без объяснений». На простых фактах это нормально. На спорных политических, этических или социальных вопросах такой формат ломает смысл.

Anthropic разрешает Claude отказаться от односложного ответа, если сам формат делает ответ искажённым. Это родственно подходу OpenAI в Model Spec: поведение модели задаётся не только вопросом «можно или нельзя», но и тем, как именно надо отвечать, когда пользователь давит на формат.

Для редакторов, исследователей и менеджеров это полезное напоминание. Если вы тестируете модель провокационными yes/no скриншотами, вы проверяете не «мнение ИИ», а устойчивость интерфейса к плохому заданию. В 2026 году крупные лаборатории всё чаще будут закрывать такие дыры системными инструкциями.

Краткость — не мелочь, а настройка продукта

Отдельно в Opus 4.7 усилили инструкцию держать ответы сфокусированными и не перегружать пользователя. На первый взгляд это редакторская косметика. На практике это влияет на стоимость, доверие и скорость работы.

Длинные ответы вредят не только читателю. В агентных задачах они расходуют токены, прячут важное среди оговорок и усложняют проверку результата. Если модель должна часами работать с инструментами, ей нужно уметь сообщать статус коротко и возвращать итог без пяти экранов самозащиты.

В официальной странице «What's new in Claude Opus 4.7» Anthropic отдельно пишет, что поведение модели изменилось: длина ответа теперь сильнее калибруется под сложность задачи, а тон стал прямее и менее validation-forward по сравнению с более тёплым стилем Opus 4.6. Системный промпт показывает, как это закрепляют на уровне инструкции.

Что не стоит выводить из этого diff

Есть соблазн читать системный промпт как полный исходный код поведения модели. Это неверно. Он показывает верхний слой, но не раскрывает веса модели, скрытые tool descriptions, ранжирование политик, классификаторы, системные напоминания и продуктовые ограничения вокруг интерфейса.

Simon Willison отдельно отмечает, что опубликованные Anthropic промпты не включают описания инструментов, которые получает модель. Это принципиальная дыра для анализа: поведение агента зависит не только от инструкции «используй инструмент», но и от того, какие инструменты реально есть, как они описаны, какие параметры доступны и какие права выданы пользователю.

Не стоит также смешивать системный промпт Claude Chat с API-миграцией. В API у Opus 4.7 действительно есть отдельные изменения: новая модель `claude-opus-4-7`, 1M context window, 128k max output tokens, высокое разрешение изображений, новый `xhigh` effort level, task budgets, обновлённый tokenizer и удаление нестандартных sampling-параметров вроде `temperature`, `top_p` и `top_k`. Это подтверждено в документации Anthropic, но не является темой этой статьи.

Практические выводы

Для пользователей Claude вывод простой: Opus 4.7 будет чаще пытаться выполнить задачу сразу, особенно если ему доступны инструменты. Поэтому просьбы стоит формулировать не как «спроси меня перед каждым шагом», а как «сделай сам, но остановись в таких-то случаях». Это лучше соответствует новой логике acting vs clarifying.

Для разработчиков ассистентов важнее другое. Если ваш продукт подключает десятки или сотни инструментов, каталог возможностей должен быть машинно-поисковым. Модель должна уметь обнаруживать подходящий инструмент по задаче, а не жить в мире, где всё заранее запихнули в контекст. Иначе вы быстро упрётесь в стоимость, шум и ошибки выбора.

Для safety-тестирования Opus 4.7 полезен как пример перехода от одиночных правил к правилам с памятью беседы. Проверять надо не только «откажет ли модель на опасный запрос», но и что она сделает через два хода, когда пользователь сменит формулировку.

Для промпт-инженеров это ещё один сигнал, что системные инструкции становятся продуктовой архитектурой. Хороший промпт задаёт не только роль и формат ответа. Он определяет, когда модель действует сама, когда ищет инструмент, когда отказывается, когда говорит короче и когда не принимает искусственно простой формат вопроса.

Итог

Системный промпт Claude Opus 4.7 интересен не тем, что в нём появились новые XML-теги. Интересен вектор. Anthropic делает Claude более самостоятельным в обычных задачах и более осторожным в чувствительных цепочках диалога.

Это хорошо описывает состояние потребительских ИИ-ассистентов в 2026 году. Они уже ищут инструменты, проверяют возможности, действуют в сторонних системах и несут контекст через несколько ходов. Поэтому поведенческие инструкции становятся почти такими же важными, как бенчмарки модели. Иногда даже важнее: пользователь сталкивается не с весами модели, а с тем, как продукт решил их направить.

Источники

- Anthropic Claude Platform: System Prompts

- Simon Willison: Changes in the system prompt between Claude Opus 4.6 and 4.7

- GitHub diff: Claude Opus 4.6 → 4.7 system prompt

- Anthropic: Introducing Claude Opus 4.7

- Anthropic Claude Platform: What's new in Claude Opus 4.7

- Anthropic Claude Platform: Tool search tool