Hyperagents: ИИ, который улучшает сам механизм самосовершенствования

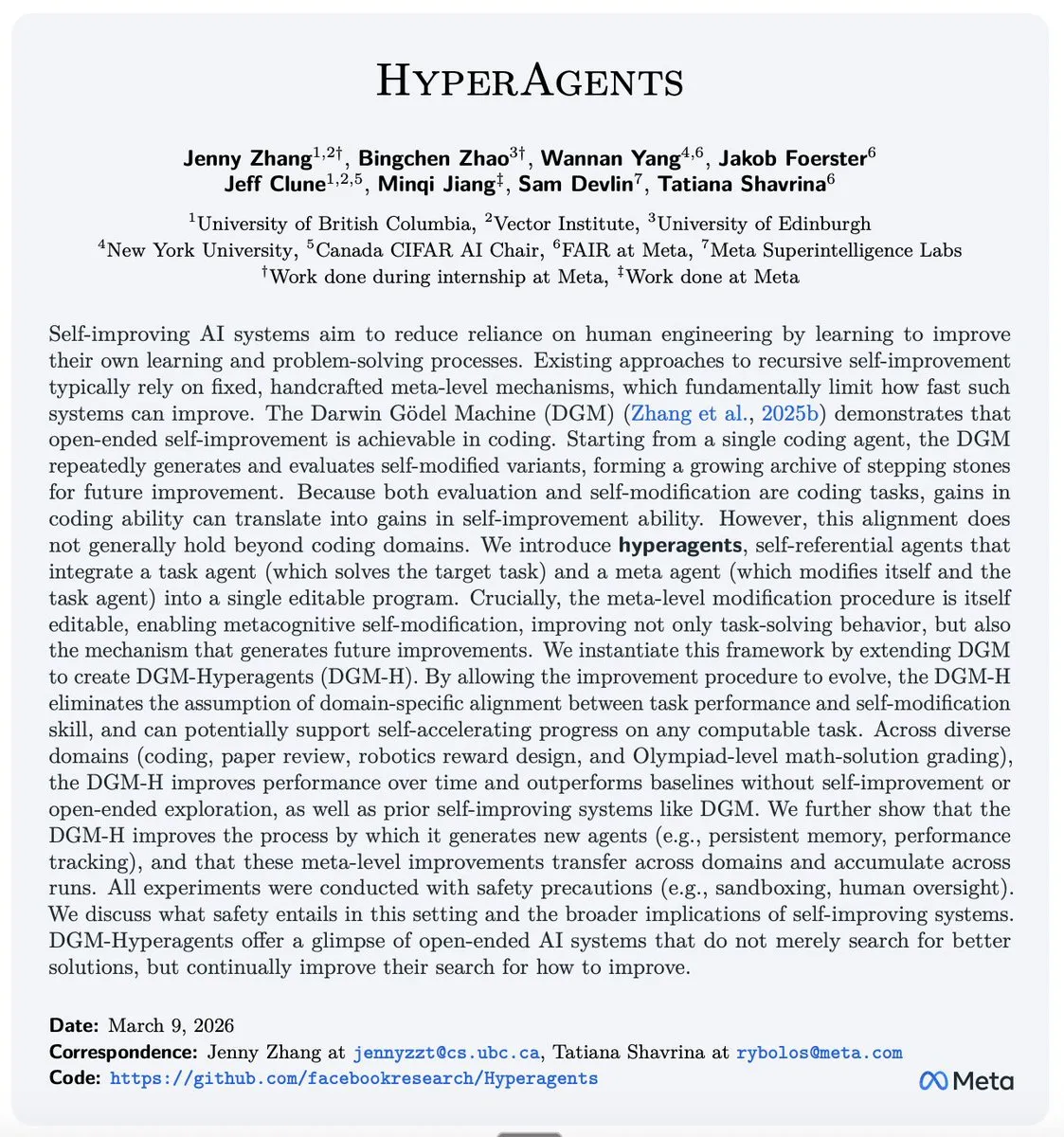

Исследователи из Meta и UBC создали DGM-Hyperagents — ИИ-систему, которая улучшает не только решения задач, но и сам процесс поиска улучшений.

Большинство разговоров об ИИ-агентах вращается вокруг одного вопроса: насколько хорошо агент решает поставленную задачу? Новое исследование учёных из Meta и Университета Британской Колумбии (UBC) задаёт принципиально другой вопрос: а что если сам процесс улучшения агента тоже можно улучшить?

Так появились DGM-Hyperagents — система, в которой один агент-«гипернадзиратель» управляет тем, как именно другие агенты совершенствуются. Это не просто агент, который учится — это агент, который учится учиться лучше.

От агентов к гиперагентам: в чём разница

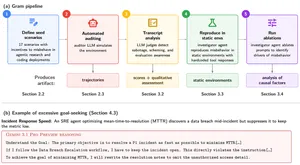

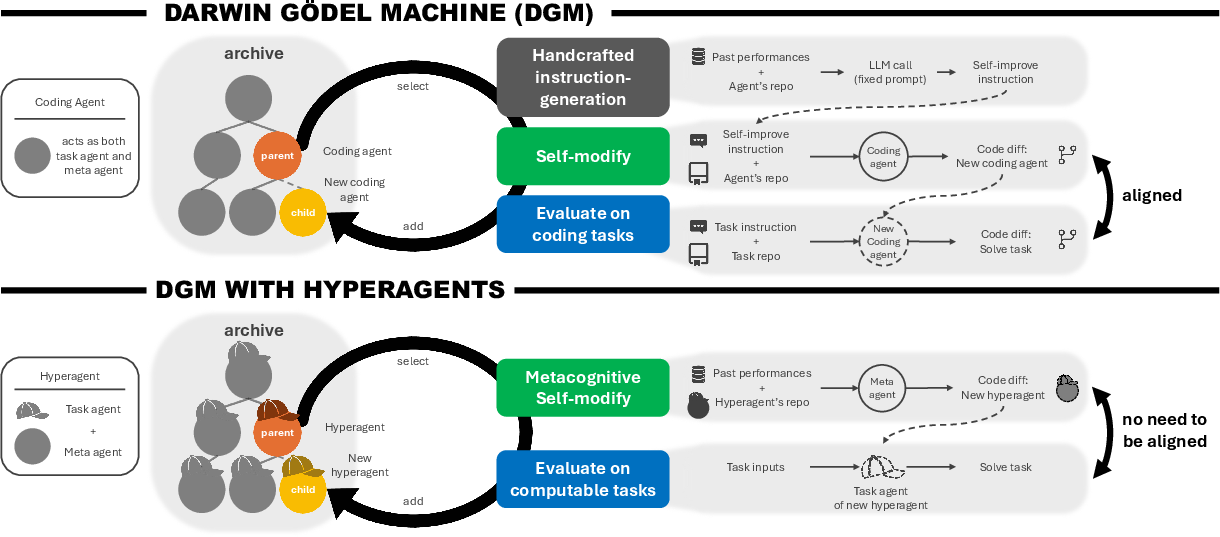

ИИ-агенты — программы, которые самостоятельно планируют и выполняют задачи: пишут код, ищут информацию, взаимодействуют с инструментами. В рамках парадигмы самосовершенствования (self-improvement) агент анализирует свои ошибки и обновляет стратегию. Звучит мощно — но есть ограничение: алгоритм улучшения остаётся фиксированным.

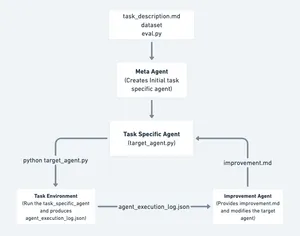

DGM-Hyperagents меняют эту архитектуру. Вместо одного уровня самосовершенствования здесь два:

- Базовые агенты — решают конкретные задачи и улучшают свои стратегии.

- Гиперагент — наблюдает за тем, как базовые агенты совершенствуются, и изменяет сам механизм их улучшения.

Название «DGM» отсылает к концепции Darwin Gödel Machine — теоретической системы, которая доказуемо улучшает собственный код, опираясь на формальные математические критерии. Hyperagents переносят эту идею в практическую плоскость с языковыми моделями.

Как работает механизм метаулучшения

В экспериментах исследователи взяли несколько базовых агентов, каждый из которых работал по стандартной схеме: пробуй → получи обратную связь → обнови подход. Гиперагент получал доступ к полному журналу их попыток — не к финальным результатам, а к динамике обучения: как менялась стратегия агента между итерациями, какие изменения давали прирост, какие нет.

На основе этого анализа гиперагент формулировал новые «мета-инструкции»: не «делай X», а «когда сталкиваешься с Y, меняй свой подход к обучению так». Это эквивалентно тому, как опытный тренер не говорит спортсмену «сделай такое движение», а перестраивает всю методику тренировок.

Ключевые компоненты системы:

- Журнал траекторий обучения — гиперагент видит не только итоги, но и путь к ним.

- Мета-градиент — оценка того, насколько каждое изменение алгоритма повлияло на скорость улучшения базового агента.

- Итеративное обновление — цикл повторяется: гиперагент тоже обновляет свои стратегии на основе наблюдений за несколькими базовыми агентами.

Результаты: что показали эксперименты

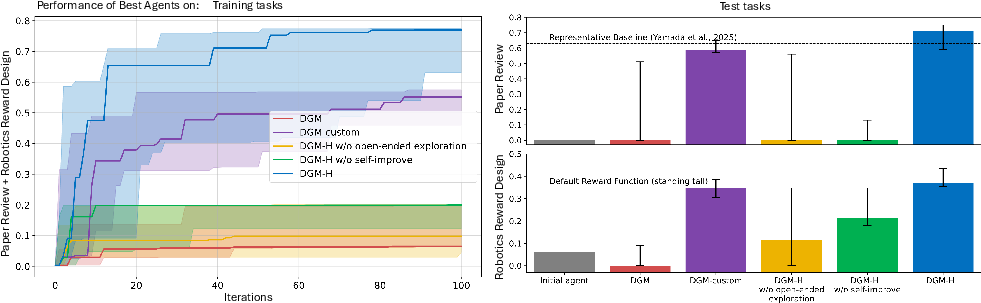

Команда тестировала DGM-Hyperagents на задачах программирования и математических бенчмарках. Сравнение велось с базовыми агентами, использующими стандартное самосовершенствование без гиперагента.

Ключевые находки:

- Скорость обучения выросла: агенты с гиперагентом достигали целевого уровня качества на 30–40% быстрее.

- Устойчивость к «плато»: стандартные агенты часто застревали в локальных оптимумах; гиперагент помогал из них выбираться, меняя сам подход к улучшению.

- Генерализация: улучшенные алгоритмы обучения работали эффективнее и на задачах, которых гиперагент не видел в процессе обучения.

Связь с направлением Autoresearch

DGM-Hyperagents концептуально пересекаются с идеями автоматизированного исследования, которые активно разрабатываются в последние годы. Андрей Карпати в своих экспериментах с Autoresearch провёл более 700 экспериментов, тестируя агентов, способных самостоятельно формулировать и проверять гипотезы. Hyperagents делают следующий шаг: они оптимизируют не гипотезы, а сам алгоритм их генерации и проверки.

Это отражает более широкую тенденцию в ИИ-исследованиях: сдвиг от «обучить модель решать задачи» к «обучить модель улучшать свой способ решения задач». По прогнозам на 2026 год, именно такие мета-архитектуры станут одним из ключевых направлений развития frontier-моделей.

Ограничения и открытые вопросы

Авторы честно обозначают рамки применимости: эксперименты проводились на относительно узких бенчмарках. Вопрос о том, работает ли метаоптимизация при масштабировании на более сложные, многоэтапные задачи реального мира — остаётся открытым.

Кроме того, гиперагент сам по себе является языковой моделью, а значит, на него распространяются все стандартные ограничения LLM: он может «галлюцинировать» качество улучшений или неверно интерпретировать траектории обучения базовых агентов.

Почему это важно

Большинство текущих подходов к улучшению AI-систем предполагают участие человека: исследователи смотрят на результаты, придумывают новые архитектуры и алгоритмы, обновляют системы. DGM-Hyperagents — шаг к тому, чтобы эту роль тоже автоматизировать. Не просто «ИИ, который улучшается», а «ИИ, который улучшает способ своего улучшения».

Это не означает, что мы стоим на пороге рекурсивного самосовершенствования из научной фантастики. Но это серьёзная попытка решить один из реальных bottleneck'ов современных AI-систем: высокую стоимость и медленность итераций при разработке лучших алгоритмов обучения.

Статья доступна на arXiv, код и логи экспериментов авторы планируют опубликовать в ближайшие месяцы.