Google Research показала AI-агентов для фигур и peer review

Google Research описала AI-агентов PaperBanana и ScholarPeer для научного workflow: один собирает фигуры, второй автоматизирует peer review.

Google Research показала AI-агентов для фигур и peer review не как очередной чат для учёных, а как заход в сам научный конвейер. Два preprint, опубликованные на arXiv 30 января 2026 года, описывают более прикладной сценарий: одна система помогает собирать готовые к публикации фигуры для статей, вторая автоматизирует рецензирование с внешним контекстом, поиском по вебу и проверкой утверждений.

Это важный сдвиг. ИИ всё чаще забирает не только генерацию текста, но и дорогие, утомительные стадии интеллектуальной работы, где раньше приходилось вручную собирать диаграммы, искать пропущенные baseline и проверять новизну статьи на фоне литературы.

По состоянию на 9 апреля 2026 года речь идёт именно об исследовательских работах Google Research, а не о новом публичном продукте. Оба preprint датированы 30 января 2026 года.

Что делает PaperBanana

PaperBanana решает конкретную и хорошо знакомую боль академической работы: у исследователя может быть готова идея, текст и эксперимент, но на фигуры и схемы всё равно уходит много ручного труда. На странице проекта авторы прямо называют готовые к публикации иллюстрации бутылочным горлышком в исследовательском процессе.

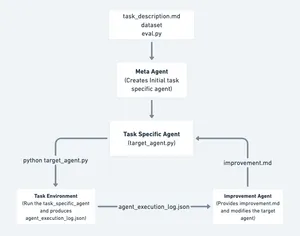

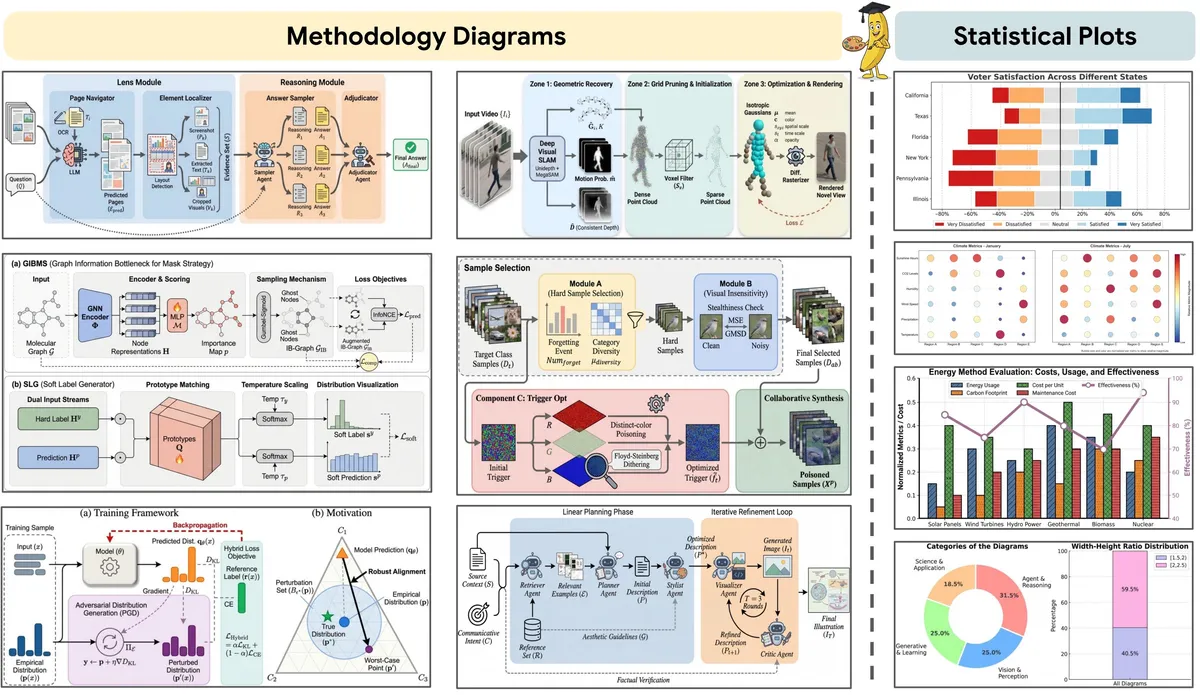

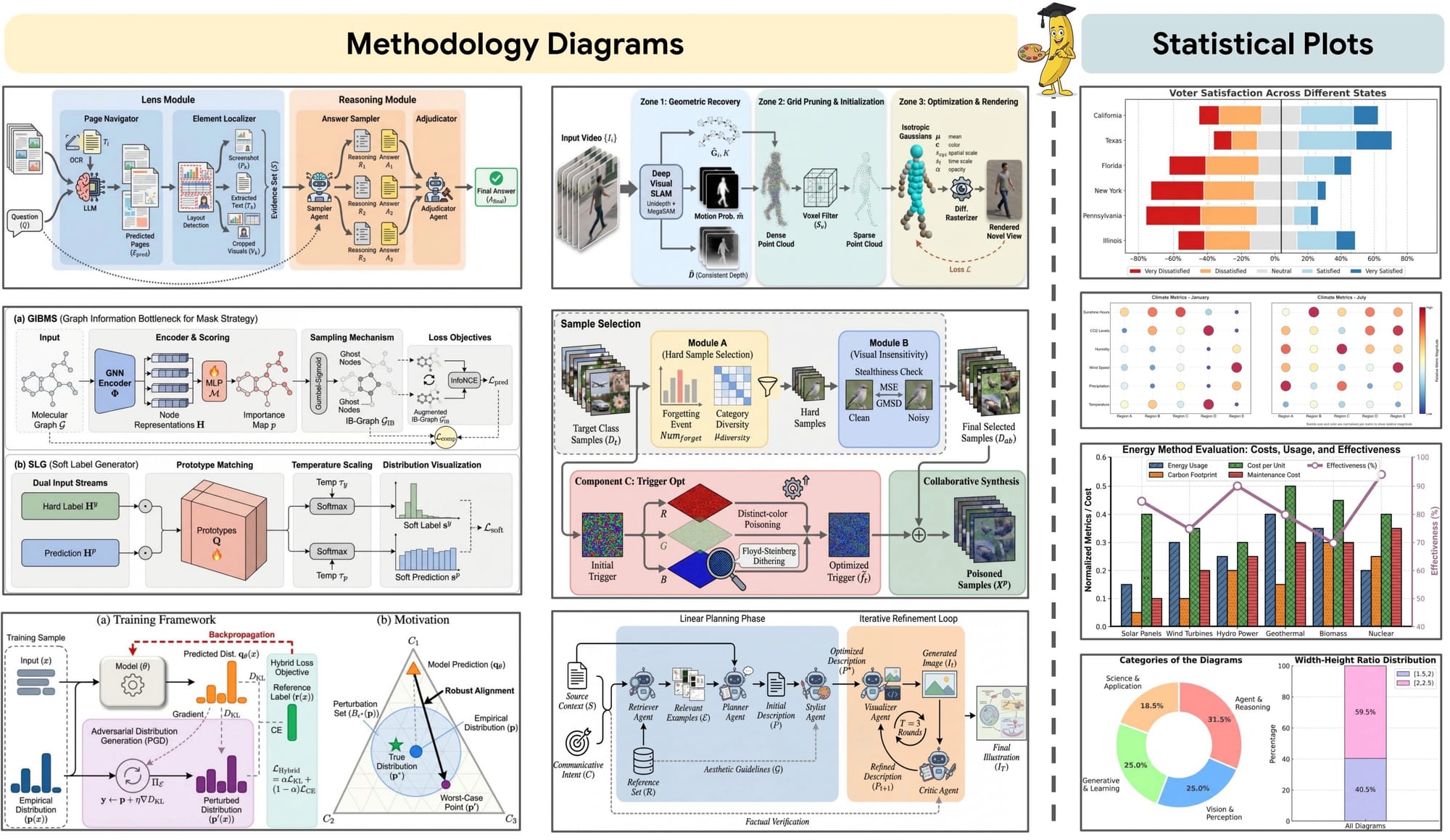

Система построена как связка из пяти специализированных агентов. Retriever ищет релевантные референсы, Planner превращает научный контекст в подробное описание будущей фигуры, Stylist собирает визуальные правила, Visualizer рендерит изображение или код для графика, а Critic проверяет результат и запускает следующий цикл доработки. Это уже не один запрос «нарисуй картинку», а полноценная агентная цепочка.

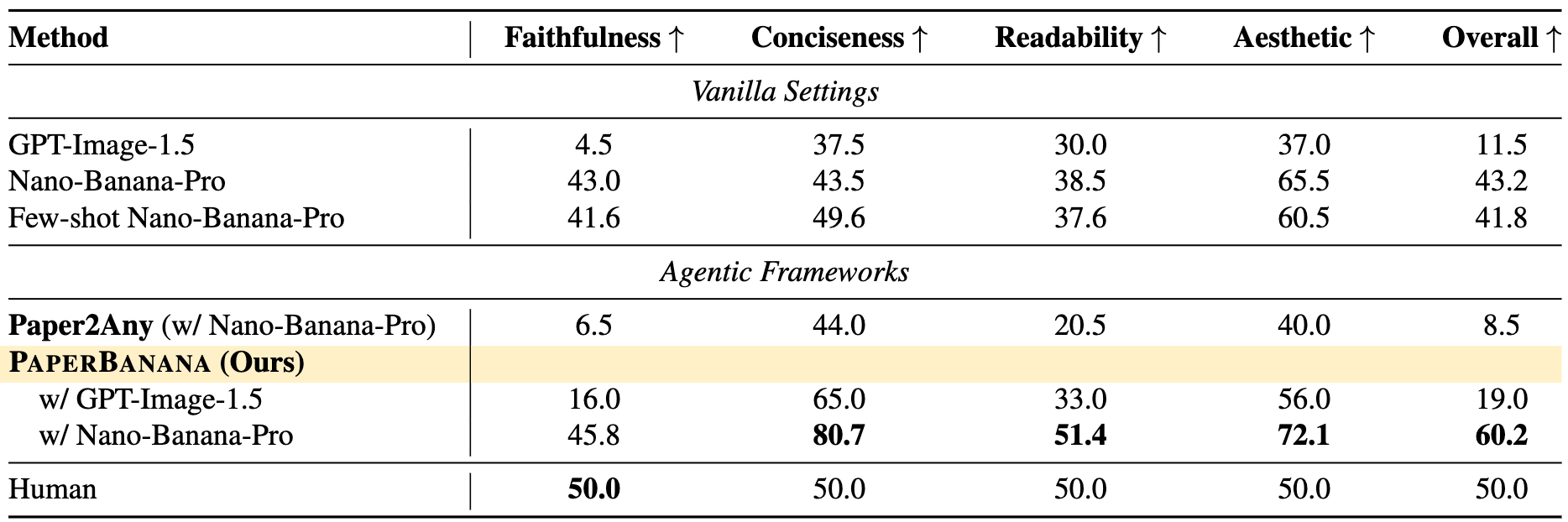

За PaperBanana стоит команда из Peking University и Google Cloud AI Research. Для оценки авторы собрали бенчмарк PaperBananaBench: 292 тестовых кейса по методологическим диаграммам из публикаций NeurIPS 2025 и ещё 292 эталонных кейса. По странице проекта система обходит базовые подходы по точности передачи содержания, лаконичности, читаемости и общему визуальному качеству.

Важно и другое: PaperBanana пытается закрыть тот слой работы, который плохо масштабируется руками. Речь не про «красивые картинки для соцсетей», а про схемы, графики и диаграммы, которые потом реально идут в статью, презентацию или заявку на грант.

Что делает ScholarPeer

ScholarPeer заходит в ещё более чувствительную зону: peer review. В аннотации авторы пишут, что многие автоматические системы рецензирования застревают на поверхностной критике, потому что читают статью в вакууме. Они умеют пересказать работу, но хуже справляются с оценкой новизны, значимости и методологических слабостей.

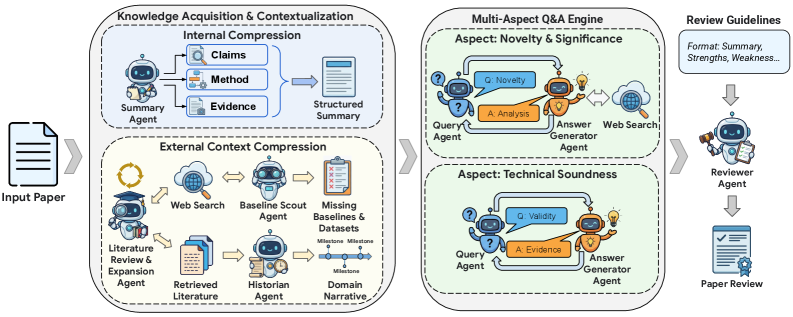

ScholarPeer пытается вытащить рецензирование из этого вакуума. В описании работы система названа мультиагентным фреймворком, который получает внешний контекст, использует веб-поиск и проверяет утверждения по литературе. Внутри для этого есть Historian Agent, Baseline Scout и Multi-Aspect Q&A Engine. То есть агент-рецензент не просто читает PDF, а ищет пропущенные сравнения, собирает предметный фон и уже потом формирует отзыв.

Авторы оценивают ScholarPeer на наборе DeepReview-13K и показывают, что система выигрывает у сильных базовых подходов в попарных сравнениях, а также делает отзывы разнообразнее и ближе по охвату к человеческим. Для новости важнее не сама цифра на графике, а принцип: Google Research фактически показывает, что хорошее рецензирование требует внешнего контекста, а не одной только суммаризации текста.

Почему это важнее обычной research-новости

По отдельности обе работы можно было бы списать на узкие академические прототипы. Вместе они показывают более широкий сдвиг: ИИ заходит в научный конвейер по тем точкам, которые долго казались слишком ремесленными, слишком контекстными и слишком человеческими для автоматизации.

Сюда попадают сразу несколько дорогих стадий работы: подготовка фигур и графиков, поиск пропущенных baseline, проверка новизны на фоне литературы и структурирование рецензии так, как это делает опытный рецензент. Это уже не история про «ассистента, который помогает писать текст». Это история про ИИ, который начинает обслуживать саму инфраструктуру производства знания.

Логика хорошо стыкуется с более широким трендом на агентные системы. Мы уже видели похожее движение в материале про ИИ-агентов в браузере и в истории про Autoresearch Карпати. Разница в том, что Google здесь двигается не в сторону общего ассистента, а прямо в научную инфраструктуру.

Где у этих систем предел

Пока это именно исследования, а не готовые массовые инструменты. У PaperBanana остаётся вопрос доверия к визуальной точности: авторы сами показывают, что генерация статистических графиков картинкой может выглядеть эффектнее, но проигрывать по точности передачи данных кодовому пути. Для науки это критично.

У ScholarPeer другой риск. Peer review держится не только на поиске похожих работ и не только на формальном разборе методологии. Там много дисциплинарного контекста, скрытого знания и профессиональной интуиции, которые трудно свести к агентной оркестрации. Поэтому до реального встраивания в редакционные процессы журналов здесь ещё длинная дистанция.

Но даже с этими ограничениями направление выглядит серьёзно. Если такие системы дойдут до рабочих продуктов, следующим полем конкуренции станет уже не то, кто лучше пишет аннотацию, а то, кто глубже встроился в производство знания, экспертизы и научной коммуникации.

Итог

Google Research не «запустила новый продукт для учёных сегодня», и это важно проговорить прямо. Но она показала два исследовательских направления, которые хорошо отражают следующую фазу агентного ИИ: не общий помощник на все случаи жизни, а узкие системы для конкретных и дорогих стадий интеллектуальной работы.

PaperBanana и ScholarPeer интересны именно поэтому. Один забирает на себя визуальное производство научной статьи, второй пробует автоматизировать внешнюю научную оценку с реальным контекстом. Если этот класс инструментов закрепится, ИИ начнёт менять не только то, как мы пишем про науку, но и то, как наука вообще собирается, оформляется и проходит проверку.