Как запустить Stable Diffusion на MacBook с Apple Silicon

Stable Diffusion на MacBook с Apple Silicon: когда хватит Draw Things, когда нужен Diffusers с MPS, а когда уже стоит идти в ComfyUI или Core ML.

Проверено 11 мая 2026 года. Stable Diffusion на MacBook с Apple Silicon сегодня запускается без экзотики. Вопрос уже не в том, можно или нельзя. Вопрос в другом: какой путь не заставит вас тратить вечер на лишнюю настройку.

Короткий ответ такой. Draw Things нужен тем, кто хочет просто открыть приложение и получить первую локальную генерацию. Diffusers с MPS нужен тем, кому важен Python и контроль над кодом. ComfyUI имеет смысл, когда вы собираете повторяемые схемы, а не просто гоняете одиночные промпты. Core ML стек Apple нужен уже не для знакомства со Stable Diffusion, а для нативных приложений под macOS и iOS. Ниже — только то, что подтверждается Apple, Hugging Face, ComfyUI и App Store.

Что нужно от MacBook

Для пути через Diffusers и ускорение mps официальные требования Hugging Face довольно прямые: Mac с Apple Silicon, macOS 12.6 или новее, arm64-версия Python и PyTorch 2.0 или новее. Если у вас MacBook на M1, M2, M3 или M4, схема выбора та же: сначала определяете сценарий, потом стек.

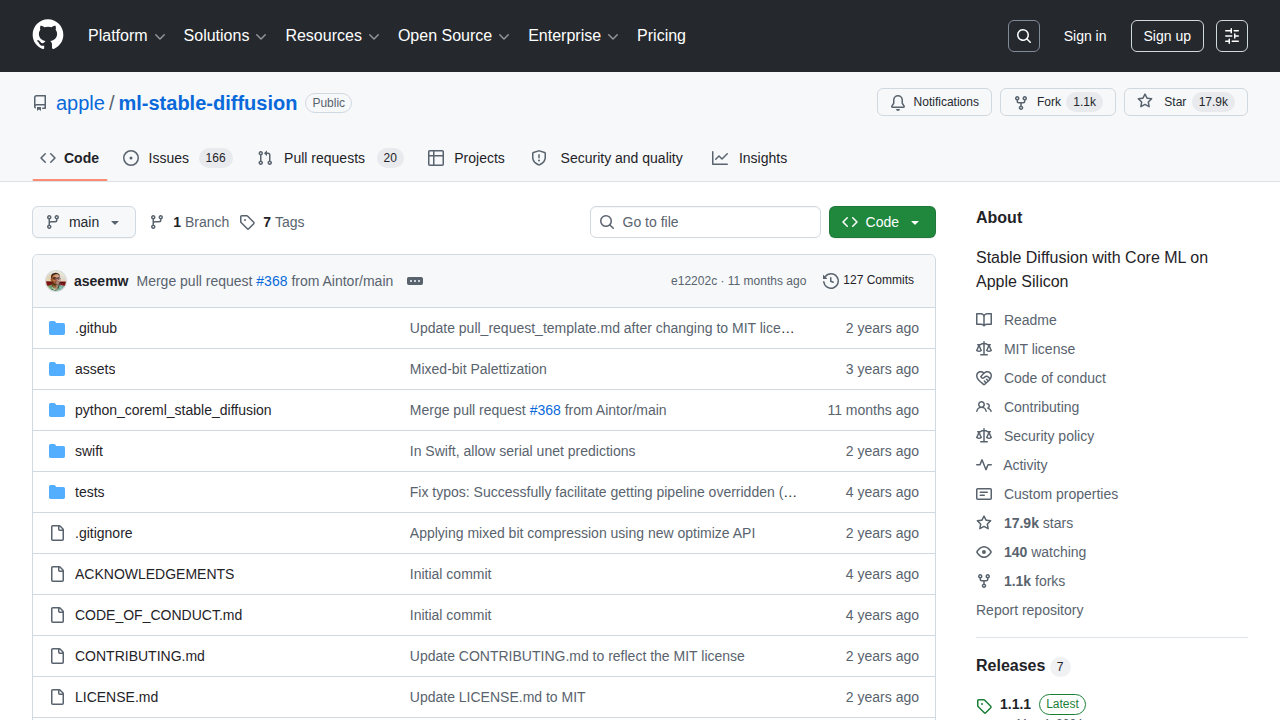

Для Core ML у Apple порог выше. В репозитории apple/ml-stable-diffusion указаны macOS 13.1 для конвертации и целевая среда выполнения, а минимальное поколение железа начинается с M1. Отдельная практическая проблема — память. Документация Diffusers прямо предупреждает: на M1 и M2 производительность сильно проседает, когда система уходит в swap. Поэтому на 8 ГБ лучше начинать с лёгких сценариев, а 16 ГБ и выше дают заметно более спокойную жизнь.

Какой вариант выбрать

| Сценарий | Что выбрать | Почему |

|---|---|---|

| Нужен самый простой локальный старт | Draw Things | Ставится из App Store, работает офлайн и не требует ручной сборки Python-стека. |

| Нужен код и контроль над пайплайном | Diffusers + MPS | Это официальный путь Hugging Face для Apple Silicon через PyTorch. |

| Нужны сложные схемы и повторяемые сценарии | ComfyUI | Настольная версия для macOS рассчитана именно на Apple Silicon, а ручная установка поддерживает M-series через Metal. |

| Вы делаете своё приложение под Apple-стек | Core ML Stable Diffusion | Apple даёт отдельный открытый стек с Python-пакетом, Swift-пакетом и готовыми Core ML-моделями. |

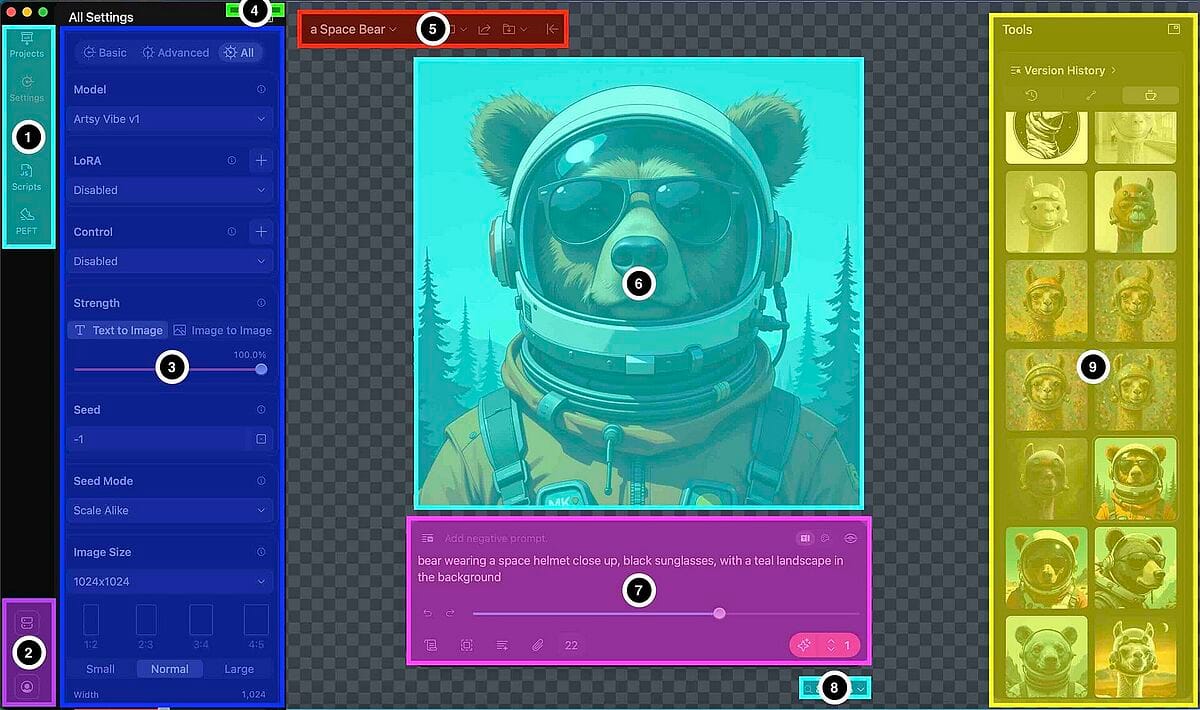

Способ 1: Draw Things для быстрого старта

Draw Things остаётся самым коротким маршрутом к локальной генерации на MacBook. В App Store приложение описано как офлайновый инструмент для генерации изображений: локальная генерация не требует интернета или подписки, а промпты и изображения остаются на устройстве. Там же отдельно подчёркнуто, что приложение оптимизировано под Apple и быстро работает на Mac с Apple Silicon.

Для этой статьи важны ещё две вещи. Во-первых, Draw Things не заставляет вручную разбираться с Python, Torch и зависимостями. Во-вторых, по описанию в App Store и официальной wiki он умеет импортировать модели сообщества и LoRA. Это хороший первый шаг, если вам нужно понять не абстрактно, а на своей машине: тянет ли ваш MacBook локальный стек генерации вообще.

Именно поэтому Draw Things — лучший стартовый путь для большинства владельцев MacBook. Ставите приложение, запускаете первую локальную генерацию, смотрите на расход памяти и только потом решаете, есть ли смысл идти в ComfyUI или в собственный Python-стек.

Способ 2: Diffusers + MPS, если нужен Python

Если вам нужен не просто интерфейс, а нормальный программный доступ, официальный путь сегодня — Diffusers с ускорением через mps. Hugging Face прямо пишет, что Diffusers работает на Apple Silicon через PyTorch mps, который использует Metal для ускорения инференса на macOS.

Минимальный рабочий пример выглядит так:

pip install diffusers transformers accelerate torch safetensorsfrom diffusers import DiffusionPipeline

import torch

pipe = DiffusionPipeline.from_pretrained(

"stable-diffusion-v1-5/stable-diffusion-v1-5",

torch_dtype=torch.float16,

variant="fp16",

use_safetensors=True,

).to("mps")

pipe.enable_attention_slicing()

image = pipe("studio photo of a ceramic mug on a wooden desk").images[0]

image.save("result.png")Здесь важны не косметические детали, а практические. enable_attention_slicing() в документации рекомендован особенно тем, у кого меньше 64 ГБ памяти или кто рендерит не в базовых 512×512. Hugging Face также предупреждает, что пакетная генерация на MPS может работать нестабильно, поэтому на MacBook обычно надёжнее итерировать изображения по одному, а не гнать их пачками.

Если вам нужен не узкий MacBook-разбор, а широкий вводный маршрут по локальной установке Stable Diffusion как класса инструментов, у нас есть отдельный материал про Stable Diffusion на русском. Этот текст уже про другое: какой путь запуска выбрать именно на Apple Silicon.

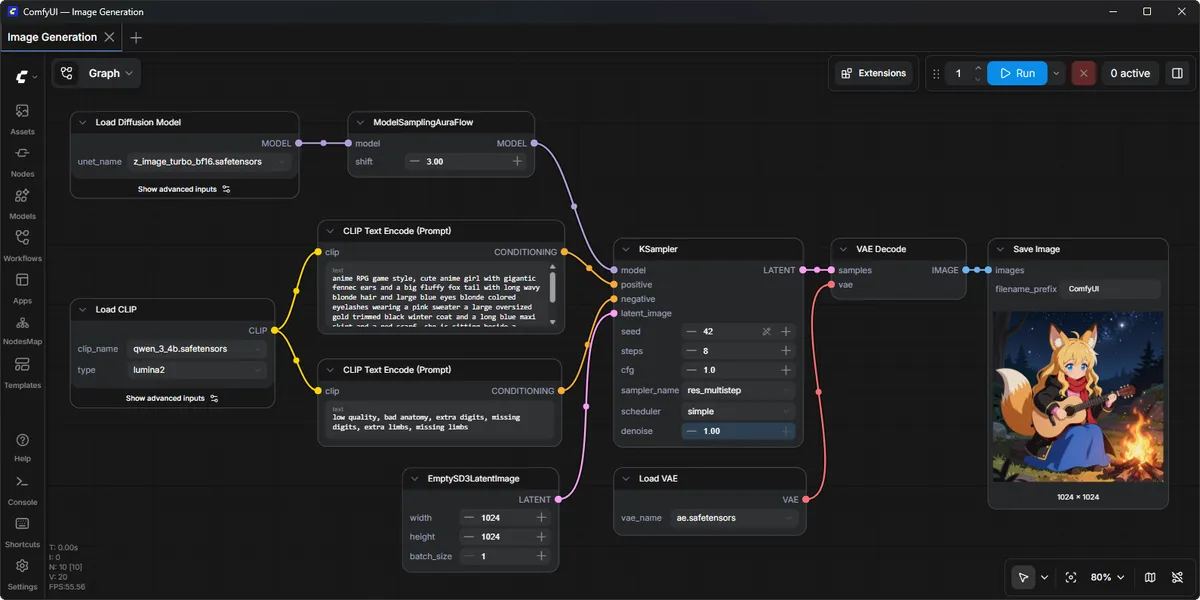

Способ 3: ComfyUI для сложных схем

ComfyUI нужен не всем. Но если вы переходите от сценария «вбил промпт — получил картинку» к повторяемым схемам, цепочкам узлов, пакетной обработке и сохранению логики в JSON, это уже его территория.

Официальная документация ComfyUI фиксирует три вещи, которые для MacBook важнее всего. Первая: ComfyUI Desktop для macOS поддерживает только Apple Silicon. Вторая: настольная версия пока в бета-статусе. Третья: её можно поставить через Homebrew.

brew install comfyuiЕсли настольная версия не подходит, ручная установка у ComfyUI тоже поддерживает Apple Silicon и прямо перечисляет M1, M2, M3 и M4 с Metal acceleration. Но это уже не путь для «попробовать вечером после работы». Это путь для тех, кто точно знает, зачем ему узловая схема. Для выбора между интерфейсами посмотрите и наш разбор ComfyUI, AUTOMATIC1111 и Fooocus: там другой интент и другой вопрос.

Когда имеет смысл Core ML стек Apple

Путь через Core ML нужен не для первого знакомства со Stable Diffusion. Он нужен тогда, когда вы собираете нативное приложение под macOS или iOS и хотите работать в логике Apple-стека, а не просто запускать готовый WebUI.

Официальный репозиторий Apple описывает Core ML Stable Diffusion как два слоя: Python-пакет для конвертации и инференса и Swift-пакет для встраивания генерации в приложения. Hugging Face отдельно уточняет, что готовые Core ML-модели у Apple уже есть для Stable Diffusion 1.4, 1.5, 2.0 base и 2.1 base, а если нужной модели нет, её можно конвертировать через инструменты Apple.

Здесь есть важная развилка. Для Python-инференса у Hugging Face описаны packages, а для Swift и нативных приложений нужны compiled bundles. Поэтому Core ML — это не «ещё один способ быстро поставить Stable Diffusion на MacBook», а скорее разработческий путь для тех, кому нужен именно развёртывание внутри Apple-экосистемы.

Что со скоростью на практике

Здесь лучше не обещать того, чего официальные источники не обещают. Универсальной таблицы вида «M1 — столько-то секунд, M4 — столько-то секунд» у вас не будет. Apple публикует benchmark-ы только для конкретных моделей, compute unit, attention implementation и конкретных версий ОС. Hugging Face отдельно предупреждает, что на MPS скорость резко проседает, когда система упирается в память и начинает свопиться.

Практический вывод проще, чем кажется:

- Если у вас 8 ГБ памяти, начинайте с Draw Things или с максимально простого MPS-сценария и не ждите комфорта на тяжёлых моделях.

- Если у вас 16 ГБ и выше, Diffusers с MPS и ComfyUI становятся заметно реалистичнее как рабочие варианты, а не как технодемо.

- Если вам нужны большие схемы, нативная интеграция или собственное приложение, смотрите не на рекламные секунды, а на то, какой стек вам вообще нужен: Python, узловой интерфейс или Core ML.

Именно поэтому в статье нет красивой таблицы с «официальной скоростью MacBook по поколениям». Такая таблица быстро стареет и слишком часто врёт читателю сильнее, чем помогает.

Итог

Если сжать всё до одного абзаца, картина простая. Хотите самый лёгкий старт — ставьте Draw Things. Нужен код и Python — идите в Diffusers с MPS. Нужны сложные схемы — ставьте ComfyUI. Делаете нативное приложение под Apple — идите в Core ML стек Apple.

Если вы ещё не решили, нужен ли вам локальный стек вообще, сначала сравните его с облачными генераторами. Для этого у нас есть отдельный материал Midjourney vs DALL-E vs Stable Diffusion. А если локальный запуск уже нужен, то на MacBook выигрывает не «самый мощный инструмент вообще», а тот путь, который соответствует вашему сценарию и не заставляет вас делать лишнюю работу.

Источники и дата проверки

Факты, системные требования и продуктовые формулировки в статье сверены 11 мая 2026 года по официальным страницам Apple, Hugging Face, ComfyUI и Draw Things.

- Apple Machine Learning Research: Stable Diffusion with Core ML on Apple Silicon

- Apple: ml-stable-diffusion

- Hugging Face Diffusers: Metal Performance Shaders (MPS)

- Hugging Face Diffusers: How to run Stable Diffusion with Core ML

- ComfyUI docs: macOS Desktop

- ComfyUI docs: System Requirements

- App Store: Draw Things — Offline AI Art

- Draw Things Wiki: Install a Model or LoRA