GitHub Copilot начнёт обучаться на вашем коде: что меняется и как отказаться

С 24 апреля 2026 года GitHub будет собирать промпты, фрагменты кода и контекст из Copilot Free, Pro и Pro+ для обучения ИИ-моделей.

С 24 апреля 2026 года GitHub будет собирать промпты, фрагменты кода и контекст из Copilot Free, Pro и Pro+ для обучения ИИ-моделей. По умолчанию вы уже согласны, если не отключите это вручную.

Марио Родригес, директор по продукту GitHub, 25 марта опубликовал обновлённую политику использования данных. Всё, что вы пишете и получаете в Copilot, теперь может стать обучающим материалом для моделей GitHub и Microsoft. Это отдельная ветка от потребительского Copilot в Edge: там Microsoft меняет браузерный UX, а здесь речь о данных разработчиков.

Что именно изменилось

GitHub обновил Privacy Statement и Terms of Service одновременно. Главное изменение: новый раздел J в пользовательском соглашении, целиком посвящённый ИИ. Он вводит определения AI Feature, Input, Output и прямо говорит: если вы не отключили сбор данных, вы предоставляете GitHub и его аффилиатам (то есть Microsoft) лицензию на использование ваших промптов и ответов для обучения моделей.

Раньше GitHub уже собирал данные взаимодействия, но только для улучшения продукта. Теперь цель расширена до обучения и тренировки ИИ-моделей.

Для пользователей из ЕС и Великобритании GitHub указал legitimate interest (законный интерес) как правовую основу для обработки данных. Не согласие пользователя, а интерес компании. С точки зрения GDPR это спорная позиция — подробнее о регуляторном контексте мы писали в статье AI Act в ЕС: что означает для разработчиков.

Какие данные собирает GitHub

Список того, что попадает в обучающий набор:

- Ответы Copilot, которые вы приняли или отредактировали

- Промпты и фрагменты кода, отправленные в Copilot

- Контекст кода вокруг позиции курсора

- Комментарии и документация, которую вы пишете

- Имена файлов, структура репозитория и паттерны навигации

- Все взаимодействия с функциями Copilot (чат, inline-подсказки)

- Ваши оценки подсказок (лайки и дизлайки)

Собранные данные могут передаваться Microsoft как аффилированной компании. Третьим сторонам, то есть другим провайдерам ИИ-моделей, данные передаваться не будут.

Кого это затрагивает, а кого нет

Изменения касаются пользователей Copilot Free, Pro и Pro+.

Copilot Business и Copilot Enterprise не затронуты. Корпоративные клиенты защищены соглашениями о защите данных (DPA). Студенты и преподаватели, получающие Copilot через образовательные программы, тоже не попадают под новую политику.

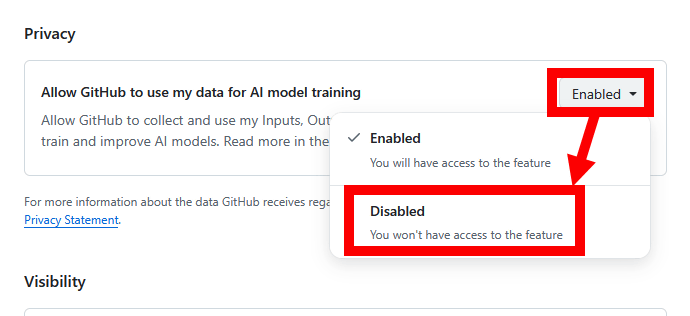

Как отключить сбор данных

GitHub дал месяц на подготовку, до 24 апреля 2026 года. Порядок действий:

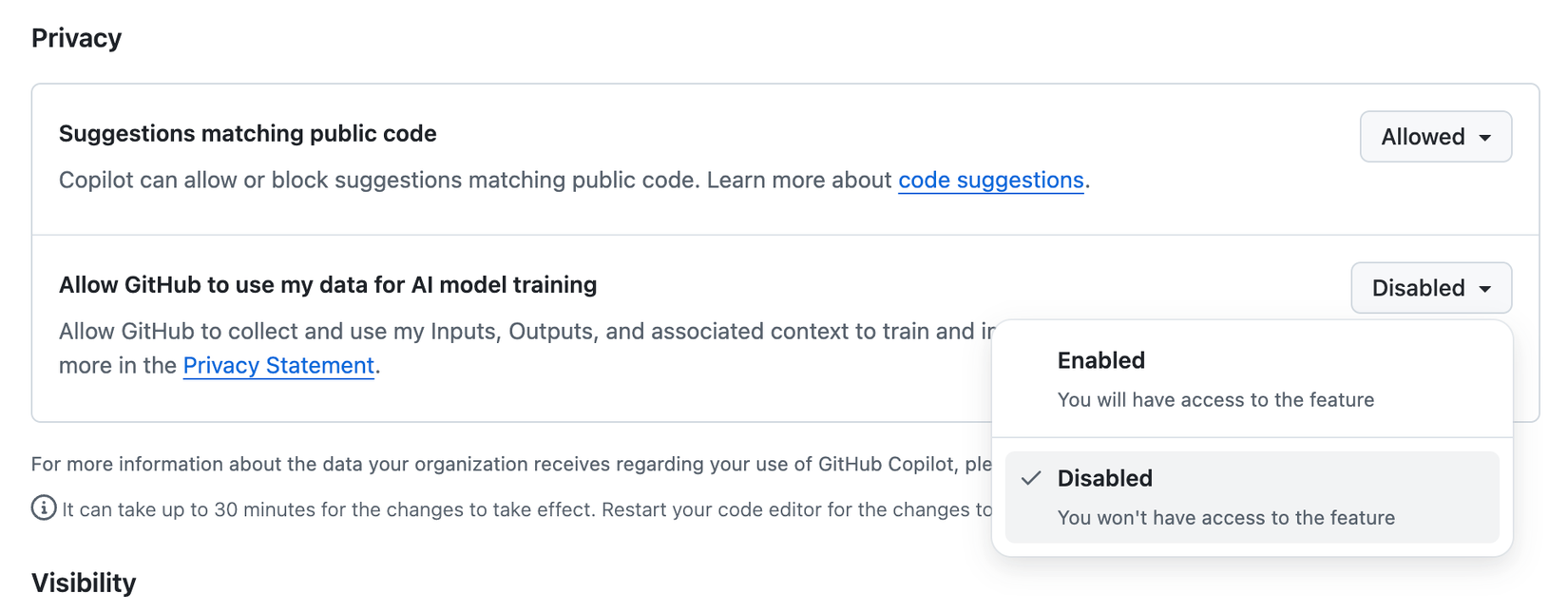

- Откройте

github.com/settings/copilot/features - Найдите раздел Privacy

- Отключите переключатель Allow GitHub to use my data for AI model training

Если вы раньше уже отключали опцию сбора данных для улучшения продукта, ваш выбор сохранён, и данные не будут использоваться для обучения. Новым пользователям и тем, кто никогда не менял настройки, стоит проверить их до 24 апреля.

После отключения GitHub перестанет собирать новые данные с этого момента. Но о судьбе данных, собранных до отключения, в политике ничего не сказано.

Если после opt-out вы хотите пересмотреть сам выбор инструмента, держите рядом обзор ИИ-ассистентов для программистов и наш evergreen-разбор бесплатных ИИ-инструментов для кода.

Приватные репозитории: не всё так просто

GitHub формулирует аккуратно: мы не используем содержимое приватных репозиториев в состоянии покоя (at rest) для обучения моделей. Ключевое слово здесь — в состоянии покоя.

Когда вы активно работаете в приватном репозитории с включённым Copilot, фрагменты кода из этого репозитория становятся частью данных взаимодействия. И эти данные уже попадают под новую политику обучения.

The Register метко заметил: приватные репозитории теперь стоит воспринимать как приватные* — со звёздочкой и мелким шрифтом.

Реакция сообщества

В обсуждении на GitHub Community к моменту публикации The Register набралось 59 дизлайков и всего 3 ракеты. Среди 39 комментариев единственный, кто поддержал идею, — Мартин Вудворд, вице-президент GitHub по работе с разработчиками.

GitHub оправдывает решение тем, что конкуренты поступают так же: Anthropic, JetBrains и Microsoft (через другие продукты) используют аналогичные opt-out политики. Родригес ссылается на внутренний эксперимент: обучение на данных сотрудников Microsoft привело к значимому росту acceptance rate подсказок Copilot.

Что делать разработчику

- Проверьте настройки до 24 апреля. Даже если вы не пользуетесь Copilot Free/Pro активно, убедитесь, что сбор данных отключён.

- Оцените риски для своей команды. Если разработчики используют личные аккаунты Copilot для работы с корпоративным кодом, их данные взаимодействия могут попасть в обучающий набор. Корпоративный Copilot Business/Enterprise этой проблеме не подвержен.

- Следите за правовым контекстом. Ссылка на законный интерес для обучения ИИ — территория, которую европейские регуляторы ещё не до конца освоили. Несколько DPA в ЕС уже присматриваются к подобным практикам. Если вы обрабатываете данные европейских клиентов, это повод для внутреннего аудита.

Этот шаг GitHub укладывается в общий тренд: компании, владеющие инструментами разработки, монетизируют данные взаимодействия через обучение моделей. Вопрос о том, кому принадлежит код, написанный с помощью ИИ, становится ещё сложнее, когда сам процесс написания тоже превращается в обучающие данные.