Как выбрать языковую модель под задачу: практическое руководство

Практическое руководство по выбору языковой модели: GPT-4o, Claude, Gemini, Llama, Mistral. Критерии выбора для разных задач и бюджетов.

На рынке десятки языковых моделей — закрытых и открытых, больших и компактных, универсальных и специализированных. Выбор модели под конкретную задачу — инженерное решение, зависящее от требований к качеству, скорости, стоимости и приватности. Этот гайд помогает структурировать выбор.

Критерии выбора

Прежде чем сравнивать модели, определите приоритеты. Четыре ключевых параметра:

1. Качество ответов. Насколько точными, полными и релевантными должны быть ответы? Для внутреннего чат-бота FAQ достаточно модели среднего уровня. Для медицинского ассистента или юридического анализа нужен максимум.

2. Скорость (латентность). Пользователь в чате ждёт ответ 1–3 секунды. Пакетная обработка документов может занимать минуты. Скорость зависит от размера модели и инфраструктуры.

3. Стоимость. API-модели тарифицируются за токены. Локальные модели — за GPU-время. Разница в стоимости между GPT-4o и GPT-4o-mini — 16 раз. Между GPT-4o и open-source на своём GPU — 50–100 раз.

4. Приватность. Данные отправляются на серверы провайдера? Для некоторых задач (медицина, юриспруденция, внутренние данные компании) это неприемлемо.

Карта моделей: что выбирать

Флагманы (максимальное качество)

Для задач, где качество критично и бюджет не ограничен:

- Claude 3.5 Sonnet (Anthropic) — сильнейшая модель для кодинга, длинного контекста (200K), точного следования инструкциям. $3/1M input, $15/1M output tokens.

- GPT-4o (OpenAI) — универсальная мультимодальная модель. Хороша в рассуждениях, генерации, анализе изображений. $2.50/1M input, $10/1M output.

- Gemini 1.5 Pro (Google) — контекстное окно до 1M токенов. Единственная модель, способная обработать час видео. $1.25/1M input (до 128K), $5/1M output.

Рекомендация: начните с Claude 3.5 Sonnet для текстовых задач и кодинга, GPT-4o для мультимодальных задач.

Баланс цены и качества

Для продакшен-систем с большим объёмом запросов:

- GPT-4o-mini (OpenAI) — 80–90% качества GPT-4o при стоимости $0.15/1M input. Лучший выбор для задач, не требующих максимального интеллекта: классификация, суммаризация, простой Q&A.

- Claude 3.5 Haiku (Anthropic) — быстрый и дешёвый. $0.25/1M input. Хорош для высоконагруженных систем.

- Gemini 1.5 Flash (Google) — оптимизирован для скорости. Один из самых дешёвых API: $0.075/1M input (до 128K).

Рекомендация: GPT-4o-mini — безопасный выбор по умолчанию. Gemini Flash — если нужна минимальная стоимость.

Open-source (контроль и приватность)

Для задач, где данные не должны покидать инфраструктуру:

- Llama 3.1 70B / Qwen 2.5 72B — максимальное качество среди открытых моделей. Сопоставимы с GPT-4o-mini на многих задачах. Требуют ~40 ГБ VRAM в Q4-квантизации.

- Llama 3.1 8B / Mistral 7B / Qwen 2.5 7B — компактные, запускаются на потребительских GPU (8+ ГБ VRAM). Достаточны для классификации, суммаризации, простого Q&A.

- DeepSeek-V2/V3 — агрессивно оптимизированные MoE-модели. Высокое качество при низкой стоимости инференса.

Рекомендация: для русскоязычных задач — Qwen 2.5. Для кодинга — DeepSeek-Coder V2 или Qwen2.5-Coder.

Выбор по типу задачи

Кодинг

Лидеры: Claude 3.5 Sonnet (закрытая), DeepSeek-Coder V2 (открытая). Claude стабильно лидирует на SWE-bench — бенчмарке, измеряющем способность модели решать реальные issues из GitHub. Для автодополнения в IDE — GPT-4o-mini или Codestral от Mistral (специализированная модель для инлайн-подсказок).

Суммаризация и анализ документов

Критичен размер контекстного окна. Gemini 1.5 Pro (1M токенов) обрабатывает целые книги. Claude 3.5 (200K) — достаточно для большинства документов. GPT-4o (128K) — для среднеразмерных текстов.

Поддержка клиентов (RAG)

GPT-4o-mini или Claude 3.5 Haiku для высоконагруженных систем. Для задач с повышенными требованиями к качеству — Claude 3.5 Sonnet или GPT-4o. Открытые альтернативы: Llama 3.1 8B или Qwen 2.5 7B + vLLM для self-hosted.

Мультимодальные задачи

GPT-4o — лучший для анализа изображений в связке с текстом. Gemini 1.5 Pro — для видео и аудио. Claude 3.5 — для скриншотов, документов, диаграмм.

Работа с русским языком

Закрытые модели (GPT-4o, Claude) хорошо работают с русским, хотя оптимизированы для английского. Среди открытых — Qwen 2.5 лучше обрабатывает кириллицу благодаря мультиязычному токенизатору. Llama 3.1 работает с русским, но токенизация менее эффективна (больше токенов на слово = дороже).

Стратегия: не одна модель, а маршрутизация

Продвинутые системы не привязаны к одной модели. Вместо этого — маршрутизатор, который направляет запросы к разным моделям в зависимости от задачи:

- Простые вопросы → GPT-4o-mini ($0.15/1M)

- Сложный анализ → Claude 3.5 Sonnet ($3/1M)

- Обработка изображений → GPT-4o ($2.50/1M)

- Конфиденциальные данные → Llama 3.1 70B (self-hosted)

Маршрутизация может быть rule-based (по типу задачи) или model-based (дешёвая модель оценивает сложность запроса и решает, куда отправить). OpenRouter и LiteLLM упрощают интеграцию с несколькими провайдерами через единый API.

Практические рекомендации

- Начните с API, не с self-hosted. Пока нет доказанного product-market fit, расходы на GPU-инфраструктуру преждевременны.

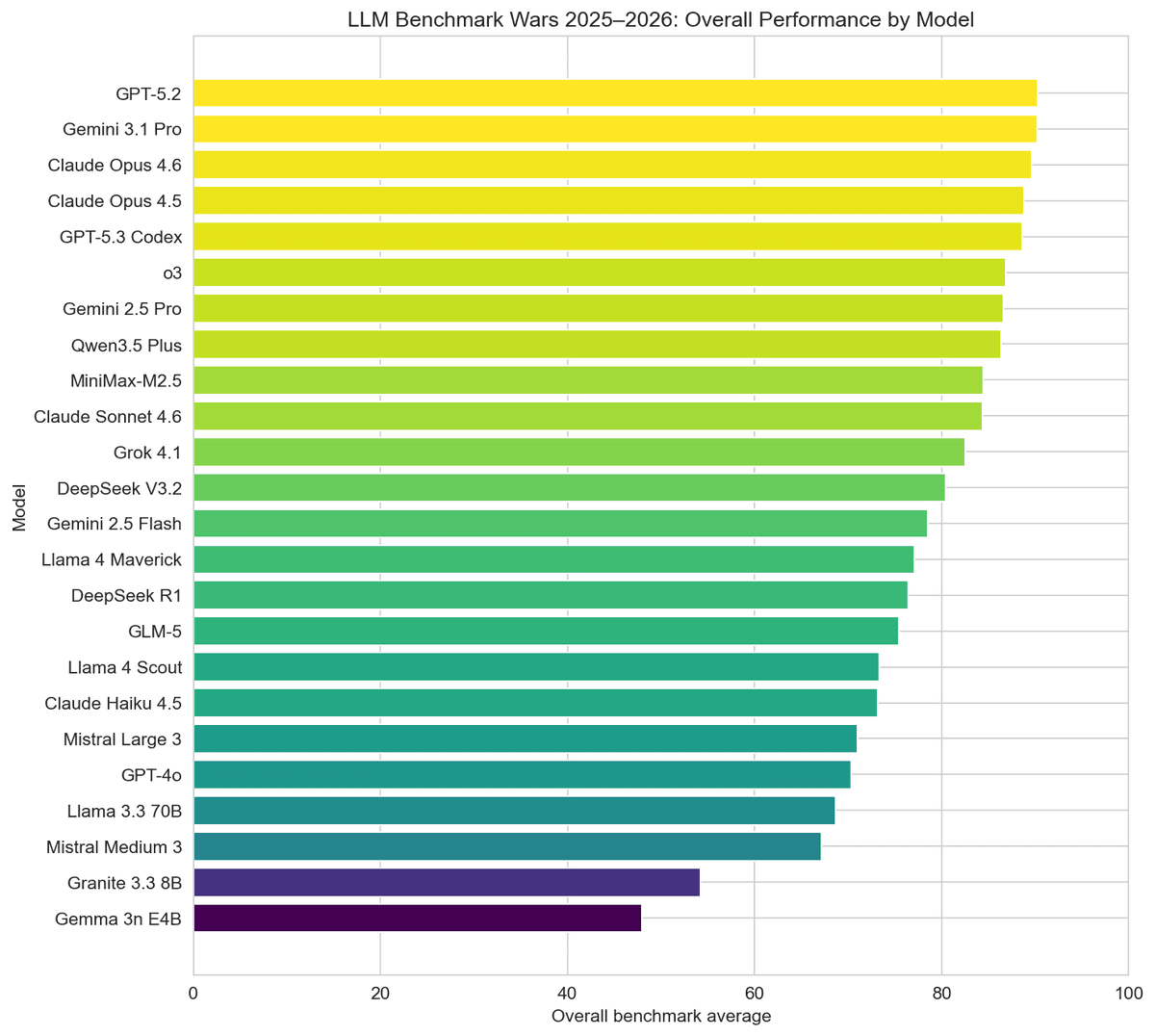

- Тестируйте на своих данных. Бенчмарки — ориентир, но не приговор. Модель, лидирующая на MMLU, может проигрывать на вашей конкретной задаче.

- Считайте полную стоимость. API token cost — только часть. Добавьте: время на интеграцию, обработку ошибок, мониторинг, prompt engineering.

- Планируйте fallback. Модель провайдера может упасть, подорожать или измениться. Архитектура, привязанная к одному провайдеру, — риск.

- Обновляйте выбор каждые 3–6 месяцев. Рынок движется быстро. Модель, которая была лучшей в январе, к июлю может уступить трём конкурентам по цене и качеству.

Фреймворк выбора языковой модели

Выбор LLM — не «какая лучше», а «какая подходит для конкретной задачи, бюджета и требований». Правильный вопрос: определить задачу → требования → ограничения → сравнить подходящие варианты.

Матрица выбора по задачам

| Задача | Приоритет | Рекомендация |

|---|---|---|

| Чат-бот для поддержки | Скорость + цена | GPT-4o-mini или Claude Haiku |

| Анализ кода / Code review | Точность | Claude Sonnet или GPT-4o |

| Генерация статей | Качество текста | Claude Sonnet или GPT-4o |

| Математика / наука | Рассуждение | o3-mini или DeepSeek R1 |

| RAG по документам | Контекст + точность | Claude (200K) или Gemini (1M) |

| Классификация / структурирование | Скорость + цена | GPT-4o-mini (Structured Output) |

| Локальный запуск | Конфиденциальность | Llama 4 Scout / Mistral 7B |

| Русский язык | Качество RU | YandexGPT или Claude/GPT с RU промптом |

Ключевые технические параметры

Контекстное окно: сколько текста модель «видит» за раз. GPT-4o: 128K токенов (~90K слов). Claude: 200K. Gemini 1.5 Pro: 1M. Для анализа длинных документов — выбирайте модель с соответствующим контекстом.

Latency: время от запроса до первого токена. Критично для real-time приложений. GPT-4o-mini и Claude Haiku ~200–400мс. GPT-4o и Claude Sonnet ~500–800мс. o3 — секунды.

Structured Output: гарантированный JSON по схеме. Критично для парсинга данных. OpenAI (Structured Outputs), Anthropic (tool_use) и Gemini поддерживают. Не все open source модели.

Бенчмарки: что читать и что игнорировать

Популярные бенчмарки (MMLU, HumanEval, MATH) полезны для общего сравнения, но плохо предсказывают производительность на конкретной задаче. Создайте собственный eval-набор из ~50 реальных примеров вашей задачи. Запустите кандидатов на нём и сравните качество + стоимость + скорость — это даст реальный ответ.

Стратегия: начните с малого

- Прототип на GPT-4o или Claude Sonnet (лучшее качество, чтобы понять потолок)

- Оцените где достаточно GPT-4o-mini / Claude Haiku (в 60–70% случаев дешёвая модель справляется)

- Рассмотрите self-hosted (Llama/Mistral) только при нагрузке >$500/мес или требованиях к конфиденциальности

- A/B тест двух финальных кандидатов на реальных пользователях перед окончательным выбором

Читайте также

- Что такое LLM и как работают языковые модели

- GPT-4o vs Claude vs Gemini: тест на русском

- ChatGPT Plus vs Claude Pro vs Gemini Advanced

Подробнее: Полный гайд по LLM для разработчиков